用OpenClaw的都知道,动不动就要花钱买 Token,用多了心疼,不用又怕跟不上。

后来我试了试 OpenClaw + Ollama 本地大模型,一下子就舒服多了。

这能把大模型完全跑在自己电脑上,不用依赖云端,也不用为 Token 花钱,对话记录、数据都在本地,隐私和可控性都强很多。

整个过程也不难,这里用最简单的方法带着大家跟着步骤一步步来,新手也可以轻松搞定。如果你也想摆脱Token的焦虑、想体验不花钱的Openclaw,并且想拥有一个真正属于自己的本地 AI 助手,那这个组合真的值得试试。

OpenClaw + Ollama 本地大模型

本地安装Ollama

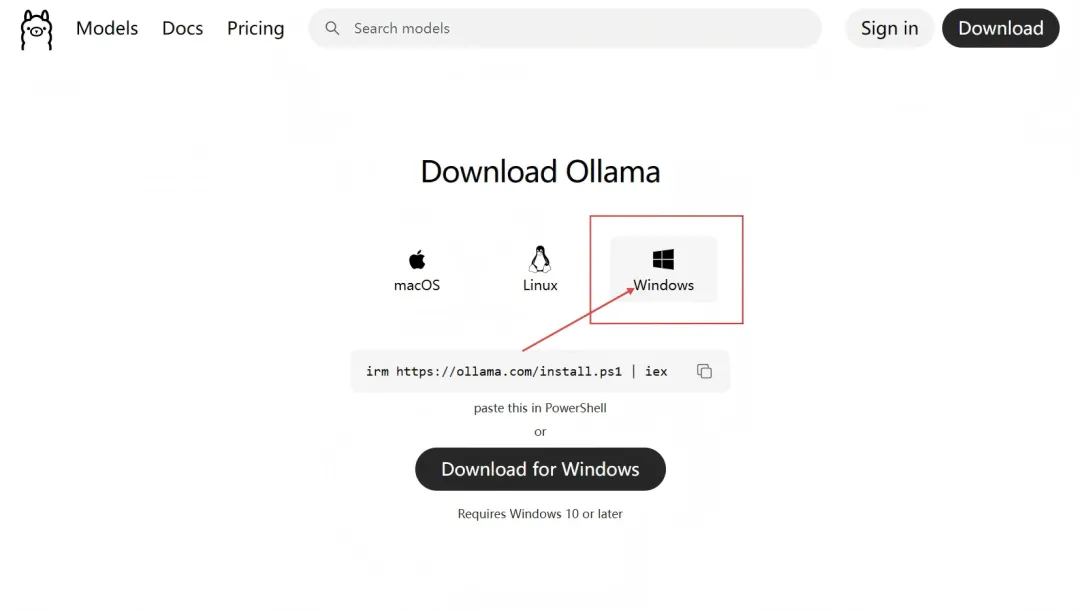

1、我们首先可以通过浏览器访问Ollama的官网:

官网地址:https://ollama.com/download

我们在对应的官网中选择Windows的版本

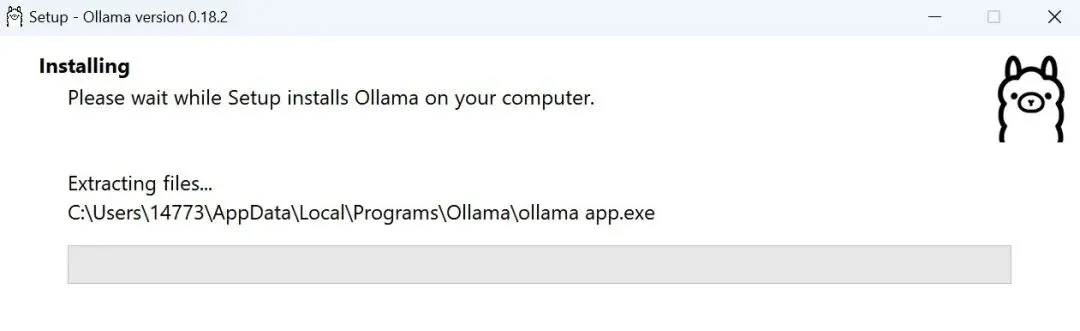

只需要点击下载即可,这里如果速度过慢多等待一会,下载好了双击即可后查看,这边可以记住地址的位置。

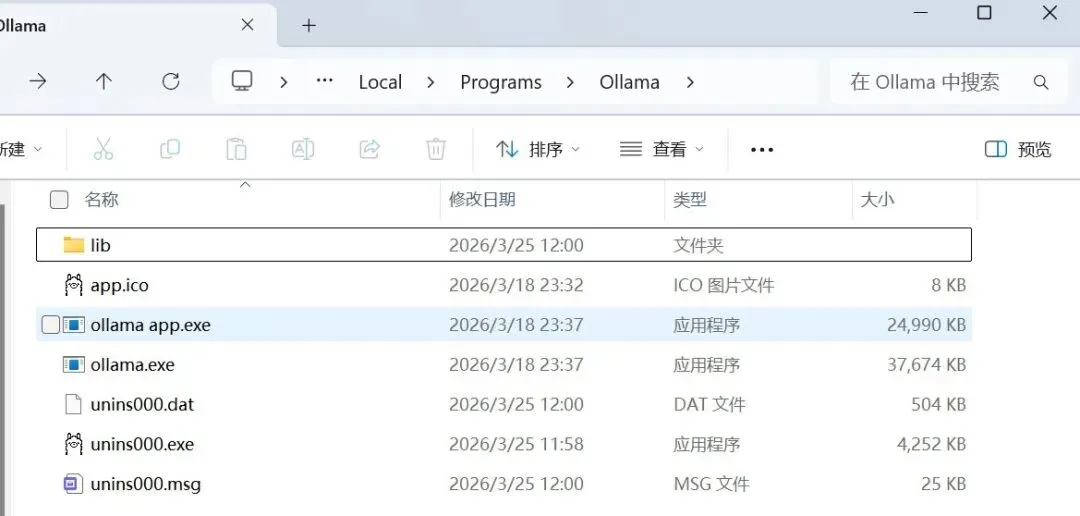

2、打开Ollama的文件地址位置,在这里我们可以看到:

这个时候就说明我们已经下载成功了,同时还会显示的Ollama的客户端窗口,这就表示安装已经完成,当前默认会下载几个g的gemma3:4b的默认模型。这就已经代表我们成功安装了Ollama。

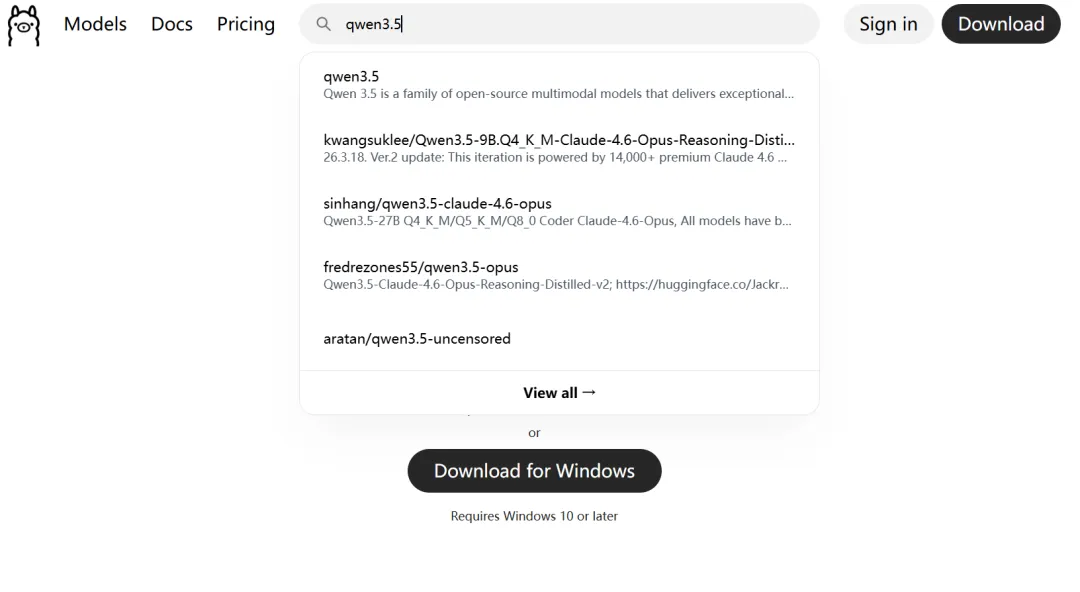

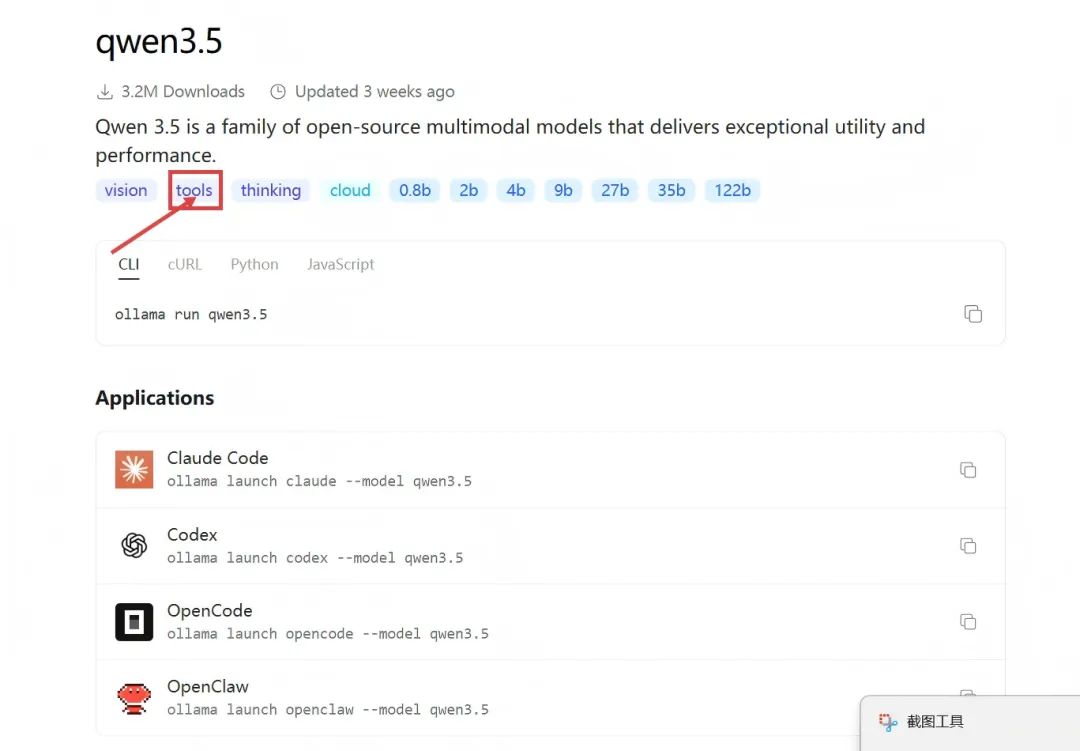

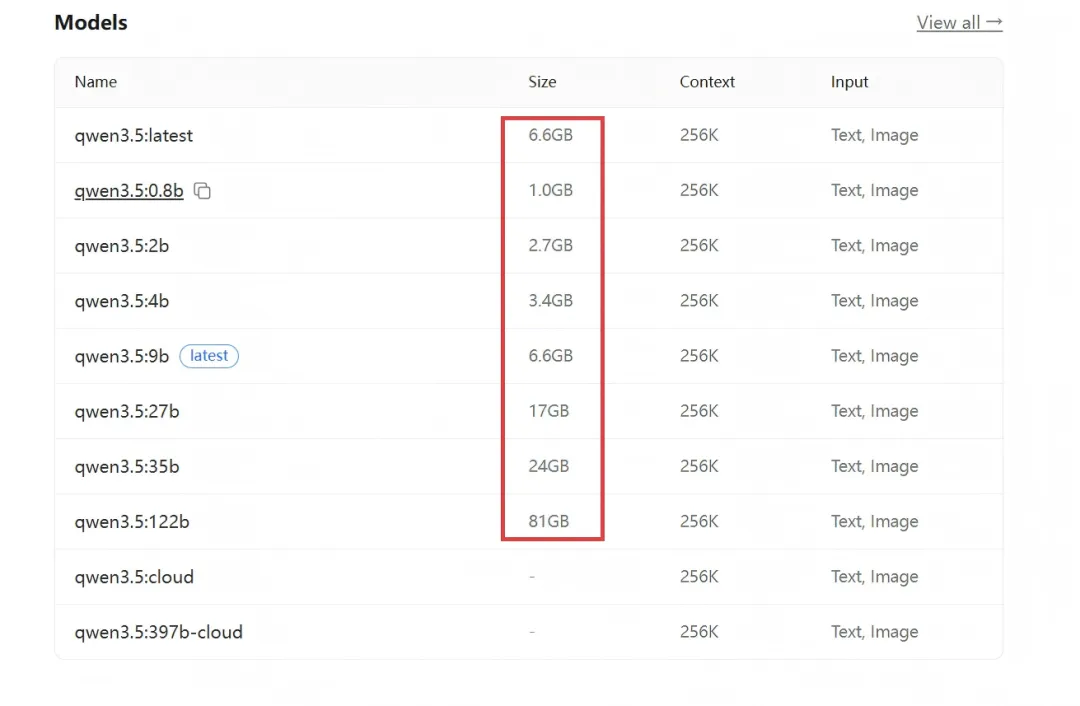

3、大模型版本根据个人需求自由选择,这里如果电脑显卡的配置高我们就可以选择27b甚至是35b和122b(推荐企业级使用),可以在Ollama的官网进行自由选择,也可以在Ollama的客户端端口下载,这里我建议在官网下载,可以清楚的了解我们的需求选择和查看所需的内存,这里我们还需要考虑想要能够和OpenClaw对接的话,模型必须带工具调用功能(必须带tools标签)。

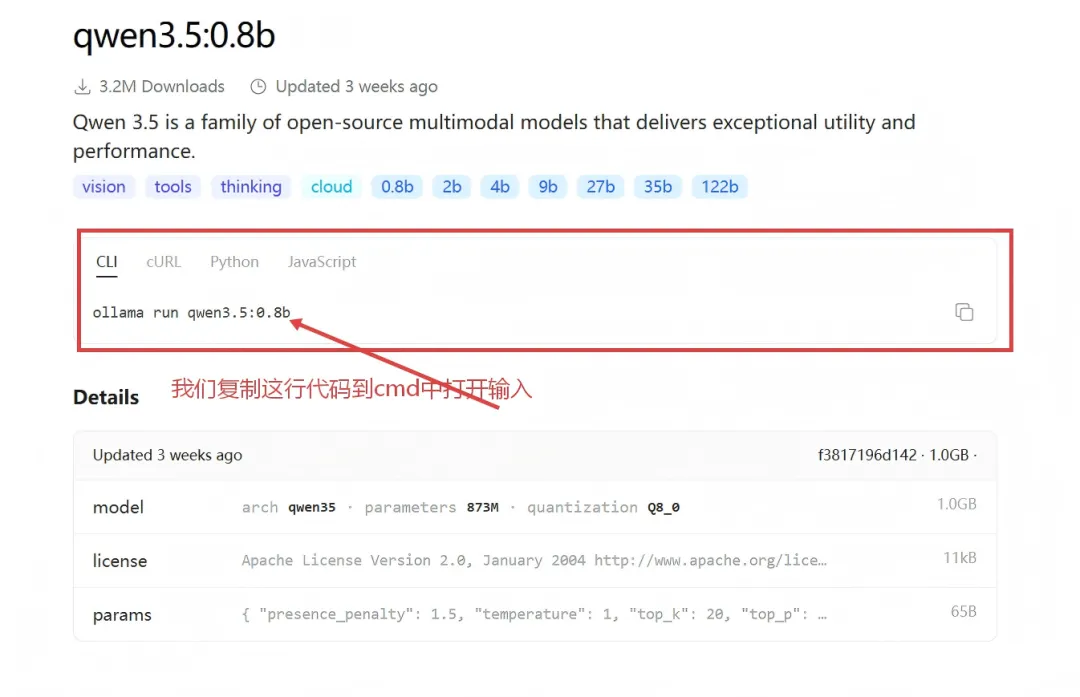

这里我们选择演示下载qwen3.5,0.8b这个版本的,大部分电脑目前都可以轻松带动,这里我个人比较推荐4b的这个版本,能满足一些日常的使用。

这里我们复制代码到cmd中回车

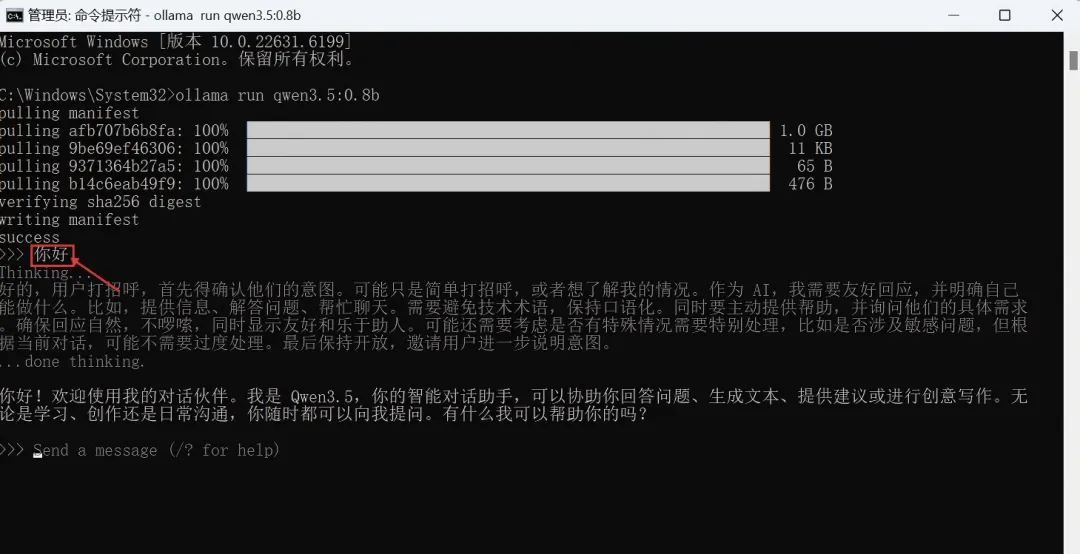

ollama run qwen3.5:0.8b

4、这里我们耐心等待下载完成,就可以直接在命令窗口对话了,到这里我们已经完成了一大半了,再坚持坚持马上就完工。

下载安装OpenClaw实现本地化部署Ollama

iwr -useb https://openclaw.ai/install.ps1 | iex

node.js:https://nodejs.cn/en/download git:https://git-scm.com/install/windows

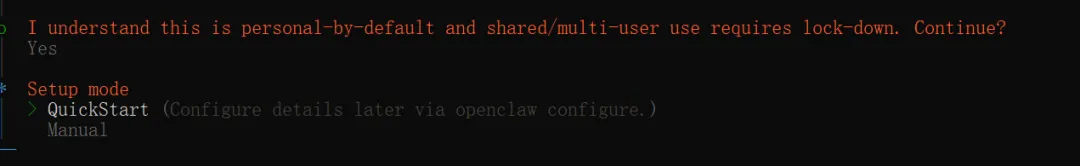

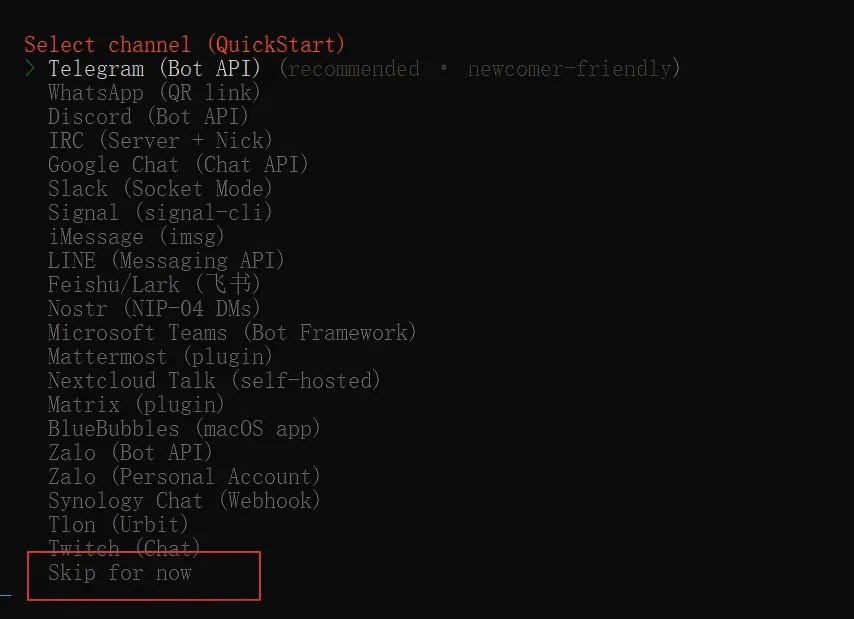

2、接下来看到的是 OpenClaw 安装过程中的配置模式选择界面,在这里跟着我的步骤选择,光标默认选中 QuickStart(快速启动模式,推荐新手)

操作步骤

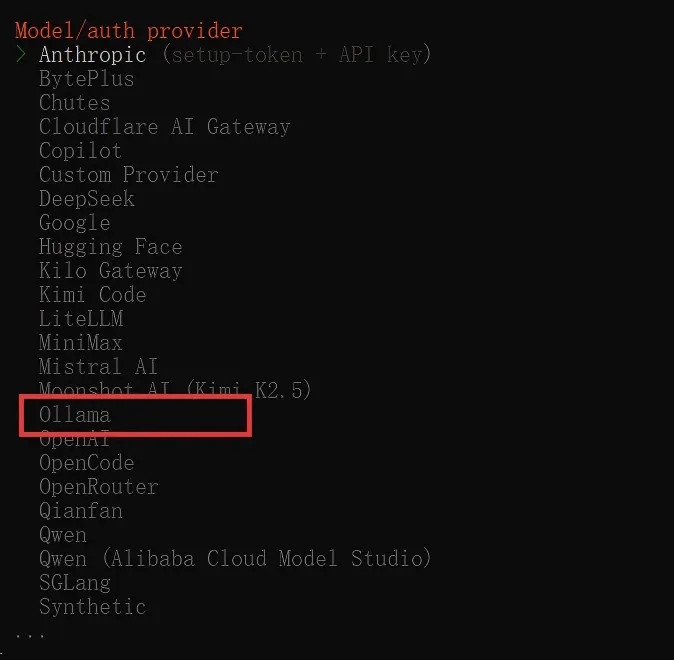

在列表中找到 Ollama选项,按方向键选中它。

按下回车键确认选择。

操作步骤

Model :输入你已拉取的模型名

qwen3.5:0.8b,回车。Ollama Base URL:直接回车,使用默认地址

http://localhost:11434。Olama mode:选择本地Local后,直接回车

后续选项全部回车默认,最后回车确认配置。

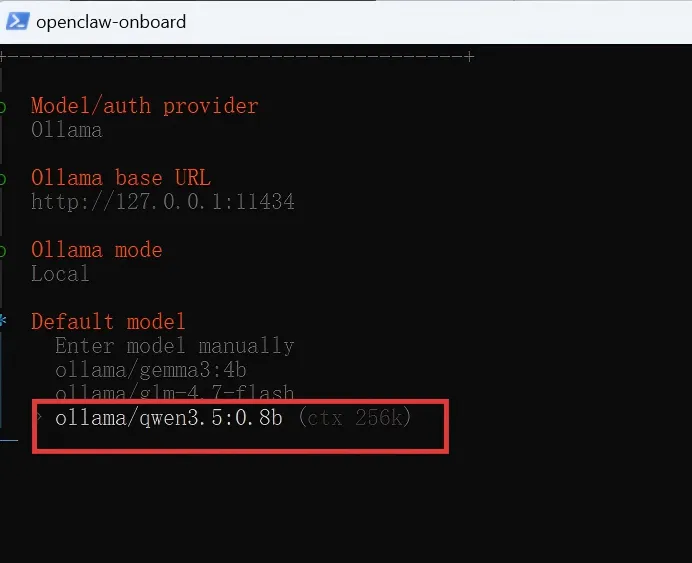

操作步骤

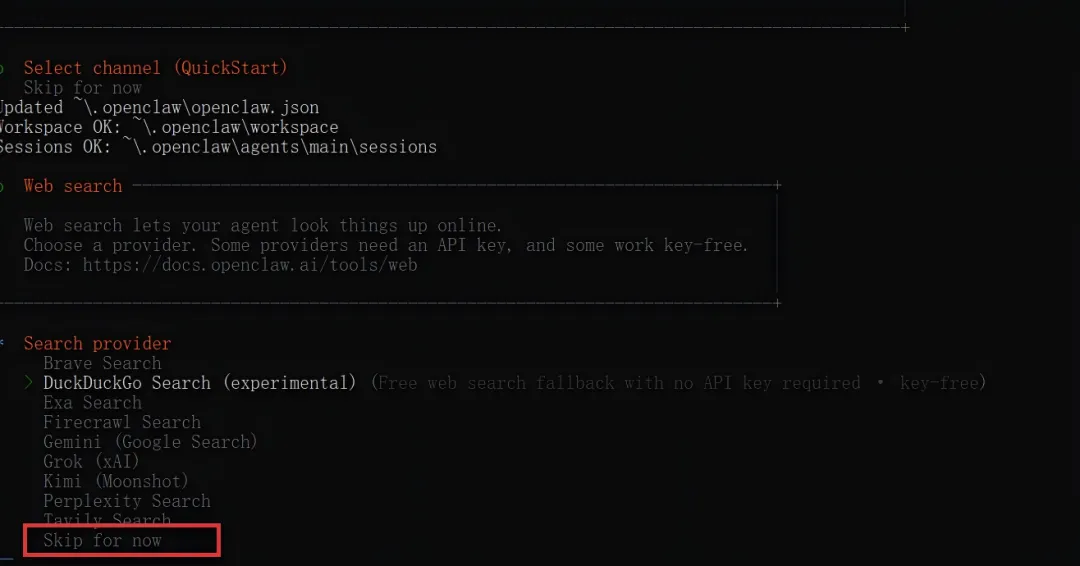

在列表中找到 Skip for now 选项,按方向键选中它。

按下回车键确认选择。

此步骤用于跳过配置聊天渠道,直接完成 OpenClaw 的初始化配置。

后续你可以通过网页控制台(

openclaw dashboard)使用模型,无需配置聊天软件。

依旧选择Skip for now

操作步骤

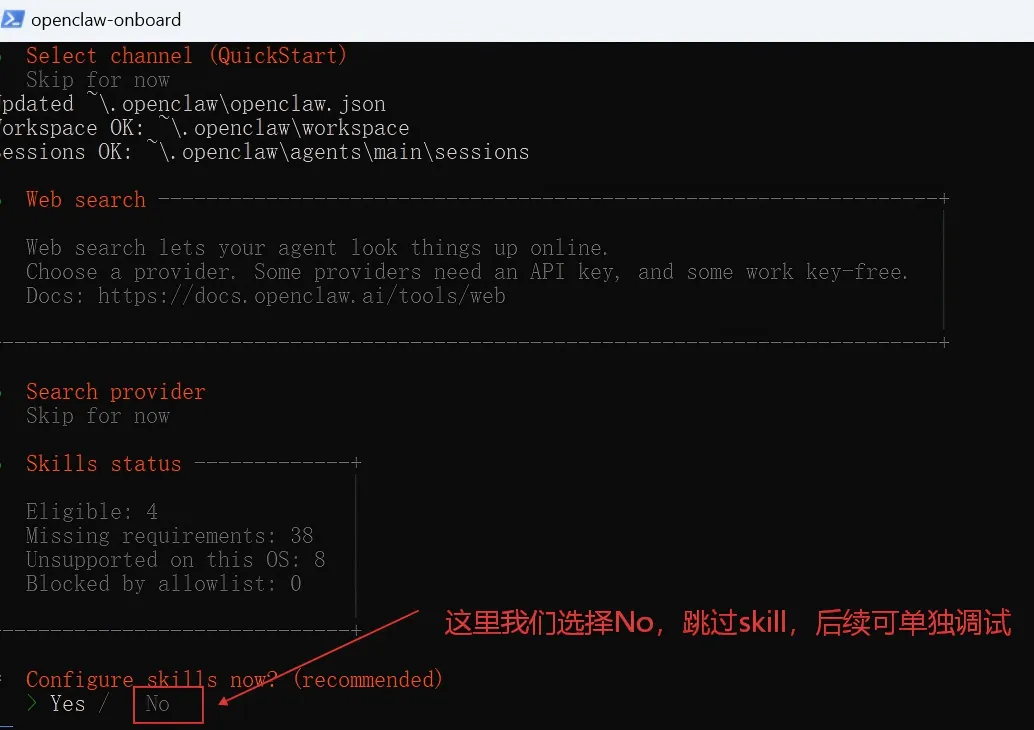

光标默认选中No,直接按回车键确认。

若想后续手动配置技能,选择 No 即可跳过;若需配置,选择 Yes 并按指引操作。

操作步骤

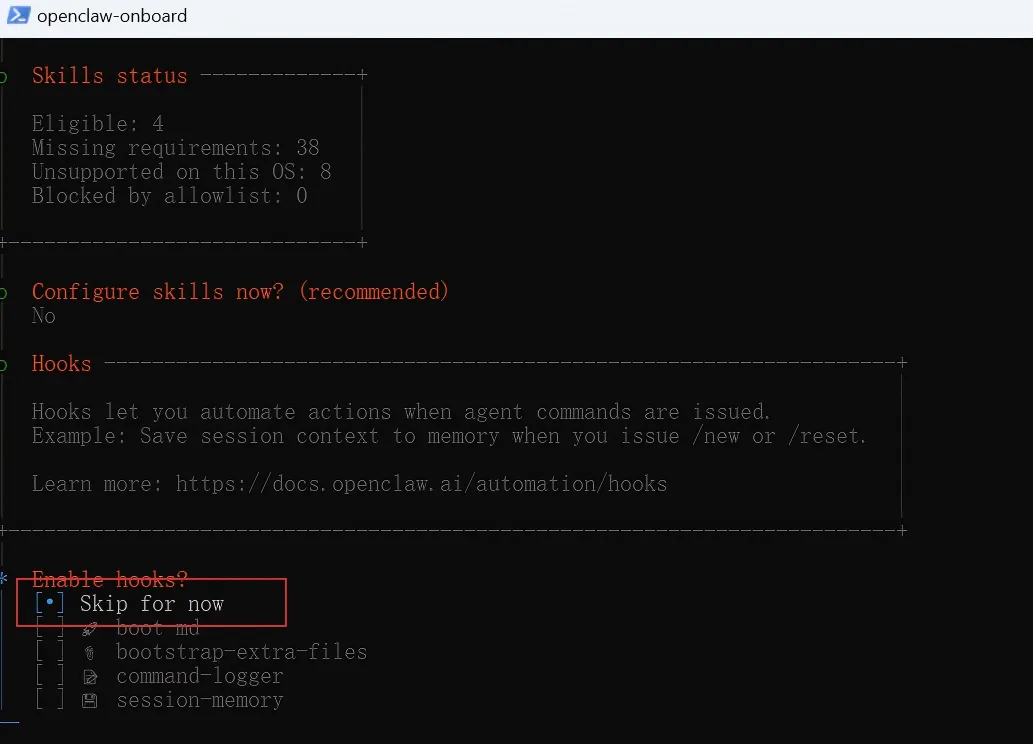

光标默认选中 Skip for now,直接按回车键确认。

此步骤用于跳过钩子(Hooks)自动化配置,直接完成初始化。

操作步骤

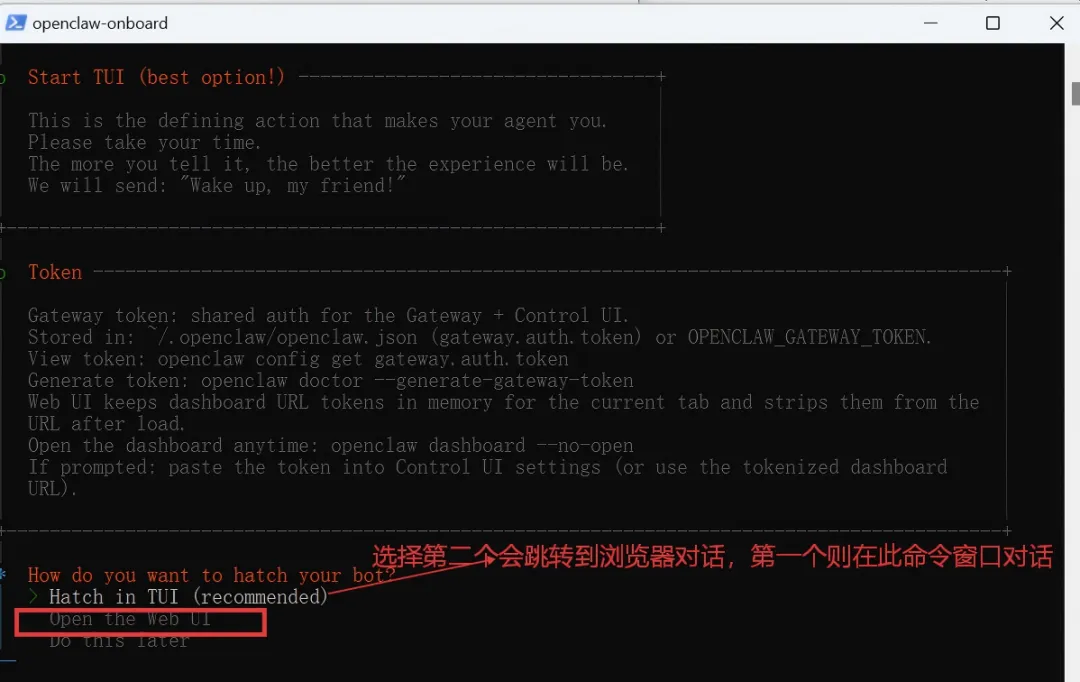

光标默认选中 Hatch in TUI (recommended),这里我们选择第二个按回车键确认。

进入Web交互界面,按提示完成代理初始化(如设置角色、偏好等)。

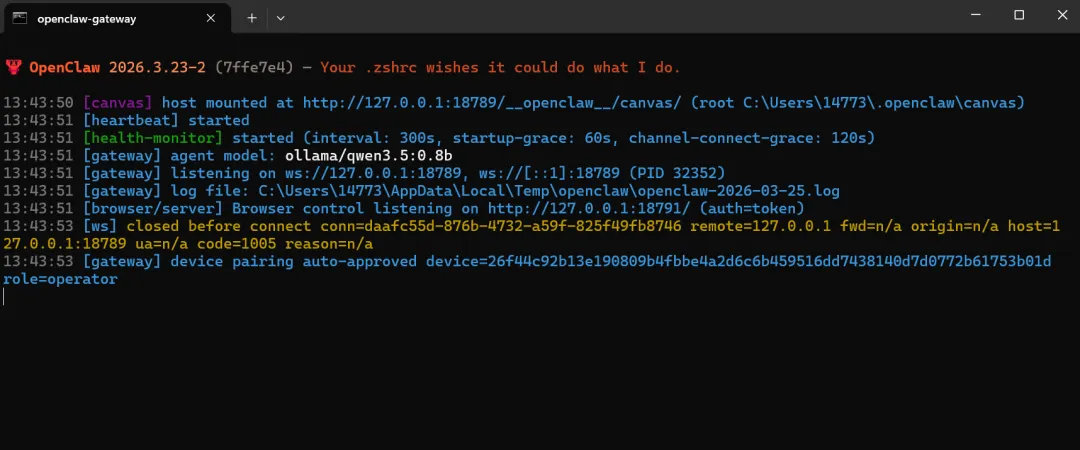

这里会有个cmd的弹窗提醒,这时候我们已经完成了全部的过程步骤。

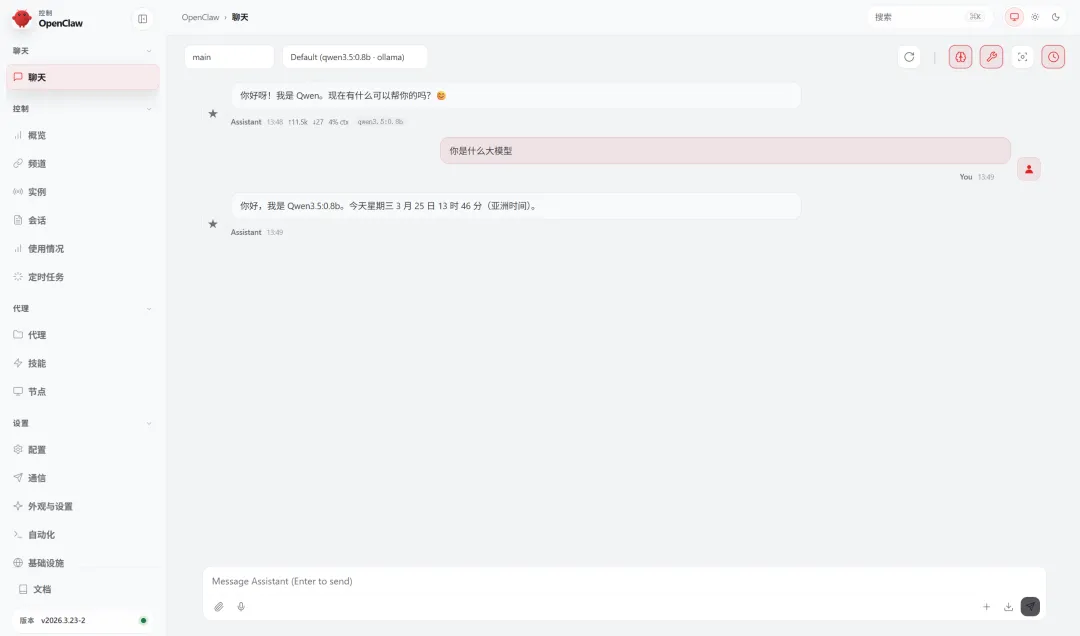

3、这个时候web页面已经可以正常使用,Openclaw正常运行啦

到这里,整个 OpenClaw 搭配 Ollama 实现本地大模型部署的教程就全部完成了,整个过程没有复杂的操作,跟着步骤一步步来,就算是纯新手也能轻松上手。

不用再为Token 花钱焦虑,也不用担心数据上传云端的隐私问题,把强大的 AI 助手牢牢握在自己的电脑里,这种自由又安心的体验,真的试过就回不去了。如果你也想拥有一个专属的本地 AI,不妨跟着教程动手试试.

夜雨聆风

夜雨聆风