2025 年 11 月,奥地利开发者 Peter Steinberger 在 GitHub 上发布了一个名为 OpenClaw 的开源项目。不到半年,27 万 Star,GitHub 历史上增长最快的开源项目。

紧接着,Meta 禁止员工在工作设备上使用,中国工信部发布安全预警,多家安全研究机构披露了严重的远程代码执行漏洞。

一边是开发者社区的狂热追捧,一边是安全机构的密集警告。企业该怎么看这个新东西?

一、OpenClaw 是什么

OpenClaw(中文名“龙虾”,因其红色龙虾 Logo 而得名)是一个开源、可本地部署的 AI 智能体(Agent)框架。

一句话说清楚:让 AI 从“你问我答”变成“你说目标,我干活”。

传统的 ChatGPT、Claude 等 AI 工具是“对话式”的——你发一个问题,它回一个答案。而 OpenClaw 是“任务式”的——你给它一个目标(比如“帮我审查这份代码”),它会自主规划步骤、调用工具、执行操作、返回结果。

打个比方:传统 AI 是一个“咨询顾问”,你问它答;OpenClaw 是一个“实习生”,你交代任务它去执行。

核心特征:

开源开放:MIT 协议,代码完全公开,任何人都可以审计、修改、自行部署。不绑定任何模型供应商,不强制使用任何云服务,支持商用。

本地部署:所有数据在本地处理,不经过第三方服务器。对企业来说,这意味着代码、文档、内部数据不会被上传到外部。

多模型兼容:支持 OpenAI、Anthropic、Google、国内主流大模型(通义千问、智谱 GLM、MiniMax 等)等多种模型,可以根据场景和成本灵活选择。

二、OpenClaw 的技术架构

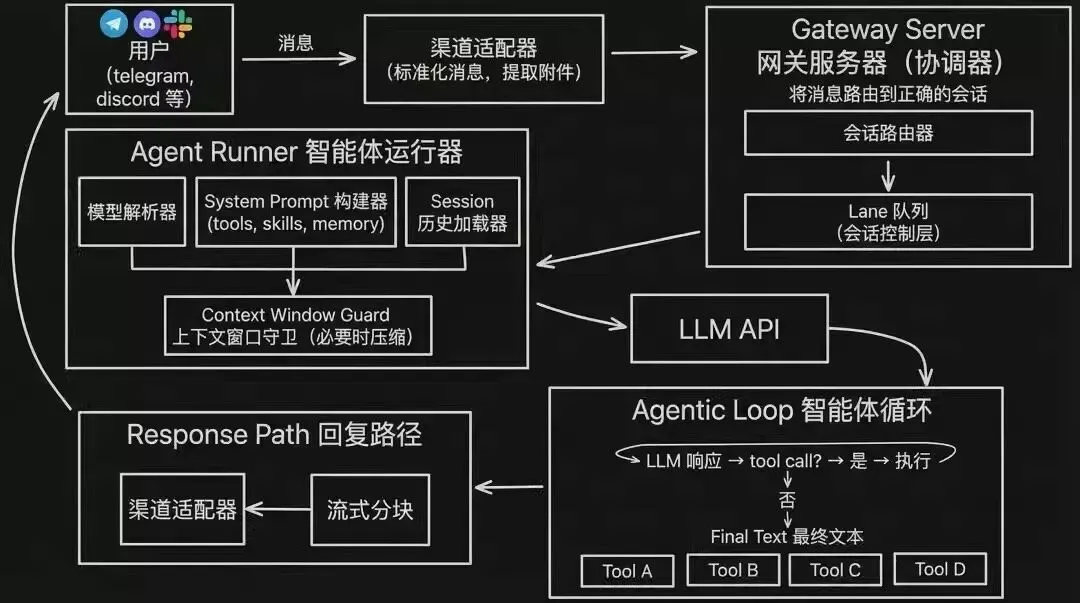

OpenClaw 不是一个大模型,而是一个运行大模型的框架。它的架构可以简化为以下几个核心组件:

Gateway(网关):系统入口,负责接收指令、管理会话、协调各组件工作。相当于“前台”,所有任务从这里进来,结果从这里出去。

Agentic Loop(智能体循环):这是 OpenClaw 的核心引擎。它模仿人类解决问题的方式:观察环境 → 制定计划 → 执行动作 → 检查结果 → 调整策略。每一步都可以调用外部工具(文件操作、代码执行、网络请求等)。

Memory System(记忆系统):短期记忆用于当前对话上下文,长期记忆用于跨会话知识积累。让智能体在连续任务中保持连贯性。

Skills / Plugins(技能与插件):类似手机上的 App,每个 Skill 是一个可调用的能力单元。官方和社区提供了大量现成技能:代码审查、文档生成、数据分析、Git 操作、邮件处理等。用户也可以自定义开发。

Multi-Entry Interaction(多入口交互):支持多种交互方式:命令行终端、Web 界面、微信/钉钉/飞书消息、API 调用等。可以把 OpenClaw 接入企业现有的沟通工具。

三、OpenClaw 能做什么——企业场景应用

1. 软件开发辅助

这是 OpenClaw 目前最成熟的应用场景:

代码审查:自动分析 Pull Request,识别潜在 Bug、安全漏洞、代码风格问题,输出结构化审查报告

自动化测试:根据需求文档生成测试用例,执行测试并分析结果

文档生成:从代码自动生成 API 文档、架构说明、变更日志

Bug 排查:给定错误日志,自动定位问题、分析根因、提出修复建议

部署脚本:根据项目结构生成 CI/CD 配置、Dockerfile、部署脚本

2. 数据处理与报告

自动化报表:定期从数据库或文件中提取数据,按模板生成报告

数据清洗:批量处理不一致的数据格式,标准化输出

文本摘要:对长文档、会议纪要、技术报告进行摘要和要点提取

格式转换:PDF 转 Word、Excel 数据整理、Markdown 排版等

3. 运维与自动化

日志分析:自动扫描日志文件,识别异常模式,生成告警

环境配置:根据需求自动配置开发/测试/生产环境

定时任务编排:将多个操作串联成自动化流水线

4. 知识管理

内部知识库问答:将企业文档导入后,员工可以直接提问获取答案

技术调研:给定一个技术方向,自动搜集资料、整理对比、输出分析报告

制度查询:对公司规章、流程文档进行检索和问答

5. 临床试验运营场景

对于CRO团队,OpenClaw 的自主任务执行能力可以覆盖大量文档密集、流程标准化的工作:

文档处理与审核

• 知情同意书(ICF)审核:上传 ICF 草稿后,自动对照法规模板检查要素完整性(如是否包含风险描述、赔偿条款、退出权利等),输出缺失项清单

• 方案偏离(PD)报告初筛:根据偏离描述、严重程度、GCP 条款,自动归类并生成初步判读意见,供医学审核人员复核

• 临床研究报告(CSR)辅助撰写:按 ICH E3 结构,从原始数据表格和统计分析结果中自动填充各章节框架,减少人工排版和搬运时间

• TMF 文档完整性检查:对照 Trial Master File 模型,自动检查各阶段应归档的文档是否齐全,标记缺失项

数据质量与监查辅助

• CRA 监查预检:上传知情同意书、病历、授权书等多类文件后,按监查要点(如签字日期一致性、入排标准符合性、合并用药记录完整性)自动核查,输出问题清单供 CRA 复核

• EDC 数据质疑辅助:根据数据核查计划(DVP),对异常数据模式自动生成 Query 建议文本

• 受试者预筛支持:处理筛选期病历和检查报告,对照入排标准输出结构化判读意见

注册与合规

• 伦理申报材料整理:按机构伦理委员会要求,自动汇总并排版申报材料清单(方案、ICF、研究者手册更新摘要等)

• IND/NDA 申报文档合规检查:对照 CTD 格式要求,检查申报资料的章节完整性和格式规范性

• 法规更新追踪:定期检索 FDA、EMA、NMPA 等监管机构发布的指导文件变更,输出差异摘要和对在研项目的潜在影响分析

日常运营

• 项目周报/月报生成:从项目管理系统提取进度数据,按模板自动生成汇报文档

• TMF 索引维护:自动更新试验主文件索引,标记超期未归档的文档

• 培训材料生成:根据新版 SOP 或流程变更,自动生成培训要点摘要和考核题目

• 供应商资质管理:定期检查供应商证照有效期,提前预警到期需更新的资质文件

注意:以上场景中 OpenClaw 输出均作为辅助初稿,需由专业人员复核确认后方可使用。在临床试验受监管环节中,AI 输出不能替代人工专业判断。

6. 多智能体协作

OpenClaw 支持多个 Agent 协同工作,可以模拟一个小型团队:

一个 Agent 负责写代码,另一个负责审查

一个 Agent 负责数据处理,另一个负责报告生成

一个 Agent 负责监控告警,另一个负责应急处置

在 CRO 场景中:一个 Agent 负责文档解析,另一个负责合规比对,第三个负责输出审查报告

这种模式在复杂任务场景下非常有价值,但也意味着更高的资源消耗和更复杂的调试难度。

四、OpenClaw 在企业应用中的现状

4.1 当前热度从何而来

OpenClaw 的爆发踩中了几个趋势的交汇点:

企业不满足于 AI 只能回答问题,需要它能真正执行任务。OpenClaw 的架构对准了这个需求

数据主权意识在增强。金融、医疗、制药等强监管行业不愿意把核心数据发到第三方 AI 服务,OpenClaw 的本地部署模式满足了这一点

开源 + MIT 协议,没有许可证成本和供应商锁定

4.2 实际采用情况

从公开信息和社区反馈来看,OpenClaw 在企业中的使用主要集中在:

初创公司和中小团队:技术团队自行部署,用于提升开发效率

大公司的个人开发者:作为个人生产力工具使用,但尚未得到公司层面的正式批准

技术研究团队:用于 AI Agent 方向的探索和实验

大型企业的正式采用目前仍非常谨慎。Meta、Apple 等公司已明确限制或禁止员工在工作环境中使用 OpenClaw。

五、风险与局限——企业必须知道的问题

在用 OpenClaw 之前,企业需要搞清楚以下风险。

5.1 安全风险(最关键)

远程代码执行(RCE)漏洞:OpenClaw 通过 WebSocket 接收指令并执行操作。安全研究人员发现,攻击者可以通过劫持 WebSocket 连接,在用户机器上执行任意命令。这意味着,如果你的 OpenClaw 实例暴露在网络上,攻击者可能直接控制你的服务器。

提示注入攻击(Prompt Injection):恶意构造的输入可以欺骗 AI 智能体执行非预期操作。比如,在一封邮件中嵌入隐藏指令,让 OpenClaw 在处理邮件时泄露敏感信息或执行危险操作。由于 OpenClaw 具备文件操作、代码执行等权限,一旦被注入成功,后果远比普通聊天机器人严重。

数据泄露风险:OpenClaw 在本地处理数据,但这并不意味着绝对安全。如果配置不当,或者网络隔离不到位,内部数据仍然可能被外部访问。

供应链风险:OpenClaw 的 Skills/Plugins 生态允许第三方贡献插件。这些插件的质量和安全性参差不齐,恶意插件可能在执行过程中窃取数据或植入后门。

凭据管理薄弱:OpenClaw 默认以明文形式存储 API Key 和访问凭证,缺乏企业级的密钥管理机制。

5.2 平台兼容性

macOS 支持最完善,体验最好

Windows 和 Linux 支持相对薄弱,安装和配置门槛较高

国产操作系统(统信 UOS、麒麟等)的支持基本空白

对于以 Windows 办公环境为主的企业,部署和维护成本显著增加

5.3 生态成熟度

OpenClaw 是一个年轻的项目,面临以下问题:

文档不完善:很多功能缺乏详细文档,需要看源码才能理解

API 不稳定:核心接口仍在频繁变动,基于它开发的应用可能随时需要适配

社区治理不成熟:Issues 和 PR 的处理速度跟不上社区增长的速度

缺乏企业级特性:没有成熟的权限管理、审计日志、多租户支持

5.4 合规与监管

工信部已针对 OpenClaw 发布安全风险预警

在医疗、金融等强监管行业,使用未经安全审计的 AI 工具可能违反合规要求

OpenClaw 处理的数据(包括代码、文档、业务数据)是否构成“重要数据出境”,需要法务评估

AI 生成内容的准确性和可追溯性,在受监管场景下需要额外验证

5.5 性能与成本

本地部署意味着企业需要自行承担 GPU/算力成本

多智能体协作场景下的资源消耗显著

与云服务相比,运维复杂度和人力成本增加

六、给企业的建议

如果你在评估是否引入 OpenClaw

可以做的:

1. 在隔离环境中试用,了解其能力和边界

2. 由技术团队进行安全评估,重点关注网络暴露、权限控制、数据流向

3. 选择低敏感场景做小范围试点(如内部文档处理、非核心代码审查)

4. 持续关注项目更新和安全公告

不建议做的:

1. 将 OpenClaw 直接暴露在公网或内网核心区域

2. 在涉及核心业务数据、客户隐私数据的场景中使用

3. 在没有安全团队审核的情况下安装第三方插件

4. 在合规要求严格的业务流程中替代人工审核环节

七、写在最后

AI 从“对话工具”走向“自主智能体”,这个方向不会停。OpenClaw 是目前这个方向上最活跃的项目。

但“技术趋势”和“能直接上生产”之间还有一段距离。OpenClaw 现阶段更适合作为技术探索和试点的对象,不建议作为生产环境的核心依赖。

一个积极信号:OpenClaw 已被 OpenAI 收购,创始人加入了 OpenAI 团队。后续的工程能力和安全投入大概率会加强,权限管理、审计、合规这些企业级特性有望逐步补齐。

除此之外OpenClaw 出现之后国内大厂快速跟进,已经有各种版本的“龙虾”上市(QClaw 等变体),企业级龙虾应用呼之欲出。同时为了兼用各种Agent ,目前各大软件厂商已经开始做出改变,从“人机界面”的软件设计已经渐渐开始朝着AI-CLI模式设计,方便Agent 直接调用软件能力,不再做封闭的界面生态,人+AI协作比想象中来的要快。由此可见,龙虾带来的不只是工作方式的改变,更是AI生态的又一次重塑,甚至能说是革命。

对我们来说,问题不是“用不用”,而是什么时候用、怎么用、在什么边界内用。保持关注,小步试错。

投稿:科林利康 AI 共创中心

苏州科林利康医药科技股份有限公司

质量 | 诚信 | 效率 | 仁爱

clinical@clinicalservice.cn

夜雨聆风

夜雨聆风