这两年,很多人提到 AI,第一反应仍然是“聊天”,“写作”,“回答问题”。但 OpenClaw 的走红,正在把大众对 AI 的理解往前推一步:AI 不只是一个会对话的模型,也可以变成一个真正参与执行任务的数字助手。严格来说,OpenClaw 并不是传统意义上的聊天机器人,而是一种更接近 AI Agent 的个人助理系统。它强调的不是“你问我答”,而是“你发一句话,它去替你做事”。

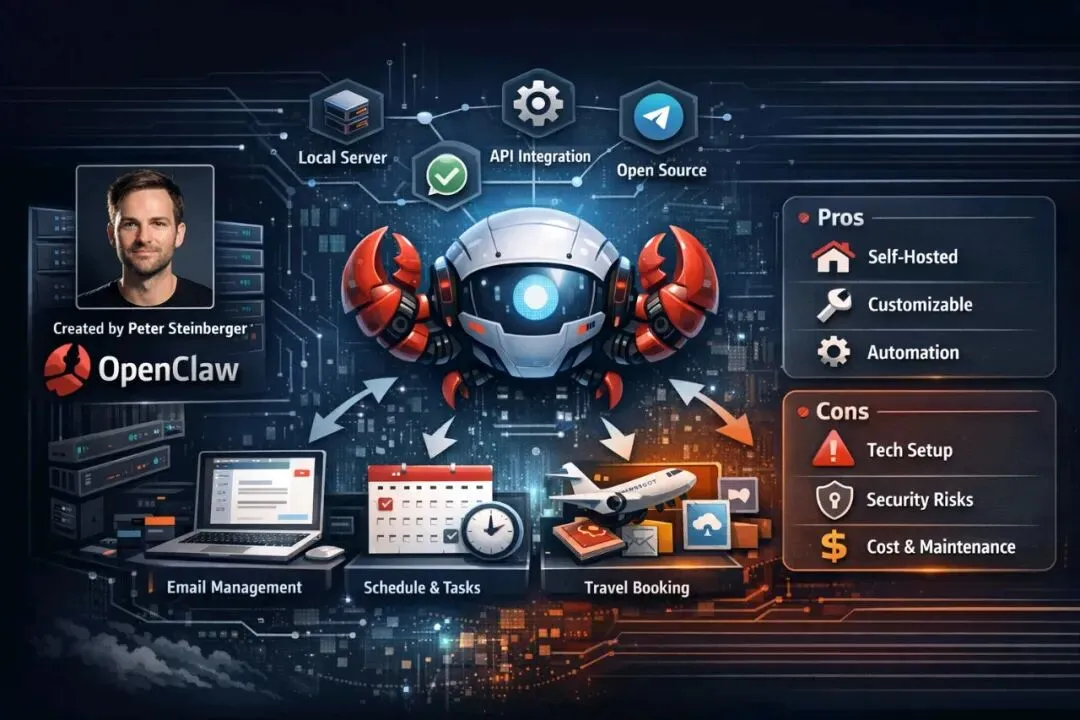

先说大家最关心的问题:OpenClaw 是谁做的? 目前公开信息显示,OpenClaw 主要由奥地利开发者 Peter Steinberger 发起并创建。公开报道直接将他称为 OpenClaw 的创建者;与此同时,OpenClaw 在 GitHub 上以独立开源项目和组织的形式运营,官方 GitHub 组织页也显示了与 Peter 相关的公开联系信息。这意味着,至少从目前的公开形态看,OpenClaw 更像是一个由个人开发者发起、随后快速形成社区生态的开源项目,而不是传统意义上由某家大公司从一开始就封闭打造的商业软件。

再进一步说,OpenClaw 到底是什么? 按照官方文档的定义,它是一个“自托管”的 AI 助手网关,你可以把它理解为一个运行在自己设备或服务器上的个人 AI 助理中枢。它可以连接 WhatsApp、Telegram、Discord、iMessage 等多个聊天渠道,让你通过自己本来就在用的聊天入口,去调用一个持续在线的 AI 助手。官方首页对它的描述更直接:它不是只会聊天,而是可以帮你清理收件箱、发送邮件、管理日程,甚至处理出行值机这类实际事务。

这也决定了 OpenClaw 和 ChatGPT、Gemini 这类通用对话产品的核心区别。后者的强项主要是生成内容、解释问题、帮助思考,而 OpenClaw 更强调“行动闭环”。它并不只是给你一个建议,而是尝试把“理解指令—拆分任务—调用工具—完成执行”串成一个完整流程。官方文档里提到,它具备多渠道接入、会话路由、记忆、工具使用、多代理路由、媒体文件支持、网页控制面板以及移动节点协同等能力;这些能力叠加起来,使它更像一个“可操作的个人 AI 系统”,而不是一个单纯的模型入口。

很多人之所以会把它叫作“龙虾”,其实和它的品牌形象直接相关。公开报道提到,互联网里流行的“养龙虾”说法,就是因为 OpenClaw 使用了龙虾标识,大家把训练和使用这类 AI Agent 的过程形象化地称作“养龙虾”。但如果从技术和产品角度表述,更准确的名称还是 OpenClaw。它本质上不是一种“宠物式 AI”,而是一套可以不断接入技能、扩展工具和自动化流程的个人代理系统。

那么,OpenClaw 怎么用到实际工作里? 从官方资料来看,最基础的使用方式并不复杂:先安装 OpenClaw,再运行引导式配置流程,然后打开控制面板,或者把它接入 Telegram 等聊天渠道,之后你就可以通过浏览器或手机消息窗口与它互动。官方给出的典型流程包括安装、运行 openclaw onboard 做初始化、再通过 openclaw dashboard 打开控制界面。文档同时说明,它支持在自己的机器或服务器上运行,并且需要用户配置所选模型服务的 API key。也就是说,它不是“打开网页就能直接用”的纯托管产品,而更像“你自己搭一个长期在线的 AI 助理站点”。

从使用场景看,OpenClaw 之所以吸引人,是因为它能把很多原本零散的重复任务整合起来。比如,你可以让它在聊天窗口里帮助你处理邮件、管理日程、衔接文档、读取图片音频、维护多轮会话;如果再接入额外技能和工作流,它还能参与更复杂的自动化任务。GitHub 组织页还显示,围绕 OpenClaw 已经形成了技能目录、技能归档仓库,以及工作流自动化相关组件,这说明它并不是一个孤立的程序,而是在朝着“平台化 Agent 生态”发展。

说完是什么、谁做的、怎么用,再来看它的优点。第一,OpenClaw 最大的优势是本地化和自主可控。官方反复强调它是 self-hosted,也就是由用户自己掌控部署环境和连接方式。相比完全依赖云端网页服务的产品,这种模式对重视数据控制权的用户更有吸引力。第二,它的渠道整合能力很强,你不需要每次都打开单独的 AI 软件,而是可以在原本就在使用的聊天软件里直接调起助手。第三,它具备明显的 Agent 属性,更适合完成持续性的任务和流程,而不只是一次性回答。第四,它是 开源项目,MIT 许可和社区驱动的模式意味着它扩展快、透明度高,也方便技术用户二次开发。

但它的缺点同样很明显,而且这些缺点恰恰决定了它目前还不是所有人都能轻松上手的产品。最直接的问题就是门槛高。公开报道明确指出,和 ChatGPT、DeepSeek 这类浏览器里即可使用的工具不同,OpenClaw 需要更偏技术化的配置流程,因此对普通用户来说并不算特别友好。它在中国一度走红后,甚至催生了专门的付费安装和调试服务,这从侧面说明,部署、调试和稳定运行并不是零门槛的事。

第二个问题是安全与权限风险。因为 OpenClaw 想做的是“替你执行任务”,它天然会比普通聊天机器人更深入地接触你的消息入口、文件系统、账号连接和自动化流程。能力越强,意味着权限越深;权限越深,对安全治理的要求就越高。官方近期也在首页显著位置展示了与技能安全相关的合作信息,说明安全本身已经成为这类 Agent 产品不可回避的核心议题。

第三个问题是成本与维护压力。虽然 OpenClaw 本身是开源的,但真正跑起来并不是完全没有成本。官方文档写得很清楚,用户仍然需要准备底层模型服务的 API key,并且推荐使用更强的新一代模型来获得更好的质量和安全性。这意味着,越想把它用好,越可能涉及模型调用费用、服务器运行、版本更新和技能兼容等持续性投入。它并不是“安装一次、永远无脑使用”的工具,更像是一个需要维护的个人 AI 基础设施。

综合来看,OpenClaw 的真正价值,不在于它是不是又一个“更会聊天”的 AI,而在于它代表了一种新的产品方向:让 AI 从回答问题,转向直接参与任务执行。它的创造者 Peter Steinberger 做的并不只是一个对话界面,而是在尝试搭建一个可以跨消息渠道、跨设备、跨工具运行的个人 AI 助理框架。对于开发者、重度效率用户,以及希望把 AI 更深地嵌入自己工作流的人来说,OpenClaw 很有吸引力;但对于只想“打开就用”的普通用户,它目前仍然偏技术化。

所以,如果要用一句话概括 OpenClaw:它不是一个简单的聊天产品,而是一套由个人开发者发起、以开源方式快速扩展、强调自托管与任务执行的 AI Agent 系统。 它的优点在于可控、灵活、能做事,缺点在于门槛、安全和维护成本。也正因为如此,OpenClaw 的意义不只是“好不好用”,更在于它让我们提前看到了未来 AI 产品的一种可能形态:不是等你提问后再回答,而是长期在线、随时可调用、真正开始替你处理事务。

夜雨聆风

夜雨聆风