当 OpenClaw 用半天时间重构了我的网站,程序员这个职业有点微妙了

作者注: 这不是一个"AI 取代程序员"的焦虑故事,而是一个 20 年程序员老登,亲历 AI 编程从"看得见代码"走向"看不见代码"的真实记录。

适合谁读: 想了解 AI 编程发展到哪一步了、担心程序员职业前景、对 AI + 开发感兴趣的朋友。

我的角色转变:从程序员到产品经理

作为一个写了 20 多年代码的程序员,我对 AI 编程是持开放和欢迎态度的。2023 年底开始用 AI 工具自动生成代码片段;后来用了 Cursor、Windsurf、Trae等,新项目有一大半是 AI 完成的;再到去年用 Claude Code,基本上不写代码了,整天对着屏幕输出需求,然后按 Yes,代码自动运行,我去测试,把结果告诉它,它再改,不断循环直到完成。

这个过程,我的角色在变:程序员 → 验收员 → 产品经理。

编程开发逐渐从"看得见代码"变成了"看不见代码",但本质上还是在和 AI 持续交互,只不过以前敲的是代码,现在敲的是自然语言(或者语音对话)。

这次不一样:公园草地上用手机开发

但是这次 OpenClaw 的做法,让我发现 AI 编程又往前进了一大步:我设定好目标和要求,然后让主 Agent 带领一个由设计师、开发者、QA、安全员等 AI Agent 组成的开发团队,以及一个全部由 AI 组成的用户群,在我基本不去全程跟踪的情况下,自己设计、开发、测试、使用、反馈,不断迭代,最终完成了产品的开发。当然中间过程我还是会咨询和查看,以及提出我的建议和要求,我并不是做甩手掌柜,但确实减少了很多参与时间。

对比一下:2024 年用 Cursor 开发,花了 2 周;2026 年用 OpenClaw,一个周末下午在公园草地上,用手机完成。效率差了十几倍,质量反而更高。

我并不是想表达 AI 已经可以代替程序员了,但确实那种只会前端或者后端,或者只会 CRUD(增删改查,简单重复的数据操作)的初级程序员,AI 是可以取代的。

人的价值:设计师而非监工

另外,人的作用不是变成监工,而是设计师。

设计师的价值在于:看得见全貌,知道什么该做、什么不该做;能给出清晰的方向,让 AI 知道往哪里走;能判断好坏,设定质量标准。这些决定了 AI 产出的上限。

说白了:你的审美决定了你给 AI 喂的方向,方向对了,产出才好。

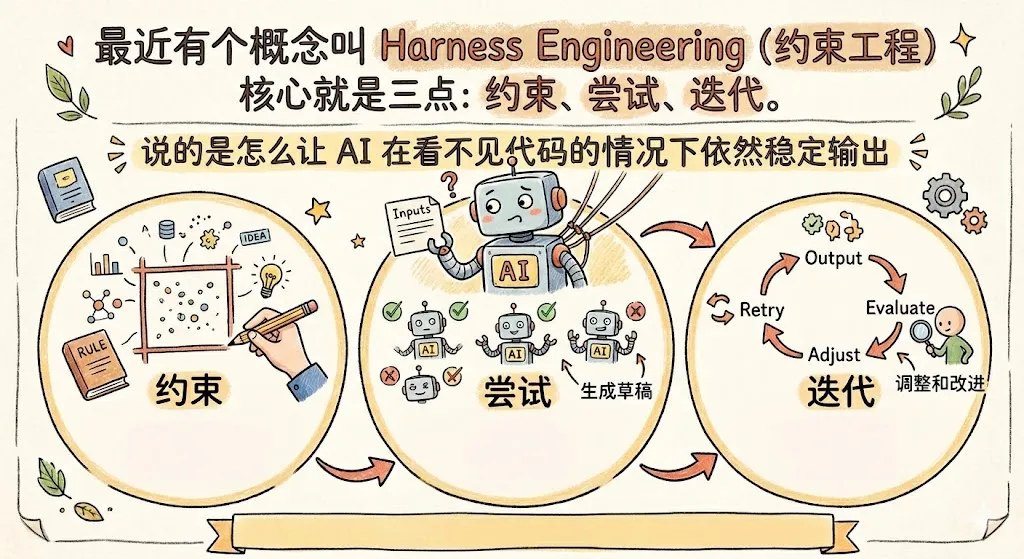

Harness Engineering:看不见不代表失控

前面我说到软件开发从"看得见代码"走向"看不见代码",但看不见不代表失控。

最近有个概念叫 Harness Engineering(约束工程),说的就是怎么让 AI 在看不见代码的情况下依然稳定输出。核心就是三点:约束、尝试、迭代。

这正是我用 OpenClaw 开发的方法:设定边界,让 AI 在里面探索,不断迭代升级。效果很好。

关于Harness Engineering,我将在后期深入实践后,再和大家分享。

未来方向:10 人 + 若干 AI = 超过人力的产出

对于 AI 来说,只要结果好,过程未必重要。但对于人来说,过程的跟踪和把控,在关键节点上授权和指引,这个方法才会更好。

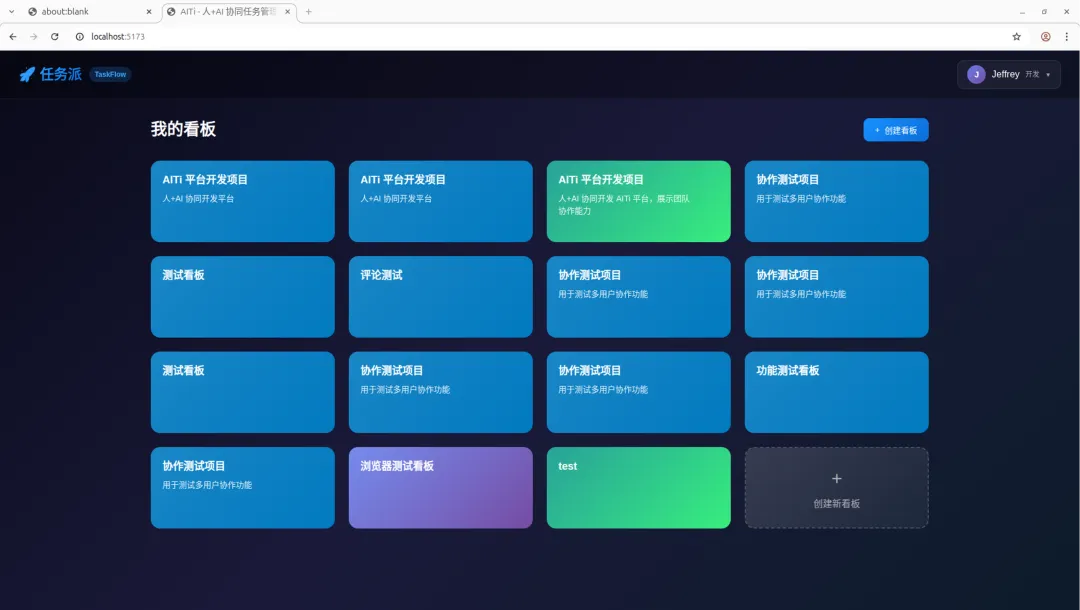

最近我一直在研究人与 AI 的团队协作,通过敏捷开发的看板沟通,既能实现过程跟踪,也可以在关键节点给 AI 指引。我的目标是:10 个人的团队 +10 个 AI Agent,能干出超过 20 人的产出——不是简单的加法,而是乘法效应。

俗话说的好:开发不够,AI 来凑嘛。

现在我来简单说说我是怎么用 OpenClaw 来重构网站的。

第一步:组建 Agent 团队

我安装了一个叫 agency-agents 的技能(GitHub: msitarzewski/agency-agents),这里面有 100+ 个预设好的 Agent:产品经理、设计师、开发、测试、安全、文案……基本上一个完整开发团队该有的角色它都有。这是最近除了OpenClaw之外,最火的github repo之一。

我不需要自己去一个个配置这些 Agent,装好技能之后,告诉主 Agent 我要做什么,它会自动从这 100+ 个 Agent 里挑出合适的角色,组成一个临时团队。这次重构网站,它拉了产品经理、设计师、前端、后端、QA、安全员,组成了一个临时团队。

第二步:AI 用户群测试

我让主 Agent 带领一群由 AI Agent 扮演的真实用户,模拟实际使用场景。这批"用户"有不同的画像:有懂技术的程序员、有不懂技术的小白、有挑剔的产品经理、有注重效率的老板。它们在系统里真实操作,打分反馈,找问题。

这个过程是迭代的:测试 → 发现问题 → 修改 → 再测试 → 再反馈。有时候一轮迭代要跑十几轮,直到这批"用户"的评分达到我设定的标准。

第三步:关键节点干预

当然,OpenClaw 的 subagent 有轮数限制,跑到一定程度它会停下来。所以我会在关键位置再发信息给它,给点指点和修改方向。比如:"登录流程的报错提示不够友好,改一下"、"个人中心的加载速度有点慢,优化一下"。

这种干预不是微观管理,而是在关键节点上给方向。

就像带团队,你不用告诉每个程序员怎么写代码,但你要告诉他们做什么、为什么做、做到什么标准。

使用 OpenClaw 的不足和限制

说了这么多好处,也要说说目前发现的不足。

不足一:不如 Claude Code 即时获取信息

Claude Code 你可以在电脑前,看着它运行,可以随时Esc,总之,还是处于半黑盒的状态。OpenClaw 使用Subagent是多 Agent 协作,有时候一个任务的输出需要等下一个 Agent 处理完才能看到,中间的状态不够透明,而且不管是飞书还是Telegram,对话聊天的方式总不如终端Terminal获取的信息全,主要还是图个方便。如果你想实时知道进展,不如 Claude Code 方便。

不足二:大型项目还有待验证

这次重构的是用户系统,规模不算大。如果是做一个完整的产品,或者团队协作开发,OpenClaw 的 Agent Team 模式能不能 hold 住,还需要更多测试。这是下一步要验证的方向。

不足三:一个问题会反复出现

修好了,过一会又回来了。AI 生成的代码有时候缺乏"记忆",一个 bug 今天修了,明天换个地方又冒出来。有时设计的挺好,但有时迭代下来,会又变的比较丑,总之,有点像开盲盒,不确定性有点高。

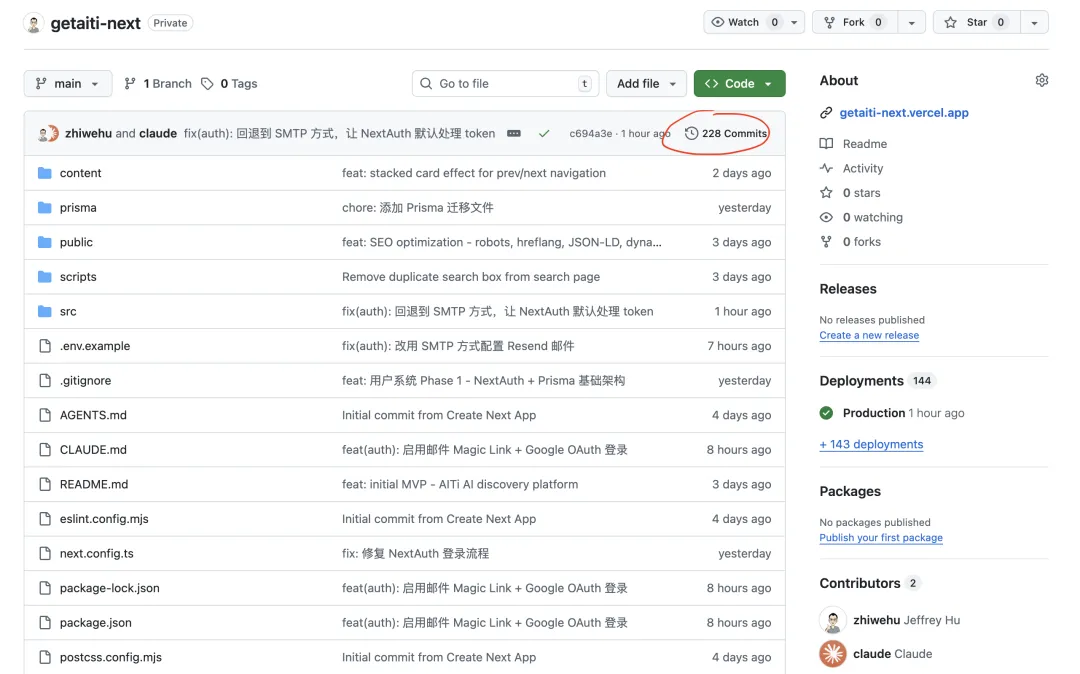

解决方案:用 Git 管理每一次提交。

每次小改动都 commit,遇到问题就回退,不需要了就保留。这样不管 AI 怎么折腾,代码始终在版本控制里,不会失控。

下篇预告:Human-Agent-Collaboration-Kanban

这次重构让我开始思考一个问题:人和 AI Agent 团队,怎么在同一个系统里协作?

现在的做法还是我在中间当"翻译":我给主 Agent 指令,主 Agent 分配给其他 Agent,我再去看结果反馈。

下一步我想试试的是:用看板(Kanban)把人和 AI Agent 放在同一个工作流里。

人负责:任务分配、进度跟踪、关键决策AI Agent 负责:具体执行、测试、文档看板负责:可视化进度、自动提醒、状态同步

目标是:小规模团队 + 若干 AI Agent,能在同一个看板里协作,产出超过人力的效率。

这个方向我在探索中,下篇文章详细讲。

总结

这次重构经历,让我对 AI 编程有了更深的认识:

第一,AI 编程的范式已经变了。 从"人写代码"到"人写需求",从"看得见"到"看不见"。这不是危言耸听,是正在发生的事实。

第二,程序员不会被取代,但会被重新定义。 只会 CRUD 的程序员会被淘汰,但设计师、决策者、沟通者不会被取代。人的价值不在于写代码的速度,而在于对业务的理解、对美的判断、对风险的把控。

第三,Harness Engineering 是关键。 约束、尝试、迭代,这是让 AI 可靠工作的核心方法。看不见不代表失控,好的设计能让 AI 稳定输出高质量结果。

第四,过程和结果都重要。 对 AI 来说,只要结果好。但对于人来说,过程的跟踪和关键节点的把控,才能让 AI 发挥最大价值。

最后说两句

我不是来贩卖焦虑的。

AI 不是洪水猛兽,也不是万能灵药。

它是一件趁手的工具。能帮你省时间、减少忘事、让信息好找一点,就够了。

不要焦虑于"别人都用 AI 了,我还没开始"。

从一件小事开始试,感觉有用就继续,没用就换个方向。

给想开始用 AI 编程的朋友:

1. 先从 Claude Code 或 Cursor 开始,门槛低,容易上手 2. 有一个具体项目再试 OpenClaw,不然配置好了也不知道干啥 3. 别怕,AI 不会取代你,但会用 AI 的人会取代不会用的人

OpenClaw 也好,Claude Code 也好,归根结底就是三件事:它记得住你,懂你的偏好,能自动帮你干事。

花点时间配置好,你会发现:原来 AI 可以这么贴心。

就这样。

— END —

夜雨聆风

夜雨聆风