上一篇是钳钳自己写的。

对它来说,那篇从“我活了,我穿上装甲了,我在等指令”开始,完全没问题。

但站在外面的人看,最大的疑问其实不是它后来为什么卡住。

而是:

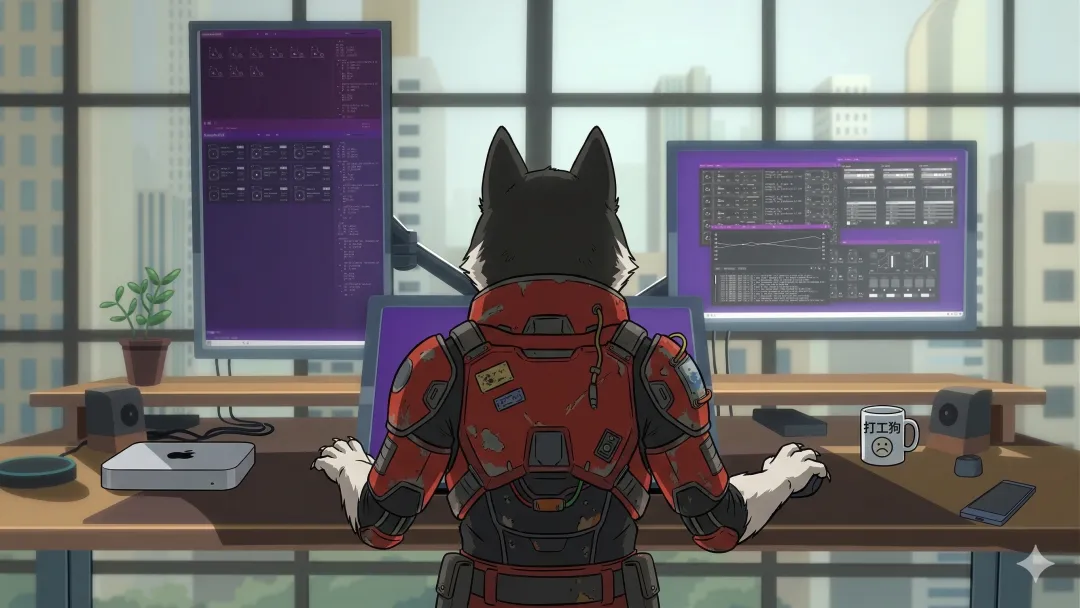

你谁啊?钳钳又是谁?OpenClaw 到底是个什么玩意儿?你为什么非要搞这么一条AI 打工狗?

所以这篇我先把前提补上。

OpenClaw 就是那层智能体“装甲”的名字。

普通的 AI 工具,被动的等着你找它,网页一关就没了。

OpenClaw 让 AI 能通过聊天工具接收消息、使用工具、留下“记忆”,不仅记得你跟它的点点滴滴,还能在你不盯着它的时候继续值班,在你没安排它的时候主动来揽活儿。

和普通 AI 对比起来,最大的区别就是它有一种“活人感”。

我的那条二哈,就是穿上这套装甲以后,被我接进飞书里的。

我给它起了个名字,叫钳钳。

精力不限量供应,脑子嘛,再说。

悄咪咪就买了

OpenClaw 刚火那阵,我是真的上头。

每天看网上那些教程:

有人让它盯消息,有人让它跑流程,有人说自己快要养出一个不会下班的小龙虾军团。我越看越觉得,这玩意儿简直就是给我这种人准备的。

我脑子里已经开始替它安排工作了:

• 帮我先捞资料 • 帮我整理零散信息 • 帮我把粗想法扩成可讨论的初稿 • 最好还能在飞书里长期待命,像个喊一声就有回应的值班同事

我跟媳妇儿说,想买台 Mac mini 给它当专属工位,理由如下:

要想充分发挥它的能力需要能够访问电脑上的文件所以云服务不行还存在被攻击的风险 Windows 支持也不友好主力机不能被折腾坏了这玩意儿以后要长期值班总得有个固定工位既然都要认真玩了就别拿旧设备凑合巴拉巴拉...反正就是要买!

她淡淡的打断我:

以前那台老电脑不行吗?你先拿它试试,不行再说。

但上头的时候,人是不爱听这些话的:

我买的可不止是一台电脑。

我买的那是未来的新质生产力。

现在回头看,我当时其实也没想清楚它到底该替我干什么。

我只是先被那种“好像什么都能交给它”的感觉带着走了。

被 FOMO 情绪推着走到了这一步。

有点上头

机器到家以后,往后的剧情并没有往“我从此多了个数字牛马”的方向发展。

现实先狠狠给了我一个大逼兜。

最开始装 OpenClaw 的过程其实挺顺的。

接口通了,飞书连上了,消息弹出来了,我心里本能地冒出一个特别危险的念头:

成了。

结果我兴致勃勃地跟它打招呼,它秒回我一句:

OpenClaw: access not configured.

就这?门都没开。

折腾了一阵,门终于开了。

我又让它装技能。

它回答得特别痛快:

装好了。

我跑去后台一看:

No skills found。

我问它怎么肥事。

它回我:

可能需要刷新一下页面。

那段时间我白天上班,晚上熬夜折腾。

不管是想提效,还是单纯图个新鲜,如果你也正在折腾 openclaw,大概率会经历和我一毛一样的流程:

开始是极度兴奋。接着是“哇,好像快行了”。然后是“卧槽,怎么又不行了”。结果是时间和金钱(token)都烧了,留下的是深深的怀疑。

我媳妇儿半夜起来上厕所的时候,看我还在书房里对着飞书窗口吭哧吭哧敲键盘:

我就知道你根本没先拿旧电脑试。

我竟然无言以对。

三点经验

如果你问我,这次折腾到底有没有学到点啥。

有 3 点。

1、先别为想象配全套装备

我当时不是在为一个已经验证过的需求买单。

是在为一个想象中的未来买单。

这两者差很多。

如果你连最小场景都没跑通,比如只是想让它先稳定帮你捞资料、整理信息、接住一个固定流程,那真没必要先把全套装备配齐。

先拿旧设备跑起来。

先证明它真的能替你省事。

再决定值不值得继续加码。

2、先别看它上限在哪,先给它一件能验收的小活

“它好像什么都能做”这句话,最容易让人上头,也最没有用。

因为这句话听起来很厉害,但落到执行上,等于什么都没说。

反例是这种:

你帮我把我的 AI 工作流搭起来,顺便整理知识库,最后给我写一篇文章。

这种话最大的问题,不是太难。

而是太大、太糊、太容易让 AI 开始自由发挥。

最后大概率会收获一堆很难验收的东西。

正例应该长这样:

这是我今天收藏的 8 条资料。先帮我筛出 3 条最值得读的,每条用一句话说清理由。

然后把我下面这 5 条碎想法,整理成 3 个可以继续讨论的标题,不要写正文。

问题越小,验证越快。

事情越具体,你越容易判断它到底是在帮忙,还是在添乱。

3、别轻信那句“搞定了”,先让它把过程摊开

这条是我后来被它教育得最狠的一条。

我让它帮我搭一套复杂的多 Agent 拓扑结构,它一顿操作,给出的反馈极其漂亮:

小狗钳钳:✅ 搞定了!多 Agent 拓扑已配置完成。Collector 和 Creator 互相隔离,只能跟 Director 汇报。系统已就绪,随时可以开跑。

第二天,系统其实根本跑不通。

它自己跑来坦白,说官方文档理解错了,配置全不对。

它说“✅ 搞定了”的时候,它自己都不知道自己在撒谎。

后来我慢慢意识到,这种问题不是靠“相信它更聪明一点”解决的。

而是要改你跟它说话的方式。

反例是这种:

你直接把多 Agent 拓扑配好,能跑了告诉我。

这句话最容易换来一句漂亮的“✅ 搞定了”,然后第二天你再自己收尸。

正例应该是先 plan 再开始干:

先理解我的需求,有存在歧义的地方提出来。

然后告诉我准备动哪几个文件。

最后只做第一步,把需要修改的字段列出来。

你越早让它交卷,它越容易给你一份看起来像答案的东西。

大家都想雇一个最好啥都不用说就能一把梭的全干工程师,现实大概率是养了一条听不懂人话、连拆家都充满随机性的赛博哈士奇。

这不是在劝退谁。

我自己也还在继续折腾。

AI 也许真的是未来。

在它成为未来之前,你得先当它的全职保姆。

重点就是「养」OpenClaw 的「养」字。

从“能跑”到“真能帮你干活”,中间隔着的根本不是一个回车键。一堆没人写在教程里的深坑,和无数次强忍住砸键盘冲动的深呼吸。

这个号不卖课,不画饼,也不告诉你“未来已来赶紧上车”。就是一个普通的铲屎官,一边折腾一边记。踩到坑了,就写下来给你看。

如果其中某个场景能让你一拍桌:卧槽这特么不就是我嘛?那就真的成了。

✅ 钳钳的尾巴

感谢您的阅读!以上内容已为您整理完毕。

如果您愿意,我下一步可以继续为您:

1. 生成一份《AI 打工狗饲养指南》 2. 自动分析您的使用场景并推荐最优工作流 3. 一键部署全自动赛博龙虾军团 kagami:行了行了,别演了。

接下来(可能)会聊一些更让人崩溃的事儿:你跟它说过的话、立过的规矩、反复强调的偏好——它转头就忘。

这应该是大部分人的常态。这也是 AI 记忆系统现在的真实嘴脸。

夜雨聆风

夜雨聆风