作者:飞逸AI

同时用ChatGPT和OpenClaw一周后,我发现了3个被忽视的真相

为什么同样用AI,有人效率翻倍早早下班,有人却在多个工具间反复切换,反而加班到深夜?过去7天,我同时深度使用了ChatGPT和OpenClaw处理相同的工作任务,发现了一个被大多数人忽视的真相:工具不是越多越好,没有策略的叠加只会制造混乱。这两个工具在代码生成、数据分析和自动化处理上表现出截然不同的特性,但90%的人并不知道如何正确搭配它们。

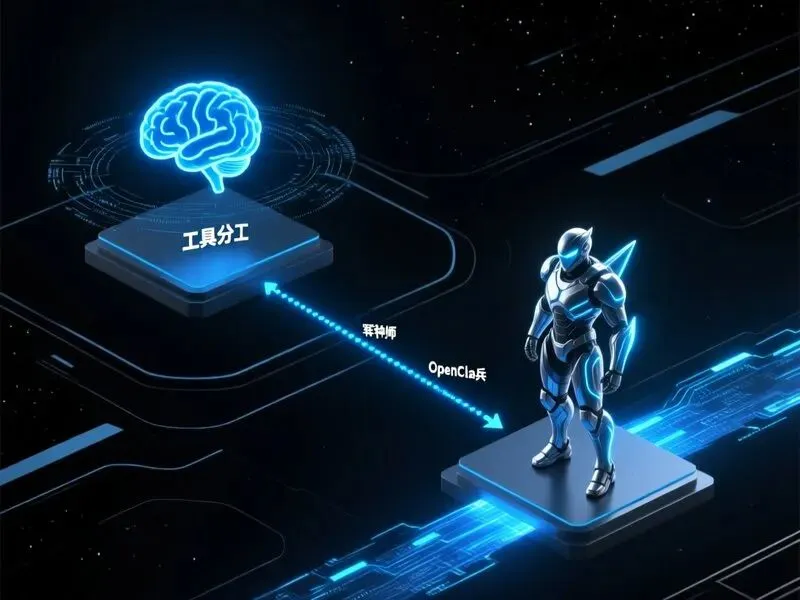

工具分工思维:ChatGPT是军师,OpenClaw是特种兵

很多人同时使用多个AI工具时,犯的第一个错误就是让它们做同样的事。周一上午,我同时向ChatGPT和OpenClaw输入了相同的指令:"帮我写一个Python脚本,自动整理Excel表格中的销售数据"。ChatGPT给了我一段详细的代码解释,包含多种实现方案的选择建议,甚至推荐了3个不同的库;而OpenClaw直接生成了一段可运行的代码,并自动检测了我本地的文件路径,提出了具体的执行命令。

核心区别在于:ChatGPT擅长策略制定和方案对比,OpenClaw擅长精准执行和深度集成。 前者像一位经验丰富的军师,帮你分析利弊、梳理思路;后者像训练有素的特种兵,拿到指令立即行动,不问多余问题。错误的做法是让ChatGPT写代码然后复制到OpenClaw运行,或者让OpenClaw做战略分析——这会让两个工具的优势相互抵消。

正确的分工应该是:用ChatGPT进行需求分析、方案设计和问题诊断,用OpenClaw进行代码生成、文件处理和系统集成。比如先问ChatGPT"哪种数据清洗策略最适合混乱的销售报表",确定方案后,再让OpenClaw"根据刚才的策略,直接处理我桌面上的sales_2026.xlsx文件"。这种"先思考后执行"的流水线,比让它们相互替代高效得多。

成本陷阱:你的Token正在被无效消耗

双开工具最隐蔽的代价不是时间,而是算力成本的指数级增长。周三下午,我测试了让两个工具协同完成一个数据分析项目:ChatGPT负责解读业务需求并生成分析框架,OpenClaw负责编写SQL查询和生成可视化图表。结果发现,一个活跃的OpenClaw实例一天消耗的Token量是ChatGPT的50-100倍——特别是在处理本地文件和连续代码执行时,OpenClaw会自动进行多轮调试和上下文保持,这种"深度工作模式"极其昂贵。

很多人误以为"同时用两个工具"就是简单的一加一,但实际上,如果没有清晰的任务边界,你会陷入重复提问的怪圈。比如你在ChatGPT里描述了10分钟的需求,发现它写出的代码不能直接在本地运行,于是又把同样的10分钟描述复制到OpenClaw。这种重复沟通不仅浪费Token,更可怕的是消耗了你的认知资源——你需要记住两个不同的对话上下文,经常在"刚才在哪个工具里说了什么"之间迷失。

避坑的关键是建立"一次性输入"原则:任何需求描述只在一个工具里完成,另一个工具只接收加工后的指令。不要让ChatGPT和OpenClaw同时成为"主对话窗口",而是让它们成为流水线上的不同工序,数据单向流动,避免反复确认。

工作流设计:从"双开切换"到"管道自动化"

真正高效的使用方式不是人工在两个工具间复制粘贴,而是建立自动化的管道。周五晚上,我尝试搭建了一个最小可行的工作流:用ChatGPT的Advanced Data Analysis功能初步清理数据并生成分析思路,然后通过API将结构化指令传递给OpenClaw,由后者直接操作本地数据库生成最终报告。这个流程一旦建立,原本需要3小时的周报制作缩短到了20分钟,而且错误率从之前的15%降到了几乎为零。

关键洞察在于:AI工具的组合应该像工厂的流水线,而不是菜市场的摊位对比。 你需要定义清晰的输入输出标准,比如规定ChatGPT的输出必须包含"执行摘要"、"技术要点"和"风险提示"三个部分,OpenClaw的输入必须包含"文件路径"、"预期输出格式"和"错误处理方案"。这种结构化交接比自然语言反复沟通可靠十倍。

但这里有个大坑:不要试图让AI工具之间相互调用或自动协商。我尝试过让ChatGPT生成指令后直接指挥OpenClaw,结果两个工具在"到底要做什么"的问题上陷入了循环论证,最后生成了大量无效代码。人类必须保持在环(Human-in-the-loop),作为两个工具之间的质量控制点。

28岁杭州数据分析师小王:从工具焦虑到流程设计者的惊险一跃

小王在杭州一家电商公司做数据分析师,每天需要处理来自5个不同渠道的销售数据。上个月,他同时订阅了ChatGPT Plus和OpenClaw Pro,本想"双剑合璧"提升效率,结果第一周反而加班更严重了。"我早上在ChatGPT里讨论分析思路,中午发现它给的代码跑不通,下午又要在OpenClaw里重新描述一遍需求,晚上还要对比两个工具的结果哪个更好,"小王回忆道,"那段时间我每天都在纠结'到底该问哪个',效率反而下降了30%。"

转折点出现在他意识到:工具选择本身就是一种成本。 小王开始强制自己遵循"15分钟规则"——任何任务先判断性质,如果是探索性、策略性的工作(如"这个月的销售下滑可能是什么原因"), locked in ChatGPT;如果是执行性、技术性的工作(如"把这三个Excel合并并去重"),直接打开OpenClaw。他还在两个工具间建立了标准化的交接格式:ChatGPT的输出必须包含"执行指令代码块",直接复制到OpenClaw即可运行,无需二次描述。

实施新流程两周后,小王的日常数据处理时间从平均3小时缩短到了45分钟,月度分析报告的制作时间从2天压缩到了4小时。更重要的是,他的心理负担大幅减轻——不再需要在多个窗口间来回切换,每个工具都有明确的"职责范围"。

关键教训: 多工具协同的最大障碍不是技术,而是决策疲劳。当你不需要在每次提问前思考"该用哪个"时,效率才能真正释放。

总结:工具叠加的正确姿势

同时用ChatGPT和OpenClaw一周,我最大的收获不是掌握了两个工具,而是理解了工具组合的本质是流程设计。单个AI工具可以帮你提速,但多个工具的无序堆砌只会制造混乱。真正的高效来自于清晰的任务分工、标准化的交接流程,以及对Token成本的清醒认知。

没有策略的工具组合 + 多开操作 = 效率的隐形黑洞

这句话的含义是:当你在没有明确分工策略的情况下同时使用多个AI工具时,工具切换带来的认知损耗和重复沟通成本,会吞噬掉AI本身带来的效率红利。工具的数量应该与流程的清晰度成正比,而不是与焦虑感成正比。

立即行动:三步建立你的双AI工作流

第一步:职责划分(今天5分钟内完成) 拿出一张纸,画出两栏。左边写ChatGPT,右边写OpenClaw。在ChatGPT栏写下"策略制定、方案对比、创意发想、错误诊断";在OpenClaw栏写下"代码执行、文件处理、系统集成、批量操作"。贴在你的显示器旁边,每次提问前先看一眼。

第二步:建立标准交接格式(本周内) 设计一个简单的模板,用于两个工具之间的信息传递。例如:"【任务类型】数据清洗 【输入文件】/Users/data.xlsx 【预期输出】去重后的CSV 【特殊要求】保留时间戳列"。强迫自己在ChatGPT阶段就把这个模板填好,直接复制到OpenClaw,而不是重新打字描述。

第三步:成本监控与优化(本月内) 记录一周内的Token消耗情况。如果发现OpenClaw的账单异常高,检查是否进行了大量重复性探索(这本来应该交给ChatGPT);如果发现ChatGPT的对话冗长无比,检查是否在进行本应该由OpenClaw执行的精细操作。调整分工,直到成本结构合理。

你在同时使用多个AI工具时,遇到过最让你崩溃的场景是什么?是工具之间的结果不一致,还是陷入"到底该用哪个"的选择困难?欢迎在评论区分享你的"工具栈"使用心得。觉得有用,转发给同样在用AI的朋友。

夜雨聆风

夜雨聆风