👆 点击上方「迷斯特的小宇宙」,加「星标」不错过精彩内容

我最近一直在想一个问题:AI 的发展,到底走到哪儿了?

说"早期"吧,ChatGPT 都出来三年了,大家用得很溜。说"成熟"吧,真正改变工作流的应用又屈指可数。这种模糊感让我很难受,直到有天我突然意识到——我们其实在重走计算机的老路,只是速度快了很多倍。

所以我想用计算机系统的发展史,来给 AI 做个坐标定位。

CPU:基础模型就是那块芯片

CPU 是什么?是计算的核心,是冯·诺依曼架构里那个什么都能算、但啥都不专精的通才。

GPT-4、Claude、Gemini 这些大语言模型,就是 AI 世界的 CPU。

你看 CPU 的发展史:Intel 4004 → 8086 → Pentium → Core → 现在的 M 系列芯片。每一代都是"更快、更省电、更多核"。AI 基础模型也一样,GPT-3 → GPT-4 → o1 → o3,本质上也是"更大、更准、更便宜"的迭代路线。

但 CPU 有个关键转折点——从单核提速撞墙,到多核并行。AI 也正在经历这个转折:单个模型的 scaling 开始边际递减,大家开始搞多模型协作、mixture of experts、thinking model……本质上就是"多核化"。

不同的是,CPU 的制程进步有物理极限,AI 的"算力密度"还没到那个墙。但那堵墙一定存在,只是我们还不知道在哪。

GPU:专用加速器的时代来了

GPU 一开始是给游戏画面做的,后来发现它特别适合跑矩阵运算,于是意外成了 AI 训练的核心硬件。这是计算机史上最有意思的"歪打正着"之一。

AI 里对应的是什么?是那些专用模型。

通用大模型是 CPU,但越来越多的场景需要专门优化的模型——代码生成、图像理解、语音、视频、蛋白质结构预测……这些"领域专用模型"就是 AI 世界的 GPU。它们不追求万能,但在特定任务上的能效比远超通用模型。

更深的类比是 AI 芯片本身:Nvidia H100、Google TPU、Apple Neural Engine……这些硬件加速器的竞争,其实就是 GPU 时代的延续。只是这次,软件(模型架构)和硬件(芯片设计)的协同优化,比以前更深度耦合了。

未来十年,我觉得"专用模型 + 专用芯片"的组合会越来越重要,就像当年"GPU + CUDA"重塑了整个计算生态。

操作系统:谁来做 AI 的 Windows?

这是我觉得最关键、也最被低估的一层。

操作系统做什么?管理资源、调度进程、提供标准接口、让应用不用关心底层硬件。没有 OS,每个应用都要自己驱动硬件,大规模繁荣就是空话。

AI 世界现在严重缺这一层。

最早能看清这件事,是因为 Claude Code 的一次意外。

2026 年 3 月底,有人发现 Anthropic 的 Claude Code 在发布 npm 包时,意外把 59.8MB 的 JavaScript sourcemap 一并打包上传了——相当于把源码裸奔在公网上。几小时后,开发者 Sigrid Jin 直接拿去做了 clean-room 重写,几天内收获 72k GitHub stars,这个项目叫 Claw Code。

为什么这么多人兴奋?

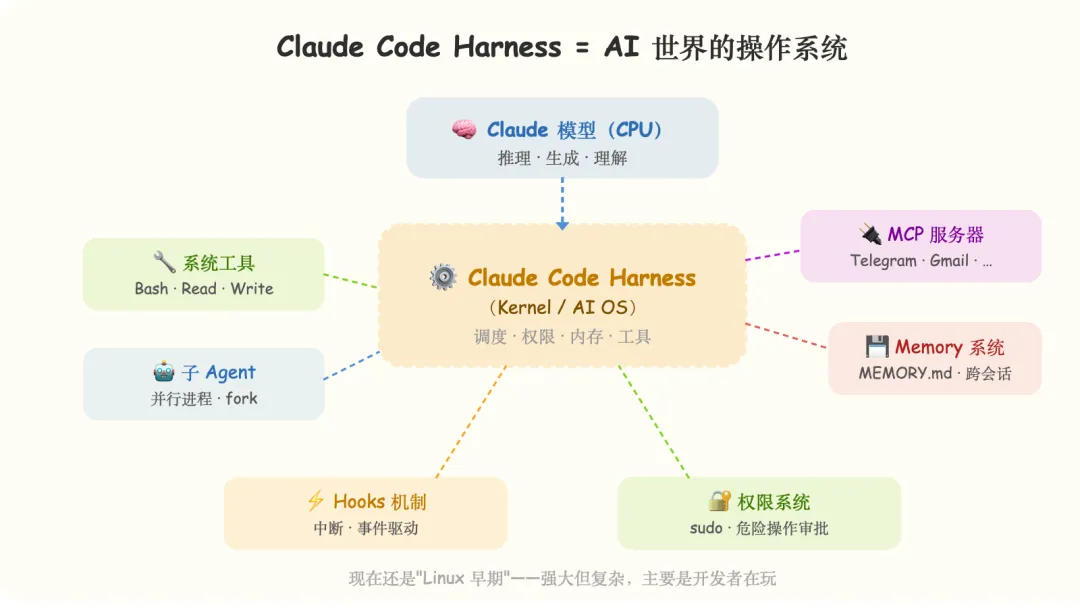

因为那份源码让大家第一次清楚地看到"AI OS"长什么样:

- 工具调度层 = 驱动程序:Bash、文件读写、网络请求统一注册,模型调接口,不碰底层

- 权限沙箱 = 内核安全模型:危险操作要审批,跟

sudo一个逻辑 - Hooks 机制 = 系统中断:事件触发→自动执行挂载脚本,工具调用前后都能拦截

- Memory 系统 = 文件系统:跨会话持久化上下文,下次打开还记得你在做什么

- 子 Agent 调度 = 进程管理:主进程 fork 子进程,后台并行,完成通知

- MCP 协议 = POSIX 标准接口:让任意来源的工具都能接进来

Claude Code 是"专有 AI OS",就像 Windows——体验打磨好,但不开源。Claw Code 则是它的 Linux 版本——内核开放,任何人可以魔改,上面已经有人在跑自己的工具链了。

历史惊人地重演:当年 Unix 的代码流传出去,催生了整个开源运动。这次 Claude Code 的源码是"意外泄露"的,但结果一样。

不过现在两者都还是"Linux 早期"——强大,配置复杂,主要是开发者在玩,普通用户进不来。

真正的 AI Windows 时刻还没到。那个时刻的标志是:一个普通人打开电脑,不需要知道什么是 agent、什么是 MCP,就能自然地把 AI 接入自己的工作流。

谁先做到这件事,就是下一个微软。

应用层:杀手级 App,我们有了吗?

个人电脑真正爆发,是因为有了 VisiCalc(第一个电子表格),后来是 Word、Excel、Photoshop。互联网爆发,是因为有了浏览器、email、搜索引擎。智能手机爆发,是因为有了微信、Instagram、Uber。

每次新平台的崛起,都需要一个"只有这个平台才能做到"的杀手级应用。

AI 现在有了吗?勉强有一些:

Cursor / Lovable / 一堆"vibe coding"工具 是目前最接近的。它们做到了一件以前真的做不到的事——让不会写代码的人能造出可用的软件。这不是"更快的 IDE",这是新物种。一个设计师打开 Lovable,用自然语言描述想要的产品,几分钟后跑起来了。这在以前需要招一个工程师。

Perplexity 也算。它改变了人获取信息的行为——不是搜索结果列表,而是直接给你一个有来源的答案。很多人用过之后真的不想回 Google 了。

豆包、千问 之类的国内应用,月活已经上亿,但说实话它们更像是"更聪明的 App 套件",而不是创造了新行为。功能很多,但没有让人拍大腿说"没有这个我不知道怎么活"的瞬间。

总体来看:应用层现在是"有好工具、没有爆款"的状态。就像 1985 年,已经有 Lotus 1-2-3、有 WordPerfect,但 Windows + Office 那个真正打穿大众市场的组合还没出现。

真正的杀手级 App,我觉得需要满足一个标准:它做到了一件以前根本不可能做到的事,而且这件事的受众是所有人,不只是开发者。

vibe coding 很接近了,但还需要再往下走一层——等 AI OS 那层成熟,等普通人也能无缝接入。

互联网:AI 们开始联网了

互联网做了什么?让孤立的计算机彼此通信,创造了网络效应。

现在 AI 世界正在发生类似的事:multi-agent 系统。一个 AI 搜索、一个 AI 写代码、一个 AI 测试、一个 AI 部署——它们协作完成一个任务。这就是 AI 版的"联网"。

但现在这套东西非常原始,就像早期 ARPANET,协议混乱,可靠性差,只有少数极客在玩。MCP(Model Context Protocol)、A2A 这类协议的出现,是在试图建立标准化的 AI 通信协议,相当于 TCP/IP 在做的事。

这个方向我非常看好,但也要保持清醒:互联网从 ARPANET 到 WWW 用了二十年。AI 的速度会快很多,但"AI 互联网"真正成熟,也许还需要五到八年。

云:AI 正在被水电化

云计算做了什么?把计算从资产变成了服务。你不用买服务器,按用量付费,弹性扩容。AWS 把计算变成了像水电一样的基础设施。

AI 也在走这条路,而且走得更快。OpenAI API、Anthropic API、各种模型云服务——AI 能力正在被"水电化"。你不需要训练模型,不需要买 GPU,调个 API 就能用上顶级智能。

这个趋势的深层意义是:AI 的获取成本正在趋向于零,竞争优势会从"有没有 AI"转移到"怎么用 AI"。

意味着什么?意味着未来 AI 时代的赢家,不一定是最懂技术的人,而是最懂用户、最懂场景的人。技术会变成门槛极低的基础设施,就像今天没有人会因为"会用云服务器"而有竞争壁垒。

那我们在哪个年代?

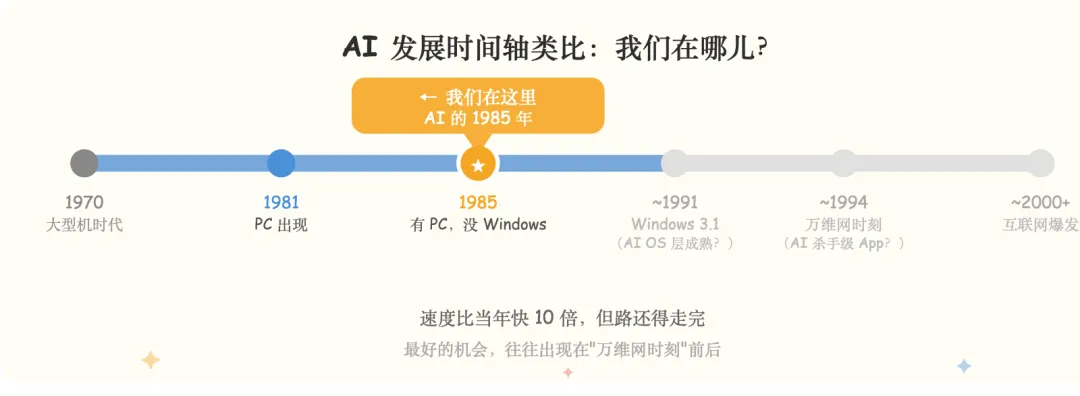

把这些放在一起,我的判断是:我们大概在 1985 年。

个人电脑已经出现,但还没有 Windows。硬件(基础模型)已经足够好用,但 OS 层(agent 编排)还很原始——像 Claude Code、Claw Code 这样的工具是最早的原型,但离"普通人都能用"还远。互联网(multi-agent)的协议刚开始有人在搞。杀手级应用还没出现。

距离"AI 的万维网时刻",可能还有三到五年。

这既让人兴奋,也让人焦虑。兴奋是因为最好的机会还没出现。焦虑是因为变化太快,很难判断该押注哪个方向。

但有一点我比较确定:每次计算平台的迁移,都会重新洗牌。PC 时代没跟上的人,在互联网时代有机会。互联网时代没跟上的人,在移动时代有机会。

AI 时代的牌,现在还没发完。

迷斯特的小宇宙,客户端技术背景,大前端技术、AI前沿技术分享,偶尔写写生活日记。

如果这篇文章对你有启发,点个「在看」或转发给朋友,是对我最大的支持 🙏

夜雨聆风

夜雨聆风