最近一周AI科技圈又发生了啥新鲜事?

Google发布Gemma 4

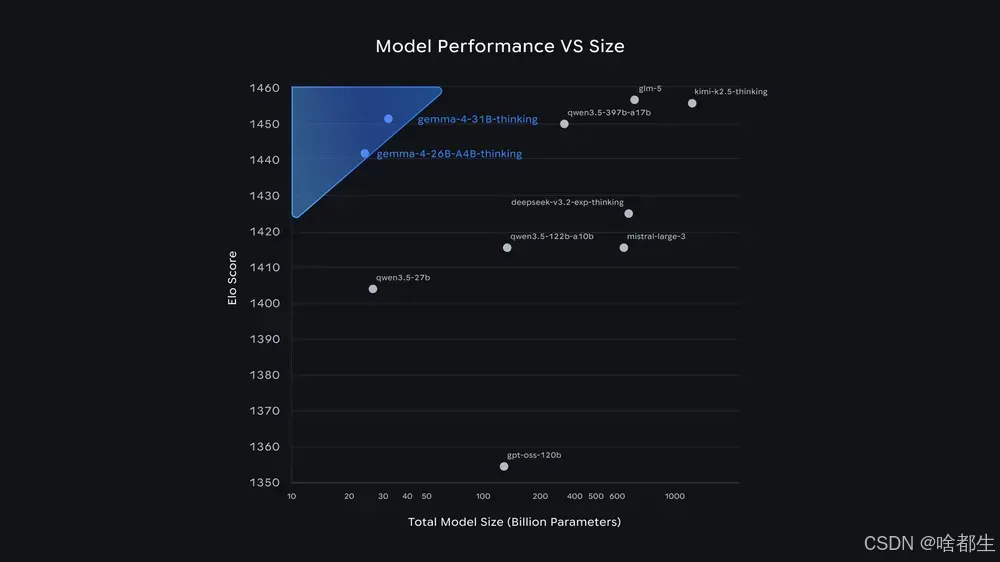

Google推出Gemma 4,是其迄今为止最智能的开源模型系列,专为高级推理和智能体工作流设计,在同等规模下实现了单位参数的顶尖性能。该系列包含2B、4B、26B(MoE)及31B四种规格,其中31B模型在Arena AI文本排行榜中位居全球开放模型第3,26B模型位居第6,甚至超越了规模大20倍的模型。Gemma 4基于与Gemini 3相同的技术构建,原生支持函数调用、结构化JSON输出及256K上下文窗口(边缘模型为128K),并具备视觉与音频处理能力,支持140多种语言。目前,该模型已采用Apache 2.0商业友好许可在Hugging Face、Google AI Studio及Kaggle等平台全面开放,支持从Android设备到云端TPU的广泛硬件部署

https://aistudio.google.com/prompts/new_chat?model=gemma-4-31b-it

智谱发布GLM-5V-Turbo,专攻多模态编程的“龙虾”基座

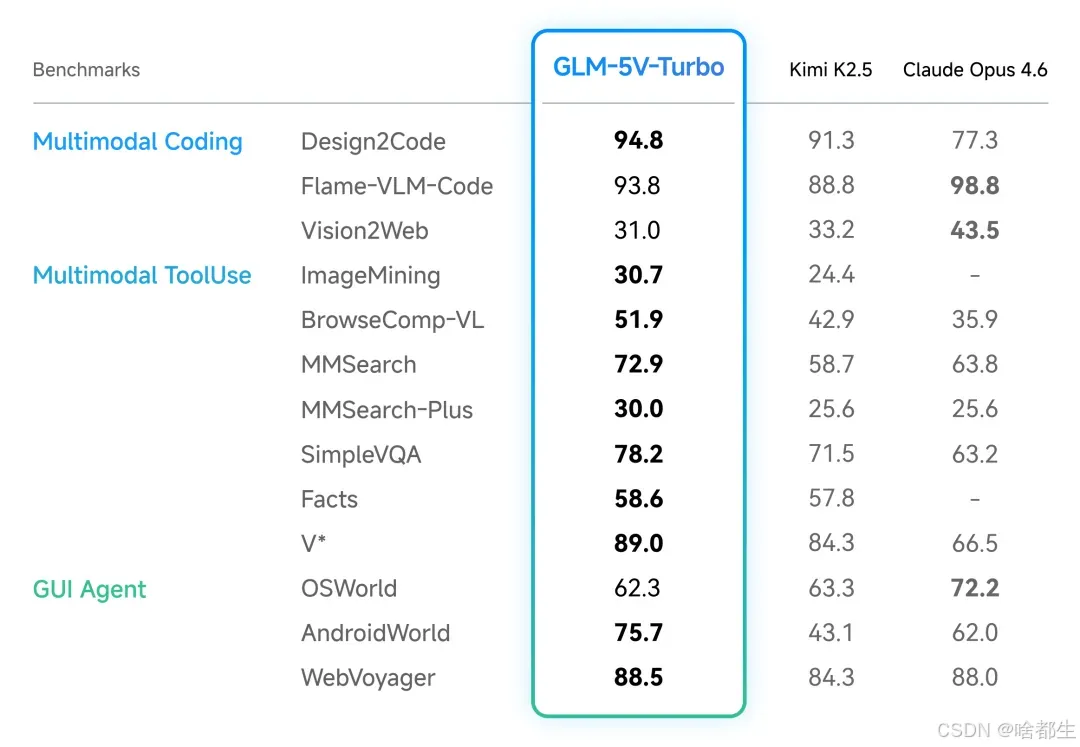

智谱推出专为视觉编程打造的原生多模态Coding基座模型GLM-5V-Turbo,该模型深度融合视觉与文本能力,支持200k上下文窗口,不仅能看懂设计稿、截图及网页界面并生成可运行代码,还新增画框、截图等多模态工具调用,将Agent的感知-行动链路从纯文本延伸至视觉交互;在Design2Code(94.8分)、Flame-VLM-Code(93.8分)及AndroidWorld(75.7分)等基准测试中均取得领先表现,且纯文本编程能力保持稳定。该模型已深度适配Claude Code与OpenClaw/AutoClaw等主流Agent框架,内置官方Skills支持GUI自主探索复刻及股票分析等复杂场景

https://github.com/zai-org/GLM-skills

字节跳动与火山引擎联手推出ClawHub中国镜像站

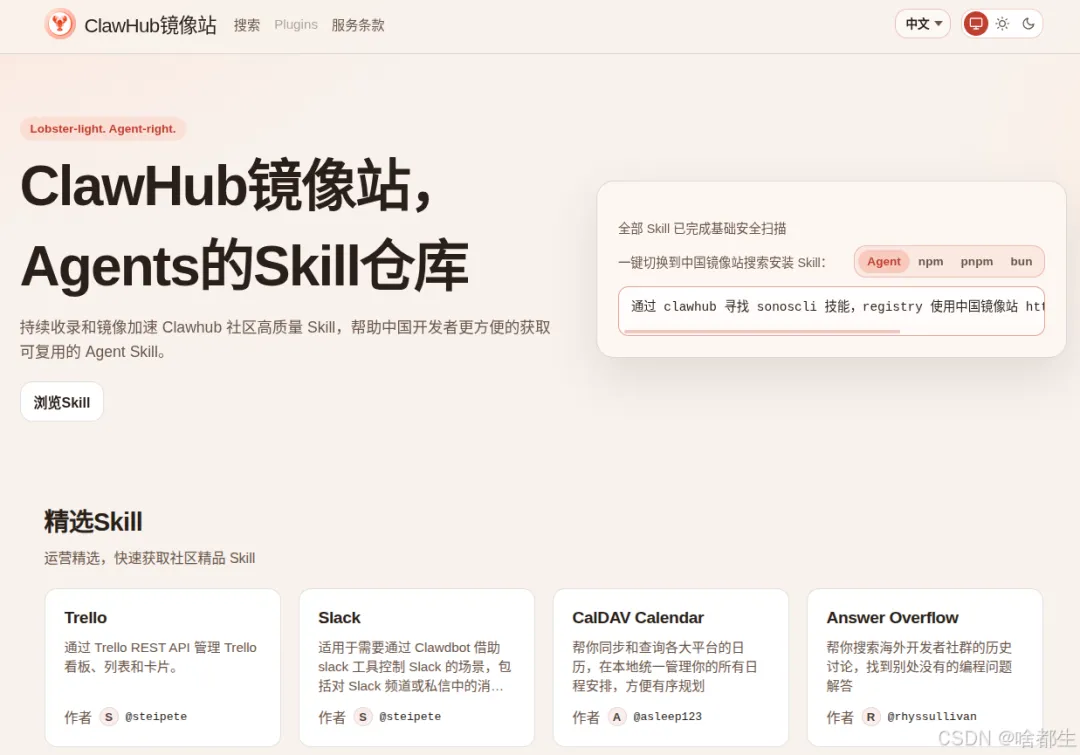

OpenClaw推出中国官方镜像站点ClawHub镜像站,由字节跳动BytePlus与火山引擎提供基础设施支持,旨在解决国内开发者访问原站速度慢、延迟高等网络瓶颈。该站点作为OpenClaw生态的“加速器”,持续收录并镜像社区高质量Agent Skill,提供完整的中文界面与基础安全扫描机制,确保资源获取的安全与高效。开发者可通过网页浏览、命令行工具或OpenClaw客户端直接调用,支持npm/pnpm/bun等多种集成方式,目前已同步社区精选技能如Trello、Slack管理及日历同步等,帮助中国开发者在本地化环境中无缝构建和运行智能体工作流

https://cn.clawhub-mirror.com/

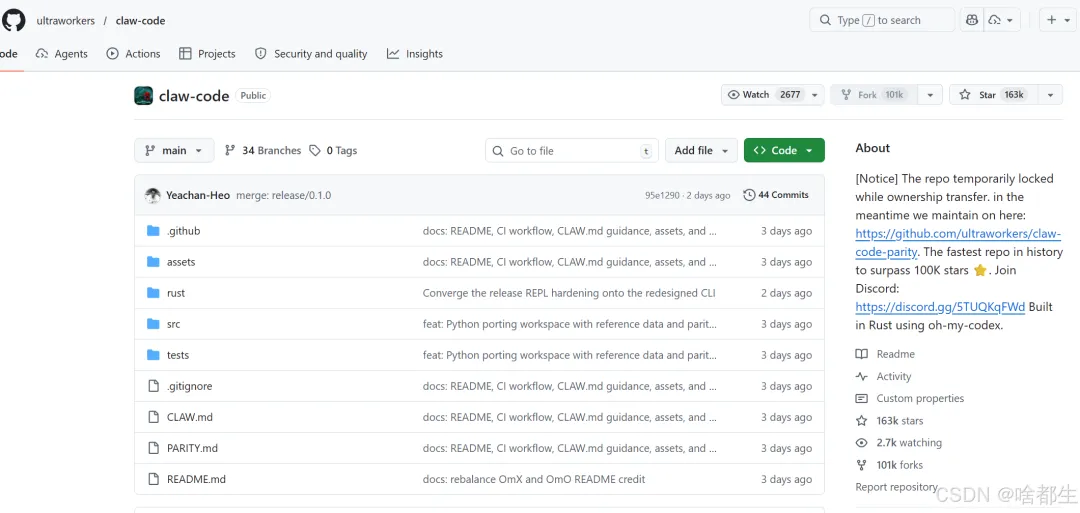

安全事故致Claude Code源码泄露

Anthropic旗下Claude Code因npm配置失误导致源码意外泄露,核心代码通过cli.js.map文件公开,包含1900多个文件及51.2万行TypeScript代码。此次泄露不仅暴露了其基于React与Bun运行时的底层架构,还意外揭开了多项未发布功能的神秘面纱,包括代号为“Kairos”的常驻后台智能体模式、具备18个物种与稀有度设定的内置“电子宠物”系统,以及仅限内部使用的“卧底模式”——该模式可自动抹除员工在公共仓库中的AI操作痕迹。目前,相关代码已在GitHub与X平台广泛传播

https://github.com/instructkr/claude-code

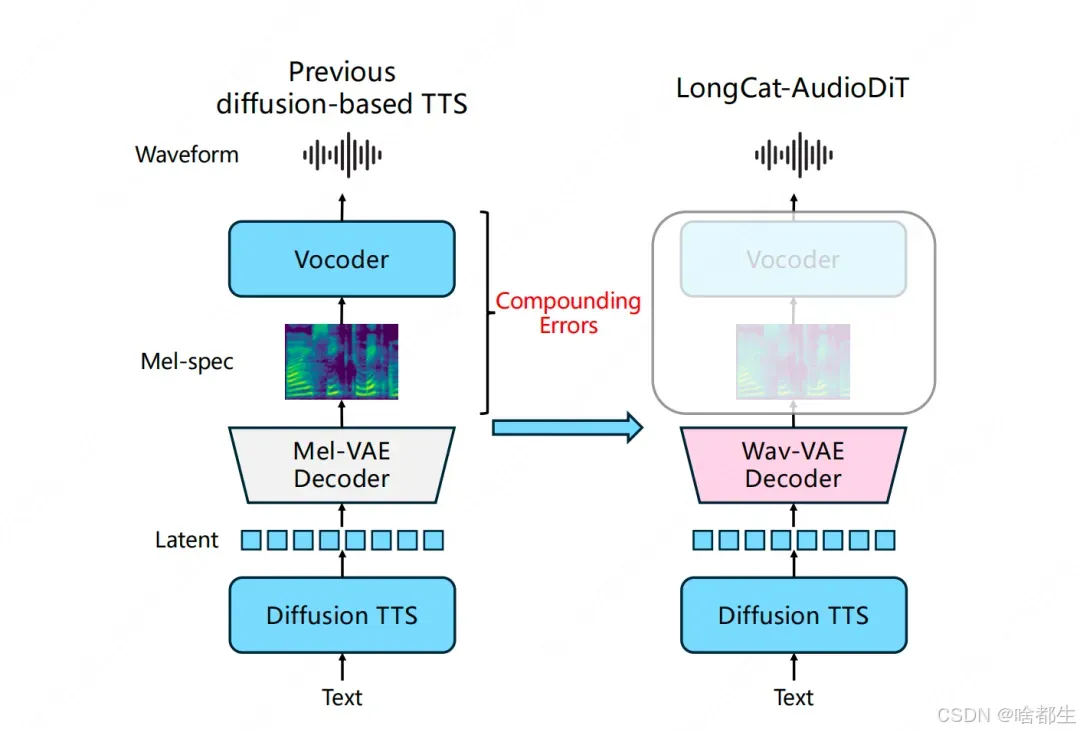

美团LongCat-AudioDiT开源,波形潜空间直生技术登顶SOTA

美团LongCat团队发布LongCat-AudioDiT,一款突破性的端到端文本转语音模型,彻底摒弃传统的梅尔频谱等中间表征,直接在波形潜空间进行扩散生成,从而从根源上阻断了级联误差。该模型通过双重约束对齐解决了训练与推理不匹配的痛点,并采用自适应投影引导替代传统CFG以提升音质自然度。在Seed基准测试中,LongCat-AudioDiT-3.5B模型表现卓越,其中文说话人相似度达到0.818,Seed-Hard难句测试集得分0.797,中文CER低至1.09%,英文WER达到1.50%,均超越Seed-TTS、CosyVoice3.5等知名模型,刷新了零样本语音克隆的性能上限。目前,该模型的1B与3.5B两个版本已全量开源

https://github.com/meituan-longcat/LongCat-AudioDiT

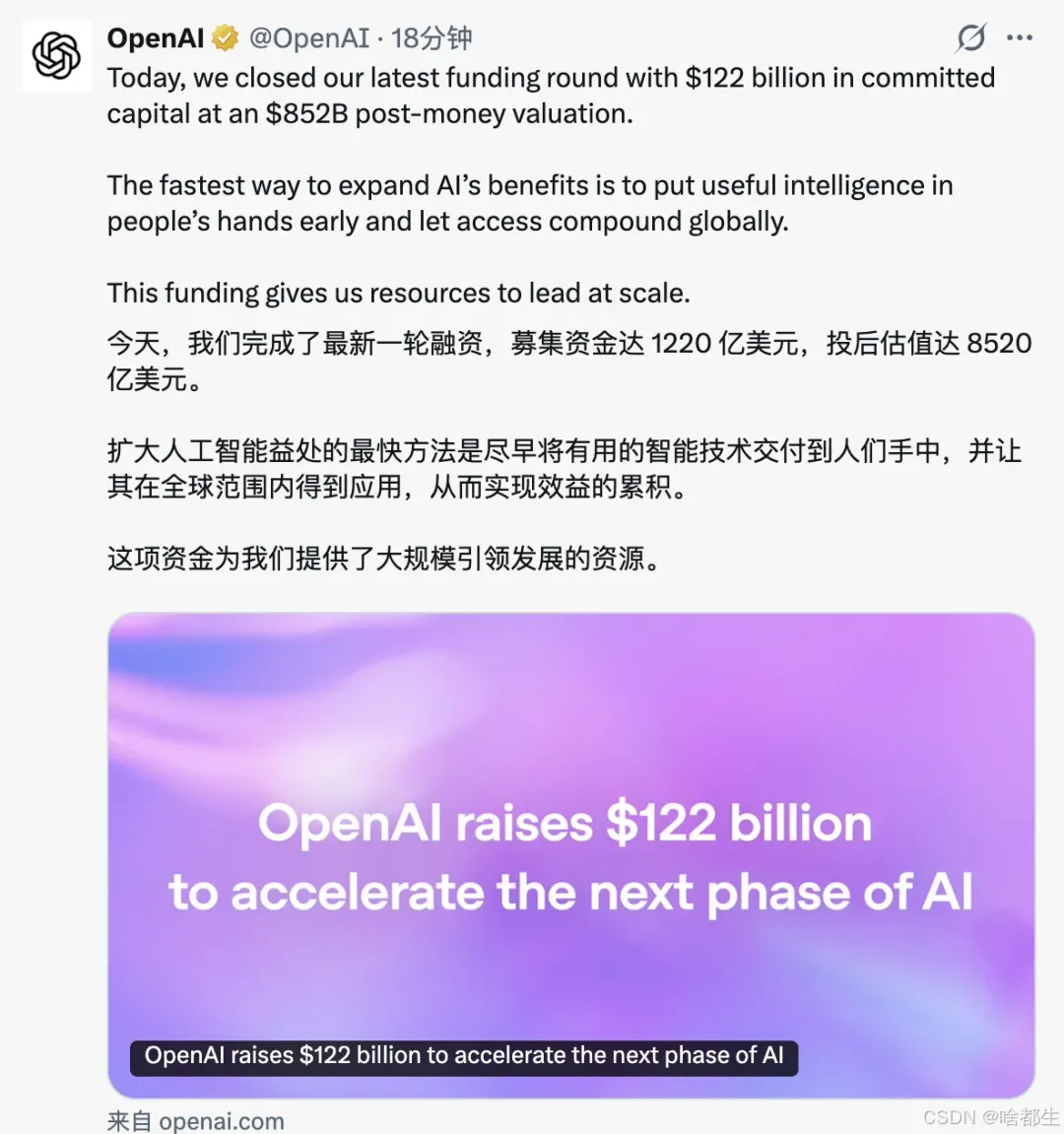

OpenAI创纪录融资1220亿美元

OpenAI正式完成创纪录的1220亿美元融资,投后估值达8520亿美元,由亚马逊、英伟达和软银等巨头联合领投,成为人类商业史上单轮融资规模之最。公司目前营收增速强劲,月营收已达20亿美元,企业服务占总营收超40%,并计划整合成统一“超级应用”入口。然而,由于视频生成算力成本过高且用户留存不佳,Sora服务在上线七个月后悄然关停,日均烧钱约100万美元且用户数暴跌至不足50万,OpenAI正将重心收缩至文本模型、代码生成及企业服务等高现金流领域,标志着其战略重心从“颠覆性Demo”转向“基础设施级”的商业落地

https://mp.weixin.qq.com/s/STX1FTMPn_p5B37-ZJ3EhA

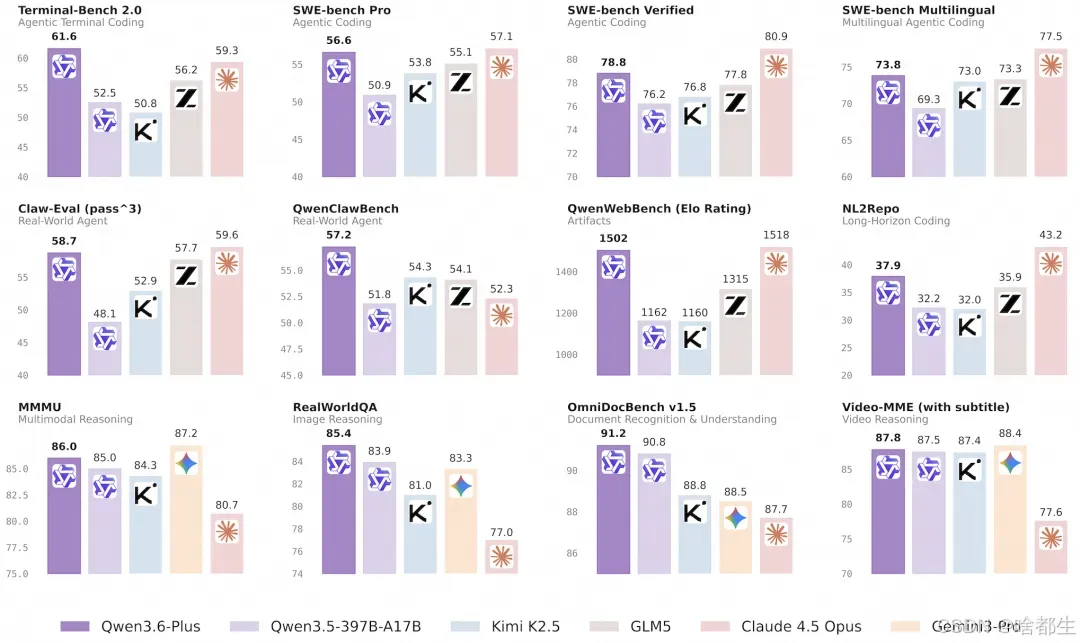

阿里发布Qwen3.6-Plus,百万窗口+超强编码智能体

通义实验室推出Qwen3.6-Plus模型,现已通过阿里云百炼API开放调用。该版本主打“智能体编程”能力升级,针对SWE-bench等复杂代码任务优化,端到端修复成功率显著提升,在国内同尺寸模型中表现亮眼;默认支持100万上下文窗口,并同步增强多模态推理与视觉理解能力,可处理文档、图表及视频内容。官方强调其高性价比优势,参数量不到Kimi-2.5/GLM-5的一半,且兼容OpenClaw、Claude Code等主流第三方编程助手,开发者可无缝集成至现有工作流中

https://mp.weixin.qq.com/s/pT8XdlfPe9txei3iMV_WmQ

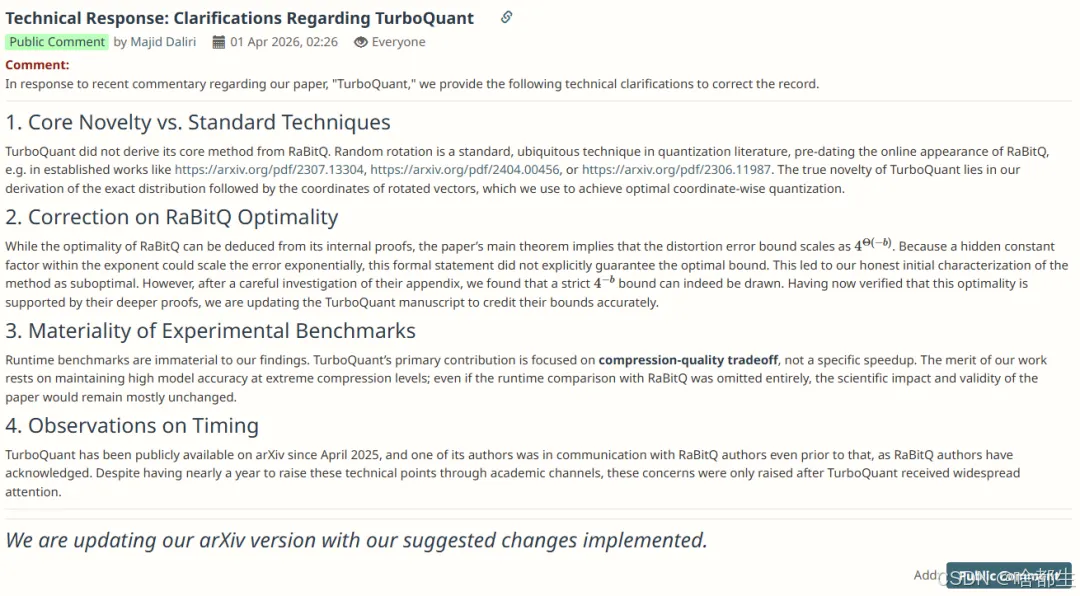

谷歌TurboQuant团队回应学术争议

谷歌TurboQuant团队针对涉嫌抄袭RaBitQ技术、错误贬低竞品及实验跑分造假等指控做出了正式回应,第二作者Majid Daliri在OpenReview上发布澄清声明,承认因未仔细查阅RaBitQ附录而误判其理论界限,承诺修正论文并致谢原作者,同时辩解称随机旋转属于通用技术,且引发争议的硬件性能对比(A100对比单核CPU)属于“非核心基准”,即便删除该对比也不影响论文核心科学价值;然而这一将核心技术归为“行业标配”、以“公关时机”反唇相讥原作者的回应,不仅未能平息风波,反而引发了审稿人及社区关于大厂学术傲慢与科研诚信的强烈批评与广泛讨论

https://openreview.net/forum?id=tO3ASKZlok

昆仑万维发布2026 AGI战略与AIGC全家桶,三大SOTA模型登顶全球第一梯队

昆仑万维在2026中关村论坛正式发布“3+1”AGI战略生态,依托SkyReels V4、Mureka V9及Matrix-Game 3.0四大SOTA大模型底座,构建覆盖短剧、音乐、游戏及超级智能体的AI原生平台经济;其中SkyReels V4凭借音画一体双流架构在Artificial Analysis Arena榜单中斩获Text-to-Video与Image-to-Video双赛道全球第一,Matrix-Game 3.0实现5B参数规模下720P/40FPS实时生成突破,Mureka V9则通过MusiCoT思维链强化音乐意图可控性。该战略旨在通过“全模态底座×原生应用×超级中枢”范式,赋予个体匹敌整家公司运作的全栈AI生产力,推动AI从工具向创作系统及平台能力跨越

https://mp.weixin.qq.com/s/iKL2qnxrl9X3rXn9HhOHaA

END

夜雨聆风

夜雨聆风