AI在医疗健康领域的

应用与政策解读

会议纪要

课程主题:AI在医疗健康领域的应用与政策解读

课程时间:2026 年4月7日 1:00 - 3:00 pm

主讲人:谭建 广州华山职业学院 研究员 博士

01

课程内容概要

本次线上研讨会系统地介绍了AI技术在医疗健康领域的技术前沿、应用现状、伦理挑战、治理框架及对学术研究的赋能作用。内容涵盖了大语言模型、多模态AI、强化学习三大技术支柱,并探讨了AI在辅助诊断、患者管理、药物研发、手术规划等多场景的具体应用。同时,谭建博士就AI的伦理原则、全球治理模式、以及研究者如何利用ChatGPT等AI工具提升科研效率进行了深入解读,并对未来“人机协同”的科研创新范式进行了展望。会议在主题分享后设置了问答环节。

02

核心内容概要

1

技术支柱与应用场景:

AI医疗依赖于大语言模型(LLM)处理非结构化文本(如电子病历)、多模态AI融合影像/基因/临床数据进行综合判断、强化学习(RL)优化个性化治疗方案三大技术支柱,推动医疗服务模式革新。

2

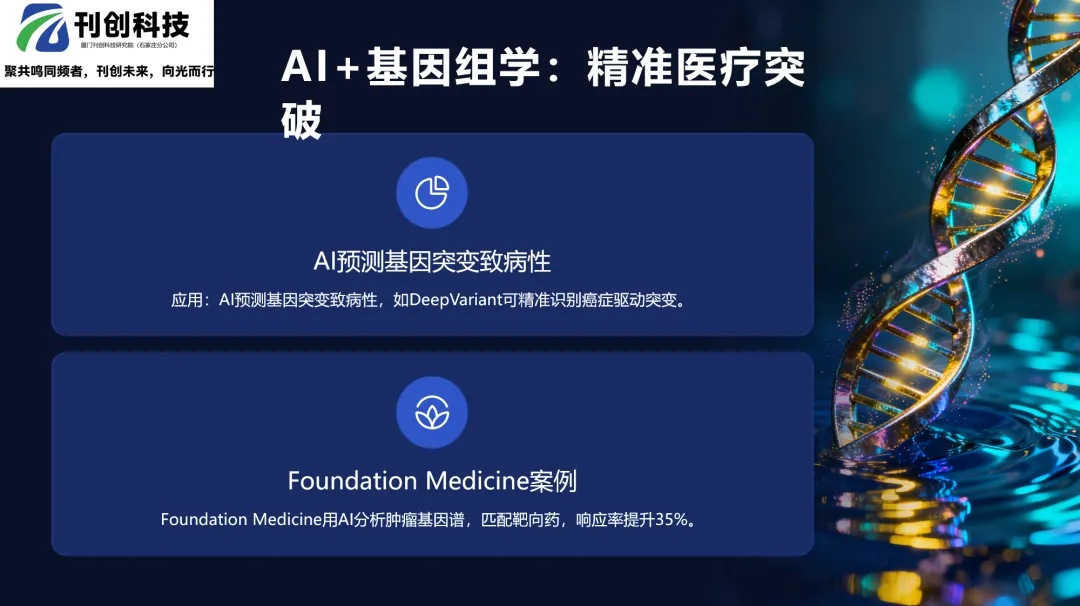

前沿应用与案例:

◦ 诊断辅助:谷歌Med-PaLM模型在美国执业医师考试中达专家水平;大语言模型在梅奥诊所使病例书写效率提升40%,诊断遗漏率下降25%。

◦ 筛查与治疗:谷歌Health在印度的视网膜AI筛查覆盖百万患者,灵敏度达98.5%;DeepMind的AI可优化透析剂量,减少30%并发症。

◦ 药物研发:AI可将药物靶点发现周期从4年缩短至18个月,并能优化临床试验设计,减少受试者脱落。

3

伦理、治理与可持续发展:

◦ 伦理挑战:包括算法偏见(如皮肤癌诊断算法对深色皮肤误诊率高)、可解释性、责任界定(如手术机器人事故责任方)以及数据隐私。

◦ 全球治理:欧盟侧重立法与伦理(AI法案),美国侧重市场驱动与事后监管(FDA预认证计划),中国侧重政府主导与场景落地。

◦ 绿色AI:通过模型压缩(如知识蒸馏)、边缘计算、使用可再生能源来降低AI模型训练与运行的高能耗。

4

AI赋能学术研究:

◦ 工具使用:ChatGPT等工具可辅助文献综述、研究思路启发、实验设计、数据分析、论文撰写与润色、回复审稿意见等,大幅提升效率(如将2个月的文献梳理工作缩短至2天)。

◦ 范式变革:AI推动研究从“假设驱动”转向“数据驱动”,并通过仿真模拟(如器官芯片)、逆向推理(从临床结局追溯病因)和促进跨学科协作,催生新的科学发现。

◦ 使用规范:研究者需声明AI使用情况,确保对AI生成内容进行人工校验与负责,并保留批判性思维,核心创意与决策不可被AI替代。

03

问答环节概要

1. 用AI润色和优化论文结构,到什么程度比较合理?

答:建议将AI生成内容的痕迹控制在5%以下。需要使用工具对AI生成的文字进行彻底重写和修改,使其更符合人工写作的自然表达,以避免被审稿系统识别。AI提供的是“预制菜”,最终的“烹饪”和核心思想仍需研究者亲自完成。

2. 如何把握引用文献的“新”(如预印本)与“靠谱”(如正式期刊)之间的度?

答:研究性论文建议主要引用近5年内的文献。预印本虽可引用,但需谨慎,最好以正式发表的学术期刊文献为准,引用预印本的比例不宜过高,否则可能影响研究的权威性。

3. 期刊要求声明AI使用情况,是否有比较通行的写法?

答:需要在论文中(通常在致谢或方法部分)声明使用了AI工具,并写明具体使用了哪些工具。这样做的目的是向编辑和审稿人透明公开AI的辅助情况。具体的描述格式可以参考其他论文或期刊要求,但核心是如实告知。

04

会议总结

本次会议全面梳理了AI在医疗健康领域从技术到应用、从伦理到治理的全景图。谭建博士指出,AI技术(大语言模型、多模态、强化学习)正深刻改变医疗的诊断、治疗、研发和管理模式,实现从“单点智能”到“系统智能”的演进。同时,AI的广泛应用也伴随着可解释性、数据隐私、算法偏见和伦理滞后等挑战,需要建立完善的治理框架。

对于科研工作者而言,AI(如ChatGPT)是强大的辅助工具,能极大解放生产力,但必须负责任地使用,明确其“辅助”而非“替代”的定位,研究者需保持批判性思维,并对最终成果负责。未来,“人机协同” 的群体智能和跨学科融合将是创新的主要方向,而评价学术价值的指标也将从传统的论文数量,转向AI协作贡献度与临床转化价值。

欢迎关注我们获取最新通知和资料分享

夜雨聆风

夜雨聆风