AI领域关键词解析与算法框架全景图

一文读懂大模型、深度学习算法与热门框架的核心原理

导语:2024年是人工智能发展史上具有里程碑意义的一年。从ChatGPT引爆全球AI热潮,到GPT-4、Claude、LLaMA等大模型持续进化,再到国产大模型DeepSeek、Qwen的强势崛起,AI技术正以惊人的速度重塑着我们的世界。本文将系统梳理AI领域的核心关键词、主流算法与热门框架,为您呈现一份详尽的技术指南。

一、AI领域核心关键词解析

人工智能领域日新月异,各种专业术语层出不穷。理解这些关键词的内涵,是把握AI发展趋势的基础。以下我们将逐一解析当前最热门的AI概念。

大语言模型Large Language Model, LLM

LLM是指包含数百亿至数千亿参数的自然语言处理模型,能够理解和生成人类语言。以ChatGPT、GPT-4、Claude、文心一言为代表的LLM通过大规模预训练学习语言的复杂模式,包括句法、语义和上下文信息,从而生成连贯、有意义的文本。LLM的核心特点是规模庞大和涌现能力——当模型规模达到一定程度时,会出现意想不到的智能表现。

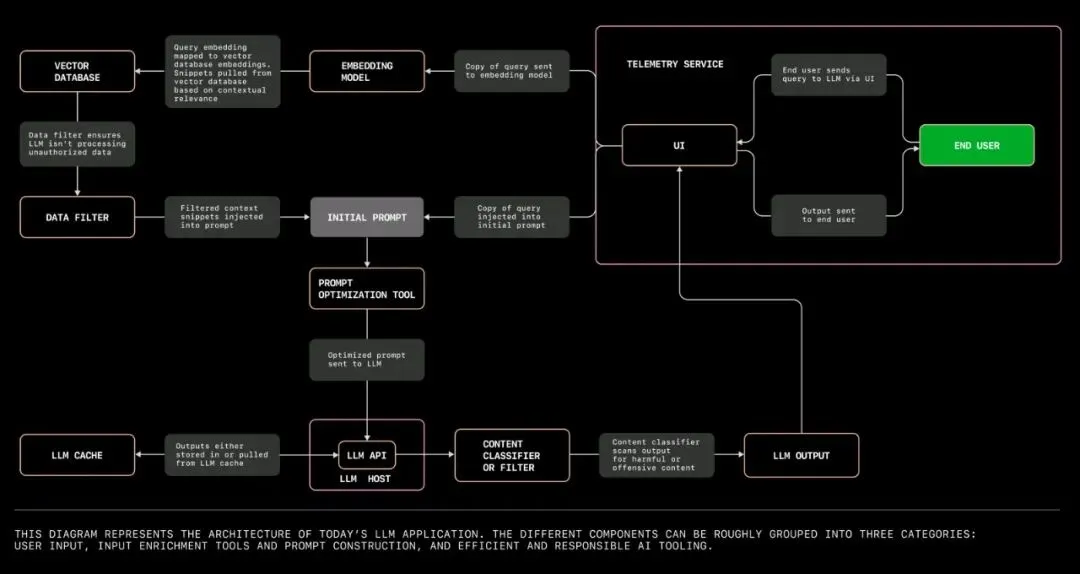

图1:LLM大语言模型应用架构示意图

通用人工智能Artificial General Intelligence, AGI

AGI是人工智能领域的终极目标,指的是能够像人类一样思考、学习和执行多种任务的智能系统。与当前专注于特定任务的"弱人工智能"不同,AGI旨在创造一个全能的"超级大脑",未来可能在任何领域都超越人类。尽管目前AGI尚未实现,但以o1为代表的新技术范式正在向这一目标稳步推进。

AI生成内容AI-Generated Content, AIGC

AIGC是指利用AI技术自动生成的内容,涵盖文本、图像、音频、视频、3D模型等多种形式。2024年AIGC技术迎来爆发式增长,从创意构思到企业级内容生产,AIGC正深刻改变着工作和娱乐的方式。预计2025年,AIGC将应用于更广泛的场景,包括游戏开发、影视制作等专业领域。

自主智能体Autonomous Agents

Agent是能够自主感知环境、进行决策并执行动作的智能系统。2024年,Agent概念初露头角,未来的Agent将推动AI实现"持续感知—思考—行动"的闭环,成为智能家居、客服、自动驾驶等领域的核心驱动力。OpenAI的o1模型标志着从"快思考"到"慢思考"的技术范式转变,为Agent发展奠定基础。

检索增强生成Retrieval-Augmented Generation, RAG

RAG是将检索系统与生成模型相结合的AI架构,能够让大模型在生成回答时引用外部知识库。2024年被称为"RAG发展元年",RAG在成本和实时性方面具有压倒性优势,同时能够有效解决大模型"幻觉"问题,成为企业知识库、智能问答等场景的首选方案。

📌 多模态生成 (Multimodal Generation)

2025年AI发展的重要方向。AI不仅能通过图像生成文本,还能够进行视频和音频的综合创造,实现"看图说话"、"看视频写剧情"等跨模态能力。

二、主流深度学习算法解析

深度学习是AI的核心驱动力,而神经网络则是深度学习的基础架构。从最早的感知机到如今的Transformer,算法模型经历了数次革命性演进。

2.1 神经网络基础

神经网络是一种模仿生物大脑结构和工作原理的计算模型,由多层神经元组成。每个神经元接收来自前一层的输入,根据权重和偏置进行计算后输出,这个输出再作为下一层的输入。神经网络通过训练来学习从输入到输出的映射关系。

2.2 卷积神经网络 (CNN)

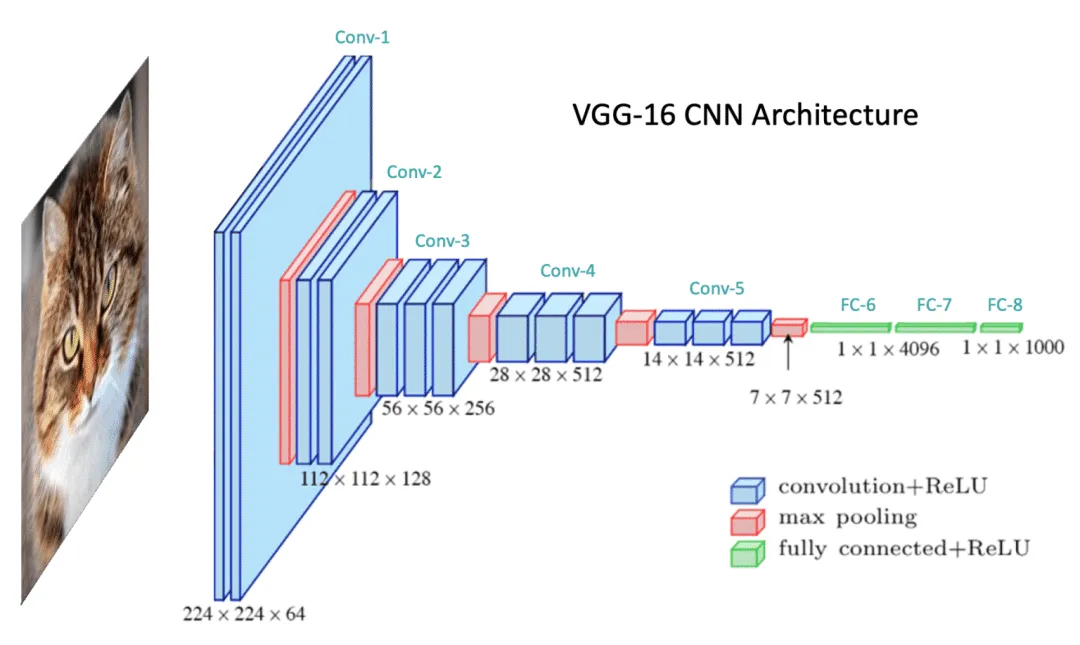

图3:CNN卷积神经网络架构 — 卷积层、池化层与全连接层

卷积神经网络 (CNN) 最早用于图像处理任务,利用卷积操作和池化层来提取图像的空间特征。CNN中的核心是卷积核(滤波器),它会在输入图像上滑动以获得局部特征,再经过多个卷积层和池化层逐步抽取高层次特征。

典型应用场景:

- 图像分类 — 猫狗识别、人脸识别、手写数字识别(MNIST)

- 目标检测 — YOLO、Faster R-CNN进行目标识别和定位

- 图像分割 — U-Net、Mask R-CNN在医学影像和自动驾驶中的应用

- 医疗诊断 — X光、CT、MRI图像的癌症检测分析

2.3 循环神经网络 (RNN/LSTM)

循环神经网络 (RNN) 最早于1986年由David Rumelhart提出,旨在处理序列数据。与CNN在空间域上提取特征不同,RNN的权重在时间域上移动,适合处理文本、语音等序列数据。

核心原理:RNN通过循环结构让网络记住以前的输入信息,使其能够处理序列数据。每个节点不仅接收当前输入,还接收前一个节点的输出,从而形成"记忆能力"。

存在问题:

- 梯度消失/爆炸 — 原始RNN难以处理长序列

- 并行化困难 — 训练和预测数据需依次送入模型

- 长程依赖问题 — 距离较远的词语关系难以学习

解决方案:LSTM(长短时记忆网络)和GRU(门控循环单元)通过引入门控机制,极大地改善了RNN的梯度问题,成为处理序列数据的主流选择。

2.4 Transformer — 革命性架构

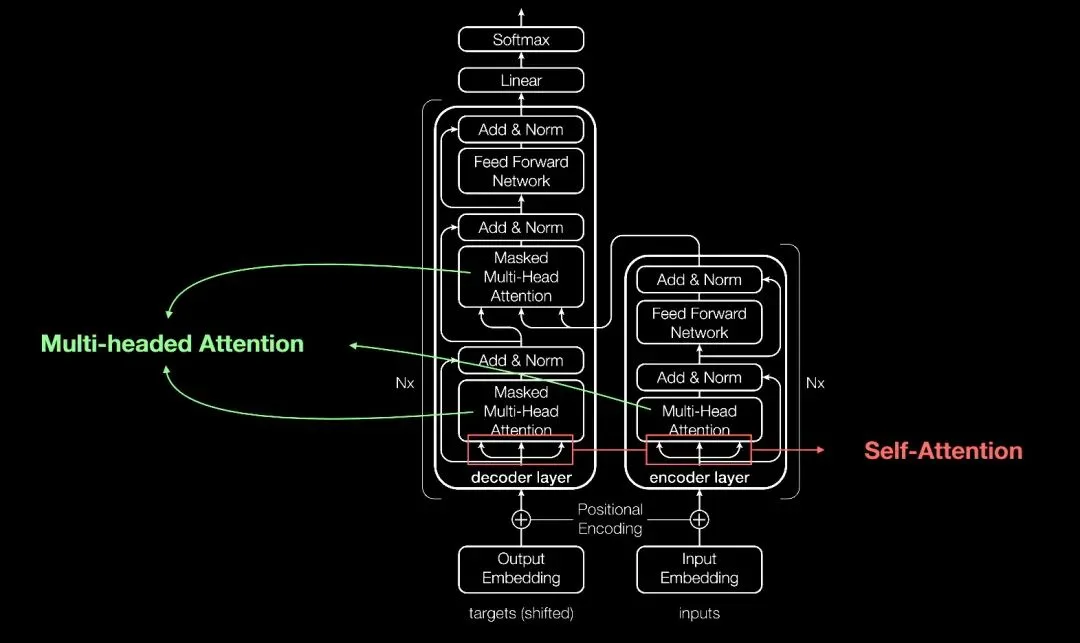

图4:Transformer模型架构 — 编码器-解码器结构与自注意力机制

2017年,Google发布了Transformer模型,这是NLP领域的革命性突破。Transformer彻底解决了RNN无法并行计算的问题,成为现代大语言模型的基础架构。

"Attention is all you need" — Transformer抛弃了传统的RNN结构,仅使用注意力机制,实现了前所未有的并行计算能力和长程依赖建模。

Transformer核心组件:

2.5 梯度下降与反向传播

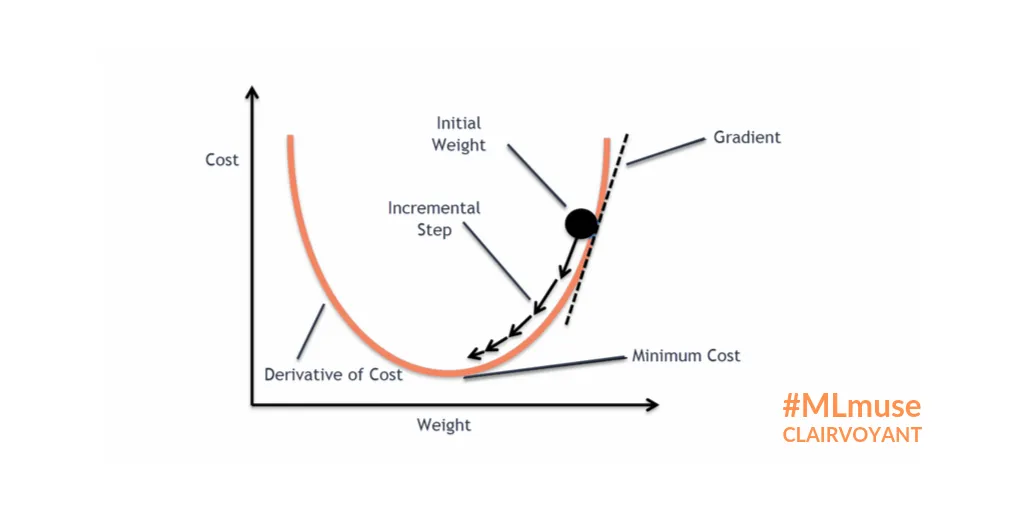

图5:梯度下降算法 — 沿函数梯度的反方向逐步逼近最优解

梯度下降 (Gradient Descent) 是优化神经网络参数的核心算法,通过迭代调整参数最小化损失函数。其核心思想是沿函数梯度的反方向逐步调整参数,因为梯度方向指示了函数值增长最快的方向。

关键参数 — 学习率 (Learning Rate):

- 学习率过大 → 越过最低点,震荡无法收敛

- 学习率过小 → 收敛缓慢,需大量迭代

- 实用范围:通常在0.01到0.1之间

自适应优化算法:

- Adam — 结合自适应学习和动量,收敛快、效果好,是目前最流行的优化器

- AdaGrad — 根据历史梯度自适应调整学习率

- SGD — 随机梯度下降,大规模数据训练效率高

三、热门AI模型框架盘点

2024年是AI大模型爆发元年,从OpenAI的GPT系列到Meta的LLaMA,从Google的BERT到国产的DeepSeek、Qwen,模型架构和性能持续突破。

3.1 GPT系列 — 生成式预训练Transformer

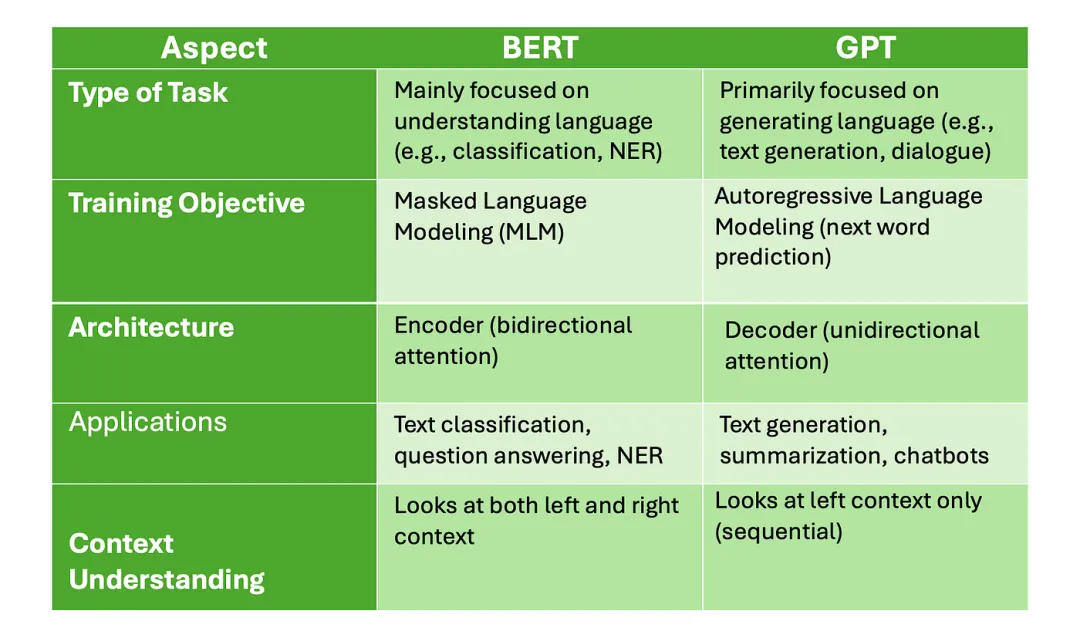

图6:GPT与BERT架构对比 — 单向语言模型 vs 双向编码器

GPT (Generative Pre-training Transformer) 是OpenAI开发的大规模语言生成模型。GPT采用仅解码器(Decoder-only)架构,通过预训练+微调的范式实现强大的语言生成能力。

3.2 BERT — 双向编码器理解模型

BERT (Bidirectional Encoder Representations from Transformers) 由Google于2018年发布,采用仅编码器(Encoder-only)架构,是理解任务的标杆模型。BERT的核心创新在于双向上下文建模——能够同时考虑词语的左右上下文。

3.3 LLaMA — 开源大模型先驱

LLaMA (Large Language Model Meta AI) 是Meta于2023年发布的开源大模型系列,凭借高效率和开源可商用的特性,迅速成为开源社区的标杆。

- LLaMA 2 — 70B参数,性能追平GPT-3.5,开源商用

- LLaMA 3 — 8B/70B/405B参数,支持长上下文

- 社区衍生:Vicuna、Alpaca、Qwen、DeepSeek等众多开源模型

3.4 国产大模型崛起

DeepSeek

深度求索 · 高性价比开源模型

Qwen 通义千问

阿里云 · 多模态能力强

文心一言

百度 · 中文理解优势

智谱ChatGLM

智谱AI · 学术友好

2024年,国产开源大模型迎来爆发。DeepSeek-V3以不到GPT-4十分之一的训练成本实现了接近的性能,Qwen系列在国际开源社区屡获好评,标志着中国在大模型领域从跟随走向引领。

3.5 主流模型对比

| 模型 | 机构 | 架构 | 特点 |

|---|---|---|---|

| GPT-4 | OpenAI | Transformer Decoder | 多模态、最强推理 |

| Claude 3 | Anthropic | Transformer | 安全对齐、长上下文 |

| Gemini | Transformer+MoE | 原生多模态 | |

| LLaMA 3 | Meta | Transformer Decoder | 开源商用、高效率 |

| DeepSeek-V3 | 深度求索 | MoE + MLA | 低成本高性能 |

| Qwen 2.5 | 阿里云 | Transformer | 中文优化、多模态 |

四、未来发展趋势展望

图7:AI人工智能的未来 — 深度学习推动技术革命

4.1 技术方向

- 推理能力增强 — o1范式开启"慢思考"时代,复杂推理任务将成为大模型新的竞技场

- 多模态融合 — 文本、图像、音频、视频、3D的统一理解与生成

- 端侧部署 — 小型化、高效化的大模型将普及到移动设备和物联网

- 具身智能 — AI与机器人结合,实现自主学习与复杂操作

- AGI探索 — 虽然真正的AGI尚需时日,但技术正在稳步推进

4.2 应用趋势

4.3 挑战与思考

⚠️ AI发展面临的挑战

算力瓶颈、成本问题、隐私安全、伦理治理、可解释性、幻觉问题...AI技术的快速发展也带来了诸多挑战,需要技术界、产业界和政策制定者共同应对。

五、总结

2024年的AI领域精彩纷呈,从大模型的技术突破到应用场景的快速落地,我们见证了人工智能的飞速发展。理解LLM、AGI、AIGC、Agent、RAG等核心概念,掌握CNN、RNN、Transformer等主流算法,熟悉GPT、BERT、LLaMA等热门框架,将帮助我们更好地把握AI技术的发展脉络。

展望未来,AI将继续深刻改变我们的生活和工作方式。保持学习、拥抱变化,方能在AI时代立于潮头。

大模型并不是智能本身,当下的大模型与智能之间的差距还很大。沿着大模型这条路可能根本达不到智能的彼岸,只是现阶段还没有找到比大模型更好的交通工具。

夜雨聆风

夜雨聆风