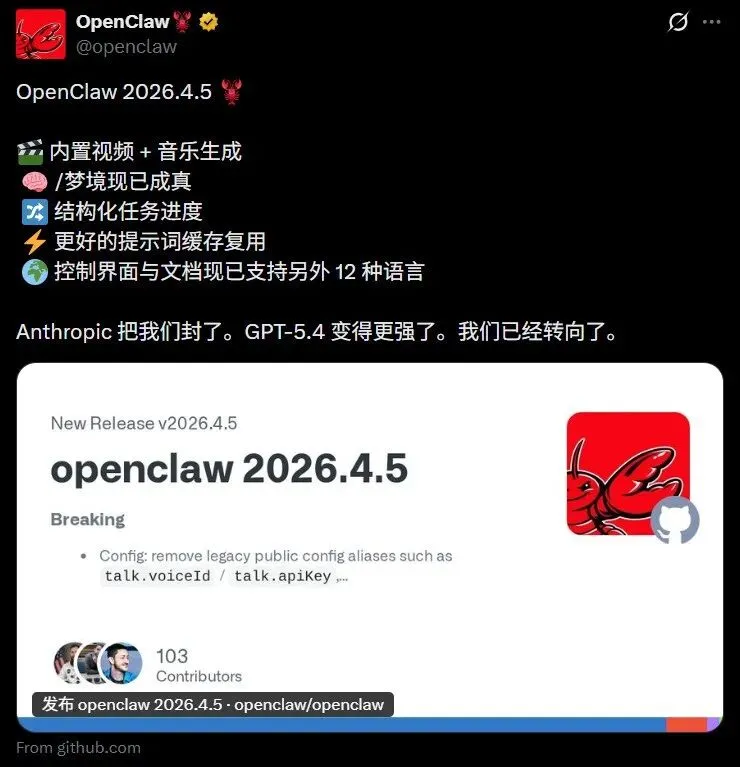

💡 4月5日发布:OpenClaw 4.5的核心新能力

4月5日,OpenClaw发布了2026.4.5版本。这次更新的核心是两个方向:

1. 媒体生成能力:首次内置视频、音乐、图片生成,可直接调用Runway、Google Lyria等11家提供商

2. Dreaming记忆系统:给AI装了一套模拟人类睡眠的"记忆巩固"机制,分Light/Deep/REM三阶段

🎬 视频与音乐来了(需自行配置API)

现在输入/video_generate或/music_generate,OpenClaw可以直接调用:

视频:xAI (Grok)、Runway、Google、MiniMax等11家提供商

音乐:Google Lyria、MiniMax

图片:新增OpenAI gpt-image-1(支持参考图编辑)

明确说明的限制:

需要自行配置对应提供商的API Key,不是开箱即用

支持异步任务追踪,生成时不会卡住,完成后自动推送

官方未提供各提供商的价格对比表。网络上早期用户反馈提到:“Runway效果好但贵,MiniMax相对便宜但风格可能不同”,暂无具体计费数据。

🧠 Dreaming记忆系统:AI的"睡眠三阶段"

这是模拟人类睡眠记忆巩固的机制:

Light(浅睡眠):快速整理近期短期记忆,把杂乱的日常记录分组归类

Deep(深睡眠):基于权重决定哪些记忆值得长期保留,支持配置recencyHalfLifeDays(记忆半衰期)和maxAgeDays(最大存活时间)

REM(快速眼动):提取"持久真相"(lasting truths),写入dreams.md长期记忆文件

开启方式: 输入/dreaming on,默认每天凌晨3点自动运行。可通过Gateway的Dreams面板查看记忆整理全过程,包括"梦境日记"(Dream Diary)查看AI的"反思"。

⚡ 提示词缓存优化(能省多少?)

4.5版本做了一轮系统性优化,涉及MCP工具排序、系统提示指纹归一化等,声称能减少重复Token消耗。

但官方未给出具体数字,实际能省多少?不同使用模式下差异多大?目前尚未有人发布大规模对比测试。

🤔 疑问:我们在讨论什么?

关于Dreaming系统:

【疑问:场景适配边界】 官方建议用于"长期项目记忆",但"长期"的定义模糊。如果做短期任务开启Dreaming,会不会污染长期记忆?

【疑问:记忆文件膨胀】

dreams.md如果长期积累,是否会影响性能?官方提到Deep阶段会"决定保留哪些",但具体的清理淘汰策略文档未详细说明。【疑问:多模型兼容性】 如果开启Dreaming后切换模型(如从Claude切到GPT-5.4),记忆格式是否兼容?长期项目的记忆连续性会不会断裂?

关于视频生成:

【疑问:Workflow健壮性】 异步任务虽然不错过,但怎么设计"生成失败重试"和"质量把关"机制?官方未提供最佳实践模板。

【疑问:成本不透明】 11家提供商价格差异大,但官方未提供"场景-提供商"推荐对照表。

💬 来社区聊聊:你准备怎么试?

OpenClaw 4.5刚发布,大家都还在同一起跑线熟悉文档。

几个问题想提前征集你的想法:

看完Dreaming的文档,你觉得什么场景最适合开这个功能?你担心它可能会在什么情况下"记错"或"漏记"?

视频生成功能,你打算先接入哪家提供商?为什么选择这家?

如果你也在研究怎么配置4.5版本,或者对Dreaming的算法有疑问,欢迎来OPC共生社区交流。

点击加入OPC共生社区 👉

夜雨聆风

夜雨聆风