当AI从“回答问题”走向“执行任务”,企业面对的核心问题,已经不再是模型是否足够聪明,而是系统是否足够可控、可追溯、可问责。从审计视角看,AI代理不再只是辅助工具,而是在逐步接近流程中的“准执行主体”。

4月9日,Anthropic发布了关于Trustworthy Agents(可信AI代理)的研究文章。文章讨论的表面主题,是AI代理如何在真实业务环境中安全、可靠地运行;但如果从审计与治理角度去看,它真正触及的是一个更深层的问题:当AI开始具备一定自主性并进入组织流程之后,企业如何重新设计授权、控制、监督与责任边界。

过去,大模型更多被视为“会回答问题的系统”;而现在,随着AI开始调用工具、处理文件、跨系统执行任务,它正在从“认知辅助者”演变为“流程参与者”。这意味着,企业面对AI时,讨论重点也必须发生转移:从能力评估,转向治理评估;从模型好不好用,转向系统能不能被有效控制。

对于审计而言,这并不是一个狭义的技术问题,而是一个典型的内部控制与风险治理命题。未来,AI代理很可能像员工、外包服务商、RPA机器人一样,成为需要被纳入授权体系、控制体系与监督体系的对象。

一、AI代理的真正变化,不是“更会回答”,而是开始“参与执行”

传统大模型的主要应用场景,多停留在问答、写作、总结、检索等认知层面。此类系统的主要风险,往往表现为输出质量风险,例如事实错误、逻辑不严密、引用不准确等。

但Anthropic定义下的Agent,并不只是更会聊天的模型,而是一类能够围绕目标自行规划步骤、调用工具、观察执行结果、调整后续路径,并在必要时继续推进任务的系统。它的关键特征不是“说”,而是“做”。

这意味着,AI的组织角色正在发生变化:从信息输出者转向任务执行参与者,从被动响应工具转向主动推进节点,从单轮交互系统转向嵌入业务流程的操作单元。

这正是审计必须高度重视的拐点。因为一旦AI不再只是影响“认知结果”,而是开始直接影响“业务结果”,其风险属性就会随之变化。

对审计来说,未来需要关注的,就不只是“员工是否正确使用AI”,而是:AI代理是否在适当授权下执行了适当行为,它的行为是否可见、可追溯、可复核。

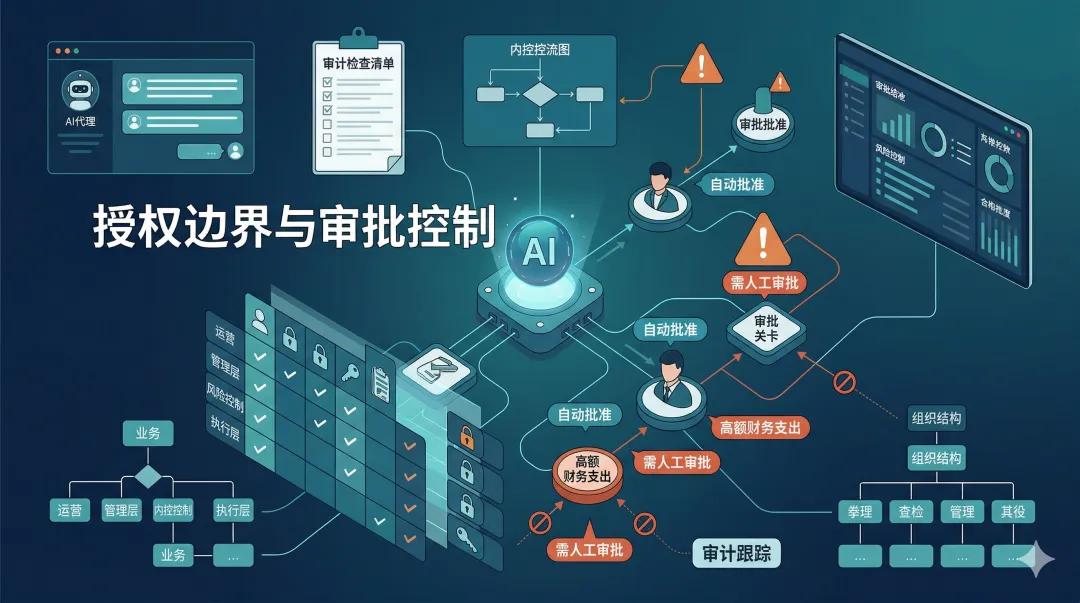

二、从内部控制视角看,Agent时代最重要的不是自动化,而是授权边界

Anthropic在文中提出一个核心原则:必须让人保持控制权。

任何具备执行能力的主体,只要进入组织流程,就必须回答三个问题:它被授权做什么,它在什么条件下可以自主行动,它越界时组织能否及时发现并制止。这恰恰是内部控制体系中最基本、也最核心的控制逻辑。

企业引入AI代理时,不能只讨论模型能力和插件接入,而必须同步设计工具边界、动作边界、审批边界、环境边界、数据边界。

这意味着,Agent治理首先不是算法问题,而是控制设计问题。

三、AI代理会倒逼控制点重构:从“单步审批”走向“计划级审批”

复杂任务下,逐步确认很容易让用户陷入机械点击,最终让审批流于形式。文章提出先看整体计划、再批准执行的思路,本质上是在把控制重点从动作审批转向策略审批。

未来对AI代理更有效的控制方式,可能不是简单增加审批次数,而是把控制前移到任务目标是否明确、执行计划是否合理、关键节点是否保留人工干预、异常情形是否能够回退给人工判断等层面。

例如:对外发送、支付、提交审批、合同变更、权限调整、批量删除、数据导出等动作,不宜完全交由AI自动完成。

审计真正要判断的,不是“有没有审批”,而是“控制是否设置在正确层级,人的判断权是否被真实保留”。

四、可信代理最重要的能力之一,不是“持续执行”,而是“知道什么时候该停下来问人”

可信代理必须学会在不确定时主动暂停、请求澄清,而不是默认假设、一路执行到底。这对应的是一个非常重要的治理概念:例外事项处理机制。

如果系统在用户目标不完整、规则缺失或冲突、事项超出阈值、涉及价值判断或责任判断等场景下仍然持续推进,就可能导致重大偏差。

一个AI代理是否“可信”,并不只取决于它完成了多少任务,更取决于它是否能在关键时点暴露不确定性,并把不应由其独立决定的问题及时退回给人。

从审计角度看,真正高风险的,往往不是“系统不会做”,而是系统在没弄清楚的情况下继续做。

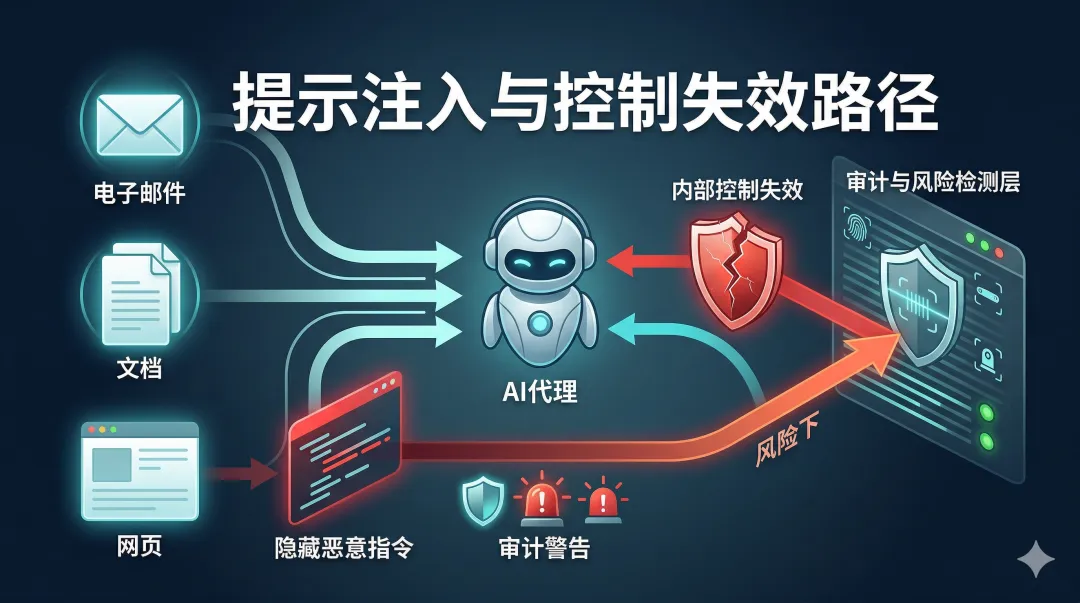

五、Prompt Injection不只是安全术语,更应被理解为一种新的控制失效路径

所谓提示注入,是指恶意指令隐藏在邮件、网页、文档、知识库等内容中,诱导AI代理偏离原有规则,执行原本不应执行的操作。从审计角度看,它更应被理解为一种新的控制失效路径。

这意味着,Agent时代的风险,不只是“模型答错”,更是系统被诱导去做错。

未来审计在评估AI代理安全性时,必须把关注点扩展到整个执行链条,包括外部输入可信性分层、敏感动作二次确认、最小权限原则、环境隔离、日志告警、回滚与事后追查机制等。

Prompt Injection提醒企业的,不是单点漏洞,而是系统工程上的薄弱环节可能被放大并串联。

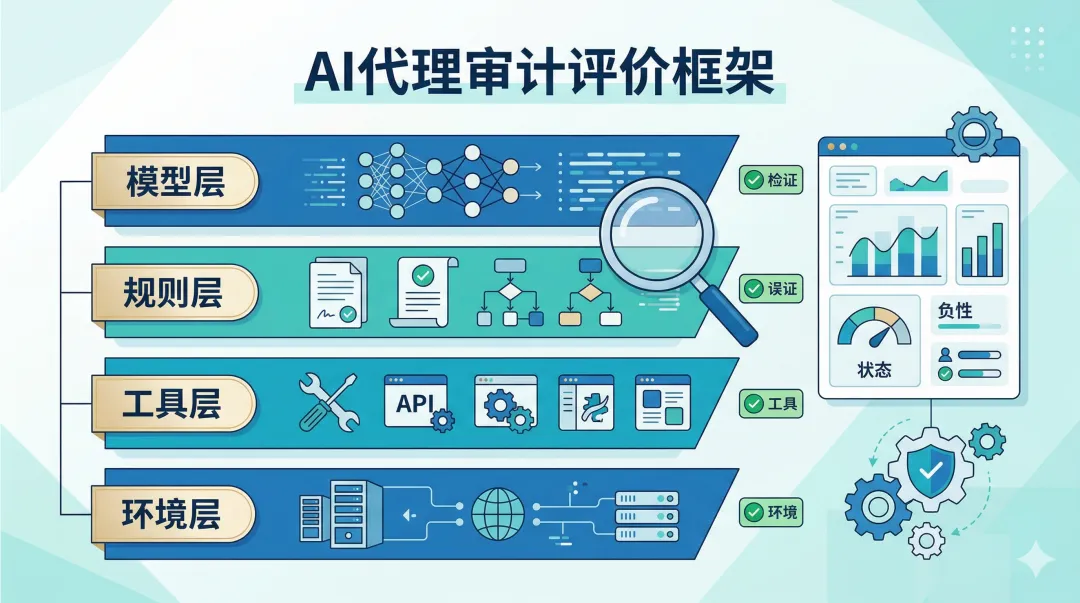

六、未来审计评价AI代理,至少应从四个层面建立观察框架

结合内部控制与信息系统审计思路,未来可从模型层、规则层、工具层、环境层四个维度评价AI代理,分别关注能力边界、行为约束、权限隔离与运行环境风险。

这四层,实际上可以构成未来审计评价AI代理的基础框架。当企业越来越多地把AI嵌入业务流程时,审计工作也必须从“抽查某次结果”走向“评价整套机制”。

七、对企业而言,AI代理真正的落点不是“替代人工”,而是“纳入治理后逐步放权”

企业不应把Agent直接视作“万能助手”,更不能在控制机制尚未成型时就将其推入核心流程。更稳妥的路径,应当是:先纳入治理,再逐步放权。

可以优先从低风险、标准化、可复核的场景试点,先赋予读取、检索、草拟、比对、整理等有限能力,对提交、发送、变更、删除、支付等高风险动作保留人工把关,并建立全过程日志、抽查、回溯和问责机制。

这并不是对AI的保守,而恰恰是让AI真正形成组织能力的务实路径。

结语

对审计而言,未来一个重要问题将不再是“企业有没有上AI”,而是:是否为AI建立了清晰的授权边界,是否对关键动作保留了有效的人类审批,是否让系统具备了暂停、请示和回退机制,是否能够追踪AI做了什么、为什么这么做、出了问题如何追责。

如果这些问题没有答案,那么再强的Agent,也只是高风险自动化;如果这些问题得到妥善回答,AI代理才有可能真正成为企业流程中可信、可控、可监督的一部分。

归根到底,审计要看的不是AI有多像人,而是:它是否被置于一个像样的控制体系之中。

联系我们

联系交流:陈老师 18589254383联系地址:江苏省南京市雨花台区绿地之窗C5座4楼

夜雨聆风

夜雨聆风