更多AI前沿科技资讯,请关注我们:

【closerAI ComfyUI】FLUX.2 Small Decoder 重磅发布!解码速度提升1.4倍,显存直降40%,本地出图更快更香

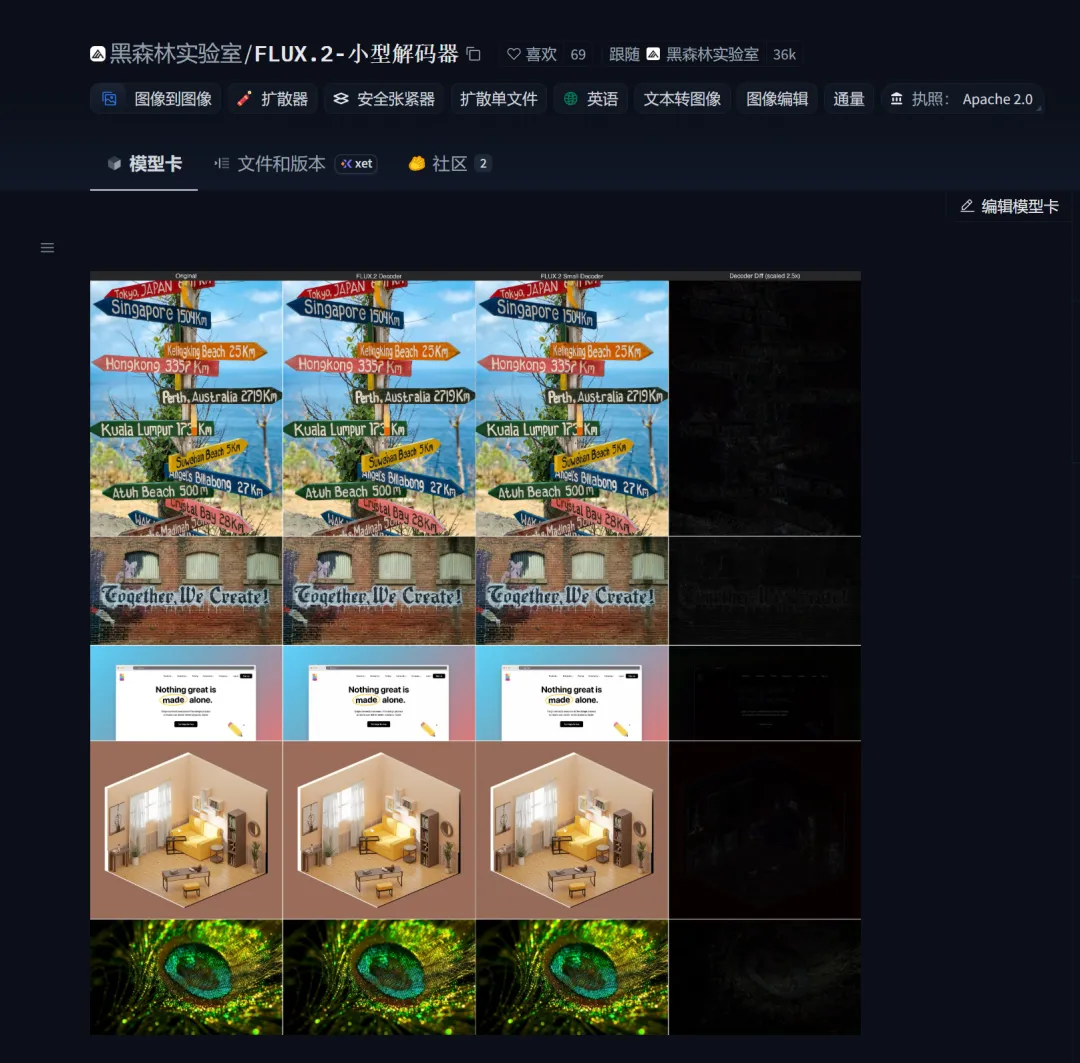

Black Forest Labs 最近又放出了一个实用性极强的优化模型——FLUX.2 Small Decoder。这是一个专门针对FLUX.2系列模型的蒸馏版VAE解码器,可以直接替换原来的标准decoder。

简单来说,它在几乎不损失画质的前提下,让解码速度提升约1.4倍,同时解码时的显存占用也降低约1.4倍。这对很多本地跑FLUX的朋友来说,简直是福音。

为什么值得关注?

速度显著提升解码过程比原版快大约40%,生成一张图的整体耗时能明显缩短,尤其适合需要快速出图的场景。

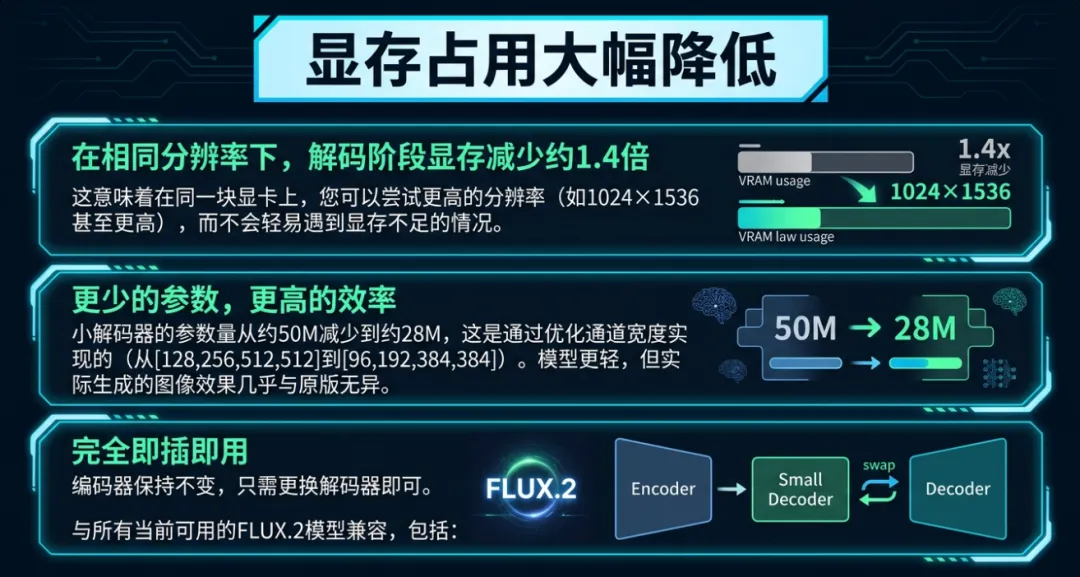

显存占用大幅降低在相同分辨率下,解码阶段的显存需求减少约1.4倍。这意味着在同一张显卡上,你可以尝试更高的分辨率(比如1024×1536甚至更高),而不容易出现显存不足的情况。

参数更少,效率更高Small Decoder的参数量从原来的约50M精简到约28M,通过优化通道宽度实现(从[128,256,512,512]缩小到[96,192,384,384])。模型更轻量,但实际生成效果与原版几乎看不出差异。

完全即插即用编码器部分保持不变,只需要替换解码器即可。兼容目前所有开放的FLUX.2模型,包括:

FLUX.2-klein-4B(完全开源,强烈推荐本地入门使用)

FLUX.2-klein-9B

FLUX.2-klein-9b-kv

FLUX.2-dev

FLUX.2 [klein]系列本身就是Black Forest Labs推出的轻量高效版本,搭配这个Small Decoder后,整体体验会更加丝滑。特别适合消费级显卡(RTX 30/40系列)本地运行、快速迭代,或者做短剧、分镜、动画素材批量生成。

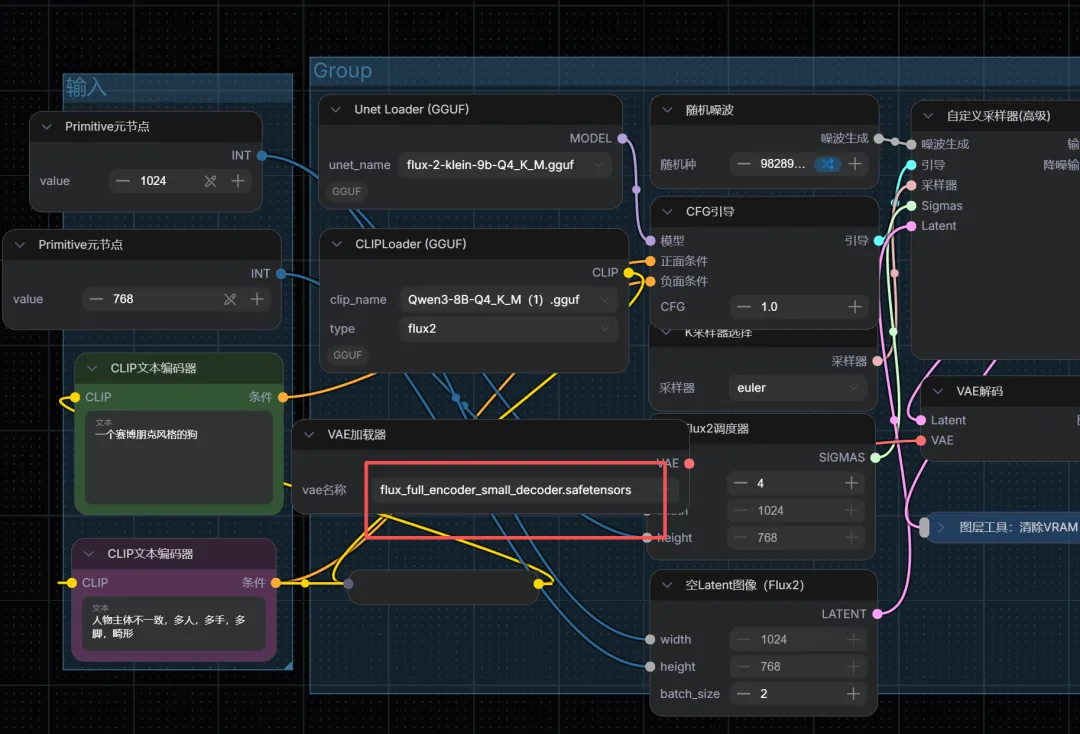

在comfyUI中的体验

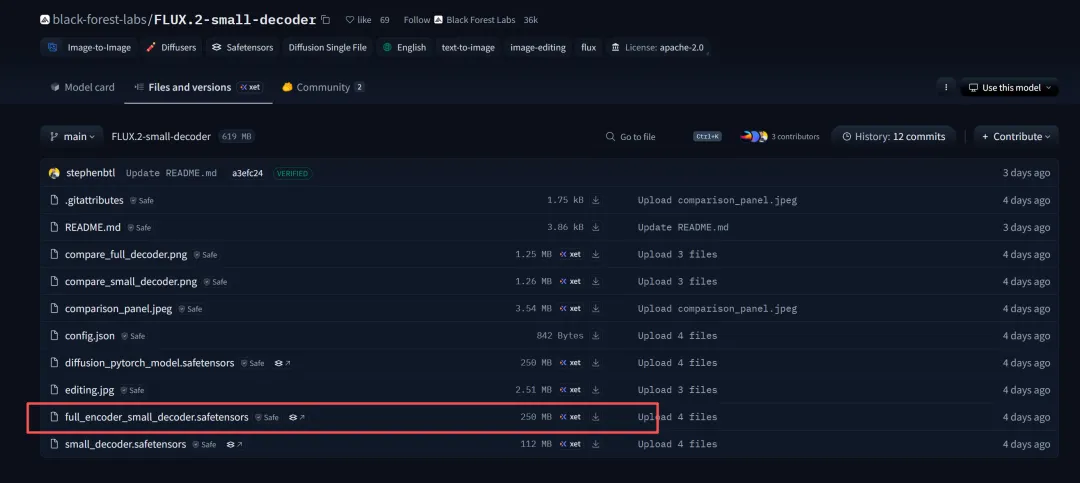

使用方法很简单,下载模型。

FLUX2kelin工作流的基础上将原来的VAE替换成Small Decoder的模型即可。如下图所示:

写在最后

FLUX.2 Small Decoder的出现,再一次证明了开源社区和Black Forest Labs在模型优化上的持续投入。它让高质量的图像生成门槛进一步降低,无论你是做AI短剧、短片、漫剧,还是日常创意出图,都能从中受益。

如果你已经在用FLUX.2 [klein]系列,强烈建议试试这个Small Decoder,相信你会感受到明显的速度和显存优化。

项目地址:https://huggingface.co/black-forest-labs/FLUX.2-small-decoder

干实事的团队永远埋头在干一件事,并做到极致,黑森林团队就是如此,开源就低调开源,从不搞小动作,干就完,也从不颠倒是非做局博关注,闭说成开。

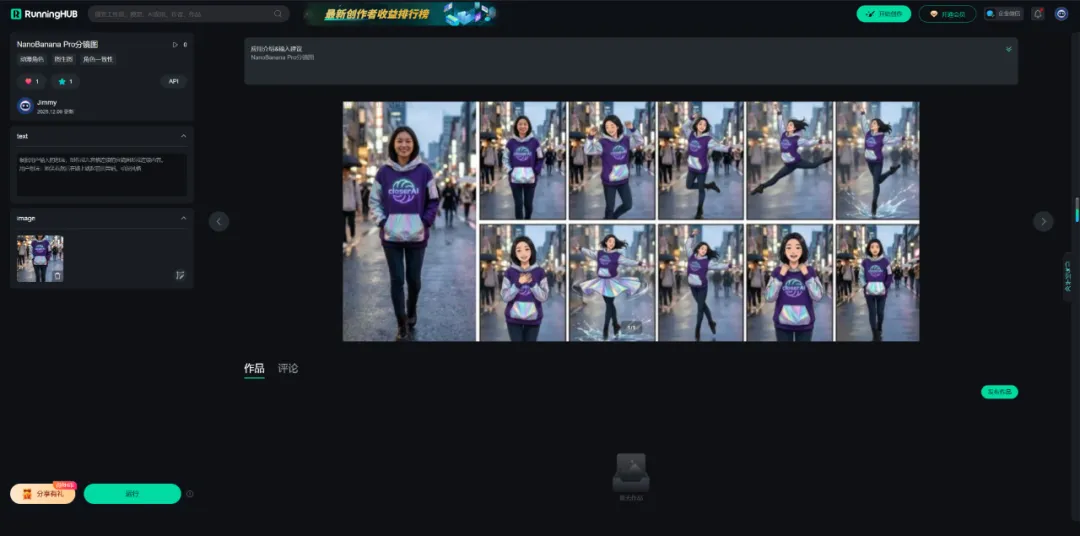

本地算力不够怎么办?

如果本地设备算力不好的小伙伴,推荐使用线上comfyUI来运行体验:runninghub.cn

NanoBanana Pro分镜图应用体验地址:

https://www.runninghub.cn/ai-detail/1998278644248272898

最后几句:

如果对你有帮助,请一键三连支持下我,感谢

CloserAI 3D Pose Editor:http://aigc.douyoubuy.cn/2025/12/03/3448/closerAI-nanoPrompts:http://closerai.douyoubuy.cn/2025/11/24/3396/closerAI 分镜设计 软件(exe)本地运行版http://aigc.douyoubuy.cn/2025/11/22/3350/以下是closerAIwater节点:http://aigc.douyoubuy.cn/2025/10/22/3121/分镜分词器节点:http://aigc.douyoubuy.cn/2025/10/11/3080/json结构化提示词http://aigc.douyoubuy.cn/2025/11/05/3242/

以上是closerAI团队制作的closerAI flux2klein9B文生图工作流(Small VAE)0408的介绍,当然,也可以在我们closerAI会员站上获取(查看原文)。

以上,既然看到这里了,如果觉得不错,随手点个赞、在看、转发三连吧,如果想第一时间收到推送,也可以给我个星标⭐~谢谢你看我的文章,我们,下次再见。

>/ 作者:JimmyMo

更多AI前沿科技资讯,请关注我们:

夜雨聆风

夜雨聆风