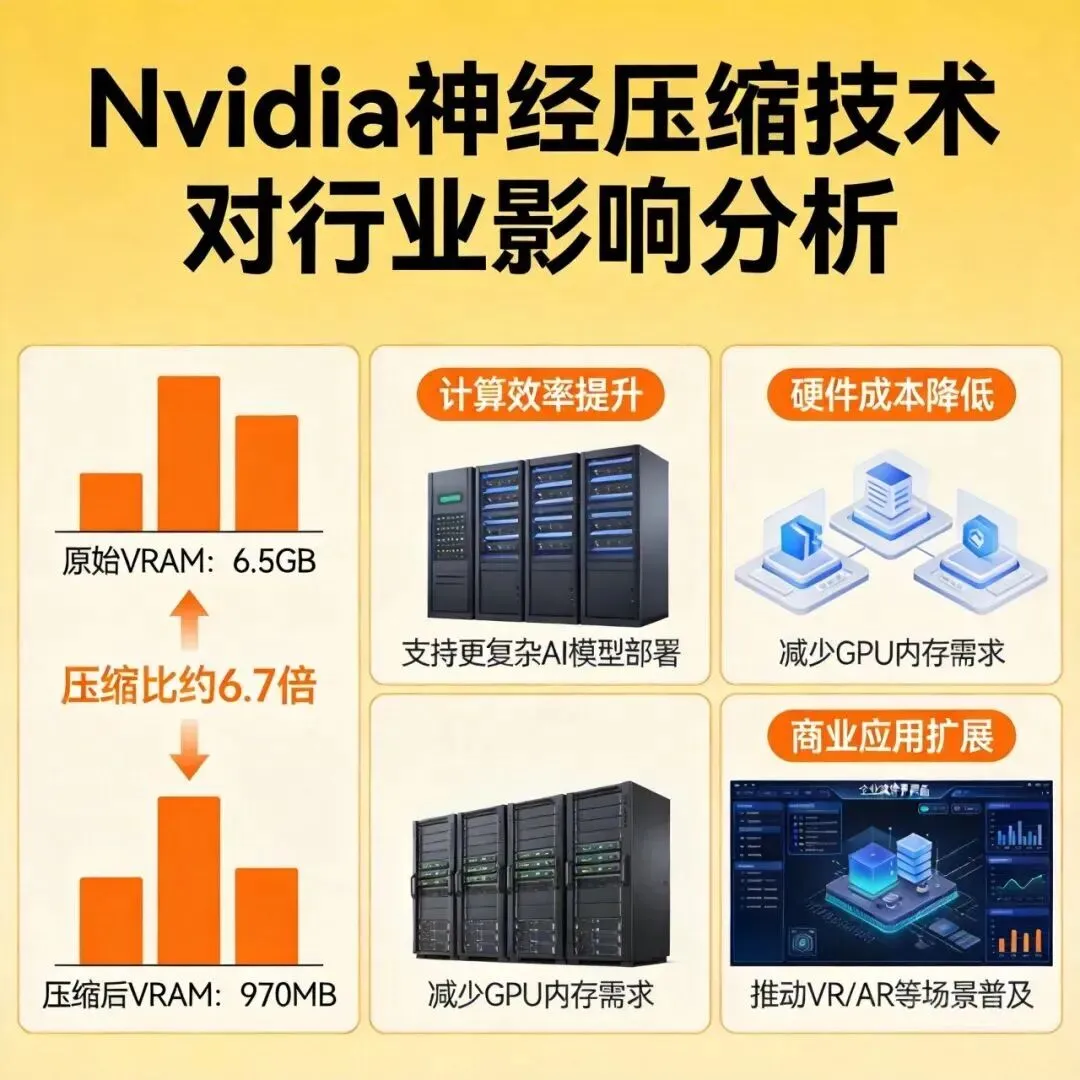

AI圈突然爆出大新闻!Nvidia神经压缩VRAM从6.5GB到970MB,行业格局又要变天了?

我看到这个新闻的时候。

真的被吓到了。

Nvidia这是要把天给捅破啊。

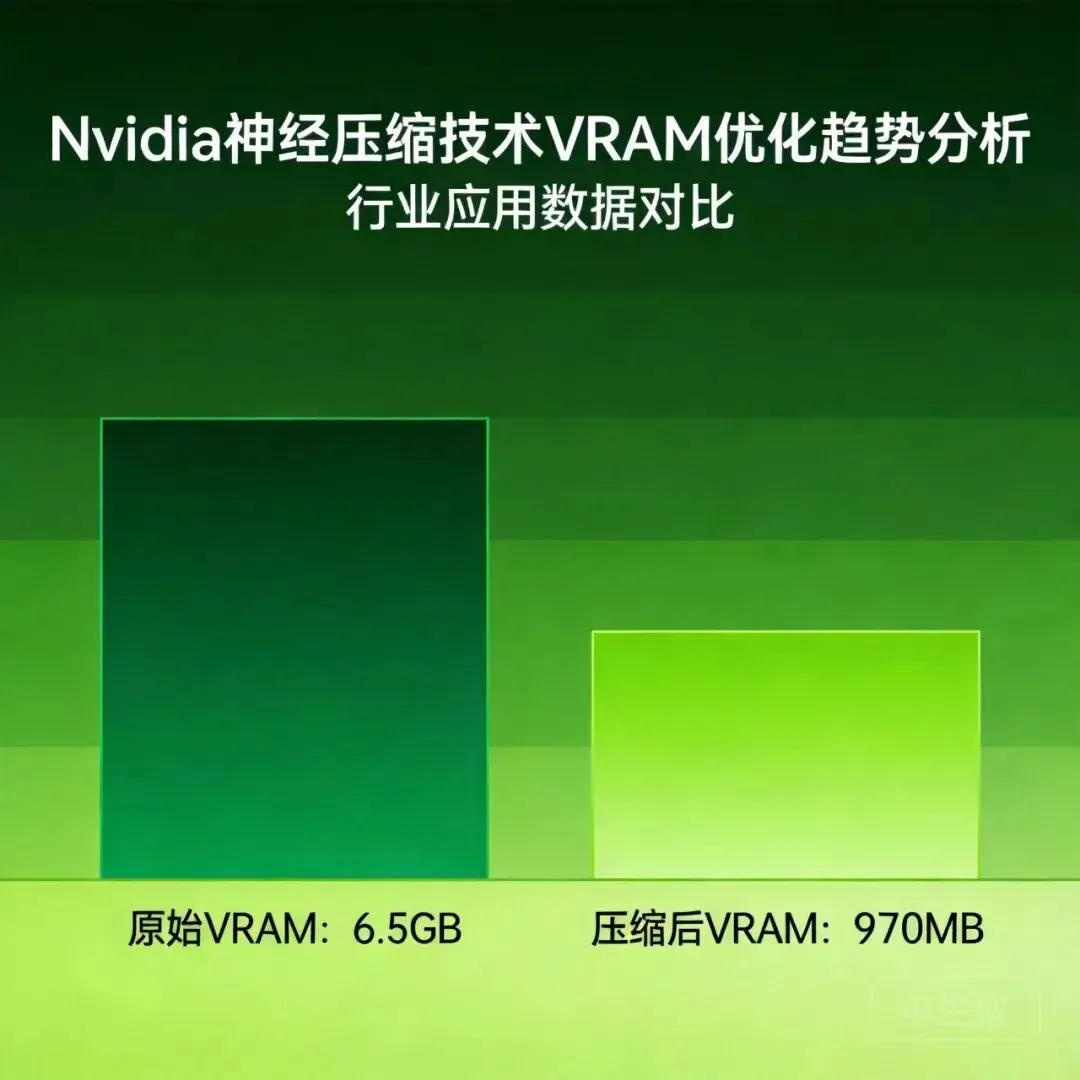

原先需要6.5GB显存的纹理数据。

现在直接压缩到970MB。

相当于直接缩小了快7倍。

这是什么概念?

我给你好好聊聊。

一、这到底是个什么黑科技?

说实话,玩3A游戏的朋友应该都有这个痛点。

现在游戏纹理越做越精细。

显存不够的话。

要么就得降分辨率,要么就得关纹理。

游戏体验差很多。

我自己那张3060,6GB显存。

玩点新游戏真的有点吃紧。

很多时候不得不降画质。

这种憋屈你懂吧?

Nvidia这次展示的神经压缩技术。

思路其实挺巧妙的。

不是传统的zip压缩那种。

是用神经网络把纹理和材质数据。

转换成紧凑的神经表示。

需要用的时候再实时解压。

这样一来,显存占用就下来了。

我看了一下测试数据。

真的太夸张了。

原先6.5GB → 现在970MB。

压缩率接近7:1。

而且质量损失很小。

人眼几乎看不出来区别。

二、这不仅仅是游戏的福音,AI也能受益

很多人可能会说,这就是给游戏玩家用的。

跟AI有啥关系?

说实话。

我觉得这个技术对AI行业的影响。

可能比游戏还大。

你想想看。

现在大模型越来越大。

推理的时候需要很大的显存。

很多人想在家跑个7B模型。

都得搞量化,损失精度。

如果能把这种神经压缩技术用到模型权重上呢?

说不定以后。

16GB显存就能跑70B模型。

这是什么概念?

直接把大模型的门槛降下来了。

普通玩家也能玩大模型了。

当然,现在这个技术还是在游戏纹理上演示。

能不能推广到模型权重。

还需要时间验证。

但这个方向。

我个人非常看好。

三、对行业来说意味着什么?

其实这几年。

大家都在拼显存容量。

显卡越做,显存越大。

价格也越来越贵。

现在倒好。

Nvidia告诉你,原来压缩比容量更重要。

如果这个技术成熟了。

以后你买显卡。

可能不用一味追求大显存了。

相同显存下。

能装更大的模型,能跑更精细的游戏。

对于整个行业来说。

这真的是一场革命。

说实话,我挺期待的。

毕竟不是每个人都买得起4090这种巨兽。

能让更多中低端显卡。

也能享受到AI和高清游戏带来的乐趣。

这本身就是一件好事。

写在最后:Nvidia神经压缩黑科技,VRAM利用率革命来了

以后跑大模型不用那么大显存了,中低端显卡也能玩AI,这波真的是降维打击。

你用过Nvidia的神经压缩技术了吗?感觉怎么样?欢迎在评论区聊聊你的使用体验。

#Nvidia #AI #黑科技 #游戏

关注我

,每天给你带来最新的AI行业观察和实战分析。

有什么想说的,欢迎在评论区留言交流。

夜雨聆风

夜雨聆风