💡 AI 正越来越多地进入我们的工作和生活。很多时候,它确实会让人感觉自己像装上了"能力外骨骼"一样,做事更快、思路更清。但一个更值得追问的问题是:这种变强,究竟是真正的协同,还是只是相对原来的自己被增强了?

这两年,AI 已经从一种新鲜工具,慢慢变成了很多人工作和生活里的基础设施。在公司里,我看到同事会用它查技术问题、整理资料、辅助分析;在家里,我也看到父母会用它查做菜的方法、问生活上的小问题。它越来越像搜索引擎、电灯、自来水一样,开始进入普通人的能力系统。

而且,大多数人应该都会有一种共同的感受:用了 AI 之后,自己好像确实变强了。以前一个问题,要翻很多资料、找很多网页、自己慢慢拼;现在,很多信息可以被快速汇总,很多表达可以被快速组织,很多想法可以被快速成型。它让我们第一次很具体地感受到,原来能力真的可以被外部工具放大。

但问题也正是从这里开始的。用了 AI 之后,我变强了,这件事是否就等于:我和 AI 组合起来,一定比我单独更强,也一定比 AI 单独更强?换句话说,AI 对人的作用,究竟只是增强,还是已经形成了真正的协同?

一、一篇关键论文:增强 vs 协同

最近,我读到一篇很有代表性的论文,正好系统回答了这个问题。论文题目叫《When Combinations of Humans and AI Are Useful: A Systematic Review and Meta-analysis》。这篇论文发表在《Nature Human Behaviour》,作者来自 MIT。它不是讨论某一个零散案例,而是系统分析了上百个实验,想回答一个非常关键的问题:人和 AI 的组合,到底什么时候真的有用,什么时候反而不如单独最强的一方?

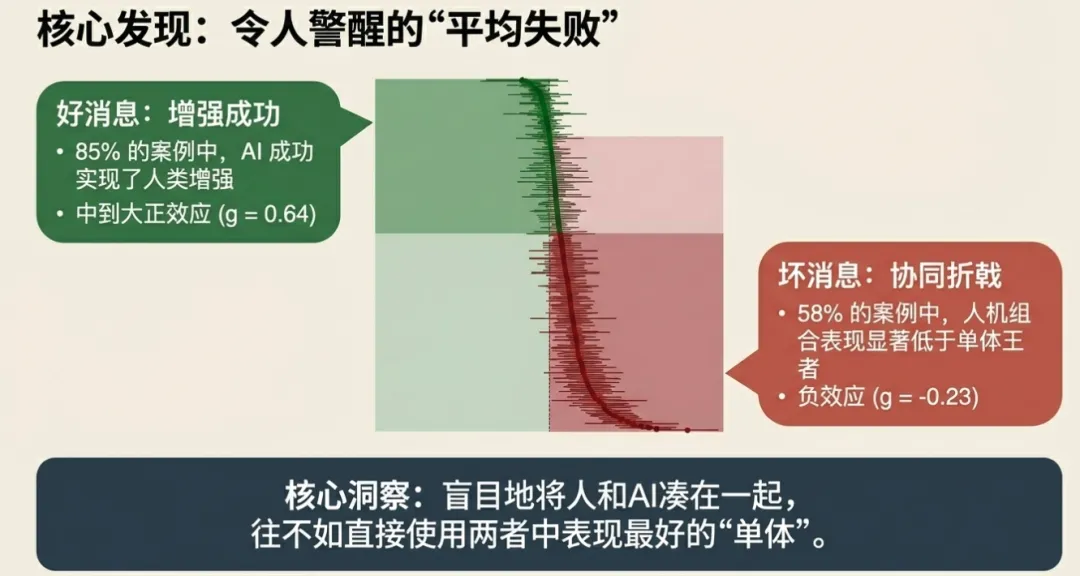

这篇研究最有价值的地方,不是单纯告诉我们 AI 好不好,而是把一个常常被混在一起的问题,拆成了两个层次。第一个层次叫增强,也就是人和 AI 组合之后,是否比人单独做更强。第二个层次叫协同,也就是人和 AI 组合之后,是否连人单独做和 AI 单独做里更强的那一个,也一起超过了。

这个区分非常重要。因为很多时候,我们以为"用了 AI 后我更强了",就默认等于"我和 AI 实现了 1+1>2"。但其实,这两件事根本不是一回事。用更通俗的话说,这篇论文得到的核心结论是:平均来看,AI 确实常常能把人增强起来,也就是让你比原来的自己做得更好;但这并不自动意味着,你和 AI 这个组合,已经强过了单独最强的那一方。增强,不等于协同。

二、任务类型的影响:创作型 vs 决策型

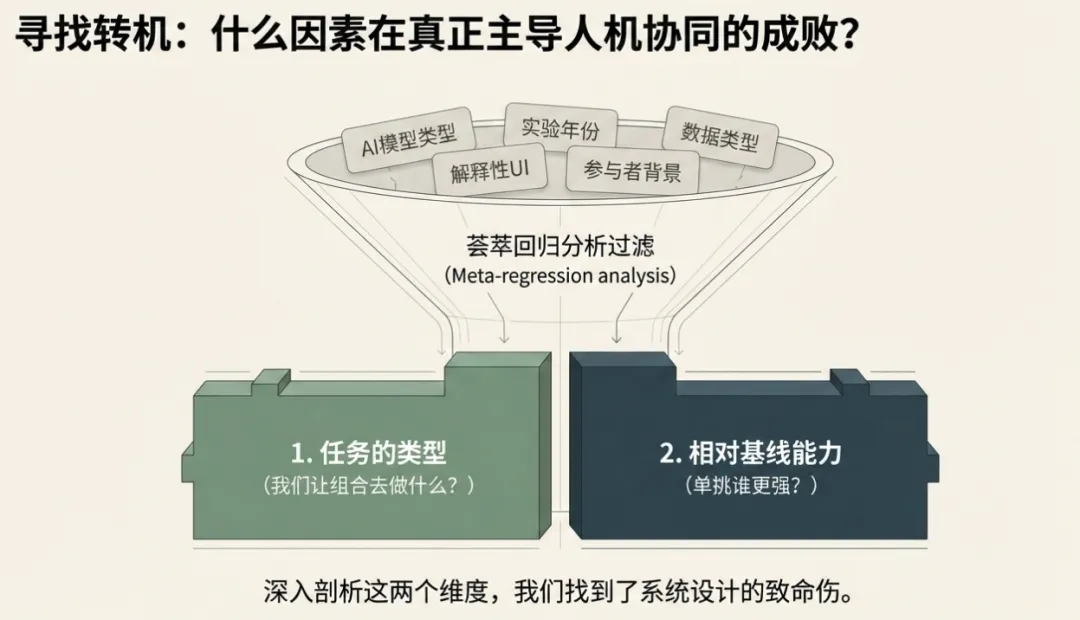

很多人看到这里,可能会问:既然如此,那决定人机协作成败的关键,到底是什么?我觉得这篇论文里,最重要的有两个洞见。

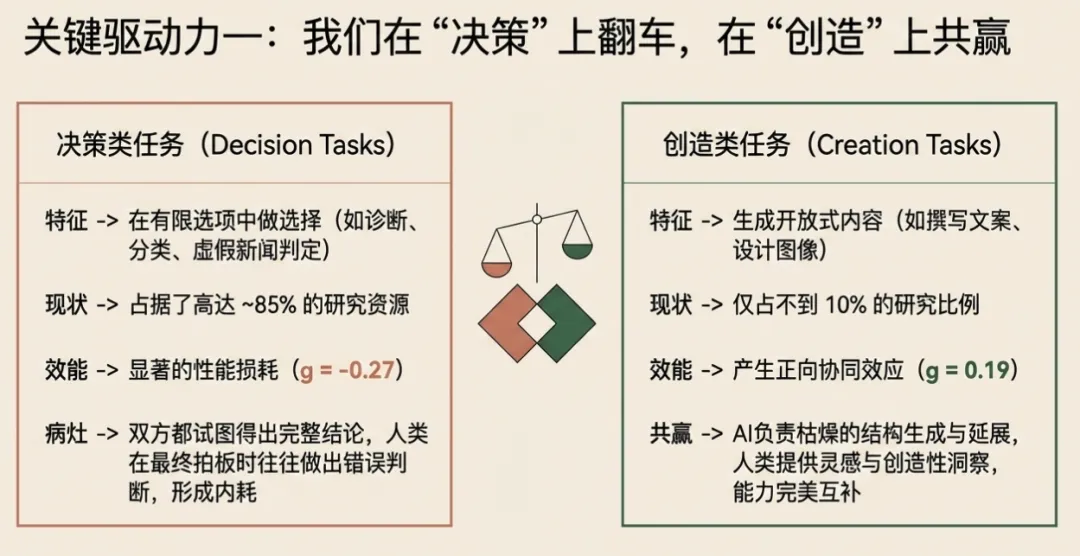

第一个洞见是,任务类型会显著影响人机协作的效果。创作型任务更容易形成真正协同,决策型任务则更容易失效。

原因并不复杂。创作型任务往往天然包含两部分:一部分需要人的洞察、理解、判断、价值感和方向感,另一部分则包含大量的组织、补全、展开和变体生成,而这恰恰是 AI 擅长的。所以在这类任务中,人和 AI 更容易形成互补关系。不是双方都去回答同一道完整的题,而是在同一个产出链条中,各自承担不同功能。

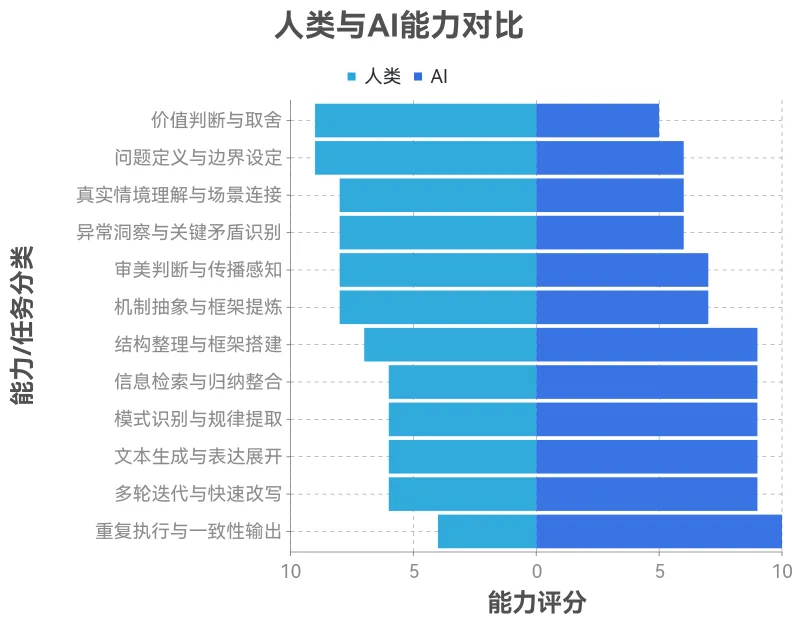

人更擅长的:问题定义、真实场景连接、价值判断、边界条件输入、复杂情境下的取舍

AI 更擅长的:信息检索、快速归纳、结构搭建、语言生成、多版本试错、重复执行

也就是说,人的优势更偏向方向、判断和约束,AI 的优势更偏向整理、展开和加速。

三、谁本来更强:一个职场类比

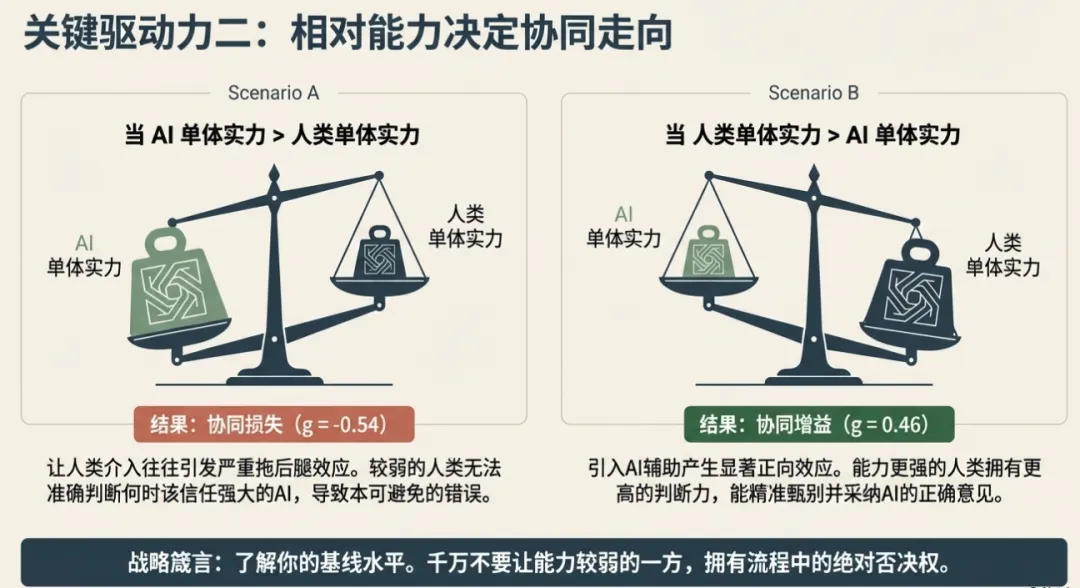

第二个洞见是,人和 AI 谁本来更强,影响极大。当人本来就比 AI 更强时,人机组合更容易出现正向协同;而当 AI 本来就比人更强时,人机组合反而更容易把结果拉低。

很多人会本能地觉得:如果 AI 已经比人强了,那再加一个人,不是应该更保险吗?但现实未必如此。因为当 AI 本来就更强时,如果人并不具备足够好的判断能力去识别什么时候该信 AI、什么时候该保留自己的判断,那么人的参与,反而可能会把一个本来更优的系统拉低。

这特别像职场中的一个经典场景。假设有一个下属能力非常强,专业水平远高于一般人。如果他的领导也很强,或者至少具备足够的判断力,知道这个下属擅长什么、在哪些问题上更靠谱、什么时候该放手、什么时候该介入,那么这两个人的组合,很可能会非常强。领导不需要事事自己做,但他能整合资源、把握节奏、控制边界,让强下属的能力真正释放出来。

可如果领导本身能力不够,又缺乏判断力,他既看不懂下属到底哪里做得好,也分不清自己什么时候该放手、什么时候该纠偏,却还总想监督、把关、最后拍板,那么这时候,监督就不再是增益,而会变成污染。结果往往不是 1+1>2,而是两个人配合起来还不如那个最强者自己单独做。

这和人机协作里的一个核心问题几乎是同构的。当 AI 已经在某类任务上明显比人强时,人真正的价值,往往不再是"和它抢着做同样的判断",而是去做另外几件更重要的事:输入真实约束,定义目标函数,设置边界条件,识别例外情况,在关键节点做取舍与纠偏。换句话说,AI 强,并不等于人没有价值;但人的价值,也不再主要体现在"我也来做一遍",而在于"我能不能把这个强能力放到正确的位置上"。

四、沉淀一个模块:人机协作模块

所以,回到现实里,我们真正需要的,不是一个模糊判断:AI 很强,所以要用 AI;而是一个可以反复调用、不断沉淀的人机协作模块。我把它叫做“人机协作三步法”。

触发

当你面对一个任务时,不要先急着问"要不要用 AI",而要先停一下,判断这到底是什么类型的任务。它更偏创作,还是更偏决策?更偏信息检索,还是更偏结构整理?更偏快速生成,还是更偏复杂取舍?只有先把任务性质看清,后面的协作才不会乱。

行动

第一步,先分任务。先判断这个任务的核心性质是什么,避免把完全不同的问题用同一种方法处理。

第二步,再看强弱。不要笼统地说谁整体更强,而要具体到这个子任务里,谁更适合主导。

第三步,最后定机制。明确谁先做、谁后做、谁负责生成、谁负责判断、谁负责复核、分歧出现时怎么处理。

机制

这背后的逻辑其实很简单。人机协作的关键,不是简单叠加,而是先识别任务,再匹配优势,最后设计流程。任务不同,人的价值位置就不同,AI 的作用方式也不同。真正有效的协作,不是谁都做一遍,而是让更擅长的一方在更合适的位置上发挥作用,再由整个流程把这些能力整合起来。说到底,不是"用了 AI 就更强",而是"把 AI 放对位置,人才会更强"。

边界

第一,它不适合把所有事情都交给 AI,更不适合把本该由自己承担的问题定义、价值判断和最终取舍一并外包。

第二,它也不意味着人必须处处介入;低质量干预,有时候比不干预更糟。

第三,这个模块不是一次性判断,而是一个动态校准过程。任务在变,AI 在变,人自己的能力也在变,所以分工机制也要不断调整,而不是定一次就永远不变。

五、最后

未来真正拉开人与人差距的,可能不是"有没有接触 AI",而是"能不能把 AI 放在它最该出现的位置"。

AI 不是天然的赋能器。它可以增强人,也可以干扰人;它可以成为能力外骨骼,也可能成为认知幻觉。决定结果的,往往不是工具本身,而是我们怎么理解任务、怎么识别强弱、怎么设计协作。

最后,我想留一个开放问题给你:在你最近使用 AI 的某个场景里,你明显感受到自己变强了。但那种"变强",到底只是相对原来的自己被增强了,还是你和 AI 真的已经形成了 1+1>2 的协同?

夜雨聆风

夜雨聆风