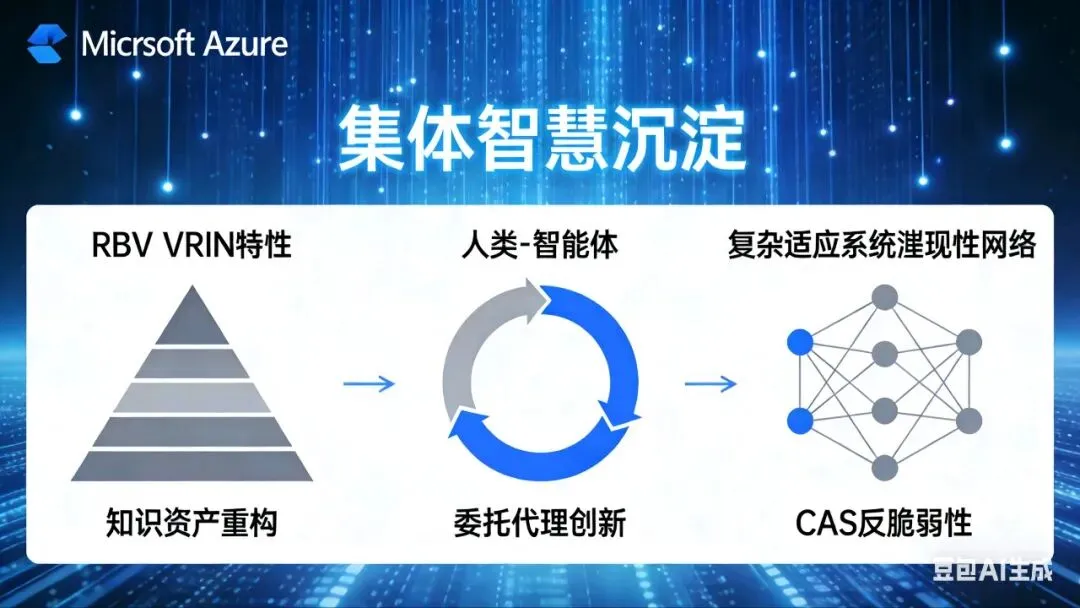

一、理论维度:AI驱动的组织范式重构

1. 资源基础观(RBV)的延伸

- 知识资产价值重构:纳德拉提出的"企业专属AI模型沉淀集体智慧",本质是将传统人力资本(如经验、直觉)转化为可编程的认知资产。这与Barney提出的VRIN特性(价值性、稀缺性、不可模仿性、组织性)形成呼应,AI模型通过持续学习将隐性知识显性化,形成新型护城河。

- 交易成本革命:AI代理(Agent)的普及大幅降低科斯定理中的"协调成本",企业边界从"市场-层级"二元结构转向"智能体协作网络"。微软将Azure定位为"AI劳动力基础设施",正是通过降低智能体交互成本重构商业生态。

2. 委托代理理论的创新应用

- 双向授权机制:传统委托代理关注所有者-管理者权责划分,而AI时代演变为"人类-智能体"动态授权。微软提出的"记忆-权限-行动"三要素框架,实质是构建新型契约关系,确保AI代理在组织目标约束下自主决策。

- 激励相容设计:通过LoRA权重分配(类似股权结构)实现模型层与应用层的利益绑定,避免通用模型"公地悲剧"。这与Holmstrom的契约理论中"非对称信息下的激励设计"形成理论共振。

3. 复杂适应系统(CAS)视角

- 涌现性组织形态:当数万AI代理在Azure平台上交互时,系统将自发形成超越人工设计的涌现模式。微软"任务控制中心"概念实质是构建CAS的观测-干预界面,通过动态调节参数引导系统向组织目标收敛。

- 反脆弱性构建:通过"基础模型主权+应用层开放"的组合策略,既保持核心能力(如企业知识图谱),又利用开源生态增强系统抗风险能力,符合Taleb提出的"反脆弱"原则。

二、实践维度:全球企业的AI转型路径

1. 制造业智能化标杆

- 西门子案例:通过AI驱动的数字孪生系统,将产品开发周期缩短30%。其"AI工厂"模式与微软"智能驾驶舱"理念相通,实现从数据采集(IoT传感器)到决策优化(强化学习)的闭环。

- 特斯拉实践:Dojo超级计算机与FSD算法的协同进化,验证了纳德拉"推理时计算创造新缩放定律"的论断。其影子模式(Shadow Mode)持续收集人类驾驶数据,形成独特的认知资产。

2. 服务业范式突破

- 高盛AI投研系统:整合NLP与知识图谱,分析师产能提升400%。其"智能体协作平台"允许不同模型(如估值模型、风险模型)动态组合,实现投资决策的群体智能。

- 亚马逊供应链优化:AI代理实时协调全球175个物流中心,库存周转率提高20%。通过"权限-行动"约束机制,确保各节点在安全边界内自主决策。

3. 公共部门创新应用

- 新加坡智慧国计划:政府AI代理处理85%的公民服务请求,通过联邦学习保护隐私。其"国家数字孪生"项目与微软"企业图谱"技术异曲同工,实现城市治理的动态优化。

- WHO疫情预测系统:整合多国医疗数据训练的AI模型,预测准确率较传统方法提升60%。验证了AI在跨组织协作中的价值创造能力。

三、全球议题:AI时代的文明重构

1. 数字经济新秩序

- 数据主权博弈:微软"主权AI"战略(如阿联酋本地化数据中心)反映全球数据治理的"数字巴尔干化"趋势。欧盟《人工智能法案》与美国的《算法问责法案》形成制度竞争,企业需构建"合规即服务"能力。

- 算力货币化:Azure的"每美元/瓦特Token产出"指标,预示算力将继石油成为新战略资源。萨尔瓦多采用比特币挖矿激励AI基建的模式,可能引发"算力殖民"争议。

2. 文明冲突与融合

- 文化模因战争:AI生成内容(AIGC)引发文化挪用争议,如Midjourney的"数字敦煌"项目遭质疑。需建立跨文化AI伦理框架,类似联合国教科文组织的《人工智能伦理建议书》。

- 认知殖民风险:英语主导的AI训练数据导致非西方语言边缘化。DeepL推出的多语言实时互译系统,通过迁移学习缓解语言霸权,值得借鉴。

3. 人类增强悖论

- 认知外包伦理:当律师90%工作时间被AI代理替代,如何定义"专业判断"?需参考《欧盟AI法案》对高风险AI的严格监管,建立人类决策的"不可约减性"原则。

- 技能贫困陷阱:全球57%劳动力面临AI技能断层,印度"数字印度"计划通过AI职业教育降低转型成本,提供可复制的解决方案。

四、未来演进:AI社会的制度设计

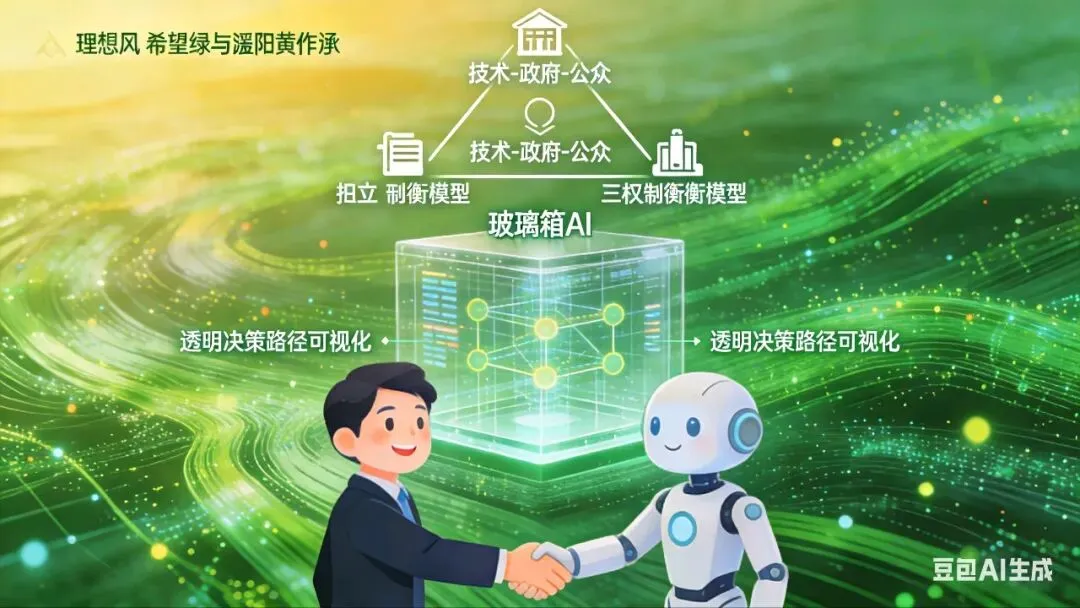

1. 新型治理架构

- 三权分立模型:建议构建"技术研发权(企业)-数据治理权(政府)-价值分配权(公众)"的制衡体系,避免技术寡头垄断。

- 动态监管沙盒:借鉴英国FCA的"监管即服务"模式,为AI创新提供风险可控的试验环境,如新加坡的"AI验证计划"。

2. 技术伦理框架

- 可解释性标准:推动"玻璃箱AI"(Glass-Box AI)认证,要求关键领域模型提供决策路径可视化,回应欧盟《数字服务法案》要求。

- 算法审计制度:建立第三方机构对AI系统进行持续监测,类似美国FDA对医疗AI的审批流程,防止"黑箱操作"。

3. 人类价值锚定

- 意义重塑工程:微软"学习型文化"转型提示,需将存在主义哲学融入AI设计。如荷兰"人生算法"项目,用AI辅助而非替代人类意义建构。

- 新工作伦理培育:针对"宏观指挥官"角色,开发"AI协作情商"课程,培养人类在人机混合团队中的领导力。

结语:站在文明断层的十字路口

纳德拉揭示的不仅是技术变革,更是人类文明范式的转换。当AI开始系统性地替代"信息处理者"角色,我们正从"人类中心主义"向"人机共生主义"跃迁。这个过程中,需要构建"技术创新-制度设计-价值重塑"的三位一体框架,确保AI进化始终服务于人类文明的整体进步。微软的实践为全球企业提供了可参考的路线图,但真正的挑战在于如何在全球多样性中找到最大公约数,避免技术乌托邦沦为数字利维坦。

夜雨聆风

夜雨聆风