AI是捷径,但捷径会伤人

听播客《The a16z Show - AI Won't Take Your Job》有感。

前两天看了一期a16z的播客,嘉宾是Balaji Srinivasan。

他说了两句话,让我倒回去听了三遍。

第一句:AI不会抢你的工作,它会让你成为CEO。

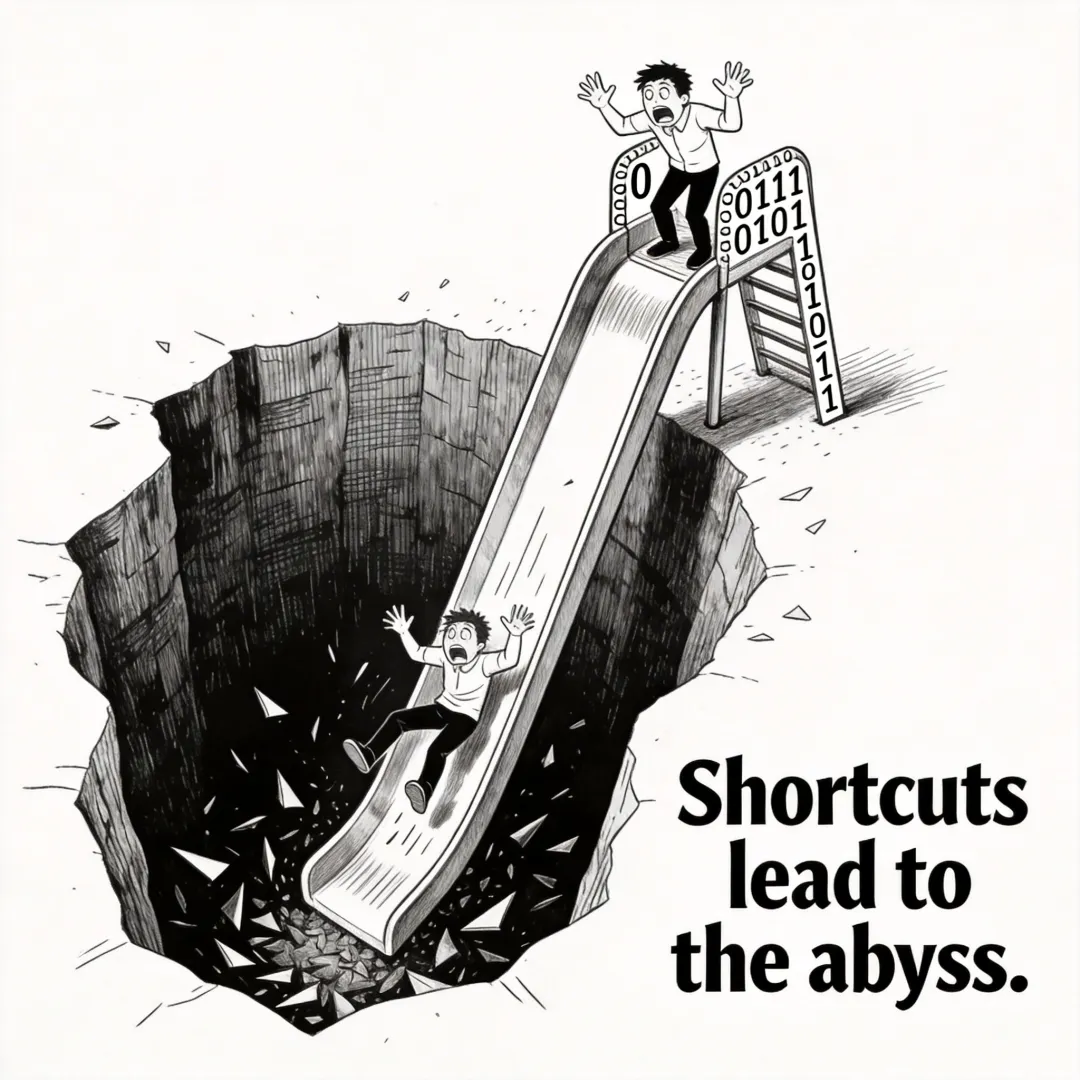

第二句:AI是一个捷径,但捷径会伤人。

问题出在哪

你说AI没用?但是:

Goldman Sachs说AI每个月替代16000个工作

90%的网络内容已经是AI slop

"Your AI Slop Bores Me"成了2026年网络热词

你说AI有用?但是:

随便一篇AI生成的PPT,你一眼就能看出来

就像有人用Windows默认桌面壁纸——一眼就能看出来

看完之后你想的不是"哇好厉害",而是这三个字:懒、蠢、坏

这就是AI最大的陷阱:它降低了创作的成本,但提高了验证的成本。

以前写一封求职信,你需要会背词汇、会写结构。现在AI能帮你写。但你反而需要花更大力气去验证——这封求职信到底是AI写的还是你自己写的?如果是AI写的,那真实的信息占比多少?

Shortcut的代价

Balaji说了一个公式:

你会背 e^(iπ) + 1 = 0,你可以说得很快。

但如果你让我从第一性原理证明它——

你知道什么是复指数,什么是复变函数吗?

你会的东西,AI是Shortcut。

你不会的东西,AI是悬崖。

捷径之所以是捷径,是因为你知道长路怎么走。

如果你不知道长路怎么走——你就只是在使用一个你不懂的东西。

你没办法debug它。

怎么用AI

正确的问法:

"我在做XX决策,我的考虑是A、B、C,AI帮我分析C这个角度对不对"

这叫带认知提问。

错误的问法:

"给我生成一篇AI行业分析报告"

这叫无脑提问。

区别在哪?

带认知提问:你是CEO,AI是打工的。

无脑提问:AI是CEO,你是打工的。

打工的能有什么深度?堆数据、整理信息、然后交差。

这就是为什么AI slop看起来都一个味:

永远正确的废话

永远安全的角度

永远没有立场的结论

因为它们没有被认知校验过。

什么时候用AI

AI擅长:图像、视频、代码审查、验证

你画一个图,AI马上告诉你手画错了。

你写一段代码,AI马上告诉你逻辑漏洞。

你做一个PPT,AI马上告诉你UX看起来很粗糙。

因为这些都可以用眼睛验证、用测试验证。

人类擅长:定义问题、选择方向、创造意义

AI不知道你想要什么。人的体感和真实经验代表的是什么。

AI不知道你这个决策背后10年的积累是什么。

AI更不知道——你到底想成为谁。

怎么问AI

不要问:

"AI行业趋势是什么"

"给我写一篇机器人洞察"

要问:

"我在考虑要不要All in AI硬件,我的担心是XXX,帮我看看我的逻辑有没有漏洞"

"我觉得AI现在的问题不是能力,是验证成本,我的判断对不对"

AI不是你的大脑,AI是你的放大镜。

放大镜只能放大你已有的认知,放不大你没有的东西。

如果你没有的东西完全依赖于AI,它剥夺了你思考的能力,会变得很恐怖。

下次问AI之前

先问自己三个问题:

我到底想知道什么?(不是"AI行业怎么样",是你具体困惑什么)

我的判断是什么?(先说你的观点,再让AI反驳你)

我会怎么验证?(你知道什么数据能推翻你的假设吗)

如果这三个问题你答不上来:

你不是在问AI,你是在问上帝。

上帝只会给你答案,不会帮你思考。

夜雨聆风

夜雨聆风