很多 AI 项目不是死在"做不出来",而是死在"你根本不知道它到底算不算做对了"。

大家看得很兴奋,也确实有理由兴奋。因为在很多场景里,AI 已经把"写出来"这件事,推进到了一个全新的速度。

可问题也恰恰出在这里。

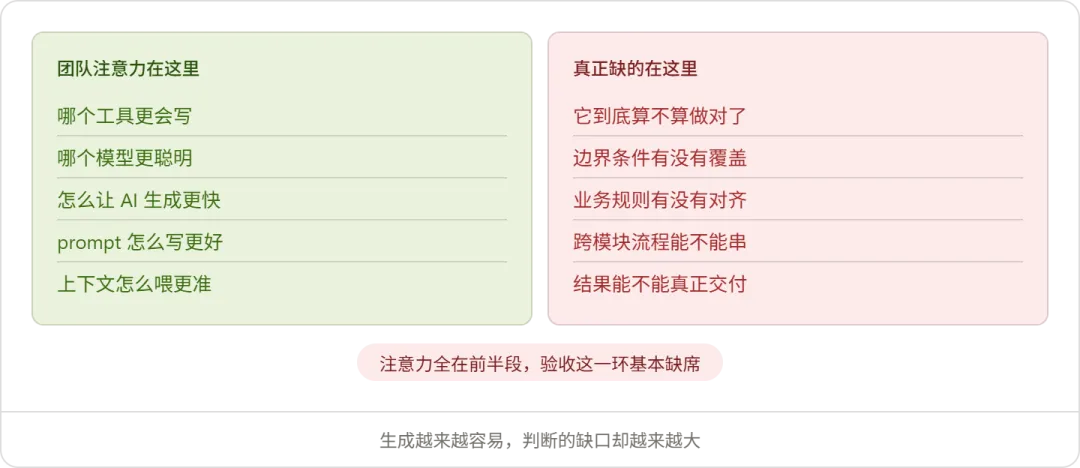

当"生成"变得越来越容易,很多团队会不自觉地把注意力全压到前半段,仿佛只要代码能吐出来,项目就已经向前走了。但真实情况常常不是这样——页面有了,接口通了,功能也能演示,可一旦进入真正要交付、要联调、要上线的时候,问题就开始像漏水一样,一处接一处地冒出来。

项目真正卡住的地方,是另一个更隐蔽、也更关键的问题:

你没有一套稳定的方法,去判断它到底算不算做对了。

01 | 过去最贵的是"实现",现在越来越贵的是"判断"

以前开发为什么慢?很大一部分原因,是实现成本高。你要手写页面,要手对接口,要补各种样板代码,很多事情卡在"做出来"本身。

但 AI 进来以后,很多实现成本正在被迅速压低。代码能更快生成,问题能更快定位,原型能更快出现。于是项目的重心,悄悄发生了转移:

难点正在从**"怎么把它做出来",转移到"怎么确认它真的做对了"**。

这一步,很多团队还没跟上。大家已经开始享受 AI 带来的生成快感,却还在用过去那种很粗糙、很依赖个人经验的方式做判断。

这就像厨房里突然来了一台速度极快的自动炒菜机。菜出得越来越快,可如果后厨没有出品标准、没有品控,最后端上桌的,依然可能是一盘看起来很热闹、吃起来却不稳的菜。生成越来越快,判断如果没升级,返工就一定会升级。

02 | 很多团队所谓的"验收",其实只是结果围观

这件事挺扎心,但很普遍。

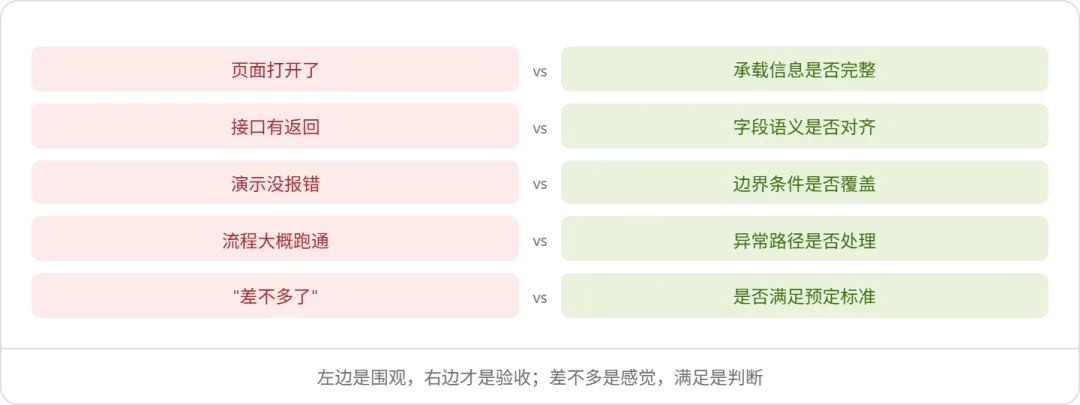

不少团队嘴上说自己也在验收,可真往里看,所谓的验收,很多时候只是围着结果看一圈——页面打开了,按钮能点,接口有返回,演示时没报错,截图发群里看着还行。于是大家就会说:"差不多了""先这样吧""能用了,后面再细调。"

听起来像在推进,实际上只是把判断往后拖。

因为真正的验收,不是"看起来差不多",而是"是否满足预先定义好的标准"。差不多是一种感觉,满足是一种判断。感觉适合快速浏览,判断才适合项目交付。

如果没有这一步,团队就会长期停留在一种特别危险的状态里:每一轮都觉得完成了,但每一轮都没有真正完成。结果就是,项目像搭积木时底板没扣紧,一层层往上叠的时候好像还挺快,可稍微一碰,就连着晃。

03 | 为什么 AI 开发尤其容易在验收上翻车?

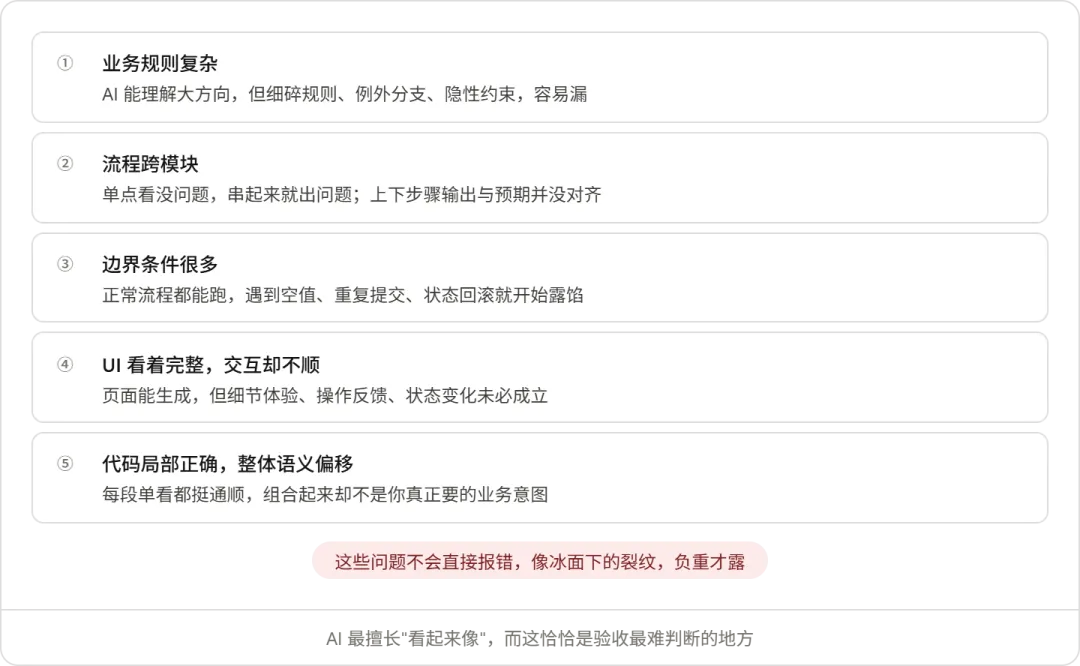

因为 AI 天生会把"看起来像"这件事做得很好。这是它厉害的地方,也是风险的来源。它很会生成一个看起来合理的页面,很会写一段看起来流畅的逻辑,很会补出一套看起来完整的函数。你第一眼看过去,常常会觉得:"挺像那么回事。"

可"像那么回事"和"真的对了",中间隔着一条很长的桥。

这些问题最麻烦的地方,在于它们不像语法报错那样会直接炸出来。它们更像冰面下的裂纹——你在上面走,前几步看不出什么,等真的负重压上去,才发现底下早就裂了。

所以 AI 开发越往后走,越需要的不是"再找个更会写的工具",而是"建立更会判断的体系"。

04 | 没有验收机制,AI 生成得越快,返工往往也越快

这句话可能最该被反复强调。

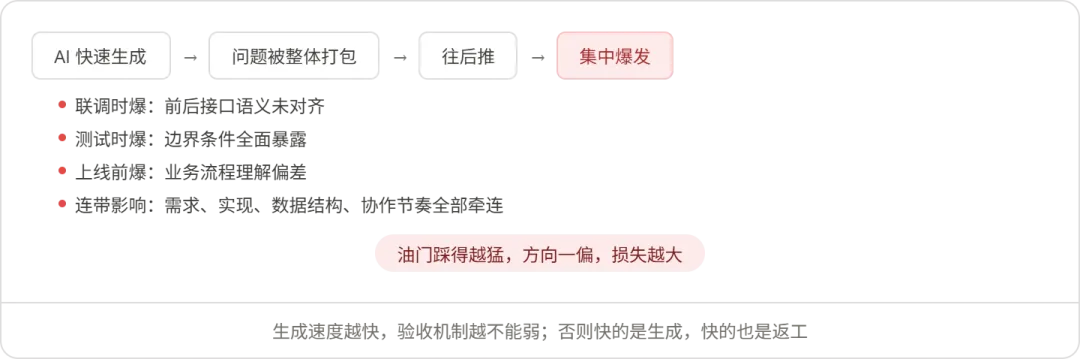

很多人以为,AI 的最大价值是减少工作量。这当然没错,但前提是结果可控。如果结果不可控,AI 带来的很可能不是纯收益,而是另一种形式的放大器——它会把对的东西更快做出来,也会把错的东西更快铺开。

原来人工写,慢归慢,但至少暴露问题的节奏也慢。现在 AI 一口气生成很多,问题不是消失了,而是被整体打包往后推——等到联调时爆,等到测试时爆,等到上线前爆。这时候返工的成本,往往已经不是改一小段代码那么简单了,它会连着影响需求理解、实现方式、数据结构、相关联的页面和接口。

就像用更快的机器缝衣服,针脚确实飞起来了,可如果版型本来就不准,最后返工不是拆一针,而是整块重裁。

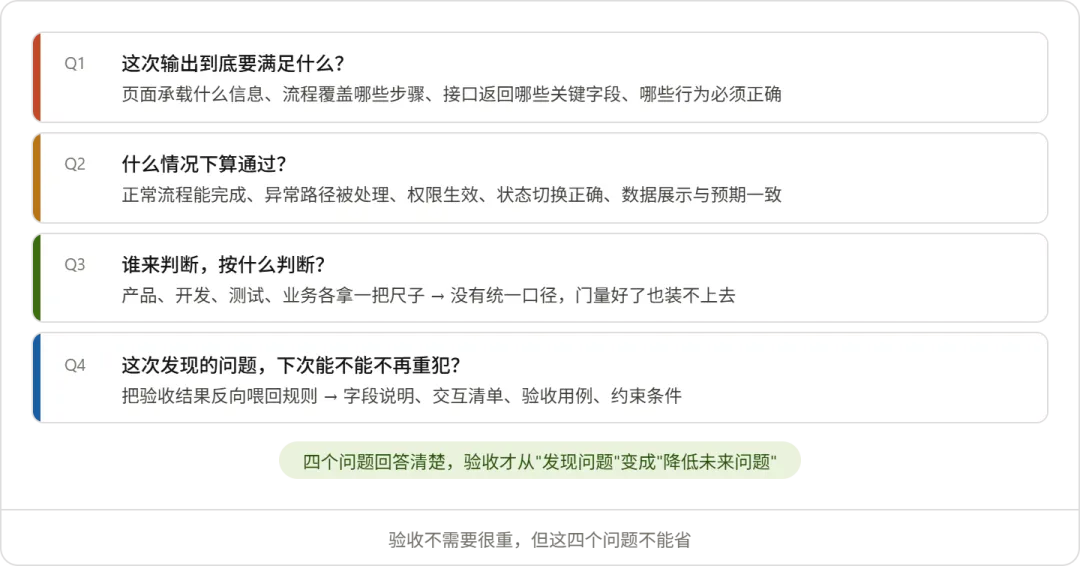

05 | 真实项目里,验收至少要回答这四个问题

很多人一听"验收",脑子里会冒出一种很重的感觉,好像必须是一套很复杂、很正式的流程。其实不一定。验收最核心的作用,是回答清楚四个非常朴素的问题。

第一,这次输出到底要满足什么。不是"做个差不多的页面",而是说清楚这个页面需要承载什么信息,哪些行为是必须正确的,哪些点这次可以先不做。没有这个前提,后面的判断就永远漂着。

第二,什么情况下算通过。很多团队的问题,不是没有看结果,而是没有定义"通过"的门槛。一个功能的验收,不该只是"我试了一下好像行",而应该更明确:正常流程能否完成、异常流程是否被处理、权限是否生效、状态切换是否正确。这就是把模糊满意,变成明确通过。

第三,谁来判断,按什么判断。产品按业务理解判断,开发按技术实现判断,测试按异常路径判断,老板按演示效果判断——四个人都不是错,但如果没有统一口径,就像四个人各拿一把尺子量同一扇门,有人说够高,有人说太窄,最后门就是装不上去。

第四,这次发现的问题,下次能不能不再重犯。真正成熟的验收,不只是在这一轮抓 bug,还要把这轮发现的问题,变成下次的规则——某类接口字段总被误解,就补字段说明模板;某类权限逻辑总漏,就补验收用例。这样验收才不是一次性的找茬,而是在给整个系统加骨架。

06 | AI 开发里的验收,不只是测试,更是前置设计

很多团队一说验收,就下意识把它等同于"开发做完之后,测试来测"。这当然是验收的一部分,但远远不够。

因为 AI 开发里,真正高价值的验收,不应该只出现在末尾。它更应该前置到一开始——在真正生成之前,就先想清楚:这次要验什么,用什么标准验,哪些点最容易错,哪些边界必须覆盖。

很多时候,AI 不是不知道怎么写,而是不知道你最在意哪部分不能错。你不给它边界,它就默认按"像答案"的方向扩展;你给出明确验收要求,它才更容易朝"可通过"的方向生成。

所以验收不是开发后半段的补丁,它更像开发前半段的导航。越早想清楚怎么验,后面越少陷入"写完了再看看哪不对"。

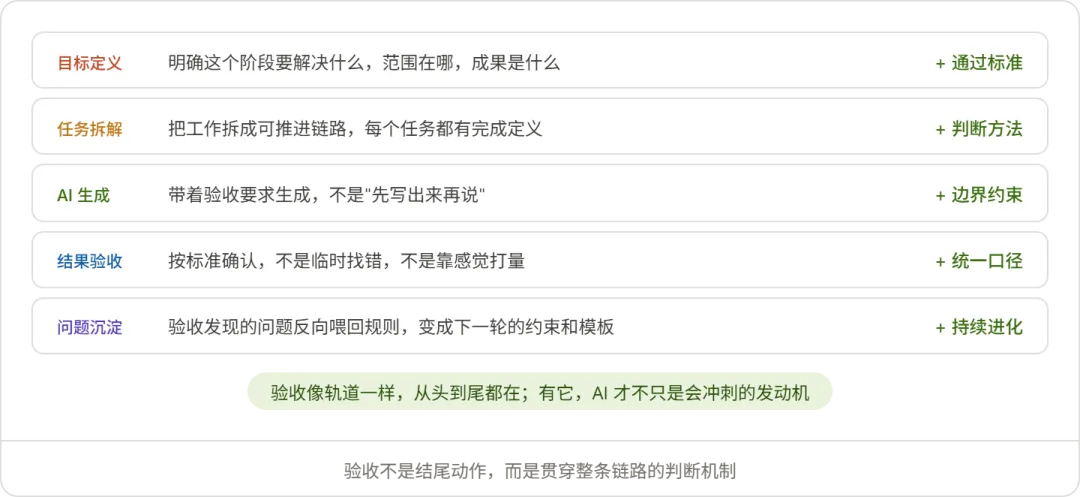

07 | 真正成熟的团队,是把验收接进了闭环

一个团队是否真正开始进入 AI 工程化阶段,有一个很明显的分水岭:不是看他们用了几个工具,也不是看他们生成了多少代码,而是看他们有没有把验收接进闭环。

什么叫接进闭环?不是出了问题再去补救,而是从一开始,验收就已经进入整条链路:目标定义时,就有通过标准;任务拆解时,就知道每步怎么判断;AI 生成时,就带着验收要求生成;测试阶段,不是临时找错,而是按标准确认;问题回收后,还会沉淀成下一轮的规则和用例。

这时候你会发现,验收不再只是一个结尾动作,它像轨道一样,从头到尾都在。有了这条轨道,AI 才不只是会冲刺的发动机;没有它,项目再热闹,也容易变成高配碰碰车。

那到底该怎么补"验收"这一层?

不用一上来就搞得特别重。很多团队真正需要的,不是一下子上完整体系,而是先把最基本的判断力补起来。

每个任务都补一句"完成标准"。别只写"做一个 XX 功能",最好顺手补一句:这个任务完成,至少应该满足什么。哪怕只有三五条,也比完全靠感觉强很多。

把高频错误整理成检查清单。总是漏权限,就把权限列进清单;总是漏异常态,就把异常态列进清单。清单不是土办法,清单是把经验从脑子里拽出来的办法。

区分"能演示"和"能交付"。很多 AI 项目最大的问题,是把 Demo 标准当成交付标准。能演示,只说明大方向出来了;能交付,才说明结果经得住真实场景。这两者一定要分开看。

让验收问题反向喂回规则。验收不是终点,它应该反向影响下一轮生成。哪里总错,就把哪里写进规则;哪类任务总漂,就把那类任务模板化。这样验收才不是"发现问题",而是"降低未来问题"。

写在最后

今天很多人讨论 AI 开发,最容易把视线钉在"生成"上。这很正常,生成确实是最显眼、最能带来快感、也最容易被演示出来的一部分。

但真正决定一个项目能不能走远的,往往不是那一刻生成得有多漂亮,而是它后面能不能被稳定地判断、校准、修正和复用。

很多 AI 项目不是死在不会写,而是死在没人真正说得清——它到底算不算写对了。

没有验收,生成越快,返工可能越快。没有验收,页面越漂亮,风险可能越隐蔽。没有验收,团队越忙,项目越可能只是在原地打转。

只有当"会生成"变成"可验收",AI Coding 才真正开始从热闹,走向生产力。

夜雨聆风

夜雨聆风