很多团队的问题,不是没人会用 AI,而是每个人都在和自己的 AI 单线作战,最后谁都没把项目真正推起来。

今天很多团队都已经开始用 AI 了。有人拿它写代码,有人拿它补文档,有人拿它拆需求,有人甚至已经把它接进了日常开发、测试、设计、运营流程里。

表面看,这当然是好事。说明大家已经不再把 AI 当成一个新鲜玩具,而是开始把它当成工作的一部分。

可真正进入团队协作后,很多问题也会很快冒出来——每个人都在用,每个人也都觉得自己效率提高了,但项目整体并没有想象中那样顺。有时候甚至会出现一种很奇怪的局面:

个人都挺忙,团队却不够稳。局部都挺快,整体却不够顺。每个人都在和 AI 高强度协作,项目却还是容易漂、容易乱、容易返工。

为什么?

因为很多团队虽然"开始用了 AI",但还没有真正进入"团队 AI 开发"的阶段。说得更直白一点:

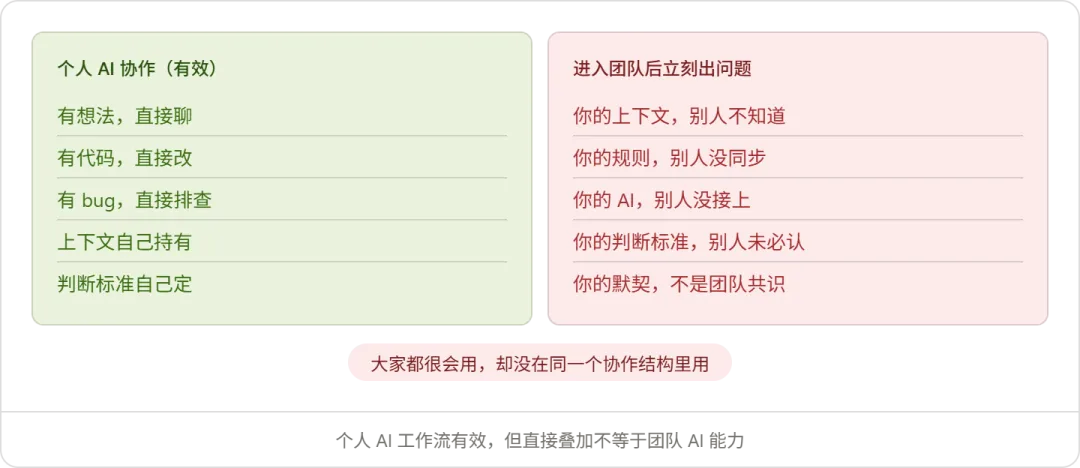

不是大家都在用 AI,就等于团队已经具备了 AI 协作能力。

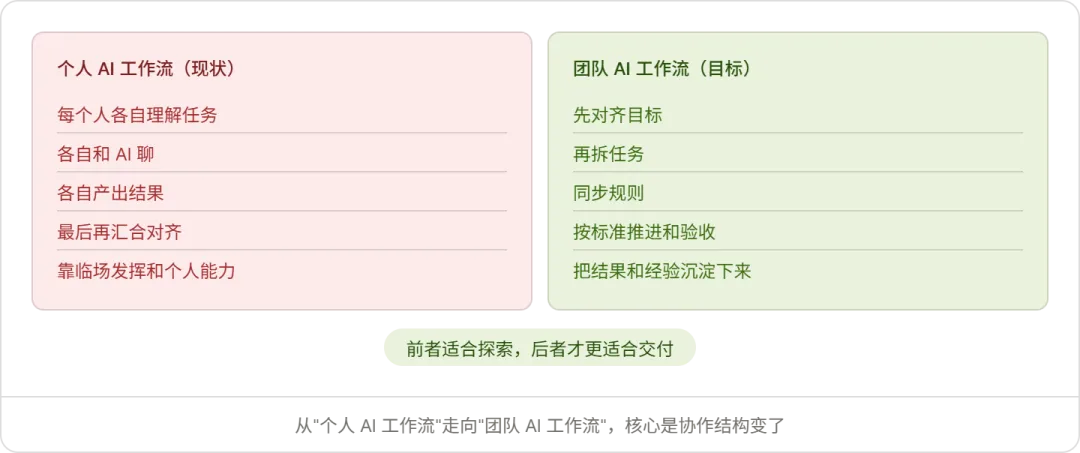

很多时候,团队只是从"每个人各自写代码",变成了"每个人各自和 AI 私聊"。工具变了,协作底层却没变。

为什么"大家都在用 AI",不等于"团队已经会用 AI"

这件事特别值得单独讲清楚。

A 用 AI 生成了一版方案,觉得很合理;B 接过来一看,发现边界完全不是自己理解的;C 再接着改,又按自己的上下文走了一轮;D 最后测试时,发现前面三个人虽然都和 AI 聊了很多,但没有人在同一条链上。

看起来每个人都更高效了,实际上,协作成本可能反而更高了。

这就像一个乐队里,每个人都配了一台很高级的智能节拍器。单独练习都挺准,可真正合奏时,如果大家听的不是同一个节拍,场面还是会散。

所以团队 AI 开发最怕的,不是没人会用 AI,而是大家都很会用,却没有在同一个协作结构里用。

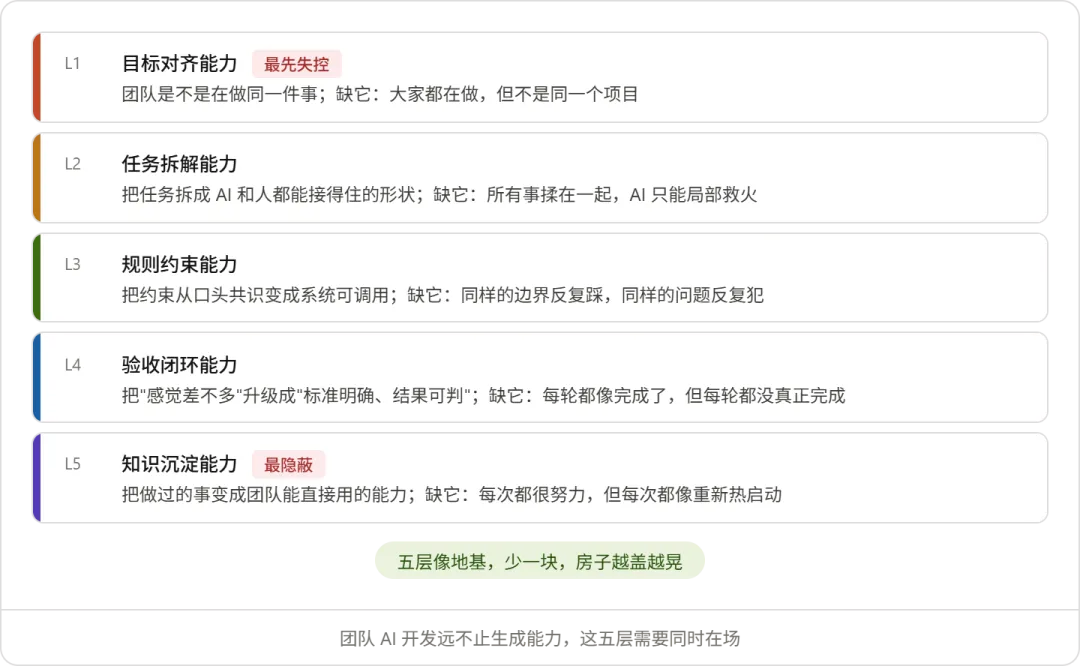

团队 AI 开发,要补的 5 层能力

真正的分水岭,不在于团队有没有接入 AI,而在于团队有没有补齐一套新的协作能力。

01 | 第一层:目标对齐能力

很多团队一上来就先关注工具——谁用 Cursor,谁用 Claude Code,谁负责知识库,谁负责 Prompt。这些当然重要,但如果只盯着工具,很容易忽略最根的问题:

团队是不是在做同一件事?

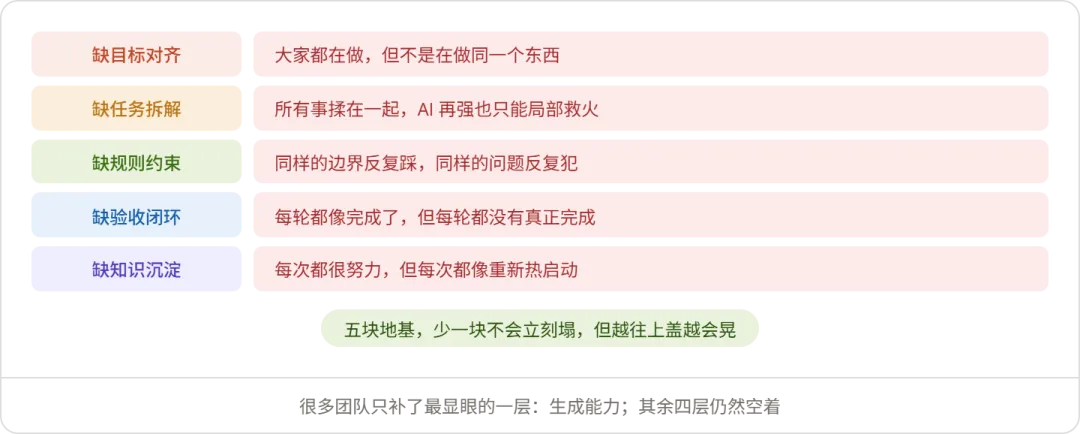

很多项目之所以进入团队后开始发散,不是工具不够统一,而是目标本来就没真正对齐。大家都在说"先做 MVP",但有人理解成"能演示就行",有人理解成"主流程能交付",还有人理解成"把未来扩展性先留好"。四个人都没说错,但四个人脑子里的项目,其实不是同一个项目。

这时候 AI 一介入,问题会被放大得更快——AI 会沿着每个人自己的理解,高速生成各自那条分支,本来还藏在水下的理解偏差,会更早浮上来。

所以第一层能力不是"谁更会写提示词",而是**"团队能不能把目标说成同一种语言"**。至少要先回答清楚:这个阶段到底要完成什么?范围到哪,边界在哪?当前更重视速度还是稳定?这轮成功的标准是什么?

如果这些都没有先对齐,团队里的每个人就像拿着不同地图,各自带着 AI 往前冲——冲得越快,偏得越快。

02 | 第二层:任务拆解能力

目标对齐之后,接下来最容易出问题的,就是任务拆解。

很多团队的问题不是没方向,而是方向一旦进入执行,就又重新塌成一团。大家太容易把 AI 当成全能执行体,然后把很多复杂事项揉成一句很大的话:"把这个模块做出来""顺便把样式也优化一下""接口和权限一起处理掉"。

对个人来说,可能还能边聊边改。对团队来说,这种做法特别容易失控——没有拆开的任务,就没有清晰边界;没有清晰边界,就没有明确交接;没有明确交接,AI 再能干,也只能在一团毛线里帮你拽线头。

真正成熟的团队 AI 开发,一定会把任务分清楚:哪些是探索型任务,哪些是确定性交付任务;哪些适合 AI 先跑一轮,哪些必须人工确认后才能继续;哪些结果要进入评审,哪些只是内部草稿。

任务一旦拆开,团队和 AI 的协作关系才会变清楚。否则整个项目就像一锅翻滚的火锅——所有东西都在里面,看着很热闹,但你真要夹一块完整的、可交接的内容出来,就会发现很难。

03 | 第三层:规则约束能力

这是团队 AI 开发里特别关键、也特别容易被低估的一层。

个人和 AI 协作时,很多规则可以放在脑子里——你知道这个项目不能乱改哪里,你知道哪个接口字段不能猜,你和 AI 聊着聊着会自动补这些背景。但团队不是一个脑子。

一个人知道,不等于团队知道;团队知道,不等于系统知道;系统不知道,AI 每次就还得重新猜。于是你会发现,很多团队项目里最烦人的问题并不高级,反而很朴素:同样的边界被反复踩,同样的错误被反复犯,同样的规则每来一个新成员都要重新讲一遍。

真正的团队 AI 开发,一定要把关键约束从"口头共识"变成"系统可调用"——哪些开发规范是强制的,哪些业务逻辑必须严格对齐,哪些任务必须带验收条件,哪些情况下不能直接依赖 AI 结果。

这不是形式主义,而是在给团队装护栏。没有护栏,AI 每次都会像第一次进入现场;有了护栏,AI 才不会总是从"最像答案"的方向胡乱延伸。

04 | 第四层:验收闭环能力

这一层,决定团队 AI 开发到底是"热闹",还是"靠谱"。

团队里最容易发生的一种事,就是:每个人都觉得自己做完了,可最后谁也说不清到底有没有真的做对。开发说逻辑通了,产品说体验不对,测试说边界没覆盖,业务说流程理解偏了——如果没有统一的验收闭环,团队就会长期停留在一种半完成状态里:做出来了,但不敢交;改过了,但不敢认;演示能跑,但一上线就心里发虚。

这时候团队最需要补的,不是再找一个更会写代码的工具,而是把"结果怎么判断"这件事前置清楚:每个关键任务有完成标准,团队对"通过"有共同口径,AI 输出不只看表面、而是按标准检查,验收发现的问题能回流到规则和任务模板里。

说白了就是:把"感觉差不多"升级成"标准明确、结果可判"。只有这样,团队协作才会稳下来。

05 | 第五层:知识沉淀能力

这层能力,决定团队是"每次都很努力",还是"越做越轻"。

很多团队做 AI 开发时,最容易出现一种错觉:这轮大家已经聊了很多,踩了很多坑,下次应该会顺很多吧?结果并没有。因为真正值钱的东西往往没有留下来——讨论过的决策没有沉,踩过的坑没有沉,已经验证有效的任务拆法没有沉,验收发现的共性问题没有沉。

于是团队就会进入一种非常熟悉的循环:这次讲明白了,下次还得再讲;这次踩过坑了,下次还会再踩;这次试出一个有效做法,过一阵又像没发生过一样。这不是因为团队不努力,而是因为努力没有变成组织记忆。

真正成熟的团队 AI 开发,一定会把这些内容持续沉下来:关键决策、规则边界、提示词基线、常见任务模板、验收清单、典型问题及处理方法。一旦这些东西开始积累,团队就会慢慢长出一种很明显的变化——不是每个人都更累,而是下一个任务会变轻。这才是真正的升级。

这五层能力,缺一层会怎样

很多团队今天的问题,不是没有 AI,而是只补了最显眼的一层——生成能力。可真正的团队 AI 开发,更像一辆列车:AI 是动力系统,当然重要,但轨道、调度、站点、信号灯、检修系统,也得同时在场。不然列车就算马力再猛,也只能在站台边轰轰作响。

从"各自和 AI 私聊",走向"可协作 AI 开发"

真正的变化,不是大家统一换一个工具,也不是强行规定只能用某个模型。更关键的变化,是团队协作方式本身变了。

前者靠个人能力和临场发挥,后者开始依赖协作结构和组织能力。前者适合探索,后者才更适合交付。

团队该怎么开始补这 5 层能力

不用一上来就大动干戈。很多团队真正该做的,不是先铺一个巨大体系,而是先把最关键的骨架立起来。

每个项目先统一一页目标说明。别一上来就直接开工,先把阶段目标、范围、边界、成功标准说清楚。

把任务从"大句子"改成"可交接小块"。一件事越能拆清楚,团队和 AI 就越能协同发力。

把高频规则整理成团队共用基线。不要让规则永远漂在聊天记录和个人脑子里。

给关键任务补完成标准。别只写"做一个功能",最好写清"做到什么程度算通过"。

每轮结束后,强制回收一批经验。哪怕只是三条规则、两条检查项、一个任务模板,也比什么都不留强得多。

这些动作看起来不花哨,但它们很像在项目地面上铺轨。轨铺出来了,AI 才不是到处乱窜的高性能摩托,它才会慢慢变成能带着团队稳定前进的列车。

写在最后

今天很多团队都已经意识到,AI 不只是一个新工具,而是一种新的工作方式。这一步很重要,但只做到这里,还不够。

因为真正决定团队能不能把 AI 用起来的,不是每个人会不会和 AI 聊,而是团队有没有把这种能力组织起来。

别再各自和 AI 私聊了。

个人效率当然重要,但团队真正需要的,是一套能让目标对齐、任务拆开、规则清楚、结果可验、经验能留的协作结构。当这五层能力慢慢补齐之后,AI 不再只是帮某个人更快,而是开始让整个团队更稳。

这时候,团队 AI 开发才算真正从"热闹尝鲜"走向"可协作落地"。

夜雨聆风

夜雨聆风