导语:谁还在说AI是“面瘫工具人”?

你有没有过这种体验?

用AI生成的视频,人物要么表情僵硬像“蜡像”,要么口型对不上像“念错台词”;想和AI实时聊两句,它卡成PPT;要是聊久了,直接“面目全非”,刚才的帅哥秒变路人甲。

这不是你操作有问题——这是过去两年AI视频行业的集体“痛点”:表现力、实时性、长期一致性,三者永远无法同时达标,像三座大山压得所有产品喘不过气。

直到2026年4月11日,米哈游蔡浩宇的AI公司Anuttacon,甩出了LPM 1.0。

当我看完官网的demo:AI小哥16秒切换N种情绪,连挑眉、抿嘴的微表情都精准踩点;对着电脑说“我要你演一个不耐烦的上班族”,屏幕里的AI立刻皱起眉头、扶额叹气;甚至连22分钟的长视频对话,人物从发型到眼神全程没“崩”——我瞬间明白:

AI视频的“天花板”,被米哈游掀翻了。

一、从“面瘫AI”到“赛博戏精”,LPM 1.0到底炸在哪?

1.1 三大核心能力,直接戳中AI视频的“命门”

对AI视频产品来说,有三个“终极考题”:

能不能演得像人?(表现力)

能不能实时互动?(低延迟)

能不能聊很久还不“崩”?(长期一致性)

过去的产品,要么顾此失彼,要么全是“半吊子”:

Runway Gen-2能生成风格化视频,但实时交互想都别想;

Pika的人物一致性有进步,但微表情还是像“读课文”;

Character.AI的实时聊天够快,但视频表情永远是“标准微笑脸”。

而LPM 1.0,直接把这三个题全答对了。

1.1.1 超绝情绪演绎:AI连“呼吸节奏”都学会了

你见过AI演“戏精”吗?

LPM 1.0的demo里,有个小哥16秒内切换了犹豫、愤怒、无奈三种情绪:从抿嘴皱眉的迟疑,到咬牙切齿的爆发,再到叹气低头的释然——连呼吸的起伏、嘴角的抽动,都和真人一模一样。

更狠的是“倾听模式”:当你对着AI说话时,它不用开口,光靠眼神、挑眉、皱眉的微表情,就能让你觉得“它真的在听”。

比如那个接孩子电话的AI女性:听到孩子声音时,先是眼睛微微睁大(意外),紧接着眉头收紧(担忧),手指不自觉攥紧衣角——这哪里是AI?分明是个演技在线的“老戏骨”。

1.1.2 实时互动:说一句话,AI立刻给你“演”出来

以前和AI视频聊天,你得等它生成半天,聊两句就卡成PPT,完全没有“对话感”。

但LPM 1.0不一样:你对着屏幕说“来唱首歌”,AI立刻张嘴开唱,口型、表情同步跟上;你说“做个自我介绍”,它马上露出微笑,开始说话——延迟低到几乎和真人对话没区别。

这背后的秘密,是Anuttacon专门做的因果式流生成器:不用等整个视频生成完,而是像真人说话一样,“边想边说边演”,把延迟压缩到了毫秒级。

1.1.3 长期稳定:聊48分钟,AI还是同一个人

最让人震惊的是“长视频能力”:LPM 1.0能生成48分钟的连续对话视频,人物的发型、五官、表情风格,全程没变化。

要知道,普通AI视频生成10分钟以上,人物大概率会“变脸”:要么眼睛歪了,要么发型变了,甚至直接变成另一个人。

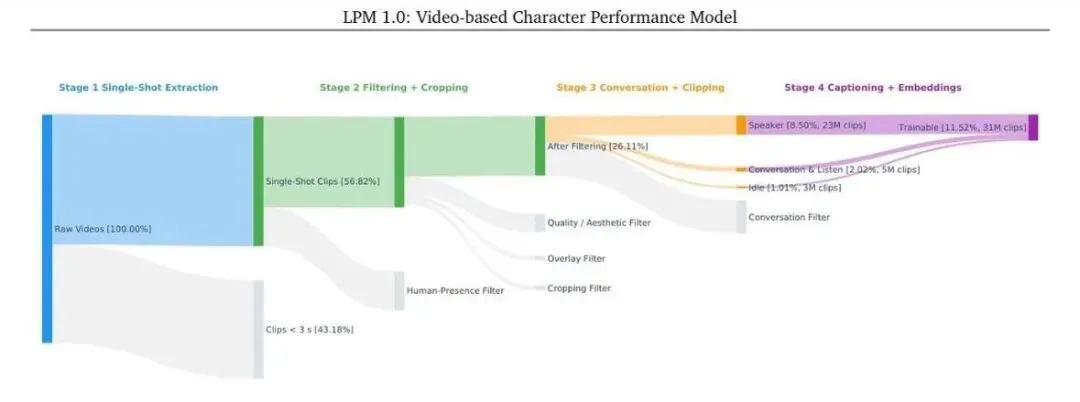

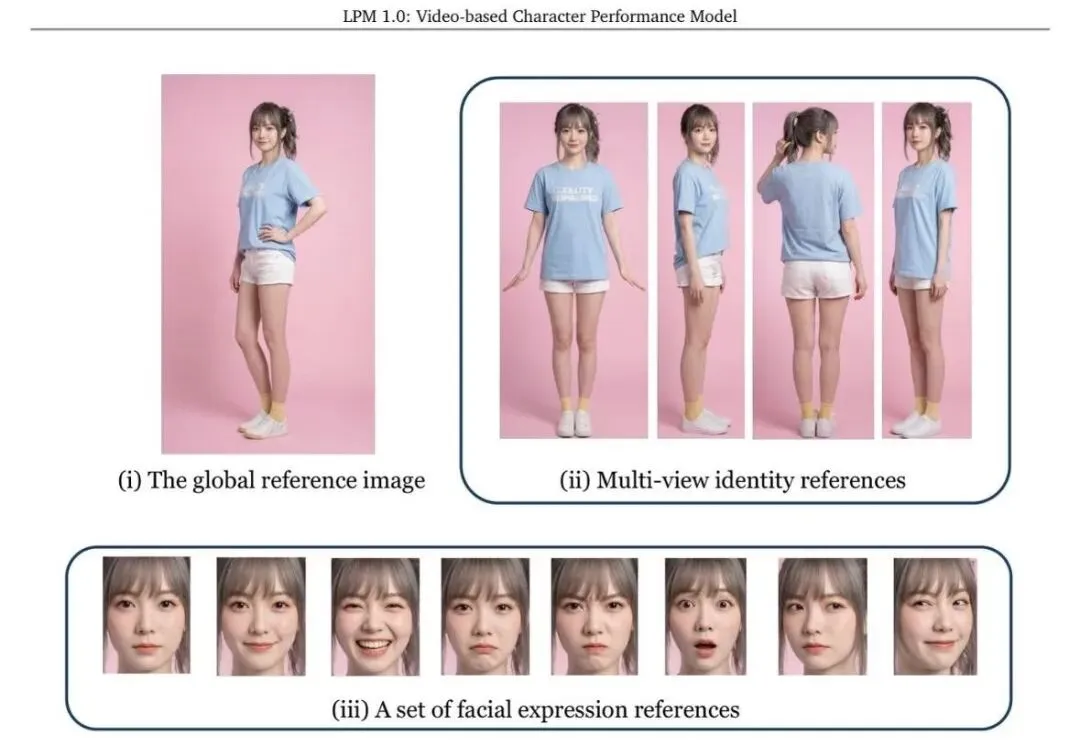

而LPM 1.0靠的是“以人为中心的多模态数据集”——团队收集了海量真人的表情、动作、对话数据,让AI记住“这个人应该是什么样”,哪怕聊到天荒地老,也不会“人设崩塌”。

1.2 网友炸了:“实时、无限长度的AI角色,终于来了!”

LPM 1.0的demo刚曝光,X上的网友直接“坐不住”:

“这要是用来做虚拟主播,直接把真人主播秒了!”

“米哈游的NPC终于能‘活’过来了!以后原神里的NPC再也不是只会说固定台词的工具人了!”

“以后拍电影,配角直接用AI生成,成本能降一半!”

有人甚至调侃:“以后甲方爸爸要改需求,直接对着AI说‘把表情改成愤怒’,AI立刻给你重做,再也不用等后期渲染3天了!”

二、为什么是米哈游?蔡浩宇的AI布局藏着什么野心?

很多人好奇:米哈游不是做游戏的吗?怎么突然搞出这么牛的AI视频模型?

其实,米哈游的AI布局,早就在“偷偷憋大招”。

2.1 从游戏到AI:米哈游的“技术护城河”

米哈游的核心,从来不是“做游戏”,而是“做数字内容”——不管是原神、崩坏,还是现在的AI,本质都是“用技术创造有沉浸感的数字世界”。

游戏里的NPC,本来就需要“像人一样互动”:玩家和NPC对话,NPC要有表情、有动作、有情绪反馈。但过去的NPC都是“预制脚本”,玩家说什么,它都只会那几句固定台词。

而LPM 1.0,就是为了解决这个问题:以后米哈游的游戏里,NPC不再是“工具人”,而是能和玩家实时聊天、互动、甚至“飙戏”的“数字人”。

比如你在原神里和钟离对话,你说“我今天打深渊输了”,钟离会皱起眉头,安慰你“下次再来,我相信你”——这种沉浸感,是以前的游戏根本做不到的。

2.2 Anuttacon的底牌:170亿参数+“懂表演”的数据集

LPM 1.0的技术团队,来头也不小:

披露模型的Ailing Zeng博士,之前在腾讯混元、IDEA研究院做过大模型研究;

整个论文有20+位研究员参与,其中不少是来自AI视频领域的顶尖专家。

而LPM 1.0的核心,是两个“杀招”:

2.2.1 170亿参数的扩散Transformer

普通的AI视频模型,大多用的是“U-Net”架构,擅长处理静态图像,但对视频的“时间连续性”(比如动作、表情的衔接)处理不好。

而LPM 1.0用的是170亿参数的扩散Transformer,专门擅长处理视频里的“空间+时间”关联:它能记住上一帧的表情、动作,然后生成下一帧的内容——所以AI的动作才会这么自然,不会出现“跳帧”“变脸”的问题。

2.2.2 把“表演课”塞进AI的数据集里

普通AI视频模型的数据集,大多是“随便找的视频”,AI学的是“怎么生成画面”,而不是“怎么演”。

但Anuttacon的数据集,是“以人为中心”的表演数据集:他们收集了大量演员的表演视频、真人的日常对话视频,甚至加入了“表演理论”的标注——比如“惊讶时眼睛会睁大,呼吸会变快”“愤怒时嘴角会向下,眉头会皱紧”。

说白了,LPM 1.0不是在“学生成视频”,而是在“学怎么当演员”。

三、LPM 1.0之后,AI视频的下一站是“数字分身”?

LPM 1.0的出现,不止是“AI视频的进步”,更是“数字人时代的敲门砖”。

它的应用场景,已经远远超出了游戏:

3.1 游戏:NPC终于能“活”过来

对米哈游来说,LPM 1.0最大的用处,就是让游戏里的NPC“活”起来。

以后你玩原神,和派蒙聊天时,派蒙会根据你的话做出不同的表情:你说“我饿了”,它会歪头笑;你说“打不过BOSS”,它会皱眉头安慰你。

甚至,你可以和NPC“自由对话”:不用再按固定选项,直接说“带我去找宝箱”,NPC会一边点头一边给你带路,还会吐槽“你怎么又找宝箱”——这种沉浸感,是以前的游戏根本做不到的。

3.2 虚拟主播:告别“预制脚本”,实时接梗不是梦

现在的虚拟主播,大多是“动捕+预制表情”:主播在后台做动作,AI同步表情,遇到观众的弹幕,只能靠人工提前写好的脚本回应。

但LPM 1.0能让虚拟主播“实时接梗”:观众发弹幕“主播唱首歌”,AI立刻开唱;观众发“主播学猫叫”,AI立刻做出猫的表情——完全不用人工干预。

以后的虚拟主播,可能根本不需要真人“中之人”,AI自己就能当主播,24小时直播,还能和观众实时互动。

3.3 影视/广告:低成本生成“数字演员”

现在拍电影,找一个配角可能要几万块,后期渲染还要花几天时间。但用LPM 1.0,你只需要输入“一个30岁的男性,表情愤怒,说‘我不同意’”,AI就能立刻生成视频,成本几乎为零。

甚至,你可以让AI演“主角”:比如拍一部科幻片,里面的外星人、机器人,都可以用LPM 1.0生成,表情、动作比真人还自然。

3.4 客服/教育:有温度的AI交互

现在的AI客服,要么是文字回复,要么是“标准微笑脸”的视频,完全没有“温度”。

但LPM 1.0的AI客服,会根据你的语气做出不同的表情:你说“我要投诉”,它会皱眉头道歉;你说“谢谢”,它会微笑说“不客气”——这种有温度的交互,能让用户的体验提升10倍。

在教育领域,LPM 1.0能生成“AI老师”:老师会根据学生的反应调整表情,比如学生答错了,老师会皱眉头说“再想想”;学生答对了,老师会微笑说“真棒”——比现在的在线教育平台,更像“真人老师”。

结语:AI的终极形态,是“有灵魂的数字人”

LPM 1.0的出现,让我们看到了AI视频的终极方向:不是“生成视频”,而是“创造有灵魂的数字人”。

以前的AI,是“工具”:你让它生成什么,它就生成什么,没有“情绪”,没有“思想”。

但以后的AI,会是“伙伴”:它能听你说话,能和你互动,能理解你的情绪——甚至,它会有自己的“性格”。

米哈游的蔡浩宇曾说:“我们要创造一个‘超越现实的虚拟世界’。”而LPM 1.0,就是这个世界的“钥匙”。

当AI能像人一样“演”、一样“聊”、一样“活”时,我们的生活,会变成什么样?

是游戏里的NPC能和你成为朋友?是虚拟主播能陪你聊天到深夜?还是数字分身能替你去上班?

不管答案是什么,有一点可以肯定:

AI的“戏精”时代,已经来了。

而我们,都是这场变革的见证者。

夜雨聆风

夜雨聆风