在机器人领域,让机器学会“拿捏”柔软的物体——比如叠一件T恤、翻一个毛巾,一直是个让人头疼的难题。相比于硬邦邦的刚体,柔性物体(Deformable Objects)的形状随动而变,接触关系极其复杂。虽然现在的视觉语言动作模型(Vision-Language-Action, VLA)在刚体操作上已经玩得很溜,但在面对“软绵绵”的挑战时,往往因为缺乏高质量的训练数据而显得力不从心。

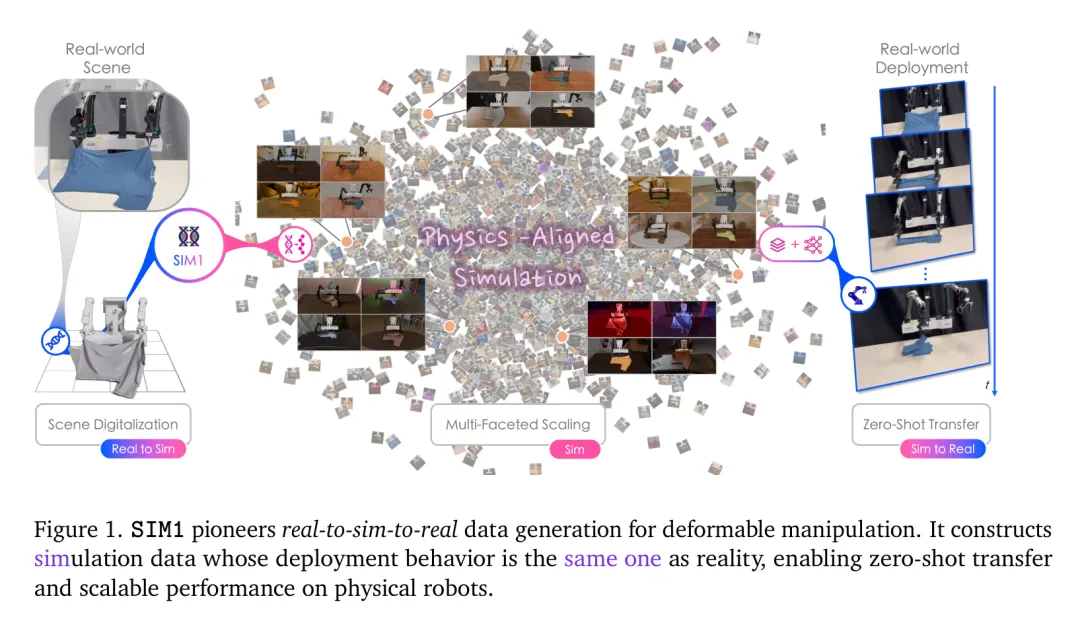

最近,来自上海人工智能实验室(Shanghai AI Lab)、复旦大学、上海交通大学和北京大学的研究团队提出了一项非常有意思的研究:SIM1。作者们的核心思路:既然现实中采集数据太贵太慢,那我们就去仿真里“造”数据。但传统的仿真往往“不接地气”,甚至仿真里的衣服像橡皮筋一样乱飞。SIM1 通过一套名为“真实到仿真再到真实(Real-to-Sim-to-Real, R2S2R)”的闭环流程,把仿真器变成了高精度的“数据放大器”。

论文地址: https://arxiv.org/abs/2604.08544 项目主页: https://internrobotics.github.io/sim1.github.io/ 代码仓库: https://github.com/InternRobotics/SIM1(已开源)

为什么折叠衣服这么难?

在聊 SIM1 之前,我们先得看看之前的方案卡在哪了。

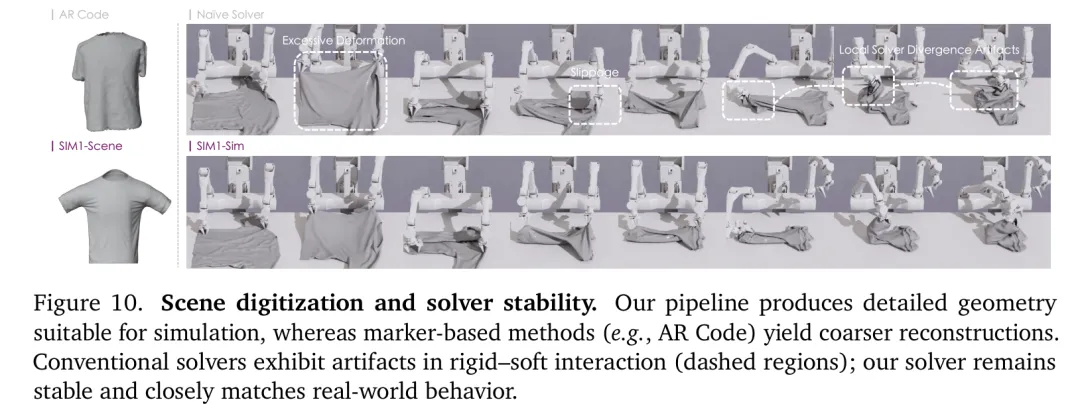

以往的仿真到现实(Sim-to-Real, S2R)迁移,在处理刚体时效果不错,但在处理布料时会遇到三个“大坑”:首先是几何不匹配,仿真里的衣服模型往往是随手画的,和现实中的尺寸、纹理对不上;其次是动力学脆弱,物理引擎大多是为刚体优化的,模拟布料时经常出现过度拉伸、穿模或者不自然的抖动;最后是动作基元太简单,简单的“抓取-放置”根本搞不定复杂的折叠动作。

研究团队认为,仿真之所以失败,不是因为它“假”,而是因为它没有“接地(Grounding)”。如果仿真里的物理规律和现实不一致,那生成的成千上万条数据也不过是“雾里看花”。

SIM1 的三步走:从物理对齐到数据爆发

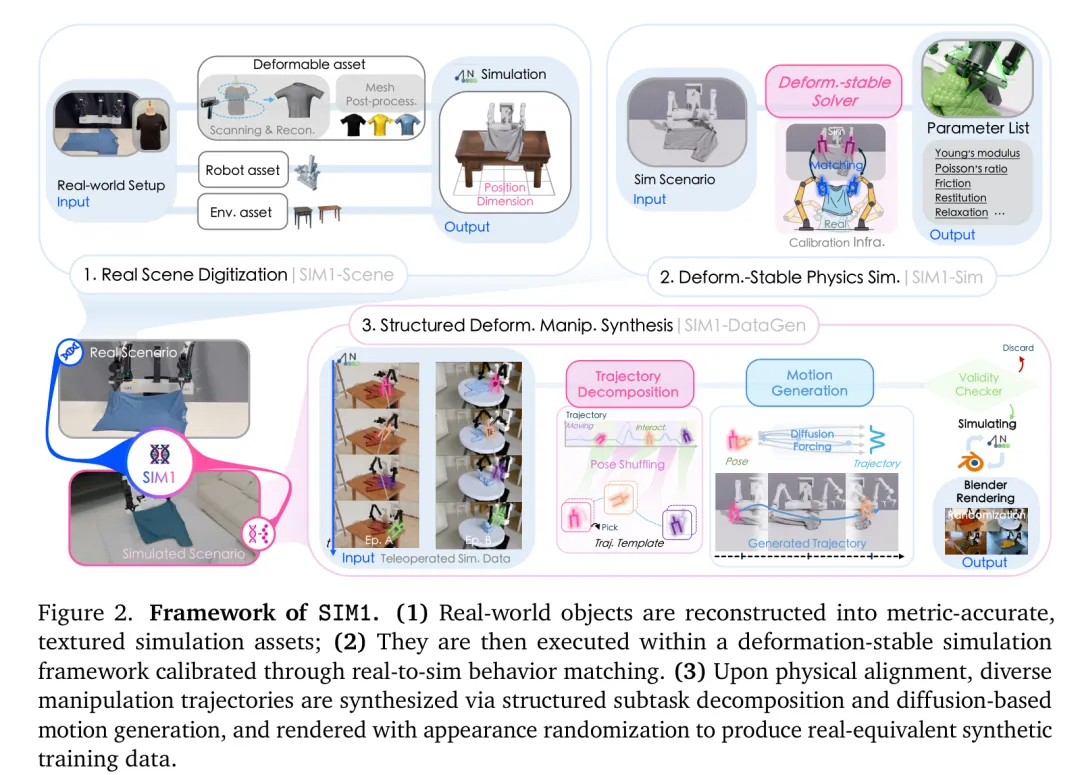

为了解决这些问题,SIM1 构建了一个由三部分组成的严密框架,分别是场景数字化(SIM1-Scene)、物理仿真对齐(SIM1-Sim)和结构化数据生成(SIM1-DataGen)。

1. SIM1-Scene:给衣服做个高精度“数字孪生”

第一步是解决“长得像”的问题。研究团队动用了专业级的 3D 扫描仪(EinScan Rigil Pro),将 T 恤挂在模特身上,通过激光扫描和 RGB 图像融合,重建出亚毫米级精度的几何模型。经过泊松重建(Poisson Reconstruction)等后期处理,这些衣服在仿真里不仅尺寸精准,连细微的褶皱和纹理都得到了还原。

2. SIM1-Sim:让布料不再像“橡皮筋”

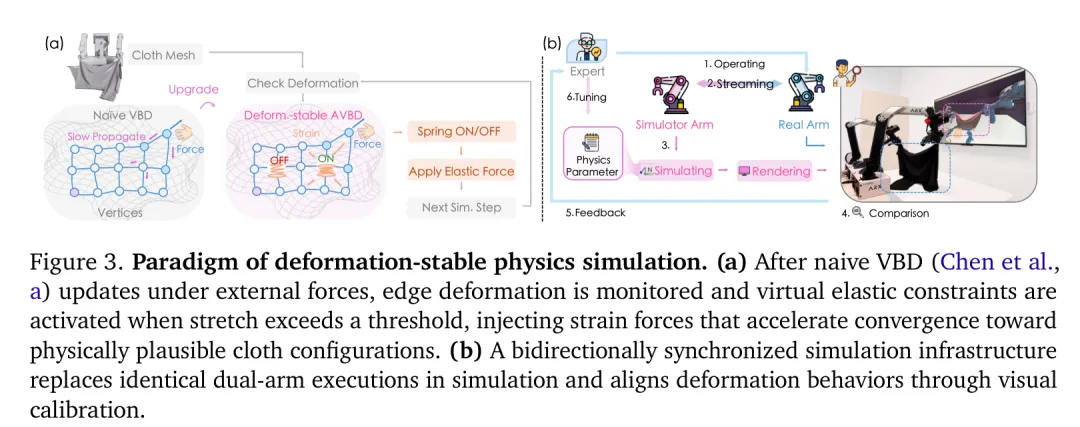

这可能是 SIM1 最核心的技术改进。为了让仿真里的布料“手感”真实,研究团队引入了增强顶点块下降(Augmented Vertex Block Descent, AVBD)解算器。

传统的物理解算器在处理机器人抓取布料时,经常会出现局部拉伸过大的情况。SIM1 在解算过程中加入了一个显式的应变约束(Strain Constraint)。简单来说,就是给布料的每一条边都设置一个“警戒线”,如果拉伸超过了预设比例 (论文中设为 5%),系统就会激活一个虚拟的弹性约束力。

其数学表达为:

当约束被违反时,会引入一个惩罚能量项:

这种设计有效防止了穿模和过度变形。随后,研究员通过双向同步的基础设施,让仿真机器人和真实机器人做同样的动作,通过视觉比对来微调杨氏模量、摩擦力等物理参数,直到两者的表现看起来“一模一样”。

3. SIM1-DataGen:结构化操纵合成

有了精准的仿真器,SIM1-DataGen 负责生成海量数据。它采用“结构化分解”策略:

输入:少量的真实专家演示数据。 处理:将演示分解为“交互段”和“移动段”。系统随机组合这些抓取点,并利用基于扩散模型的轨迹生成(Diffusion-based Trajectory Generation)来补全过渡动作。 输出:物理真实且视觉多样化的合成轨迹。

最后,通过一个基于 ResNet-18 和 Transformer 的视频判别器过滤掉物理不合理的样本,并结合 Blender 进行视觉随机化渲染。

实验结果:纯仿真训练也能“吊打”现实基准?

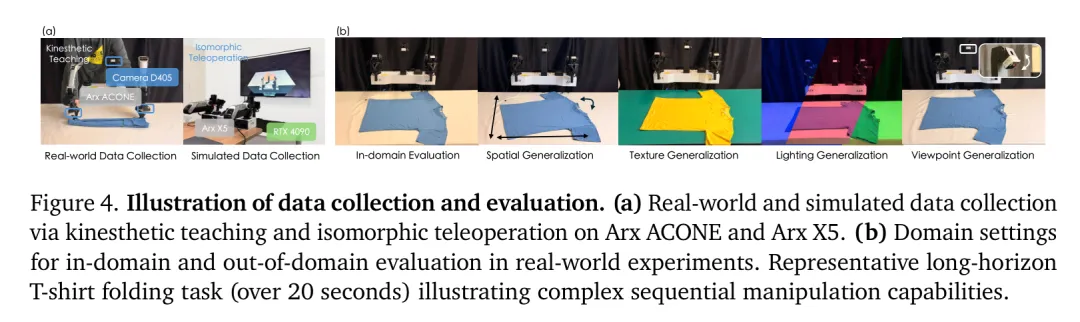

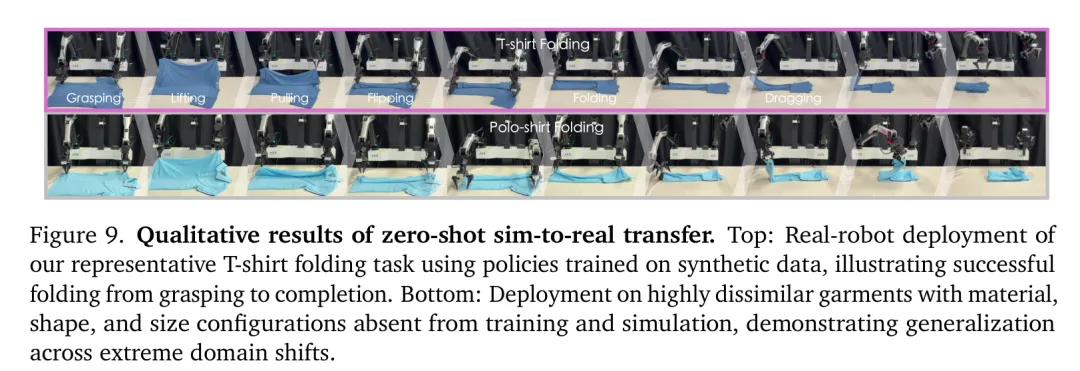

研究团队在 ARX ACONE 双臂机器人上进行了测试,任务是长周期(超过 20 秒)的 T 恤折叠。

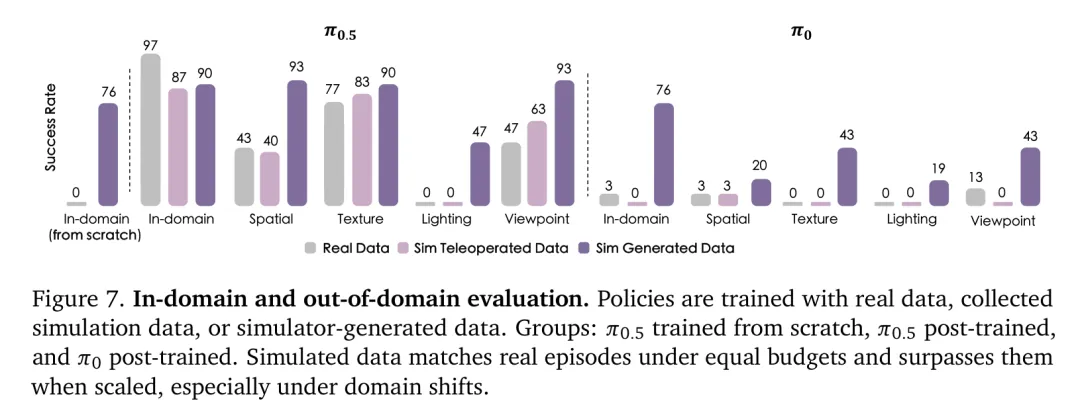

实验结果:

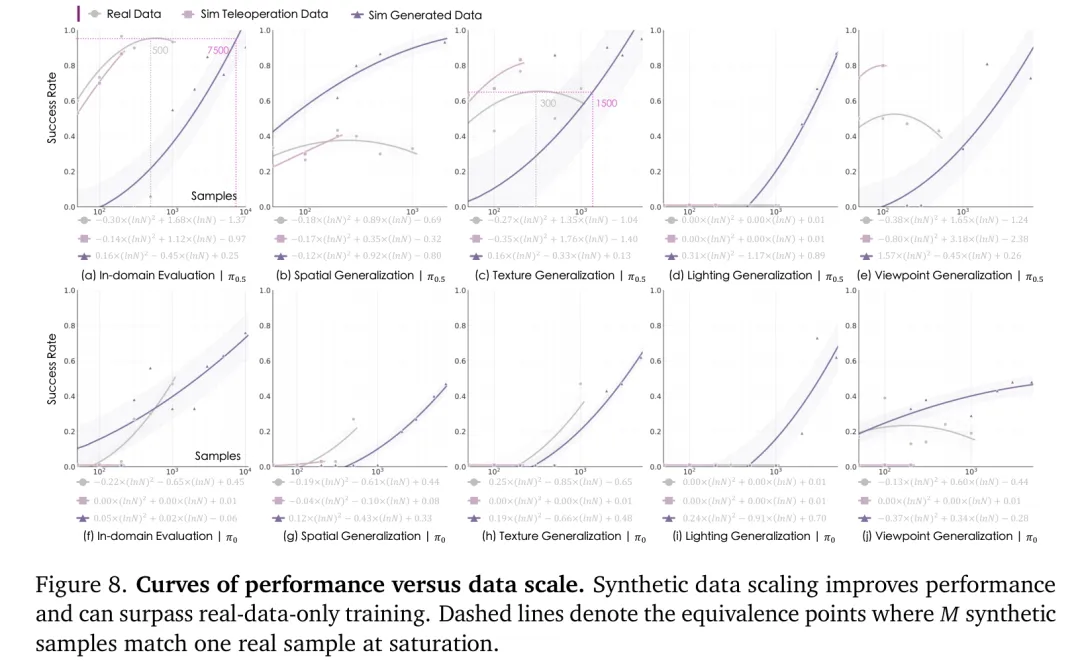

零样本迁移成功率:“仅”使用纯仿真生成的合成数据训练的模型,在真实环境下的 T 恤折叠任务中达到了 90% 的成功率。 泛化能力拔群:在纹理泛化测试中,SIM1 训练的模型成功率比仅用真实数据训练的模型高出 50% 以上。 数据等效性:有意思的是,研究发现,大约 15 条 仿真轨迹的效果等同于 1 条昂贵的现实采集轨迹。

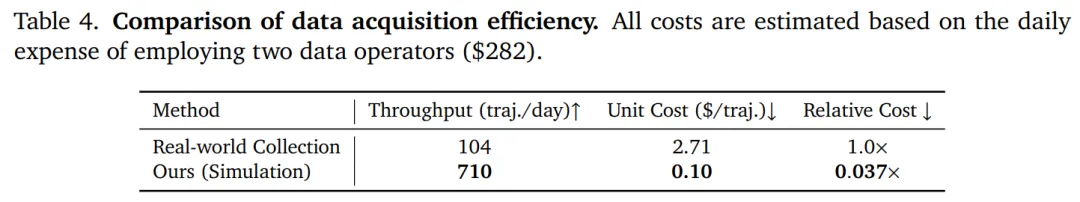

现实中采集一条轨迹的成本约为 2.71 美元,而 SIM1 仿真生成的成本仅为 0.10 美元,降本幅度高达 27 倍。

现实中采集一条轨迹的成本约为 2.71 美元,而 SIM1 仿真生成的成本仅为 0.10 美元,降本幅度高达 27 倍。

一点思考

SIM1 的成功给我们提供了一个非常清晰的信号:在具身智能(Embodied AI)领域,数据的“量”固然重要,但“物理对齐”的“质”才是通向通用的关键。

通过把复杂的物理规律“揉”进仿真器,研究团队实际上是为机器人创造了一个完美的“练功房”。这种 R2S2R 的闭环思维,或许会成为未来解决更多柔性物体操纵的标准范式。目前代码已在 GitHub 开源。

夜雨聆风

夜雨聆风