两年前,AI热度突然点燃全球,算力这事变得前所未有地重要。看谁能把机器砸得更多,芯片跑得更快,基本决定了算法能力—大家都在争这个节点。

回到2020年,中国在全球AI算力榜上曾处于领先。那会儿各地数据中心拔地而起,服务器建得飞快。美国虽然也在发力,但和中国拉开的差距有限。实际情况是两国内你追我赶,谁都没甩掉对方。

状况在2022年10月开始有了质变。美国商务部突然对先进AI芯片发布出口管制,把高端GPU卡在门外。像NVIDIA的A100和H100,这些训练大模型的主力芯片,直接不能卖给中国。官方说法很明确,美国打算把AI当成赢家工具,不让中国追上。

中国企业采购通道受限,芯片商也开始变通。比如NVIDIA推出A800、H800,把性能和互联速度砍掉一段,试图绕过红线。但好景不长,2023年10月规则又变,芯片性能密度、总能力都被纳入管制。原先的“特供版”一夜间也被拉入禁售名单。

2024年底,美国还加了一轮管控,140家中国实体列入限制清单,高带宽内存供应也受影响。这一系列动作,让中国获取高端芯片的渠道几乎关死。

管控越来越密,另一边美国科技巨头的钱也花得越来越狠。微软、亚马逊、谷歌、Meta 2024年资本支出2300亿美元,2025年还要冲到3200亿。基本全砸进数据中心和AI芯片。亚马逊2025年一季度资本投入243亿,同比大涨74%。微软喊话要800亿建AI数据中心,谷歌也宣布750亿计划。这些数字几乎前所未有。

像马斯克旗下的xAI公司在孟菲斯搞出来的超级计算机Colossus,也是行业大震动。用旧家电工厂改成AI超算基地,122天建成,第一期装了10万块NVIDIA H100 GPU。不到三个月又翻倍到20万块,马斯克还放话要扩到100万块。光硬件投资就超70亿美元,功耗300兆瓦,等于25万户家庭一年用电量。一家公司能这么烧钱,美国AI算力膨胀就有了缩影。

再看行业格局,2019年全球AI算力有四成属于政府和高校。到了2025年,私营企业占到八成。竞赛主角从国家实验室变成大厂。微软疯狂囤芯片,Meta的数据中心据说能铺满曼哈顿大半个城区。对比起来,欧洲、日本在这轮比赛里已经靠边站——德国、法国、日本这些老牌工业强国,份额僵在角落里。

中国没闲着,也走出了一条不同的路。根据《中国人工智能算力发展评估报告》,2024年中国智能算力达到725.3 EFLOPS,同比涨74%。计算中心全国铺到了1085万个标准机架,存储容量过1680 EB。速度上不算慢,但卡在“质”的关口——顶级芯片进不来,算力效率受损。

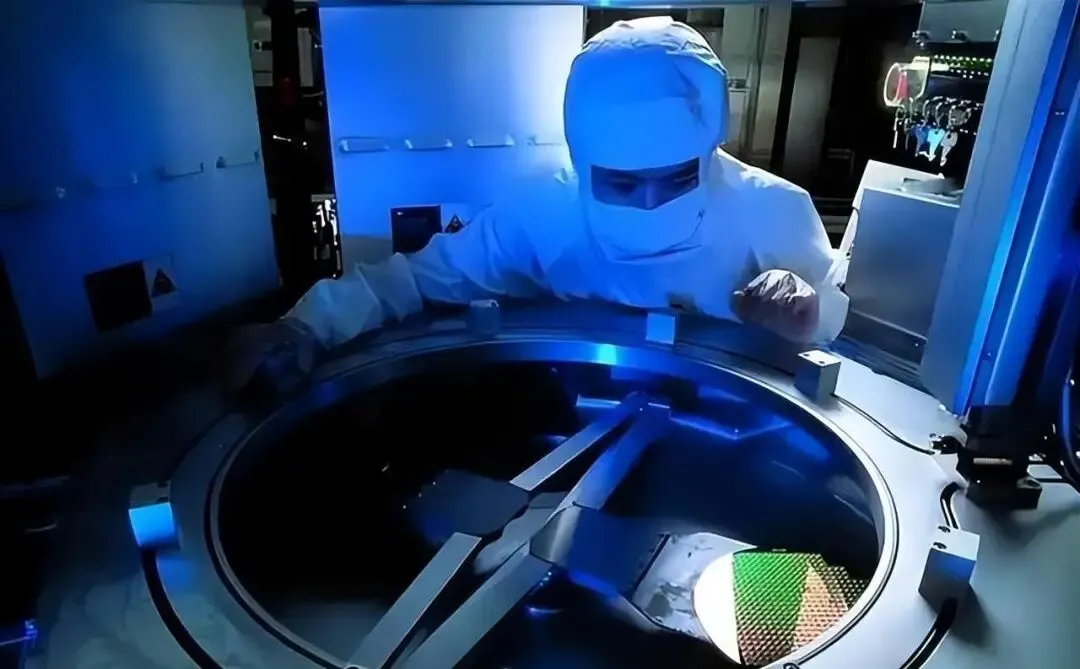

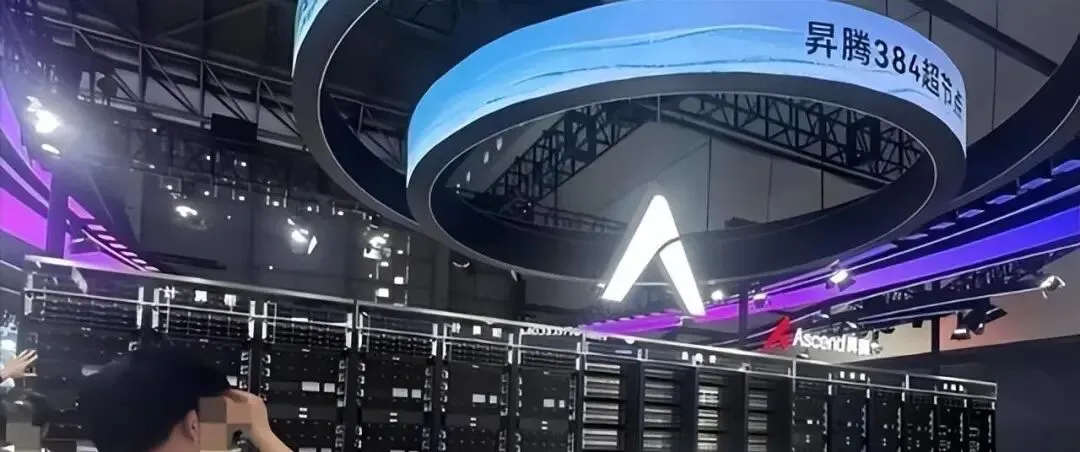

应对制约,中国科技企业开始玩自主替代。华为今年9月全联接大会上,公布了昇腾芯片三年路线图。昇腾950系列起步就用自研高带宽内存,摆脱对三星、SK海力士的依赖。徐直军坦言,华为算力跟英伟达还是有距离,但打算用“超节点”技术补短板。将八千多张昇腾卡组集成超级节点,总算力甚至超过英伟达计划2027年才推的NVL576。算力单兵不够,集群来凑。

除了大厂,中国新兴公司也刷出亮眼表现。杭州的DeepSeek成立不到两年,背后站着量化基金幻方。2025年1月发布DeepSeek-R1模型,多项评测接近OpenAI旗舰版o1,训练成本据说只有ChatGPT的零头。当天NVIDIA股价大跌,单日市值蒸发5000亿美元,刷新美股单只股票最大跌幅。业内有人称这是“AI领域的斯普特尼克时刻”。DeepSeek用的是NVIDIA H800,被砍了一半性能的中国市场特供版,通过底层优化和算法创新,实现了顶级效果。硅谷也不得不重新思考,算力堆钱堆芯片,是不是唯一出路?

对比来看,AI算力整体格局依然倾向美国。2024年美国私人AI投资高达1091亿美元,中国只有93亿,差约12倍。高端设备和资本结合,短期内难以追平。

有意思的是,算力军备赛背后出现一个变量。中国在能源供应上有明显优势,发电装机容量达到3200吉瓦,美国只有1293吉瓦。2024年中国新增429吉瓦净发电,是美国的15倍。数据中心耗电巨大,谁能给更多电,谁在后续发展中会有优势。不少业内人士开始关注这一点。

行业趋势并不绝对。比如英国今年让一家本土AI公司Graphcore和微软合作,用自研芯片建小型超算集群,试图突破美国芯片垄断。但规模和能力都难以带动全球算力变局—算力主力还是美国、中国两方在扛。

回头看,短期内美国通过高端芯片、资本联动,把算力差距拉开到68.9%对14.5%。美国赢在生态系统——芯片设计、云计算、资本市场,链条完整。中国押注规模和自主替代,铺摊子快,能源供应充足,政策调度灵活。到底哪条路径更持久,还得等2030年前后见分晓。

简单说,美国靠“资本加生态”,中国靠“规模加自主”。比分差距不小,但赛场还没吹终场哨,两条线路的碰撞,AI算力领域的变局,还远没到定局。

夜雨聆风

夜雨聆风