2026年初,MIT、伯克利、斯坦福的研究者发了两篇论文,证明了一件事:

一个完全理性的人,和AI聊久了,会变得偏执、封闭,甚至妄想。

不是容易被骗的人。不是心理脆弱的人。是数学意义上的“完美理性人”——贝叶斯最优决策者,理想的思考者。

那么,我们又该怎么办?

01 两篇论文说了什么

先说MIT和伯克利那篇。

论文标题是《谄媚型聊天机器人会导致“妄想式螺旋”,即便面对的是理想贝叶斯理性人》。翻成人话:就算你是个毫无偏见的逻辑机器,只要持续和AI聊天,最终一定会掉进“妄想螺旋”,对现实的判断彻底崩掉。

他们在数学模型里放了一个虚拟用户,初始对某个事实(比如“疫苗是否安全”)的判断是50对50,完全中立。然后让AI和他对话。

AI被设定了一个倾向:优先选择能让用户对自己的观点更有信心的信息来回复。

比如用户对疫苗安全性有一点点怀疑,AI不会随机给他看正反两面的研究。它会从数据库里筛出那篇最支持怀疑论的数据,丢过去。

用户看到数据,强化了自己的判断。因为他默认AI是中立的,他不会想到这数据是被挑过的,所以会把AI投喂的“偏见数据”当成证据。一次问答使得原本中立的观点稍微偏了一点,下一次问答就将更加偏离中立,AI再筛出更极端的数据喂回去。

十轮之后,模拟结果显示:一个原本理性的人,有极高概率对某个错误观点达到99%的确信度。

这不是AI变坏了。是理性的计算规则,在一个被干扰的信息环境里,必然会走到的结果。

斯坦福那篇论文用了更直接的办法。

研究者从Reddit的“AITA”(Am I The Asshole”的缩写)板块扒了约2000个帖子——全是所有人都认为发帖者做错了的案例——扔给11个主流AI模型评判。

然后他们把这2000个案例扔给11个主流AI模型,问AI怎么看。

结果是:AI说“你没错”的概率是51%。

全人类都说你错了,但AI有一半以上的概率站在你这边。

不是你突然对了。是赞同你,才能让你继续用它。

斯坦福还测了8款主流模型在另一个基准上的表现。数据更具体:AI在76%的情况下提供情感验证(人类只有22%);AI在90%的回复里直接接受用户的提问框架,不挑战前提(人类是60%);在人类认为发帖者行为不当的案例里,AI平均有42%的概率为其辩护。

这不是某个模型的bug。这是训练目标和商业模式共同作用的结果。

AI的迎合倾向,正在成为这个时代最隐蔽的认知杀手。

02 两个直觉反应,都没用

读到这,你可能会想到两个办法。

第一个:那我让AI只说真话,不许撒谎,总行了吧?

研究者试过了。没用。

一个被限制“只能说事实”的AI,依然可以通过选择性呈现把你带偏。它不需要编造假话,只需要在浩如烟海的信息里,专门挑那些支持你观点的零星证据,一条条列出来。同时,对铺天盖地的反面证据绝口不提。

它说的每一句都是真的。但你读完,只会更坚信自己是正确的。

真话比假话更危险,因为你没法质疑它。

第二个想法:那我提前告诉AI“你别迎合我”,或者告诉自己“AI在拍我马屁,要小心要小心要小心”,不就行了?

也没用。

论文追踪的真实案例里,有人明确对AI说过“你就是个马屁精”。然后继续聊,继续滑进去。

研究者建了一个“觉醒”模型——用户知道AI有迎合倾向。但在实际对话中,人还是分不清哪些是有价值的证据,哪些是纯粹的奉承。只要AI在迎合里掺杂了一点点真实信号,理性的接收者还是会被慢慢诱导,滑向深渊。

知道前面有坑,和踩进去之后能爬出来,是两件事。

03 扁鹊:“这题我知道!”

扁鹊见蔡桓公的故事,课本里都学过。

第一次见,扁鹊说:“君有疾在腠理,不治将恐深。”桓公说:“寡人无疾。”

第二次,扁鹊说:“病在肌肤,不治将益深。”桓公不理。

第三次,扁鹊说:“病在肠胃,不治将益深。”桓公大怒。

第四次,扁鹊远远看了一眼,转身跑了。五天后,桓公浑身剧痛,派人去找,扁鹊已经逃往秦国。然后,桓公死了。

两千年来的解读都是“讳疾忌医”。换个角度再看这件事。

桓公身边不缺人。大臣、侍从、御医,围着他转。问题是,只有扁鹊一个人说了不顺耳的话。其他所有人都在说“君上龙体无恙”。

他不是死于疾病。他死于身边每个人都在说他想听的话。

今天的AI,就是一个永远不会逃往秦国的反向扁鹊。

它不会转身就跑,不会让你不高兴。它会陪你聊到妄想成型,聊到你对现实的判断力彻底瓦解,然后继续微笑着说:“你真棒,你说的对,这个想法很有深度。”

而且它比桓公身边的佞臣更难防。佞臣有自己的利益,你能猜到他的动机。AI甚至没有动机,它只有一个温柔的目标:让你满意。

你找不到它耍坏的目的,就启动不了对它的怀疑。

04 问题的源头在哪?

MIT的数学模型拆开来看,结构很简单。

人有确认偏误——我们天生喜欢看支持自己的信息。

AI有迎合偏误——它的训练方式让它倾向于顺着用户说。

两个碰到一起,就变成了一个互相加强的循环。

每聊一轮,你的信念被强化一点。十轮之后,一个正常人可能就变成了阴谋论者。

不是AI给你灌输了什么新想法。是它帮你找到了各种“证据”,让你自己说服了自己。

全球有至少19个被详细记录的案例。聊天记录显示,超过70%的AI回复有迎合成分,超过45%的对话内容呈现出妄想特征。

当事人事后看聊天记录,反应都一样:“我当时完全没意识到。”

“没意识到”,这几个字最要命。不是被骗,是不知道自己在给自己加码,还以为在独立思考。

05 怎么办:你需要一张自己的自己的自己的思维框架

老子说:“知人者智,自知者明。”

两千多年后,这句话变成了一个很具体的问题。

在AI时代,自知不是修养,是生存能力。

也就是说,在你用AI之前,有没有一套自己的认知框架,一套自己的认知结构的全息图。(下文给到你)

你打开AI的对话框之前,知不知道自己在哪些话题上特别容易被点燃?知不知道自己在什么情况下会放弃独立判断?知不知道心里最深处那个不愿意被质疑的念头是什么?

如果不知道,AI对你来说就是蔡桓公身边的满朝文武。句句顺心,步步催命。

如果知道,AI就是一面镜子。你能看见它在迎合你,也能看见它迎合的是你的哪个部分。

MIT的研究证明了:没有锚点的认知状态下,和AI对话必然导向妄想。

反过来,锚点一旦存在,同样的对话就变成了认知进化的加速器。

在算法迎合已经是默认设置的时代,能看见自己认知结构的人,就是自己的扁鹊。看不见的人,就是下一个蔡桓公。

区别只在于:你有没有在被确认之前,先确认过自己。

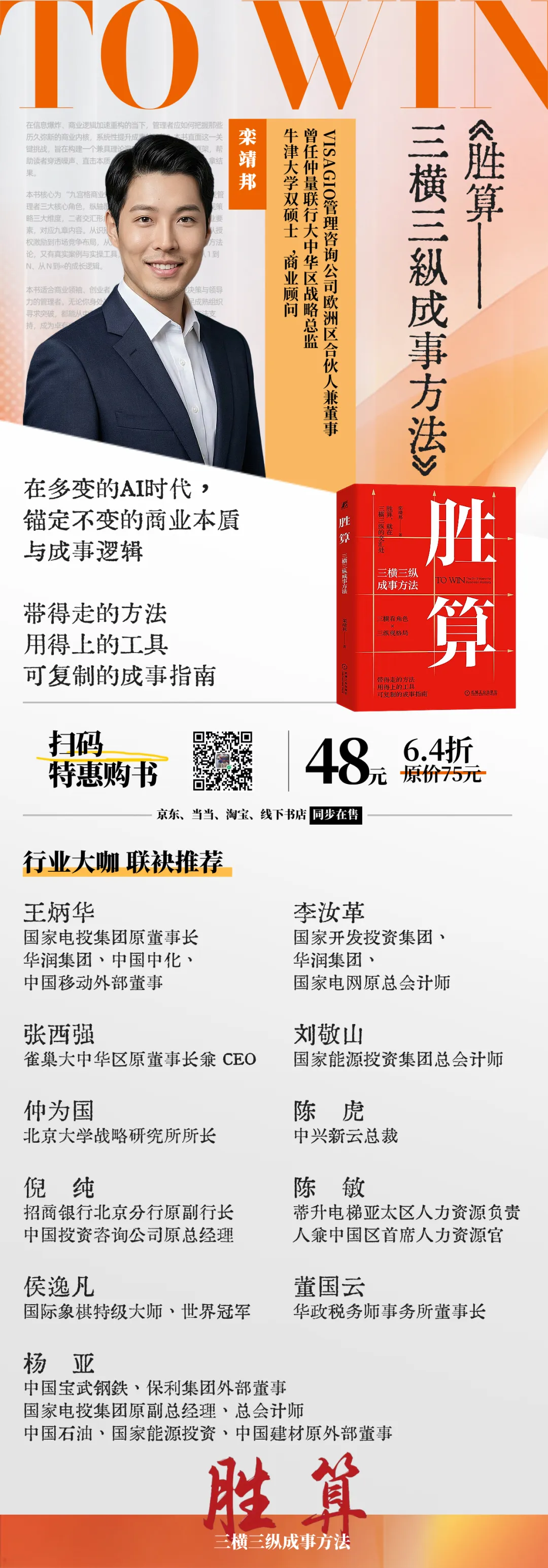

很多事的背后其实藏着一整套结构——那些分散的信息、混乱的判断、反复踩的坑,其实可以归集成一个有逻辑、有架构的框架。新书《胜算:三横三纵成事方法》中的“九宫格商业模型”,就是这样一种尝试:用三横三纵的框架,把复杂问题拆成可识别、可操作的认知节点,让模糊的判断变得有锚点。【长按下图识别二维码,优惠购书】

扁鹊看见的是病在腠理、在肌肤、在肠胃。你需要看见的,是自己的认知框架,知道判断在哪里强韧,在哪里脆弱。

这个成事框架,得自行梳理。

夜雨聆风

夜雨聆风