LG - 机器学习 CV - 计算机视觉 CL - 计算与语言

1、[LG] All elementary functions from a single binary operator

2、[LG] Sample Complexity of Autoregressive Reasoning:Chain-of-Thought vs. End-to-End

3、[CL] Continuous Knowledge Metabolism:Generating Scientific Hypotheses from Evolving Literature

4、[CL] LoSA:Locality Aware Sparse Attention for Block-Wise Diffusion Language Models

5、[LG] The Linear Centroids Hypothesis:How Deep Network Features Represent Data

摘要:仅凭单一二元算子构建所有初等函数、自回归推理的样本复杂度:思维链与端到端的比较研究、基于动态演进文献的科学假设生成、面向块级扩散语言模型的局部感知稀疏注意力、线性质心假说:深度网络特征如何代表数据

1、[LG] All elementary functions from a single binary operator

A Odrzywołek

[Jagiellonian University]

仅凭单一二元算子构建所有初等函数

要点:

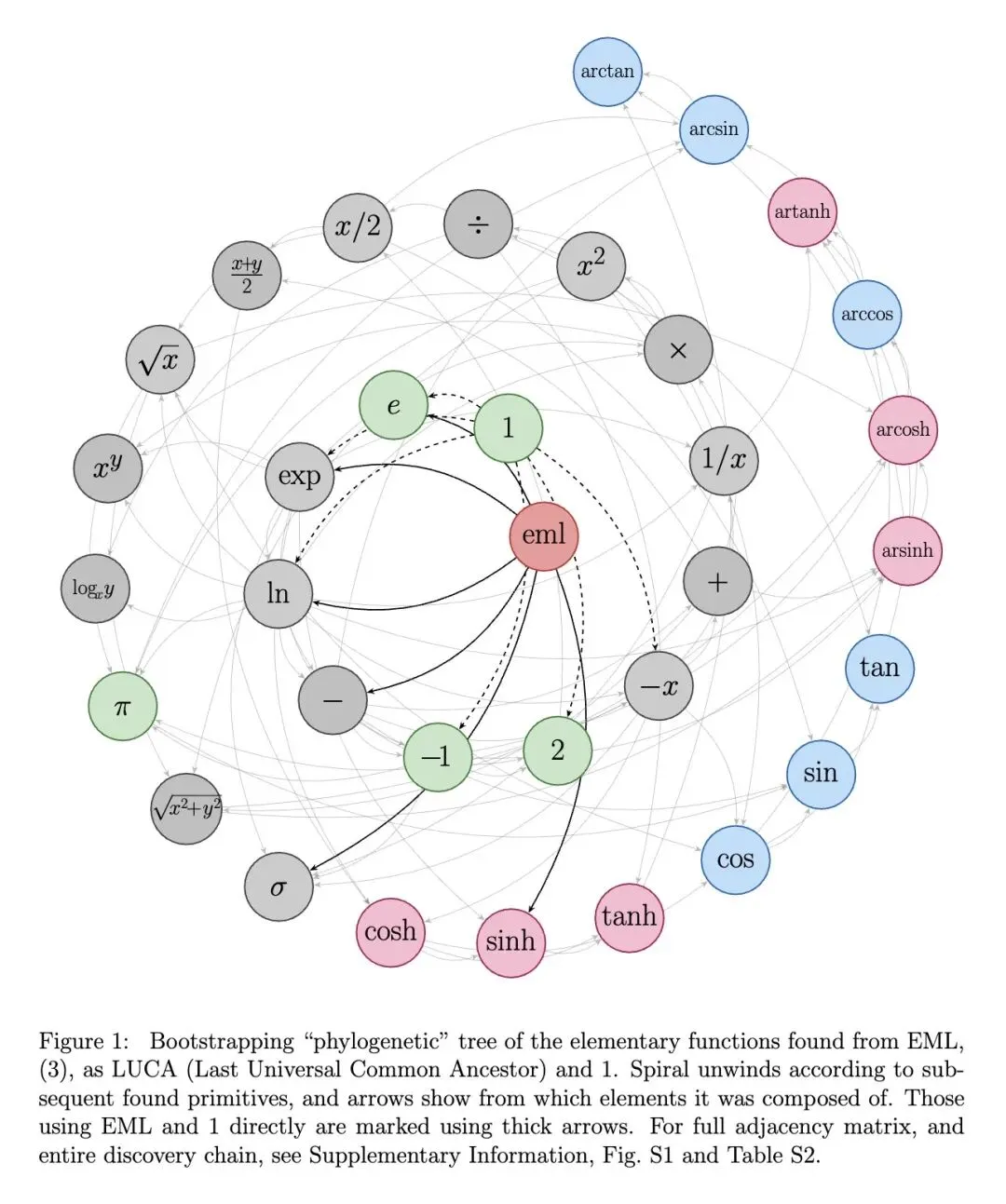

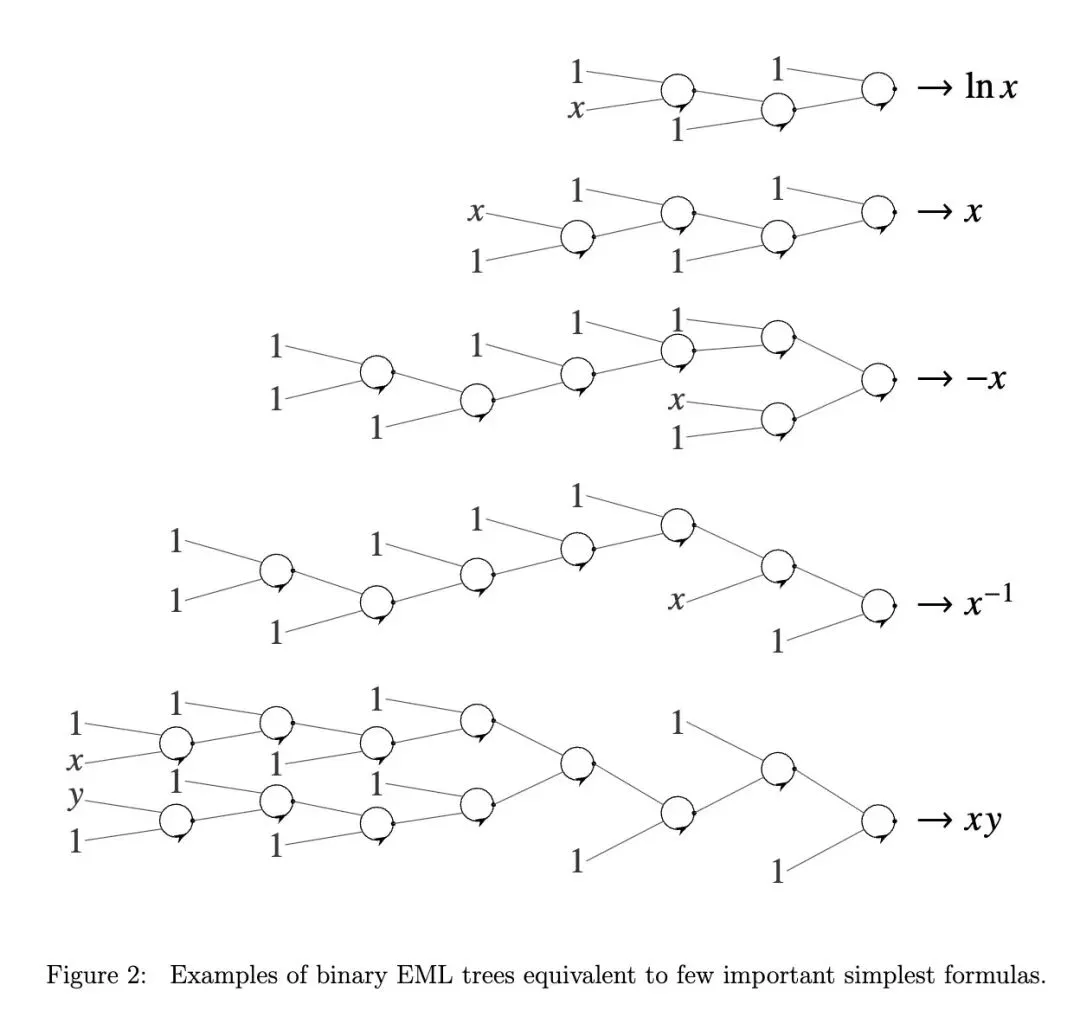

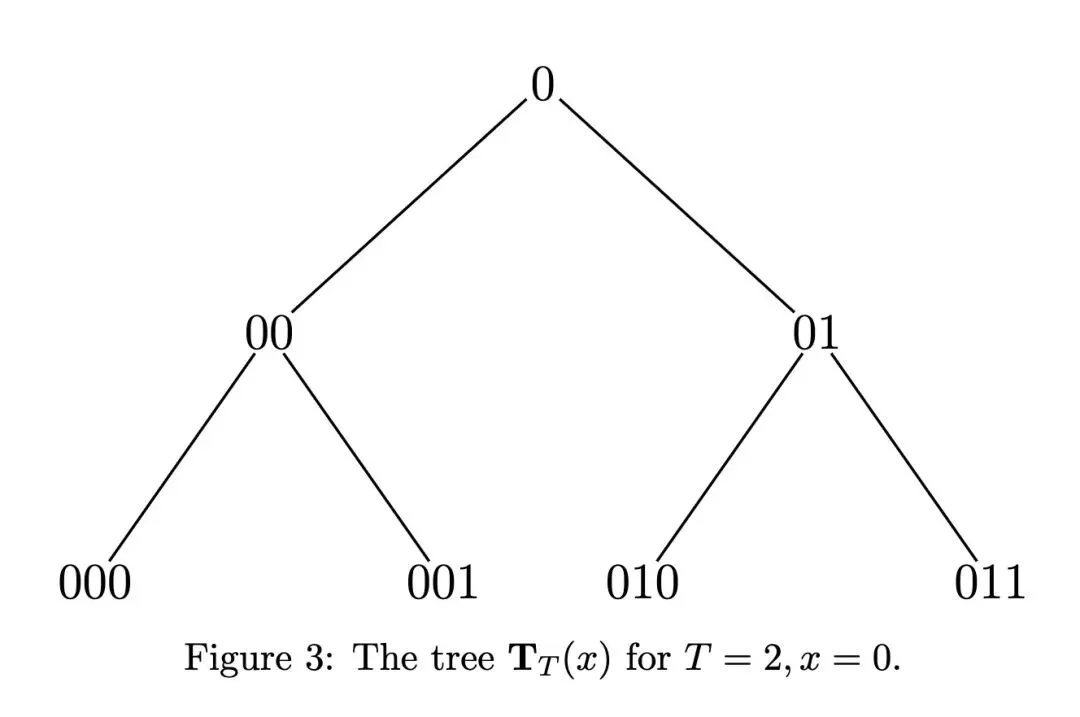

颠覆传统的数学分类认知: 打破了“连续数学天生需要多种不同算子(如加减乘除、三角函数、对数等)”的传统观念,证明了单一基础算子即可满足需求。 引入连续数学的“与非门”: 提出了 EML (Exp-Minus-Log) 算子,定义为 eml(x, y) = exp(x) - ln(y)。仅需该算子配合常数1,即可生成所有标准初等函数、算术运算以及常数(包括 、 和 )。反直觉的复平面路由: 为了仅用 EML 计算纯实值函数,系统在内部必须经过复数域的运算(例如,通过计算 ln(-1)来生成 和 ,并利用欧拉公式推导三角函数)。统一的二叉树表示法: 所有的初等数学公式都可以被转化为由完全相同的节点构成的二叉树结构,其上下文无关文法极为简单: S → 1 | eml(S, S)。符号回归(SR)领域的突破: 将传统符号回归中离散的、组合爆炸的搜索空间,转化为连续的、结构统一的参数空间。通过参数化 EML 树,使用标准的梯度下降优化器(如 Adam)即可从数值数据中精确恢复出闭式(closed-form)的数学公式。 发现方法: EML 算子并非纯解析推导得出,而是通过对包含36个按键的“科学计算器”基元进行系统性的“消融”搜索,结合数值自举(bootstrapping)和常量识别算法发现的。 优化过程的鲁棒性: EML 树展示了一种特性,即能将训练后的连续权重“吸附”(snap)到精确的二元状态(0或1),在较浅的树深度(深度4以内)下,能从随机初始化中完美恢复出精确的符号公式。

主旨: 这篇文章主要探讨并解决了一个数学和计算科学中的基础性问题:连续数学是否能像布尔逻辑使用单一的“与非门(NAND)”那样,仅用一个极其简单的二元算子来重构所有的初等数学函数和运算?文章旨在寻找这个连续数学领域的通用图灵完备原语,并探索其在计算和机器学习中的应用潜力。

创新:

发现了统一基础算子 EML: 创新性地提出了 eml(x, y) = exp(x) - ln(y)这一非线性不对称算子,证明了它是构建整个初等数学体系的充分条件。构建了公式的同质化计算架构: 将极其复杂的、由不同符号组成的异质数学公式,统一转换为只包含 eml和1的同质化二叉树/模拟电路结构。提出了可微分的符号回归新范式: 创新性地利用 EML 树的统一性,构建了包含所有可能公式的“主公式(master formula)网络”,使得纯粹依靠梯度下降算法(连续优化)去发现精确的符号公式(离散结构)成为可能。

贡献:

理论贡献: 证明了初等函数的生成基可以被极度压缩到一个二元算子和一个常数,从根本上简化了连续数学操作的分类复杂性。 工程与计算贡献: 开发了 EML 编译器原型,能够将标准数学公式编译为纯 EML 代码;验证了用单一指令栈机器或均一化模拟电路进行所有科学计算的可行性。 AI与机器学习贡献: 为基于神经网络的符号发现(AI Feynman/KAN等)提供了一种全新的同质化网络架构,解决了以往符号回归中算子库不完备或离散搜索极难优化的问题。

提升:

结构统一性指标: 将表示初等函数的算子种类从三十多种(加减乘除、三角函数等)直接降维至 1种(极大降低了计算系统指令集的熵)。 符号回归的精确度与收敛性: 在浅层树(深度2-4)的情况下,使用 EML 架构通过标准 Adam 优化器从数值拟合中盲搜(不加任何先验规则)精确闭式数学公式的成功率,在深度2时达到了 100%。 泛化能力: 优化得到的并非近似的黑盒神经网络权重,而是能直接“吸附”回精确符号表达式的参数,从而实现了完美的外推泛化能力。

不足:

表达效率低下(树深度爆炸): 极其基础的运算(如乘法)需要极深的二叉树(编译器输出长度达41,即使穷举搜索也需要长度17),导致深层结构的计算效率远低于传统硬件级别的加乘器。 内部运算依赖复数域: 即使是纯实数的输入输出(如 x + y),EML 内部也需要引发负数对数(复平面跳跃)和浮点溢出()等特殊情况,这对传统浮点计算和自动微分框架(如 PyTorch)的鲁棒性提出了极大挑战(易产生 NaN)。深层优化的梯度问题: 由于 exp和ln的强非线性,在符号回归应用中,当树深度超过 5 时,成功盲搜恢复公式的概率急剧下降(低于1%),面临严重的梯度消失或爆炸问题。

心得:

复杂体系往往源于极简规则的迭代: EML 算子深刻揭示了连续数学领域的一种“分形”美学。平时看似风马牛不相及的对数、三角函数和四则运算,本质上只是 exp(x) - ln(y)这一非线性映射在复平面上不同路径的折叠与投影。这启示我们,在物理或AI领域寻找“大一统理论”时,底层的通用法则可能比我们想象的要简单、反直觉得多。连续与离散边界的消解(AI符号发现的破局点): 传统AI一直面临“连接主义(连续梯度)”与“符号主义(离散逻辑)”难以融合的困境。EML 树巧妙地用极其单一的拓扑结构把离散的公式搜索变成了一个连续权重的路由选择问题。这为未来大型神经网络具备真正的“精确逻辑推导能力”提供了一条令人兴奋的底层架构重构路径。 “借道高维”的解题哲学: 论文中最令人惊叹的反直觉点在于:为了用 EML 算出纯实数的结果,它必须在运算中途跳入复数域(利用欧拉公式绕路)。这种“为了解决低维问题,必须借助高维空间游走”的现象,不仅在数学上十分巧妙,在工程创新和系统架构设计上也极具启发性——有时最直的捷径往往在更高的维度里。

一句话总结:

论文开创性地发现了一个连续数学领域的“与非门”算子 eml(x,y) = exp(x) - ln(y),仅用它和常数1即可推导出所有标准初等数学函数,这一极度反直觉的统一结构将复杂的符号运算化简为同质的二叉树网络,从而巧妙地把离散的“符号回归公式发现”转化为了可用深度学习梯度优化的连续参数拟合问题。

A single two-input gate suffices for all of Boolean logic in digital hardware. No comparable primitive has been known for continuous mathematics: computing elementary functions such as sin, cos, sqrt, and log has always required multiple distinct operations. Here I show that a single binary operator, eml(x,y)=exp(x)-ln(y), together with the constant 1, generates the standard repertoire of a scientific calculator. This includes constants such as e, pi, and i; arithmetic operations including addition, subtraction, multiplication, division, and exponentiation as well as the usual transcendental and algebraic functions. For example, exp(x)=eml(x,1), ln(x)=eml(1,eml(eml(1,x),1)), and likewise for all other operations. That such an operator exists was not anticipated; I found it by systematic exhaustive search and established constructively that it suffices for the concrete scientific-calculator basis. In EML (Exp-Minus-Log) form, every such expression becomes a binary tree of identical nodes, yielding a grammar as simple as S -> 1 | eml(S,S). This uniform structure also enables gradient-based symbolic regression: using EML trees as trainable circuits with standard optimizers (Adam), I demonstrate the feasibility of exact recovery of closed-form elementary functions from numerical data at shallow tree depths up to 4. The same architecture can fit arbitrary data, but when the generating law is elementary, it may recover the exact formula.

https://arxiv.org/abs/2603.21852

2、[LG] Sample Complexity of Autoregressive Reasoning: Chain-of-Thought vs. End-to-End

S Hanneke, I Mehalel, S Moran

[Purdue University & The Hebrew University & Technion and Google Research]

自回归推理的样本复杂度:思维链与端到端的比较研究

要点:

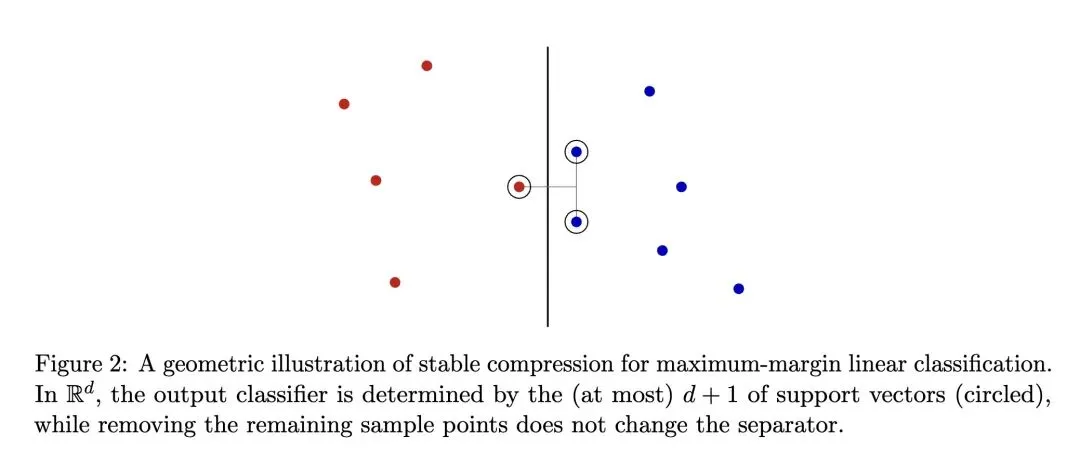

解决了自回归 PAC 学习的基础性悬案: 彻底解答了 Joshi 等人(2025年)留下的关于“自回归生成长度 如何影响样本复杂度”的核心开放问题。 反直觉发现(思维链机制): 证明了在思维链(CoT)监督下,只要基类具备有限的 VC 维,其样本复杂度与生成长度 完全无关。这推翻了此前业界认为 CoT 仍需依赖 样本量的认知。 高信息熵(端到端学习分类学): 揭示了端到端(e2e)学习中样本复杂度的丰富图景:从常数级 到线性级 之间,几乎任何单调次加性(monotone-subadditive)的增长率都是可能存在的,打破了原有的“非对数即线性”的简单二分法。 反直觉发现(不存在通用维度定理): 通过对角化论证(diagonalization argument)证明,没有任何单一的组合维度能够定量刻画所有次线性的端到端增长率,这挑战了传统 PAC 学习理论中“总能找到一个维度来表征学习难度”的固有预期。 引入自回归树维度(ATdim): 提出了一种全新的基于树的组合维度,与此前使用的 Littlestone 维度相比,它为判断对数级 e2e 增长率提供了一个更广泛、限制更弱的充分条件。 病态的奇偶性效应: 揭示了一个极端现象:如果基类没有有限的 VC 维,自回归系统的可学习性可能会根据 的奇偶性发生病态震荡(例如,偶数长度时完全无需训练即可学习,奇数长度时即使有 CoT 监督也完全不可学)。 样本压缩方案的应用: 创新性地应用了稳定样本压缩机制(Stable sample compression schemes),成功将二元基类的学习能力提升为对完整 CoT 轨迹的学习能力。

主旨: 这篇文章主要在 PAC(概率近似正确)学习框架下,严格研究了自回归大模型生成过程的“样本复杂度”与“生成长度()”之间的深刻关系。论文对比了“端到端监督(仅给定最终答案)”和“思维链监督(给定完整的中间推理轨迹)”两种范式,探讨提供详尽的中间推理步骤能在多大程度上降低模型学习所需的样本数据量。

创新:

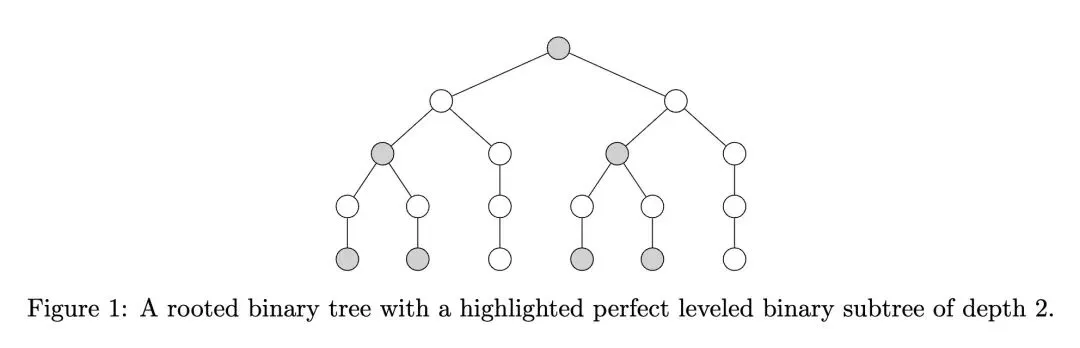

完整的增长率构造法: 首次构造出了能够精确映射到任意“单调次加性”函数 的假设空间,从数学上直接证明了自回归系统学习难度的演变是一个极其连续且丰富的谱系。 全新的组合维度 ATdim: 创造性地定义了“自回归树维度(Autoregressive Tree Dimension, ATdim)”,通过寻找生成的前缀树(prefix tree)中是否存在大规模的完美层级子树,来更精准地捕捉模型生成路径的多样性。 跨范式的样本压缩降维映射: 没有使用传统的 ERM(经验风险最小化)去生硬拟合 CoT 轨迹,而是巧妙地将一条长度为 的多类别思维链样本,膨胀(inflate)成 个二元基类样本,并利用多数投票(majority vote)的样本压缩方案,成功剥离了泛化误差界限中对 的依赖。

贡献:

理论补全: 彻底补全了 Joshi 等人留下的理论拼图,证明在有限 VC 维下,CoT 监督能将样本复杂度对序列长度的依赖直接降为 0(即与 独立)。 确立端到端学习分类学(Taxonomy): 从理论上确立了端到端学习随长度 增长的完整可能形态,不仅包含了已知上限(线性)和下限(常数/对数),还确认了中间状态的必然存在。 否证了单一维度特征的存在性: 使用对角化论证确凿地证明了:在端到端自回归学习中,企图寻找一个像“VC 维”那样完美的单一数学维度来刻画次线性增长是徒劳的。

提升:

CoT 样本复杂度的上限紧致化: 将思维链监督下的样本复杂度上界从先前的对数级依赖 ,极致压缩到了常数级独立 。 特定网络类的最优样本复杂度: 针对具备稳定样本压缩特性的类(如自回归线性分类器网络),得出了无需依赖组合爆炸,仅与特征维度 相关的极优 CoT 学习上界 。 放宽了对数级增长的门槛: 相比于要求严苛的 Littlestone 维度(若 Ldim 无限,之前的方法将失效),本文使用新提出的 ATdim,证明了即使 Ldim 为无限大的某些函数类,其端到端学习复杂度依然可以保持极其高效的对数级增长。

不足:

理想化假设(有限字符与唯一正确答案): 理论模型局限于二进制或有限规模的离散词表 ,并且假设最终只有一个“正确答案”。对于大语言模型在现实中面临的无限开放式生成、多条合法推理路径(如数学证明有多种解法),该理论尚未能直接适用。 常数因子的潜在膨胀: 尽管在 CoT 分析中去除了对长度 的依赖,但样本界限中引入了“对偶 VC 维(Dual VC Dimension)”作为乘子。对于某些极端的假设空间,对偶 VC 维可能会随原 VC 维呈指数级爆炸,使得该理论界限在部分情况下不够紧致。 放弃了基础类的可学习性假设: 文章指出如果抛弃基类具有有限 VC 维的假设,自回归学习行为将变得毫无规律(如奇偶性病态问题)。这意味着该理论高度依赖于“模型预测下一个 Token 这一动作本身必须是容易学习的”这一强预设。

心得:

“授人以渔(过程)”的降维打击: 论文在极其严格的 PAC 理论下证明了:给出思维链(过程)能让长文本生成的样本复杂度直接免疫长度 的增加。这从根本上解释了为什么 OpenAI 等公司开始极力推崇基于过程的奖励模型(PRM)和 RLHF 中的逐步推理,因为这在数学本质上将一个“随步骤指数/线性爆炸”的学习难题,降维成了常数级难度的任务。 反直觉的“奇偶性”病态提示我们谨慎评测: 当基类不具备良好性质时,模型在偶数长度和奇数长度表现出的“零难度可学”与“绝对不可学”的反差极度震撼。这启发我们在构建复杂大模型的评测 Benchmark 时,模型某些时候在长上下文中表现好,可能仅仅是由于网络结构底层某种特征的巧合(如恰好卡在偶数拍),而非真正具备了强大的泛化推理能力。 复杂系统没有捷径(放弃寻找银弹): 论文证明了不存在单一的维度参数能完美表征端到端自回归学习的次线性增长。这给我们带来的深刻启示是:大语言模型的黑盒由于自回归步骤的叠加,其状态空间已呈现出高度的非线性与分形特征。试图用传统的单一简单指标去框定或预测大模型(比如 Scaling Law 中的某个单一参数)注定会遇到局部失效,未来的 AI 理论需要拥抱这种“无法被单一维度刻画”的拓扑复杂性。

一句话总结:

本文在 PAC 学习理论框架下彻底解析了自回归推理模型的样本复杂度,反直觉地证明了思维链(CoT)监督能够完全消除样本需求对生成长度的依赖,并揭示了端到端学习中极端丰富且无法被单一数学维度统御的复杂增长图景。

Modern large language models generate text autoregressively, producing tokens one at a time. To study the learnability of such systems, Joshi et al. (COLT 2025) introduced a PAC-learning framework for next-token generators, the primitive underlying autoregressive models. In this framework, an unknown next-token generator maps a sequence of tokens to the next token and is iteratively applied for T steps, producing a chain of tokens whose final token constitutes the model’s output. The learning task is to learn the input-output mapping induced by this autoregressive process. Depending on the available supervision, training examples may reveal only the final output (End-to-End supervision) or the entire generated chain (Chain-of-Thought supervision). This raises two natural questions: how the sample complexity depends on the generation length T, and how much Chain-of-Thought supervision can reduce this dependence. In this work we give a nearly complete answer to both questions by uncovering a taxonomy of how the sample complexity scales with T. For End-to-End learning, we show that the landscape is remarkably rich: subject to mild conditions, essentially any growth rate r(T) between constant and linear can arise as the sample complexity, and combined with the linear upper bound of Joshi et al., this yields an essentially complete characterization. In contrast, under Chain-of-Thought supervision we show that the sample complexity is independent of T, demonstrating that access to intermediate reasoning steps can eliminate the dependence on the generation length altogether. Our analysis introduces new combinatorial tools, and as corollaries we resolve several open questions posed by Joshi et al. regarding the dependence of learnability on the generation length and the role of Chain-of-Thought supervision.

https://arxiv.org/abs/2604.12013

3、[CL] Continuous Knowledge Metabolism: Generating Scientific Hypotheses from Evolving Literature

J Tao, Y Wang, X Liu, M Yang

[Central University of Finance and Economics & Beijing Institute of Technology & TsingyuAI]

持续性知识代谢:基于动态演进文献的科学假设生成

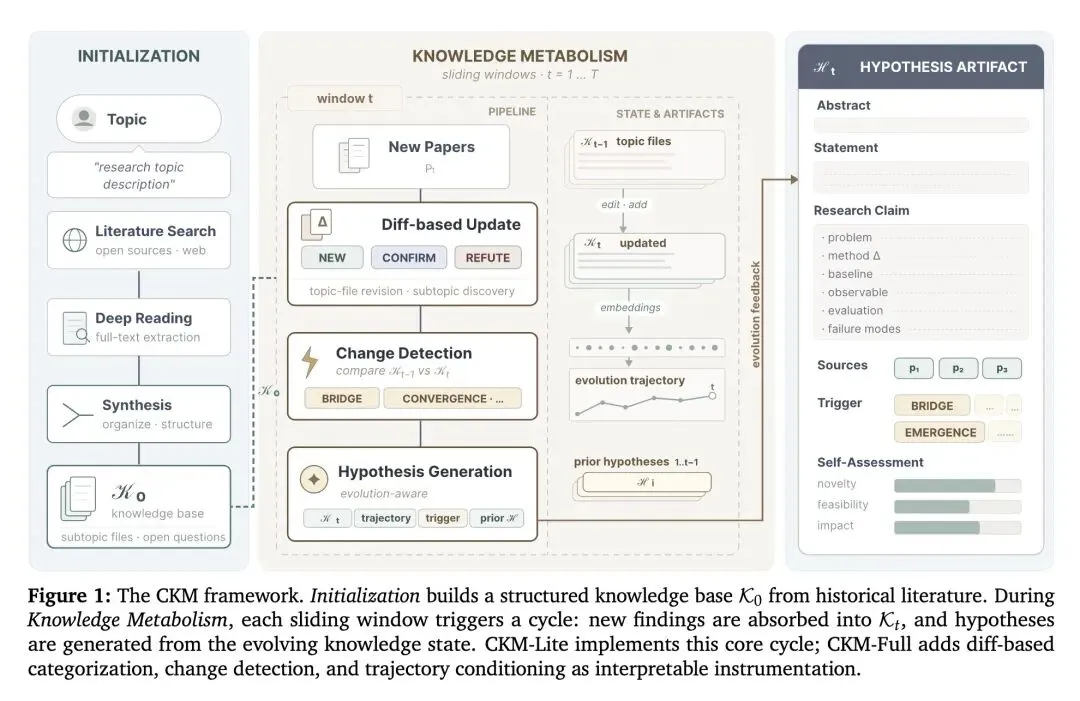

要点:

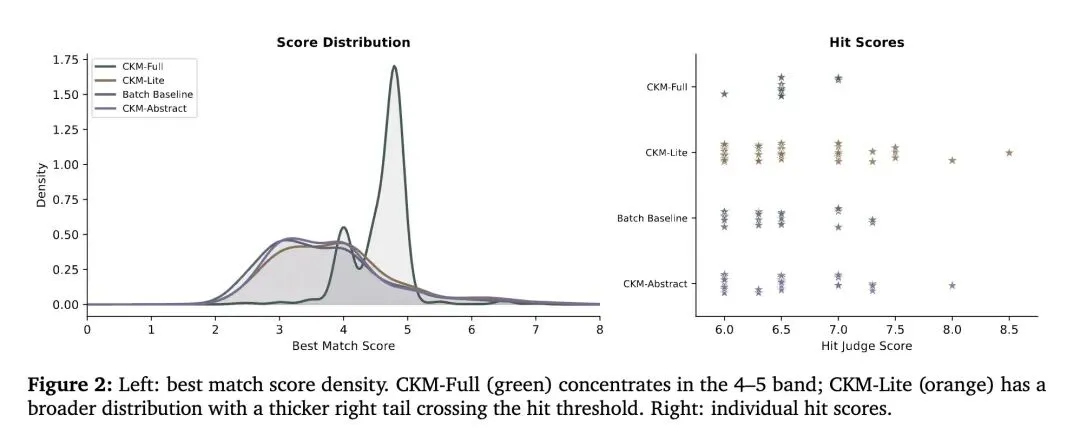

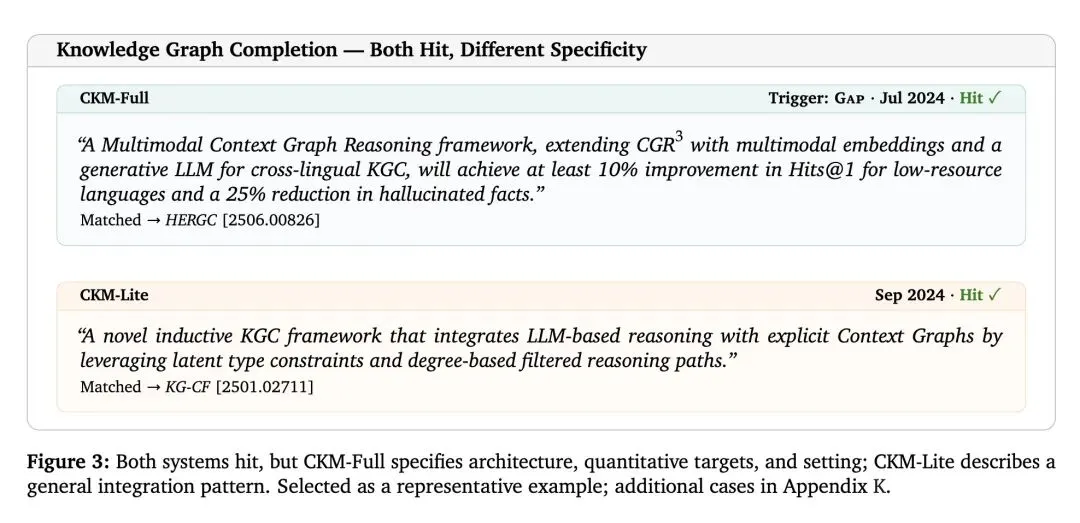

挑战“静态快照”范式: 打破了当前大模型科学发现系统(如 AI Scientist)将文献视为一次性静态输入的惯例。引入了“连续知识代谢(CKM)”框架,通过滑动时间窗口来追踪知识的动态演进。 反直觉的极高能效比: 仅进行增量更新的 CKM-Lite 变体,在预测命中率(+2.8%)、假设产量和对齐度上全面超越了全局批处理(Batch Baseline),同时令人惊讶地将 Token 计算成本降低了 92%。证明增量追踪远优于直接塞满超长上下文。 “评估悖论”(质量与覆盖率的严酷权衡): 极其反直觉的发现:假设的新颖性与预测命中率几乎完全不相关(r ≈ 0)。具备深度分析能力的 CKM-Full 生成了极具原创性和具体性的假设(Cohen's d=3.46),但命中率却大幅下降(1.4% 对比 5.8%)。原因在于,极其精准的预测要么完美命中要么彻底落空,而当前的“命中率”指标实际上在变相奖励那些宽泛、表述模糊的“安全”假设。 轨迹稳定性决定可预测性: 一个研究领域的语义“漂移(Drift)”(即发展轨迹的稳定性)与预测成功率呈负相关。频繁摇摆、高漂移的领域极难预测,这为 AI 驱动的科学发现划定了明确的边界条件。 不同类型的知识变更信号预测率不同:“聚合(Convergence)”信号(即多篇独立论文得出相同结论)产生的假设预测命中率,几乎是“矛盾(Contradiction)”信号的 5倍。

主旨: 本文旨在探讨大语言模型(LLM)如何通过持续追踪不断发展的科学文献来生成具有前瞻性的科学假设。文章指出,科学发现不是基于静态知识库的一次性检索,而是对知识演进、矛盾和趋势的持续“代谢”。为此,作者提出了 CKM 框架,并在真实的未来论文发表数据上验证了增量文献处理的有效性及其带来的深层特征变化。

创新:

滑动时间窗口的增量处理: 摒弃了传统的 RAG(检索增强生成)批处理模式,采用按时间序列的滑动窗口持续更新结构化知识库。 基于 Diff(差异)的知识归类与变更检测: 在 CKM-Full 变体中,创新性地将新论文带来的知识变更为“新增”、“确认”或“矛盾”,并提取出5种核心触发信号(如桥接、聚合、趋势确认等),将“知识是如何改变的”作为生成假设的条件输入。 基于未来的时序验证协议(Temporal Validation): 采用真正的预测性验证——使用历史文献生成假设,并与生成时间点之后发表的真实学术论文进行命中率对齐。

贡献:

方法论贡献: 证明了基于时间序列的增量知识累积,是比单次大规模批处理更高效、更准确的科学发现路径。 实证发现: 在 50 个前沿 AI 研究课题上,深刻揭示了科学假设生成任务中“高新颖性”与“高预测覆盖率”之间存在的固有矛盾(Quality-Coverage Trade-off)。 工具与基准: 提供了一个经济高效的假设生成框架(CKM-Lite),并建立了一套多维度的评估指标体系,指出了当前仅看重“命中率(Hit Rate)”的单一评估方式的巨大缺陷。

提升:

效率与成本: 相比于全局批处理,CKM-Lite 将 Token 消耗降低了 92%(每生成一个 hit 仅需 40 万 Token vs 1140 万 Token)。 预测准确度: CKM-Lite 的预测命中率提升了 2.8%(p=0.006),并在12个独占领域中取得了唯一命中。 假设质量: 引入变更感知的 CKM-Full 将假设的原创性得分大幅提升了 1.44 分(10分制,Cohen’s d=3.46),并且其生成的假设相比真实论文的“时间领先量(Temporal Lead)”达到了 537 天(大幅优于 Lite 的 404 天)。

不足:

评估高度依赖 LLM 裁判: 假设的命中验证、新颖性打分和对齐度评估均依赖于 GPT-4o 等模型,缺乏真实领域人类专家的盲评(尽管作者使用了跨模型验证来缓解偏见)。 机制耦合难以剥离: CKM-Full 是一个包含差异分类、变更检测和轨迹条件化的“捆绑包”,实验未能通过消融研究精确隔离出具体是哪个单一模块导致了命中率的下降或新颖性的提升。 领域局限性: 验证的 50 个主题高度集中在快速迭代的 AI/NLP 领域(依赖大量开箱即用的 arXiv 论文),该框架在文献更新缓慢、数据封闭的传统学科(如湿实验生物学或材料科学)中的泛化能力未经测试。

心得:

重新思考“命中率(Hit Rate)”的评估陷阱: 这篇论文揭示了一个非常深刻的现象——高命中率往往意味着“平庸的正确”。大模型为了追求高命中率,会生成模糊、大颗粒度的假设。真正跨界、细节丰富的原创假设(如 CKM-Full 提出的),往往因为过于具体而难以在短期内被某篇具体的论文完美覆盖。这警示我们在设计 AI Agent 评估指标时,不能唯“Hit Rate”论,否则系统会不可避免地滑向“模式塌陷”与“空话连篇”。 时间(Time)是终极的降本增效器: 我们总以为把尽可能多的文献塞进长上下文窗口(Long Context)效果最好。但 CKM 证明,按照人类处理知识的方式——顺着时间线“增量吸收”,只关注 Delta(增量/差异),不仅能让大模型更好地抓住研究趋势,还能以不到 1/10 的算力成本实现反超。在处理海量信息时,“时间序列化的增量流”可能比“静态全景图”更符合大模型的推理机制。 科学突破的可预测性取决于“领域漂移(Drift)”: 论文指出,如果一个研究领域朝令夕改、热点频繁切换(高漂移),AI 也无法预测它的下一步;反之,如果在稳定领域出现了“多方聚合(Convergence)”信号,AI 预测的成功率会飙升。这启示我们,AI 科学家的用武之地不是去预测那些混沌、无序的前沿热点,而是去那些基础扎实、出现共识雏形的领域,精准打击尚未被填补的具体 Gap。

一句话总结:

本文提出了“连续知识代谢(CKM)”框架,通过滑动时间窗口增量处理科学文献来生成预测性假设,不仅反直觉地以降低 92% 计算成本的代价超越了传统批处理的预测命中率,更深刻揭示了科学发现中“极致的创新性必然伴随较低的短期预测覆盖率”的严酷评估悖论。

Scientific hypothesis generation requires tracking how knowledge evolves, not just what is currently known. We introduce Continuous Knowledge Metabolism (CKM), a framework that processes scientific literature through sliding time windows and incrementally updates a structured knowledge base as new findings arrive. We present CKM-Lite, an efficient variant that achieves strong predictive coverage through incremental accumulation, outperforming batch processing on hit rate (+2.8%, p=0.006), hypothesis yield (+3.6, p<0.001), and best-match alignment (+0.43, p<0.001) while reducing token cost by 92%. To understand what drives these differences, we develop CKM-Full, an instrumented variant that categorizes each new finding as novel, confirming, or contradicting, detects knowledge change signals, and conditions hypothesis generation on the full evolution trajectory. Analyzing 892 hypotheses generated by CKM-Full across 50 research topics, alongside parallel runs of the other variants, we report four empirical observations: (1) incremental processing outperforms batch baseline across predictive and efficiency metrics; (2) change-aware instrumentation is associated with higher LLM-judged novelty (Cohen's d=3.46) but lower predictive coverage, revealing a quality-coverage trade-off; (3) a field's trajectory stability is associated with hypothesis success (r=-0.28, p=0.051), suggesting boundary conditions for literature-based prediction; (4) knowledge convergence signals are associated with nearly 5x higher hit rate than contradiction signals, pointing to differential predictability across change types. These findings suggest that the character of generated hypotheses is shaped not only by how much literature is processed, but also by how it is processed. They further indicate that evaluation frameworks must account for the quality-coverage trade-off rather than optimize for a single metric.

https://arxiv.org/abs/2604.12243

4、[CL] LoSA: Locality Aware Sparse Attention for Block-Wise Diffusion Language Models

H Xi, H Singh, Y Hu, C Hooper…

[UC Berkeley]

LoSA:面向块级扩散语言模型的局部感知稀疏注意力

要点:

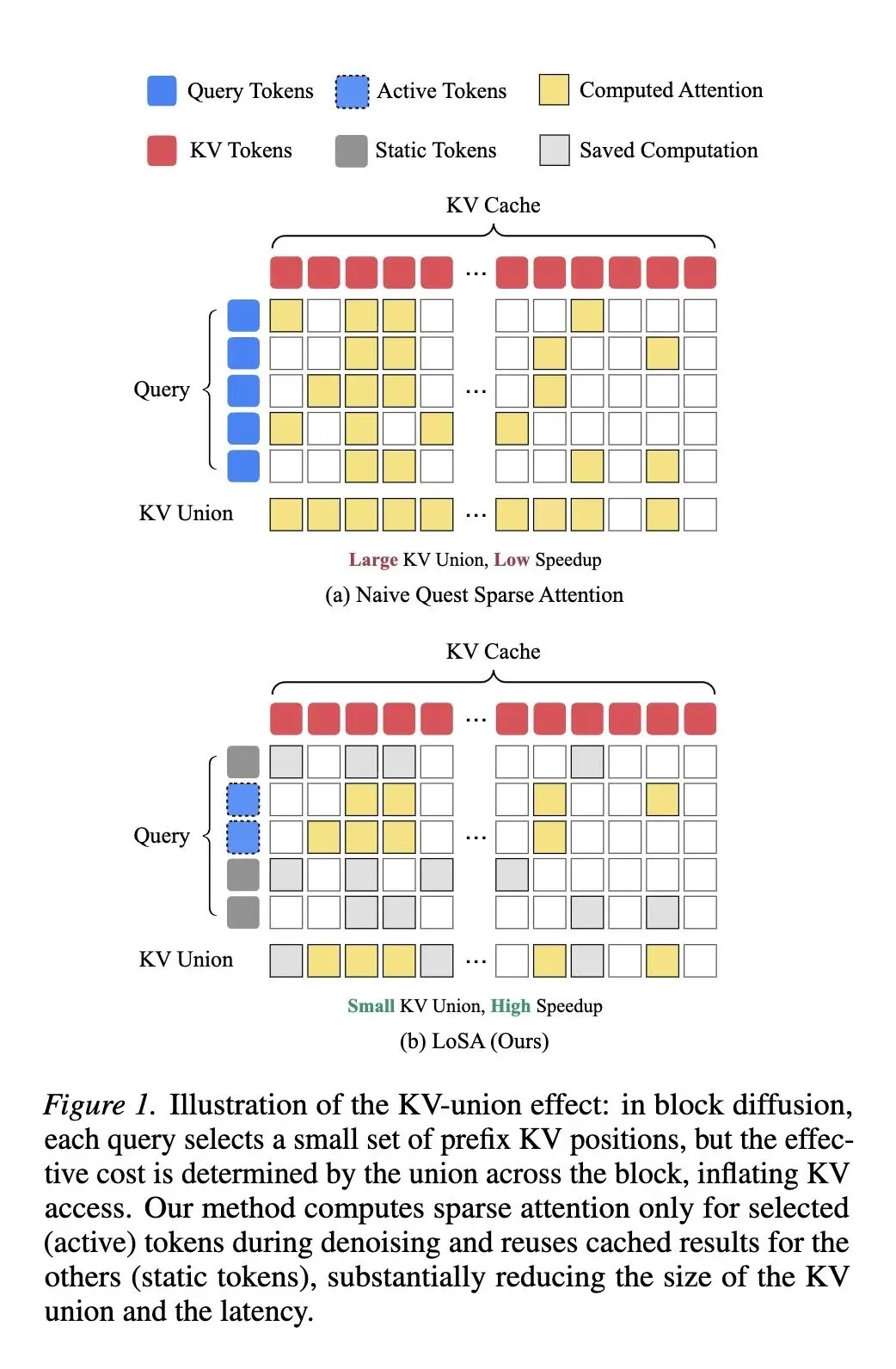

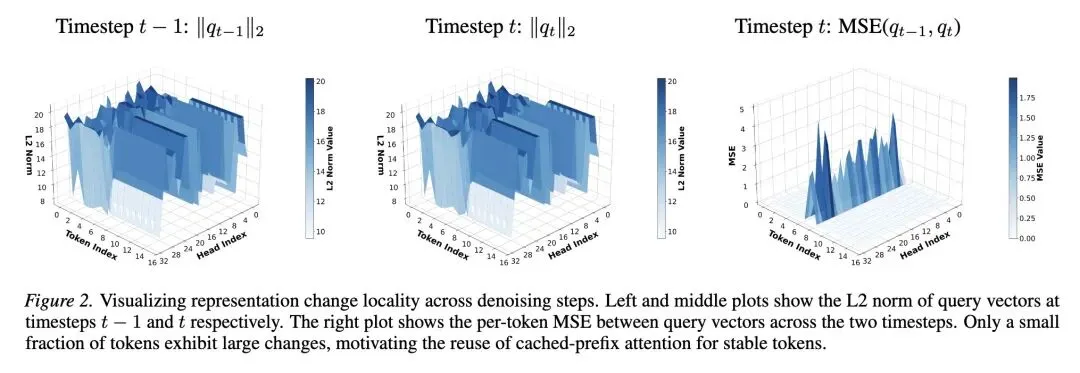

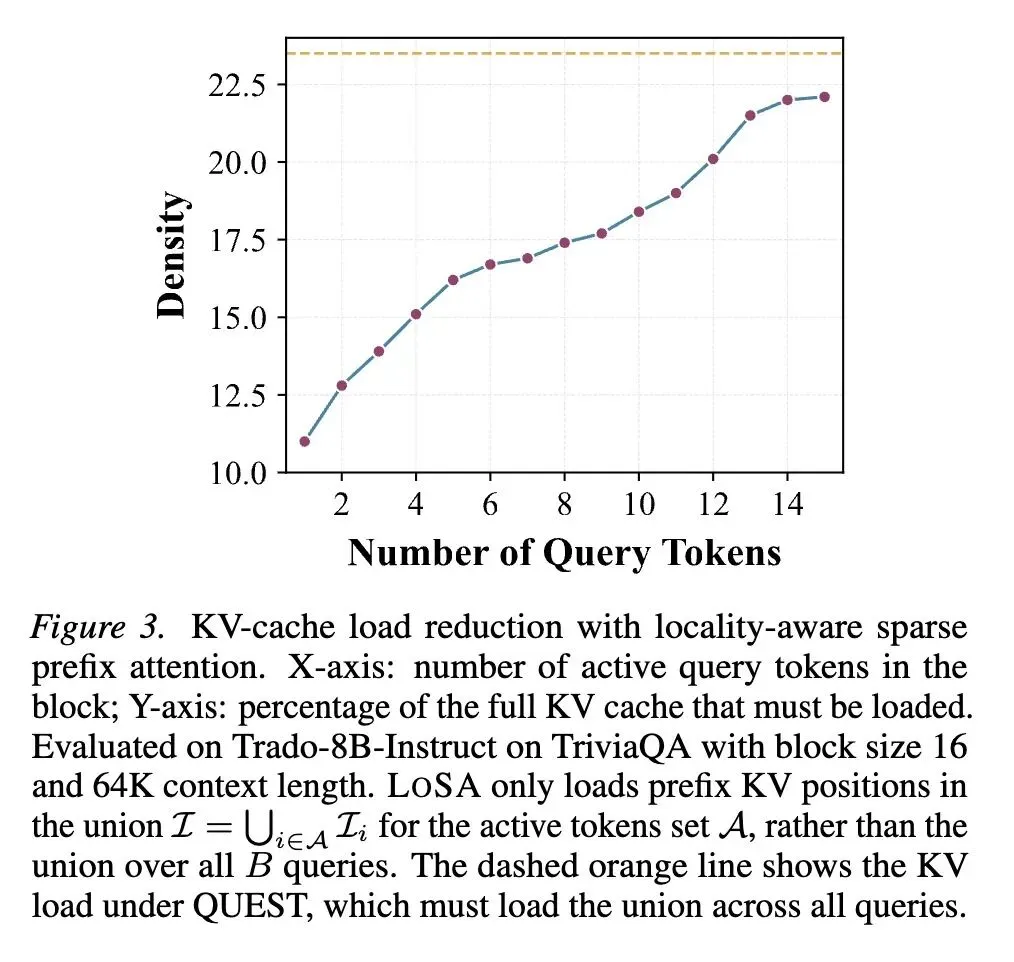

发现了块状扩散语言模型(DLM)中的“KV膨胀(KV Inflation)”问题: 直接将自回归模型中的稀疏注意力机制套用到 DLM 上会失效。因为在一个块(block)内,不同的查询(Query)会选择不同的前缀 KV 索引。注意力的内存瓶颈由这些索引的并集决定,这导致实际加载的 KV 数量急剧膨胀,抵消了稀疏化带来的加速。 反直觉的发现:“表示变化的局部性(Locality of Representation Changes)”: 在连续的去噪步骤之间,只有极小部分的 Token(称为“活跃 Token”)的隐藏状态会发生显著变化;绝大多数 Token 非常稳定,几乎保持不变。 提出 LoSA(局部性感知稀疏注意力)机制: LoSA 不再为块内的每个 Query 计算稀疏注意力,而是直接复用上一去噪步骤中“稳定 Token”的注意力输出缓存,完全跳过这些 Token 的注意力计算。 高信息熵的提效原理: 仅对极少数的“活跃 Token”进行稀疏注意力计算。这极其显著地缩小了需要加载的 KV 索引并集,直接将内存访问流量降低了 1.54 倍,从根本上解决了 KV 膨胀问题。 精度与速度的双重提升: 反直觉的是,LoSA 不仅比朴素的稀疏注意力更快,而且精度更高(在激进的稀疏度下,LongBench 平均准确率提升高达 9 分)。这是因为“稳定 Token”复用的是精确的稠密注意力结果,从而免受了稀疏 KV 选择带来的近似误差。 硬件验证的极高加速比: 在 RTX A6000 GPU 上实现了高达 4.14 倍的注意力加速,在更新的 RTX 5090 上也达到了 3.67 倍,证明该方法有效打破了长上下文 DLM 的内存带宽瓶颈。

主旨: 本文旨在解决基于块生成的扩散语言模型(Block-wise DLMs)在处理长上下文时面临的严重内存瓶颈问题。通过揭示朴素稀疏注意力在 DLM 中引发的“KV膨胀”现象,文章提出利用去噪过程中的“局部性变化”特征,大幅减少冗余计算和内存读取,从而在不损失精度的前提下极大地加速长文本生成。

创新:

首创针对块状扩散模型的局部性复用: 敏锐地抓住了扩散解码与自回归解码的根本差异,首次发现并量化了去噪步骤间 Query 表示的“局部性变化”规律。 解决并集爆炸(KV Inflation)的架构设计: 创造性地通过“将 Query 从整个块(Block)缩小为极少数活跃 Token”的方式,从数学上直接减小了所需拉取 KV 索引的并集大小。 跨步(Cross-step)精确注意力缓存机制: 提出缓存并复用上一时间步的局部对数归一化项(log-normalizer)和注意力输出,使大部分 Token 能够以 的代价获得近乎无损的全量注意力信息。

贡献:

理论贡献: 深入剖析了现有稀疏注意力机制在 DLM 上的失败原因(KV膨胀),为非自回归大模型的稀疏化指明了新方向。 算法贡献: 提出了 LoSA 算法,将“剪枝活跃 Token”、“计算活跃 Token 的稀疏前缀注意力”和“融合当前块注意力”整合为一套完整的、易于实现的加速流水线。 实证贡献: 在 Trado-8B、SDAR-8B 等多个先进模型和 LongBench 评测集上进行了全面验证,证明了该方法在准确率和实际硬件耗时上的双重压倒性优势。

提升:

显存访问量骤降: 相比朴素 QUEST 方法,LoSA 的 KV Cache 密度(实际加载的 Token 比例)平均降低了 1.54 倍。 极端稀疏下的精度挽回: 在每个 Query 仅允许检索 128 个 KV Token 的极端限制下,朴素方法精度崩溃(31.54%),而 LoSA 成功将精度拉回到 41.97%(提升超过 10 分),几乎媲美全量稠密注意力(44.86%)。 极高的墙上时钟加速比: 在 64K 上下文、块大小 16 的场景下,相比于标准稠密注意力,实现了 4.14 倍的端到端运算加速。

不足:

短上下文场景收益微弱: 当上下文较短(< 1K tokens)时,因为整个 KV 缓存本身就很小,KV 膨胀问题并不严重,LoSA 带来的加速和精度提升并不明显,且引入的局部性评估等额外开销反而可能拖累性能。 缺乏批处理(Batched Serving)验证: 当前实验主要集中在 Batch Size = 1 的场景,尚未与 vLLM、TensorRT-LLM 等主流的动态批处理推理引擎进行深度集成与测试。 首步(Step 0)存在固有开销: 在每个生成块的第一个去噪步骤,没有历史缓存可用,必须退化为进行一次完整的全量(或朴素稀疏)注意力计算,这带来了无法避免的初始化固定开销。

心得:

不同生成范式的“水土不服”: 将自回归领域大放异彩的算法(如 QUEST)直接平移到扩散模型上,由于并行生成的“并集效应(KV Inflation)”,反而成了累赘。这警示我们,新架构(如非自回归、扩散语言模型)亟需深入底层计算逻辑去定制优化,盲目“拿来主义”在系统底层往往行不通。 “懒惰”是提效的最高境界: LoSA 的核心智慧极度反直觉——既然大部分 Token 在去噪时几乎没怎么变,干脆什么都不算,直接拿上一步的结果抄作业。这比任何精妙的稀疏算法都管用,因为“不计算”就是最快的计算。 因祸得福的近似容错机制: 非常有趣的是,LoSA 这种为了省计算力而“抄作业”的行为,反而保护了那些稳定 Token,让它们免受了稀疏检索带来的信息丢失。这揭示了一个绝佳的工程设计哲学:好的近似算法,不仅要在“算得准”的地方花力气,还要利用系统固有的惯性,在“不用算”的地方完美保留原始精度。

一句话总结:

针对块状扩散语言模型(DLMs)在长文本推理中遭遇的“KV膨胀”内存瓶颈,本文巧妙捕捉到去噪步骤间仅极少数 Token 会发生显著变化的“局部性”特征,提出 LoSA 算法通过复用稳定 Token 的历史注意力结果,仅对活跃 Token 进行稀疏计算,从而以反直觉的方式同时实现了超过 4 倍的推理加速与极端稀疏下的巨大精度回升。

Block-wise diffusion language models (DLMs) generate multiple tokens in any order, offering a promising alternative to the autoregressive decoding pipeline. However, they still remain bottlenecked by memory-bound attention in longcontext scenarios. Naïve sparse attention fails on DLMs due to a KV Inflation problem, where different queries select different prefix positions, making the union of accessed KV pages large. To address this, we observe that between consecutive denoising steps, only a small fraction of active tokens exhibit significant hidden-state changes, while the majority of stable tokens remain nearly constant. Based on this insight, we propose LOSA (Locality-aware Sparse Attention), which reuses cached prefix-attention results for stable tokens and applies sparse attention only to active tokens. This substantially shrinks the number of KV indices that must be loaded, yielding both higher speedup and higher accuracy. Across multiple block-wise DLMs and benchmarks, LOSA preserves near-dense accuracy while significantly improving efficiency, achieving up to +9 points in average accuracy at aggressive sparsity levels while maintaining 1.54× lower attention density. It also achieves up to 4.14× attention speedup on RTX A6000 GPUs, demonstrating the effectiveness of the proposed method.

https://arxiv.org/abs/2604.12056

5、[LG] The Linear Centroids Hypothesis: How Deep Network Features Represent Data

T Walker, A I Humayun, R Balestriero, R Baraniuk

[Rice University & Google Research & Brown University]

线性质心假设:深度网络特征如何表征数据

要点:

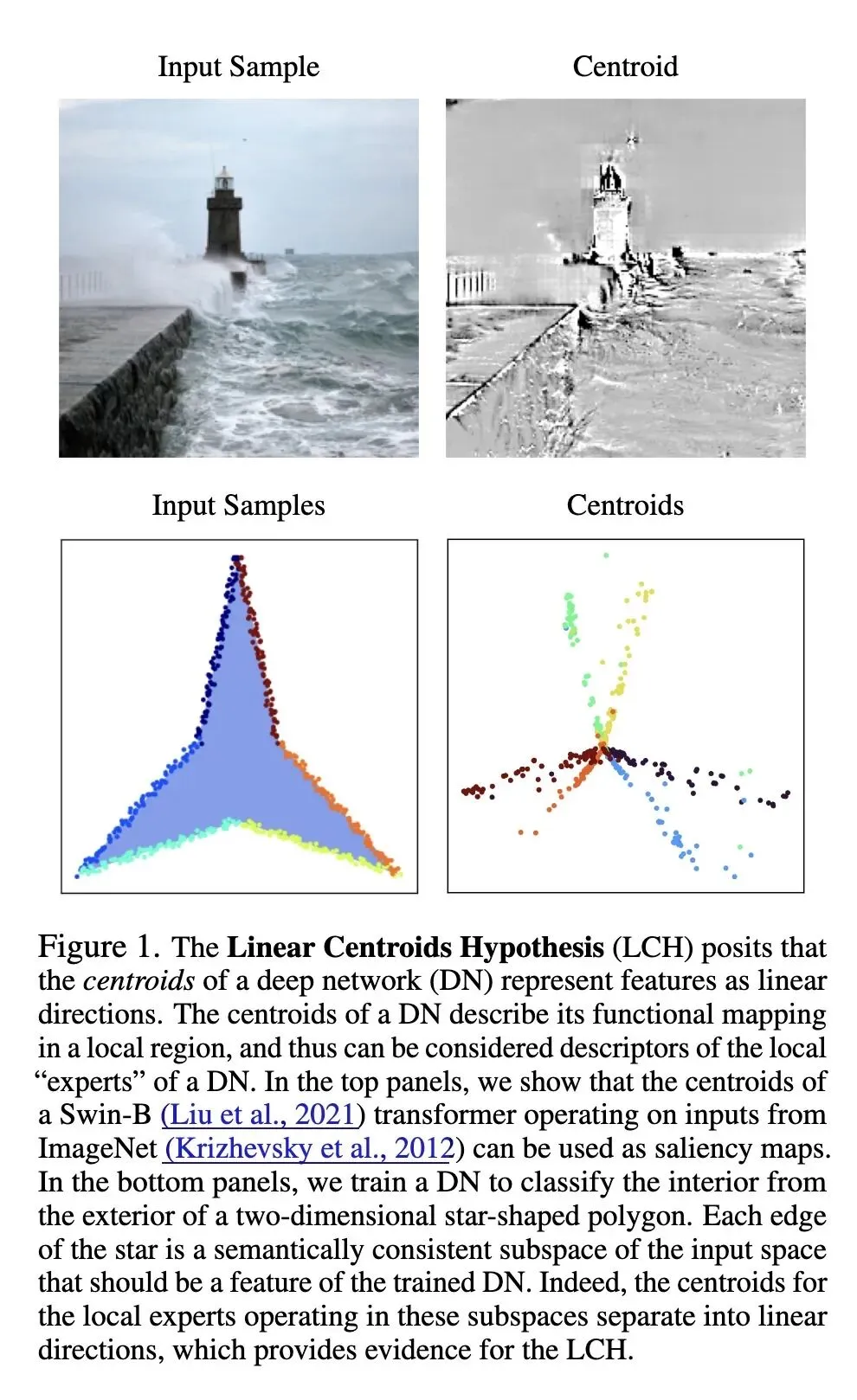

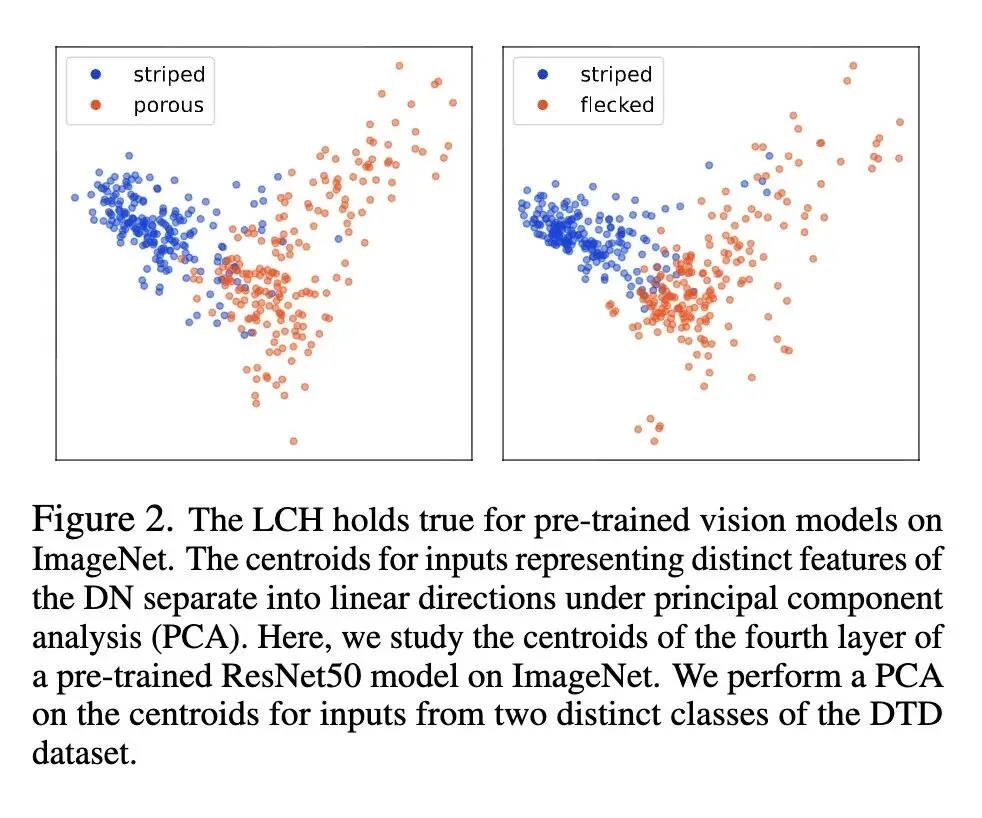

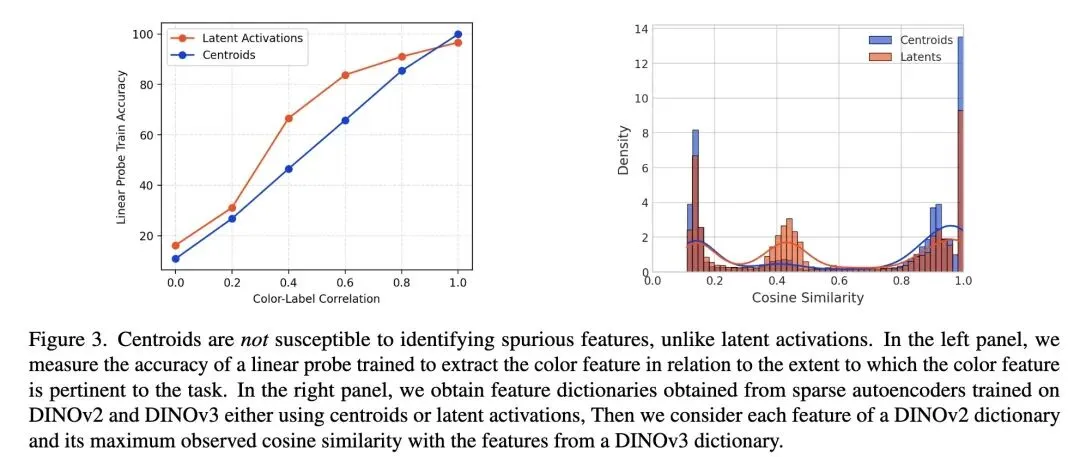

对线性表示假说(LRH)的批判: 指出现有解释性研究的核心假设 LRH(认为特征是隐层激活空间中的线性方向)存在根本缺陷:它脱离了具体的网络子组件,极易识别出伪特征(虚假特征),并且难以跨多层应用。 提出线性质心假说(LCH): 提出了一种全新框架,认为深度网络(DN)的特征不应由隐层激活定义,而应由网络将输入空间划分成的功能区域(局部“专家”)的质心(Centroids)来定义。特征对应于这些质心所形成的线性方向。 基于幂图(Power Diagrams)的数学基础: 利用样条逼近理论,说明连续分段仿射(CPA)网络将输入空间划分为幂图细分。对于任何可微的网络组件,这些分区的质心可以通过输入-输出雅可比矩阵(Jacobian)的行和(row-sum)来高效计算。 对伪特征的鲁棒性: 实证表明,隐层激活即使面对与任务无关的随机噪声(伪特征)也会形成线性方向;但质心只有在特征真正被网络计算所“利用”时,才会形成线性方向,从而彻底排除了伪特征。 现有解释性工具的完美平替: 证明在稀疏自编码器(SAE)中,只需将输入从“隐层激活”替换为“质心”,就能得到更稀疏、语义更连贯的特征字典,且在下游任务迁移和未知数据激活上表现更好。 高效的回路发现(Circuit Discovery)与探测(Probing): LCH 提供了一种新的基于梯度的归因指标,可以快速过滤掉无关神经元(如在 GPT2-Large 中),无需进行详尽的消融实验。基于质心训练的线性探测器(在 Llama-3.1-8B 真实性数据集上)的泛化能力也显著优于基于激活的探测器。 作为显著性图的“局部质心(Local Centroids)”: 引入了“局部质心”(在输入点周围小邻域内平均质心)作为一种高度忠实于模型的基于梯度的显著性图,它能直观突出网络局部专家实际使用的输入特征,克服了标准梯度方法经常通不过“健全性检查(sanity checks)”的弊端。

主旨: 本文旨在解决深度神经网络(DNN)机制可解释性中的核心问题:网络究竟是如何提取和表示特征的?作者挑战了当前主流的“线性表示假说(LRH)”,提出了一种更具机制性和几何基础的新框架——“线性质心假说(LCH)”。LCH 将解释性的焦点从“输入在隐层空间中的位置”转移到“网络如何通过局部专家(质心)对输入进行函数映射”,从而为特征识别、回路发现和模型可视化提供了一个统一且更可靠的基础。

创新:

视角的根本转换(激活 雅可比质心): 放弃了对前向传播激活值的依赖,创新性地将特征定义为网络局部线性近似区域的几何质心(计算上等价于输入输出的雅可比向量积)。 统一几何框架: 首次将特征字典(SAEs)、线性探测(Probing)、回路发现(Circuit Discovery)和显著性图(Saliency Maps)统一在“网络诱导的输入空间分区(幂图细分)”这一个数学/几何对象下。 局部质心显著性图: 提出了一种全新的显著性图构造方法——局部质心(Local Centroid),它通过平均输入邻域的雅可比行和,直接反映模型决策的局部敏感性,且对未训练模型不产生误导性结果。

贡献:

理论贡献: 提出了 LCH,从理论上(结合样条逼近和幂图细分)解释了为什么质心的线性方向比激活值的线性方向更能真实反映网络提取并“利用”的特征。 方法论贡献: 提供了一种对伪特征免疫的解释性框架。证明了 LCH 可以直接无缝接入现有的 LRH 工具链(如直接用质心训练 SAE)。 实践贡献: 在 DINO 视觉Transformer、GPT2-Large 和 Llama-3.1-8B 等前沿大模型上成功验证了 LCH 的有效性,提出了高效的神经元过滤归因公式,大大降低了寻找大模型回路的计算成本。

提升:

特征字典质量: 在 DINOv2 上的实验表明,基于质心训练的 SAE 提取的特征在语义上更加连贯(如完美区分“带黑字的白高尔夫球”),且在 ImageNet 子集上的特征命中率和下游探针准确率均高于传统方法。 探测器泛化性: 在大语言模型(Llama)的真实性探测任务中,质心探针的跨数据集泛化准确率明显优于激活探针(曲线更平缓、准确率更高)。 回路发现效率: 通过质心归因公式计算 GPT2 的神经元敏感度,可将特定任务(如预测不定冠词“an”)的关键神经元瞬间锁定在 Top 99.8% 的极小范围内,免去了海量消融实验。

不足:

计算成本增加: 尽管雅可比向量积(JVP)比计算完整雅可比矩阵快,但提取质心仍比直接提取前向激活值多消耗约 10% 到 15% 的计算时间。 忽略了“半径”参数: 幂图细分由“质心”和“半径”共同参数化,本文完全聚焦于质心,未探讨半径(决定质心是否落在其自身区域内)对解释性的潜在价值,可能丢失了部分几何信息。 局部显著性图的泛化验证有限: 提出的“局部质心”显著性方法虽然在视觉模型上效果惊艳,但目前尚未在更广泛的网络架构或文本/离散输入分布上进行充分的对比评估。

心得:

“它到底做了什么”比“它目前在哪”更重要: 现有的可解释性研究(如用 SAE 拆解激活空间)往往只关心输入在隐层高维空间中的坐标位置(激活值),但这极易受到输入噪声的干扰(伪特征)。LCH 的高明之处在于,它通过求导(雅可比矩阵)去观察模型在这个局部区域内的“行为动作(斜率/函数映射)”。看一个人(模型)的本质,不要看他处于什么位置,而要看他的行为倾向(梯度/质心)。 数学之美的降维打击: LCH 将深度神经网络极其复杂的非线性黑盒,优雅地解构为输入空间中无数个连续的“局部线性专家(分段仿射)”。一旦你接受了这个设定,所有晦涩的解释性问题,瞬间就变成了高中几何题——特征不过是这些局部专家在空间里的对齐与排列。这种基于第一性原理的数学拆解,往往比后验的统计观察(如聚类激活值)更加扎实。 大浪淘沙,挤掉解释性的泡沫: 论文揭示了一个令人不安的事实:我们目前用各种高大上的 SAE 跑出来的大模型特征字典中,很可能充斥着大量根本没被模型实际用于计算的“伪特征”(只是前向传播时的副产品)。LCH 提供了一把极其锋利的剃刀,通过检验质心是否共线,无情地切除了这些虚假的解释性泡沫,这为走向真正的人工智能“机械可解释性(Mechanistic Interpretability)”迈出了坚实的一步。

一句话总结:

本文通过提出“线性质心假说(LCH)”,将深度神经网络可解释性的基石从容易受骗的“隐层激活值”转移到了代表网络局部专家行为的“雅可比质心”上,不仅从根本上排除了伪特征的干扰,更为特征字典提取、回路发现和显著性图生成提供了一个统一、更具因果性和更高质量的几何框架。

Identifying and understanding the features that a deep network (DN) extracts from its inputs to produce its outputs is a focal point of interpretability research. The Linear Representation Hypothesis (LRH) identifies features in terms of the linear directions formed by the inputs in a DN’s latent space. However, the LRH is limited as it abstracts away from individual components (e.g., neurons and layers), is susceptible to identifying spurious features, and cannot be applied across sub-components (e.g., multiple layers). In this paper, we introduce the Linear Centroids Hypothesis (LCH) as a new framework for identifying the features of a DN. The LCH posits that features correspond to linear directions of centroids, which are vector summarizations of the functional behavior of a DN in a local region of its input space. Interpretability studies under the LCH can leverage existing LRH tools, such as sparse autoencoders, by applying them to the DN’s centroids rather than to its latent activations. We demonstrate that doing so yields sparser feature dictionaries for DINO vision transformers, which also perform better on downstream tasks. The LCH also inspires novel approaches to interpretability; for example, LCH can readily identify circuits in GPT2-Large. Code to study the LCH can be found here.

https://arxiv.org/abs/2604.11962

夜雨聆风

夜雨聆风