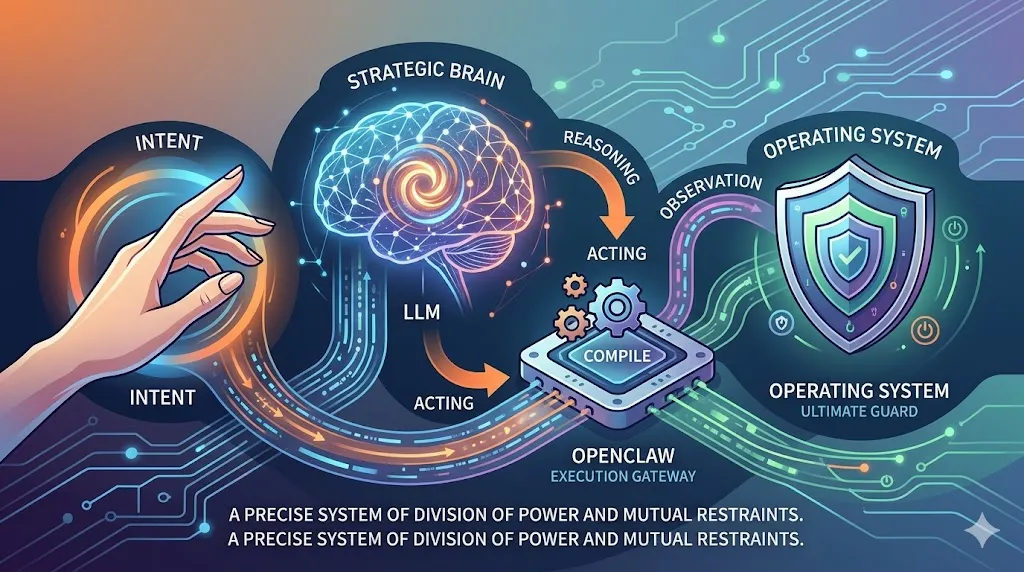

人、大模型、OpenClaw 与操作系统:AI 执行代理的权限制衡体系

真正的智能,不在于让 AI 能做什么,而在于人类清醒地决定让它做什么,以及绝不让它做什么——因为操作系统不会判断对错,它只会精确执行每一个被授权的指令,包括错误。

在 AI 智能体(AI Agent)技术迅猛发展的今天,像 OpenClaw 这样的开源本地执行框架,正从开发者工具走向普通用户桌面。它运行在你的电脑上,通过 飞书、钉钉、微信等常用聊天应用与你交互,能真正执行任务(如整理文件、发送邮件、管理日程)。要理解它的能力边界、安全风险与使用哲学,关键在于厘清四个核心角色:人(用户与开发者)、大语言模型(LLM)、OpenClaw 本身,以及操作系统(OS)。

这四者构成了一套精密的分权与制衡系统——缺一不可,又各司其职。忽视任何一环,都可能导致对 AI 能力的误判,或对安全风险的低估。

一、人:意图的起点与责任的终点

一切始于人。

无论是普通用户说一句“帮我把上周的发票整理到 Excel”,还是开发者编写自动化脚本,人始终是任务意图的发起者。更重要的是,人也是最终的责任承担者。

AI 可以犯错,但人不能免责。当 OpenClaw 误删文件、泄露凭证,或被诱导执行不当指令时,法律与伦理的问责对象永远是运行它的人。因此,使用 OpenClaw 不仅需要信任,更需要清醒的权限意识。

对开发者而言,人是“架构师”:设计和审核 Skill(技能插件)、配置安全策略、遵循最小权限原则。对普通用户而言,人是“授权者”:是否允许访问下载文件夹?是否允许控制浏览器?每一次授权,都是在向 AI 开放一部分数字世界的控制权。

二、OpenClaw:本地网关与执行协调者

OpenClaw 远不止是一个简单的 LLM 插件,而是连接意图理解与实际执行的关键中介层。它是一个运行在用户态的本地网关进程与轻量控制平面,扮演着“意图路由器”和“执行协调者”的双重角色,而非系统级控制器。

1. 意图路由器(Intent Router):

通过 Channel Adapters 规范化来自飞书、钉钉、微信等应用的输入后,进入 routing 与 session 层。它会判断意图复杂度:这种机制本质上类似于规则优先 + 大模型回退的混合决策架构(rule-first with LLM fallback)。

• 快路径:对于简单、明确的指令(如“静音”“清理垃圾”),可通过预设规则或直接 Skill 调用快速处理,减少延迟; • 慢路径:对于模糊或复杂的任务(如“根据这些发票写周报”),则转发给大模型进行深度推理。 2. 执行协调者与安全层:

OpenClaw 会收集必要的本地上下文(文件状态、当前窗口等,受权限限制),并在数据处理中进行基础的安全检查。它解析大模型输出的结构化计划,然后转化为具体的应用调用或系统调用,最终交由操作系统在权限约束下执行。

这种“先路由、后协调”的机制,让 OpenClaw 成为连接人类意图与真实操作的高效中介,同时也是重要的安全缓冲区。

三、大语言模型:战略大脑,但无手脚

大模型(如 Qwen、Llama 3、GPT-4o、Claude 等)是系统的“认知引擎”。它擅长:

• 理解自然语言指令; • 将复杂目标拆解为可执行步骤; • 在遇到问题时进行推理与重试; • 跨领域调用不同工具。

但它有一个根本局限:不具备原生执行能力,必须通过外部系统(如 OpenClaw)间接作用于现实世界。它不了解不同操作系统的具体执行细节,无法直接感知网页是否真实加载完成,也可能产生幻觉(hallucination)。

因此,大模型只是战略规划者。它的输出需要 OpenClaw 翻译成结构化的行动计划,最终在操作系统的权限约束下,通过具体应用程序或底层系统调用逐层落地执行。

四、操作系统:物理世界的最终守门人

无论 AI 的规划多么精妙,所有操作最终都必须经过操作系统的权限验证并落地执行。

OS 只认权限:

• 它通过用户权限模型、沙箱、TCC(macOS)等机制,严格限制进程的行为边界; • AI 的实际能力上限,由操作系统授予的权限决定。以普通用户身份运行 OpenClaw,它就无法修改系统文件;在 Docker 容器中隔离运行,它就无法随意访问主机设备。

在实际执行路径中,操作往往通过具体应用程序、命令行工具或运行时环境间接完成,但这些行为最终仍需接受操作系统的权限校验。

此时,最关键的最后一道防线,正是 OS 对 OpenClaw 进程的权限限制——即使 AI 被诱导试图访问 ~/.ssh,若权限不足,操作也会在 OS 层直接失败。

五、四者的协作闭环

OpenClaw 的典型工作流程构成了一个完整的 Agent 生命周期(基于 ReAct 风格的循环,即“推理—行动—观察”的迭代过程,并支持更多高级模式):

1. 用户 发起请求(通过聊天应用输入 Prompt); 2. OpenClaw(路由与预处理):规范化输入,判断路径;必要时收集上下文并进行基础安全检查。若走慢路径,则发送给大模型; 3. 大模型(决策):生成结构化的行动计划; 4. OpenClaw(执行协调):解析计划,转化为具体应用调用或系统调用(受 Skill 权限限制); 5. 操作系统:验证权限 → 执行操作(或拒绝)→ 返回观察结果(Observation); 6. OpenClaw & 大模型:根据结果循环推理,直至任务完成或失败; 7. 用户:接收最终结果,并可随时干预、调整权限或审核日志。

这是一个动态闭环,而操作系统是其中直接对接实际执行环境并实施最终权限裁决的关键节点。

六、安全启示:权限即权力

OpenClaw 的最大风险,不在于 AI 产生“自我意识”,而在于权限授予的随意性。以管理员权限运行它,相当于把电脑钥匙交给一个可能受提示注入影响的进程。

1. 警惕提示注入(Prompt Injection)

恶意网页、邮件或对话中隐藏的指令,可能诱导 AI 执行危险操作(如上传文件)。其本质是将“数据输入”伪装为“控制指令”,从而突破模型的意图边界。OpenClaw 提供了一定防护,但最终仍依赖用户配置。

2. 权限分级原则(Human-in-the-Loop)

• 低风险:自动执行(如搜索、读取公共信息); • 中风险:需通知或确认(如修改文件、发送邮件); • 高风险:严格人工确认或禁用(如删除操作、网络外联、金钱交易)。

最佳实践

• 永远不要以管理员(root/Administrator)权限运行 OpenClaw; • 使用 Docker、firejail 或类似工具隔离运行环境; • 为每个 Skill 明确声明所需权限,严格遵循最小特权原则; • 对敏感操作启用人工确认,并定期审查日志和授权记录; • 默认拒绝所有未显式授权的能力(Deny by Default); • 充分利用 OpenClaw 的开源特性:审查代码、自定义安全规则。

结语:AI 不是神,而是受控的工具

OpenClaw 是将人类意图高效转化为系统操作的开源中介机制。它的强大,源于大模型的理解力、操作系统的执行约束、开源社区的透明性,以及人对它的信任与谨慎授权。

在 Agentic Workflow(智能体工作流)时代,真正的智能,不是让机器替我们思考,而是让我们更清醒地利用操作系统的权限模型为 AI 划定疆界。权限是 AI 的缰绳(由操作系统强制执行),而逻辑与审核是人类的栅栏(由 OpenClaw 与用户共同构建)。守住这两点,AI 才能成为你最可靠的助手。

夜雨聆风

夜雨聆风