#算电协同##AI算力##液冷散热##储能# #电网设备##科技科普

2026年3月,全国两会《政府工作报告》首次将"算电协同"纳入国家战略。这是继"数字中国"之后,又一个横跨科技与能源的国家级部署。AI算力需求年均45%增速,而电网扩张速度只有3%-5%。这条裂缝,正在越来越大。

一、算电协同到底是什么?

简单说:算电协同,就是让"算力"(AI计算能力)和"电力"(能源供给系统)从各自发展,变成"双向融合"。

算力需要电力支撑,电力需要算力优化。这不是一个单纯的技术概念,而是横跨能源基础设施、数字基础设施的国家战略设计。

为什么这个时候提出?

2025年中国数据中心用电量达1933亿度,占全社会用电量1.9%,同比增速17% 国际能源署预测:到2030年全球数据中心耗电量将超过日本全国年用量,较2024年翻倍增长 AI算力需求年均增速45%,而电网扩张速度只有3%-5%

算电协同要解决三个核心痛点

- 痛点一:

AI耗电暴增,电网承压 - 痛点二:

绿电消纳困难,弃风弃光率高 - 痛点三:

算力布局与电力供给错配(西部有绿电,东部有算力需求,中间缺传输)

二、算电协同的两大核心方向

方向一:电力支撑算力——"算力跑多快,电力跟得上"

核心逻辑:AI集群的算力上限,不取决于GPU的数量,而取决于能供给多少电。

一个百万人口城市的年用电量,约等于一座10万平方米数据中心的年用电量。

具体需求:大型变电站 → 液冷散热 → 备电储能 → HVDC供电。

方向二:算力赋能电力——"让电网更聪明"

AI可以大幅提升电力系统的运行效率和预测能力:

AI电网调度(实时预测负荷,优化发电与输电) 数字孪生电网(用算力模拟整个电网运行状态) 虚拟电厂(AI聚合分布式能源,参与电力市场交易) 电力设备故障预测(机器学习提前发现变压器、线路隐患)

三、算电协同催生哪些技术和设备需求?

设备一:液冷散热系统——算力密度突破的关键

图:AI数据中心液冷服务器 · 每100P算力需约5MW散热配套,PUE可降至1.04以下

AI芯片功耗远超传统CPU。一个英伟达H100 GPU,TDP(热设计功耗)为700W;一个GB200 NVL72机柜,满载功率高达120千瓦,相当于一个小型工厂。

传统风冷已无法应对——液冷是唯一选择:

- 冷板式液冷

:直接接触芯片散热,热效率比风冷高10-50倍 - 浸没式液冷

:服务器整体浸入绝缘冷却液,PUE可降至1.04以下 - 氟化液

:不易燃、不导电,适合高功率数据中心

2027年AI服务器机架电力需求,将比2022年传统云服务器机架高出50倍——液冷是唯一能匹配这个密度需求的散热方案。

设备二:储能系统——绿电稳定的"调峰器"

图:大型光伏+储能联合电站 · 解决绿电"看天吃饭"问题 · 西部绿电大基地标配

风电、光伏"看天吃饭",大规模并网时,电网需要"削峰填谷"。储能就是干这个的。

算电协同场景下,储能需求被进一步放大:

- 数据中心配储:

大型AI数据中心配置储能,既是备用电源,又可参与电网调峰 - 绿电+储能联合运行:

西部大型风电光伏基地配储能,解决"弃风弃光"问题 - 虚拟电厂:

分布式储能聚合,由AI统一调度,参与电力市场

按1GW算力配储4-6GWh计算,中国未来三年智算中心建设将带动储能需求约200GWh——这是一个全新的蓝海市场。

设备三:HVDC高压直流供电——最适配AI数据中心的配电方案

为什么HVDC比传统交流电更适合AI数据中心?

传统数据中心用交流电,但服务器内部需要整流(AC→DC)再供给芯片,多一次转换,多一次损耗。

HVDC直接供给直流电,减少转换损耗,提升供电效率约5%-10%,且更易与储能和光伏直流侧对接。目前华为、维谛等厂商已推出成熟方案,加速替代传统UPS。

设备四:电力芯片与继电保护——被忽视的"卡脖子"环节

这是算电协同中最容易被忽视,但技术壁垒极高的环节。

电力系统运行的"神经系统"是电力芯片——继电保护芯片、计量芯片、通信芯片。这些芯片决定电网能否安全、稳定地运行。

过去的痛点:核心芯片大量依赖进口,存在"卡脖子"风险。

现在的进展:国家电网旗下智芯微电子已实现大规模国产化替代,但在高端IGBT等功率器件上仍有差距。

设备五:大型变压器——最直接的"算电接口"

AI数据中心建设,第一步就是申请专用变压器接入电网。一座大型AI数据中心,需要数十兆瓦的专变容量。

四、亟待攻克的技术和设备有哪些?

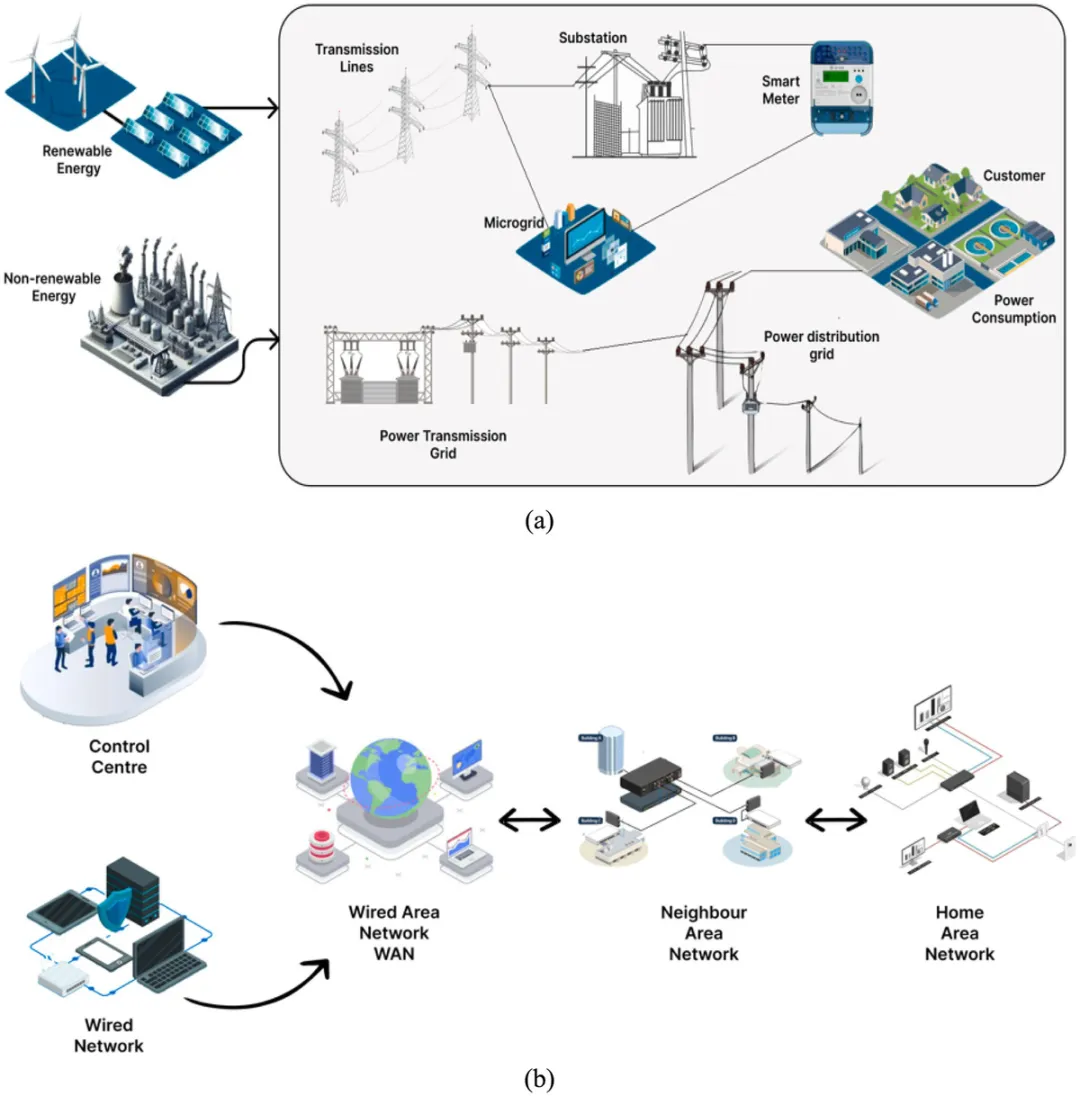

图:AI赋能的智能电网数字孪生 · 实时模拟电网运行状态 · 实现跨区域电力最优调度

瓶颈一:国产GPU算力——最核心的"卡脖子"

2025年中国AI加速卡出货约400万张,国产厂商拿下约四成份额,但整体需求缺口仍高达66%。突破方向:先进制程(3nm及以下)、高带宽存储(HBM)、片间互联技术。

瓶颈二:高压功率半导体(IGBT/SiC)——电力系统的"心脏"

液冷散热、HVDC配电、储能PCS(储能变流器),核心功率器件都是IGBT或SiC MOSFET。国产在高压大电流场景下仍有不足。突破方向:SiC晶圆国产化、8英寸SiC衬底、国产IGBT模块可靠性提升。

瓶颈三:液冷工质(氟化液)——浸没式液冷的核心材料

全球能生产氟化液用于数据中心的厂商主要集中在3M(美国)、苏威(比利时)等少数几家。国产氟化液正在突破,但纯度和稳定性仍有差距。

瓶颈四:HVDC核心功率模块——配电系统的"心脏"

HVDC功率模块需要高压大功率电力电子技术。国内在高压(3kV以上)功率模块上,与ABB、Siemens等国际巨头仍有差距。

瓶颈五:电网智能调度AI——让全国电力"一张网"运行

AI驱动的实时电力调度,需要打通数据、模型、系统三层。不仅是技术问题,更是制度问题——电力市场改革与AI技术同步推进,才能真正实现算电协同。

五、算电协同产业链六环节

| ①绿电供给 | |

| ②高效传输 | |

| ③智能调度 | |

| ④算力承载 | |

| ⑤节能降耗 | |

| ⑥市场交易 |

这六个环节相互耦合——任何一个环节的短板,都会成为整个系统的瓶颈。

徐老师总结

① 算电协同写入2026年政府工作报告,是国家战略层面的重大部署。背后是AI算力年均45%增速,与电网扩张3%-5%增速之间越来越大的裂缝。

② 算电协同有两大方向:电力支撑算力(电力跟得上算力的扩张),与算力赋能电力(AI让电网更高效、更智能)。

③ 算电协同催生五大设备需求:液冷散热系统、大型储能、HVDC配电系统、电力芯片与继电保护、大型变压器。

④ 五大亟待攻克的瓶颈:国产高端GPU、高压功率半导体(IGBT/SiC)、液冷工质氟化液、HVDC功率模块、电网智能调度AI。

⑤ 算电协同的本质,是一场基础设施的协同进化。谁能同时解决"电力供得上"和"算力用得好"两个问题,谁就掌握了AI时代的能源话语权。

(注:本文为科技科普文章,不涉及任何公司或投资建议)

夜雨聆风

夜雨聆风