AI视频大片的核心秘密:为什么你的AI视频看起来像PPT?

前几天我一个朋友兴冲冲地跟我说,他用某款AI视频工具做了一条"大片",结果发到群里被群友无情吐槽:"兄弟,这不就是PPT加了个自动播放吗?"

他很委屈。他觉得自己的AI视频已经够酷炫了——画面在动,镜头在转,台词也有。为什么就是不够"大片"?

这个问题我思考了很久,也观察了市面上大量的AI视频作品,终于发现了一个扎心的真相:大部分人的AI视频之所以看起来廉价,不是因为AI不够强,而是因为他们根本不懂视频创作的基本原理。

你以为AI能替你搞定一切?醒醒吧,少年。

01 为什么你的AI视频看起来像自动播放的PPT?

我见过太多人用AI做视频的流程是这样的:打开工具,输入"一个帅哥在海边跑步,夕阳西下",然后等着AI生成10秒视频,最后把几段视频拼接起来,加个背景音乐,导出。

这套流程有没有问题?

问题大了。

你仔细想想,电影院里那些让你肾上腺素飙升的大片,是靠什么撑起来的?是台词吗?是画面自动播放吗?

当然不是。

是靠运镜——推、拉、摇、移、跟、升降,每一种镜头运动都带着情绪和节奏。

是靠景别——全景交代环境、中景展现互动、近景传递情感、特写捕捉细节。大片从来不会一个景别打天下。

是靠光影——逆光制造氛围、侧光勾勒轮廓、顶光烘托压迫感。光不对,再好的场景也是一盘散沙。

是靠色调——冷色调营造压抑、暖色调传递温情、对比色制造冲突。色调不对,整个视频的气质就垮了。

是靠音效——不是随便找个BGM就完事了,好的音效设计是画面的第二灵魂。

是靠情绪——所有这一切,最终都要服务于情绪的传递。

你把这些都扔给AI,让AI自己猜,那AI大概率会给你一个"还不错但就是哪里不对"的视频。这不是AI的错,是你的错。谁让你把导演的活儿全甩给AI了?

AI是工具,不是导演。你才是导演。

02 六大核心要素,缺一不可

让我来跟你拆解一下,真正的大片感是怎么来的。

第一,运镜。

别小看这俩字。运镜是视频区别于图片的核心要素。

同样是拍一个人站在天台,"固定镜头"和"缓慢推进的镜头"传递的情绪完全不一样。前者是旁观,后者是聚焦。AI视频工具现在基本都支持运镜控制,但你得学会用。

学会用"推镜头"制造紧张感,用"拉镜头"制造疏离感,用"摇镜头"制造巡视感,用"环绕镜头"制造包围感。

你要是只会"随机运镜",那就别怪你的视频像PPT。

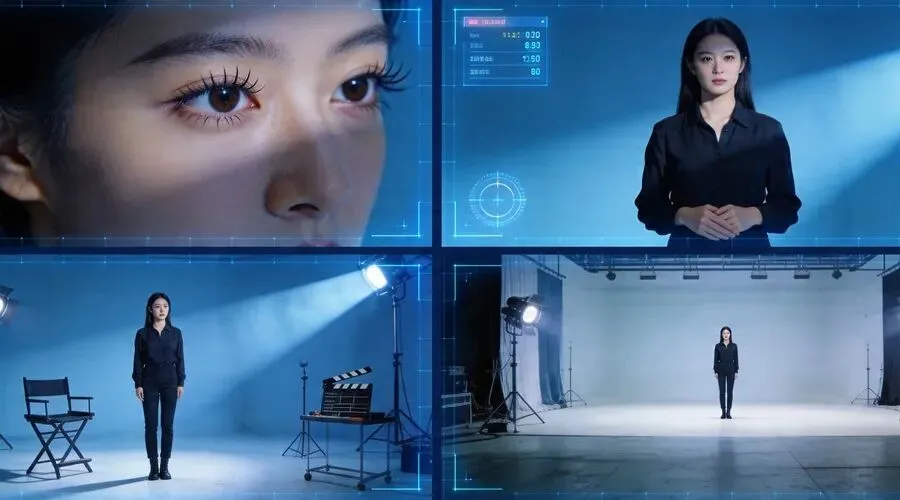

第二,景别。

近景看表情,中景看互动,远景看环境,特写看细节。

一部两分钟的视频,如果从头到尾只有一个景别,那看起来就像是一张会动的照片。大片之所以是大片,就是因为它会不断切换景别,让观众始终保持视觉新鲜感。

用AI做视频的时候,要有意识地规划景别序列。开头用全景建立世界观,中间用中景推进叙事,高潮用近景和特写放大情绪。

第三,光影。

摄影是光影的艺术,这句话放到AI视频领域同样适用。

"阳光下的女孩"和"逆光中的女孩",虽然描述差不多,但光影不同,整个画面的情绪就完全不同。前者是明媚,后者是诗意。

学会指定光线方向、光线质感(硬光/软光)、光线色温(暖光/冷光)。这些细节AI都能理解,关键是你得学会表达。

第四,色调。

色调是视频最容易被忽视但又最影响气质的要素。

同样是赛博朋克主题,"赛博朋克+冷色调"是标准的未来感,但"赛博朋克+暖色调"就变成了废土朋克。

用AI做视频的时候,通过prompt明确指定色调风格,或者在生成后用调色工具统一画面色调。记住,一致性是大片感的基础。

第五,音效。

这里说的不只是BGM。

真正的大片会利用音效来制造节奏感和沉浸感。比如脚步声的远近变化、环境音的层次感、关键时刻的音效强调。

好消息是,2026年的AI视频工具已经开始支持原生音视频同步生成了。Kling 3.0、Runway Gen-4这些工具都能生成配套的音效。坏消息是,大多数人还是在用"随便加个背景音乐"的思路做AI视频。

第六,情绪。

这是最重要的一点,也是最抽象的一点。

所有前面说的要素——运镜、景别、光影、色调、音效——最终都要服务于一个目的:传递情绪。

你的视频是想让观众感到紧张?感动?震撼?愉悦?愤怒?

不同的情绪需要不同的视听语言来表达。

一段紧张刺激的动作戏,需要快速剪辑、动感运镜、低频音效和冷峻色调。

一段温情脉脉的回忆戏,需要缓慢推进、柔和光线、暖色系和舒缓音乐。

你得先想清楚你要传递什么情绪,然后调配相应的视听要素。

03 2026年的AI视频工具,应该怎么选?

说完了理论,该说实操了。

2026年的AI视频工具市场,正在经历一场大洗牌。Sora在3月24日关停的消息震惊了整个行业,但这反而给国产工具带来了巨大的机会窗口。

简单说说目前的主流工具:

可灵AI(快手):国产之光,2026年已经迭代到3.0版本。中文理解最好,动作自然度高,最长支持2分钟视频。适合做叙事类的短视频。

即梦AI(字节):和剪映深度集成,如果你本来就是剪映用户,上手成本为零。Seedance 2.0版本支持多模态混合输入。

海艺AI:限时免费不限次,支持4K/60fps输出,画质在免费工具里是的天花板。

通义万相(阿里):2026年4月刚发布的新工具,主打"从演员到导演"全链路,5个主体参考是业内最多的。

Runway Gen-4:专业级工具,电影级画质,运动笔刷功能独一无二。但需要海外访问,门槛较高。

我的建议是:根据需求选工具,根据工具定策略。

如果你追求效率,那就选可灵或即梦,它们的模板系统和中文理解能帮你快速出片。

如果你追求画质,那就选海艺或Runway,虽然效率低一点,但画面是真的好看。

如果你追求性价比,那就选通义万相或者PixVerse,开源方案几乎零成本。

但无论你选哪个工具,记住我前面说的六大核心要素。工具只是手段,审美才是天花板。

04 把AI变成你的创作伙伴,而不是偷懒的借口

写到这里,我想跟你说一个可能有点扎心的观点。

很多人用AI做视频,本质上是想偷懒。他们觉得有了AI,就可以不用学摄影、不用懂剪辑、不用理解视听语言,直接一步登天做出大片。

这个想法,我劝你趁早丢掉。

AI是工具,工具是用来放大你的能力的。如果你本身有100分的能力,AI可以帮你放大到200分。如果你只有30分的能力,AI最多帮你放大到60分。

AI不会让一个不懂电影的人变成导演,它只会让一个懂电影的人效率翻倍。

所以,与其花时间抱怨"AI做的视频不够大片",不如花点时间学学基础的视听语言。了解什么是运镜、什么是景别、什么是光影、什么是色调。

当你真正理解了这些东西,再配合AI的强大生成能力,你才能做出真正有质感的大片。

记住:镜头+构图+氛围感,这是大片的三角定律。缺少任何一个角,你的AI视频就永远只能是"看起来还不错的自动播放PPT"。

好了,今天的分享就到这里。

你觉得你的AI视频缺什么?运镜?光影?还是审美?

评论区聊聊。

夜雨聆风

夜雨聆风