LLM, Token, Context, Prompt, Agent, Skill……,最近在摸索 Gemini CLI 的过程中,为了能更顺畅地和这些数字工具打交道,我把大模型核心的几个概念重新消化了一下。

这些笔记并不是教科书式的精准定义,更多是我基于近期摸索过程的一些个人理解。在此记录并分享出来,权当一份学习记录,也欢迎大家一起交流。

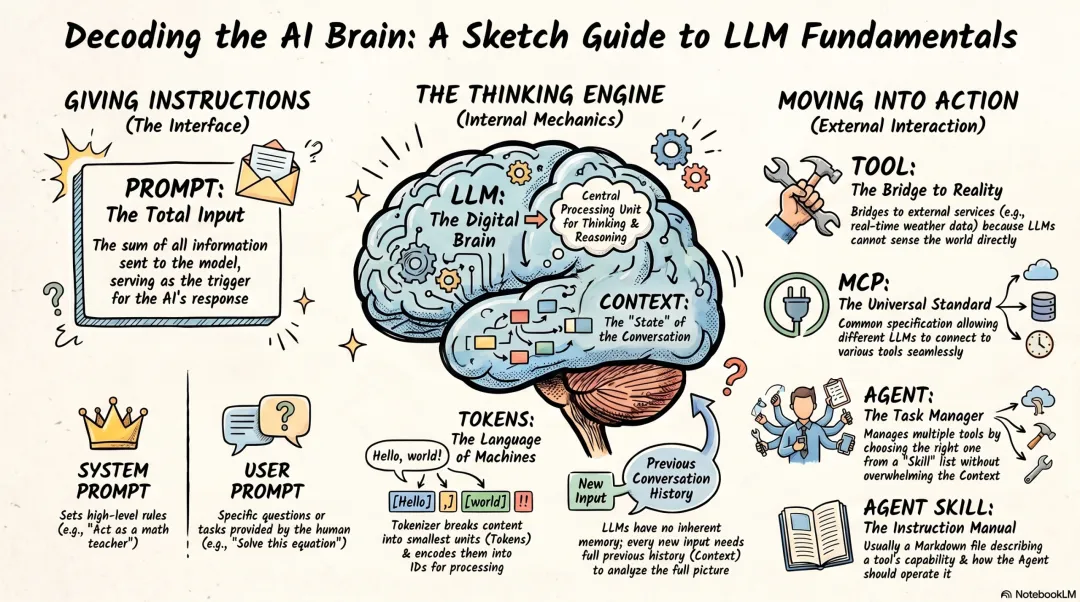

一、LLM:大脑的本质是“概率游戏”

LLM(大语言模型):负责信息接收、思考和生成。本质是基于海量的历史数据和当前的输入所做的概率性预测输出。

二、 Token & Context:沟通的颗粒度与记忆的幻觉

Token(词元): 与大模型沟通的最小内容单位。文字内容发送给 LLM 之前被拆分为 Token 并编码为 Token ID,LLM 接收到一串 Token ID 之后,逐一吐出答复的 Token ID,然后解码为文字内容。 Context(上下文):大模型没有会话状态,每次发给大模型的内容,会和之前的交流内容一起发给大模型分析计算。所以,整个架构中会有“记忆”处理的能力。

三、Prompt:指挥官的艺术

发给大模型的所有输入信息,分为:

User Prompt:用户发给大模型的指令、问题(比如:“帮我写个大纲”)。 System Prompt:系统级设定(比如:“你是一名苏格拉底式的数学老师,只启发不给答案”)。

四、 Tool & MCP:打破硅基世界的“次元壁”

LLM 是一个“困在盒子里的大脑”,它可以思考但是无法感知“硅基生命世界”中的其它“存在”。所以,也就无法与真实世界发生交互,比如:查询天气这样一个任务。它需要感知到与“硅基生命世界”中的“天气查询服务网站”并与之互动才能完成。

Tool(工具):让 LLM 可以感知“硅基生命世界”中的其他“存在”,并架起双方沟通桥梁。比如:LLM 想查天气,自己办不到,必须通过一个查询接口(Tool)去连接天气查询服务网站。 MCP(模型上下文协议): 它是一套通用的工具接入规范。有了它,同一个工具可以无缝接入不同的 AI 系统,不再需要为每个模型单独写一套代码。

五、 Agent & Skill:从工具到“分身”

Skill: 告诉 LLM 某个工具该怎么用的“说明书”(通常是 Markdown 文件)。

Agent:通过 Skills 管理多个 Tool,在处理复杂任务的时候,制定计划,管理执行步骤,按需提供Skills 给 LLM。避免一次把所有可能的信息发给 LLM,可以减少 Token 的消耗、Context Window 超载。

夜雨聆风

夜雨聆风