阅读时间:8分钟

系列:AI科普第④课

同学们好,又见面了!

前三节课我们聊了Token、脑机接口、AI骗人。你们现在对AI的理解,已经超过了大部分成年人。

今天这节课,老师要告诉你们一个很多人不知道的事实——

你每用一次AI,它就在烧电。

你以为AI是"云端的东西",用起来好像"不花钱"?错了。每一次AI回答你的问题,背后都在消耗真实的电力、占用真实的服务器、排放真实的碳。

这节课,老师带你们看看AI的"能耗账单",顺便结合最近的一些新闻,让你知道AI竞争背后,到底在比什么。

■ 训练一次大模型,要烧多少电?

先说一个数字,你们猜猜:

训练一次GPT-4,需要花多少电?

答案是:约50吉瓦时(GWh)(代表多次训练或更大模型的累计耗能 )。

1吉瓦时是什么概念?

● 够一个普通家庭连续用5700年的电量

● 相当于25000个家庭一年的用电量之和

● 如果用煤炭发电,相当于烧掉了几十吨煤炭

● 如果按每度电0.6元算,光训练一次的电费就高达几十万美元

这只是训练的费用——"教AI学会"的阶段,只做一次。

而你们每天用ChatGPT、DeepSeek、文心一言,这些推理(Inference)过程每天都在发生。

■ 你用一次AI,大概花了多少电?

这个问题更有意思。

老师查了一下资料(虽然AI告诉我的数字不一定准,所以老师要加一句"仅供参考" 😄):

一次普通的AI对话(大约20个问题)耗电量:约0.01-0.05度电

相当于手机充一次电的1/10到1/2。听起来好像不多?

但是——全球每天有多少人在用AI?

ChatGPT日活用户超过1亿。DeepSeek上线即爆火,高峰期每秒处理几百万次请求。

如果1亿人每天各问20个问题:

● 每天耗电:100万到500万度

● 每年耗电:3.6亿到18亿度

● 相当于一座小型城市全年的用电量

而这,还只是聊天。如果把AI搜索、AI图片生成、AI视频生成、AI语音助手全部算进去——AI行业的总用电量,正在以惊人的速度增长。

■ 全球数据中心,已经成了"吃电巨兽"

你们知道全球最大的"用电户"是谁吗?

不是工厂,不是高铁,是数据中心。

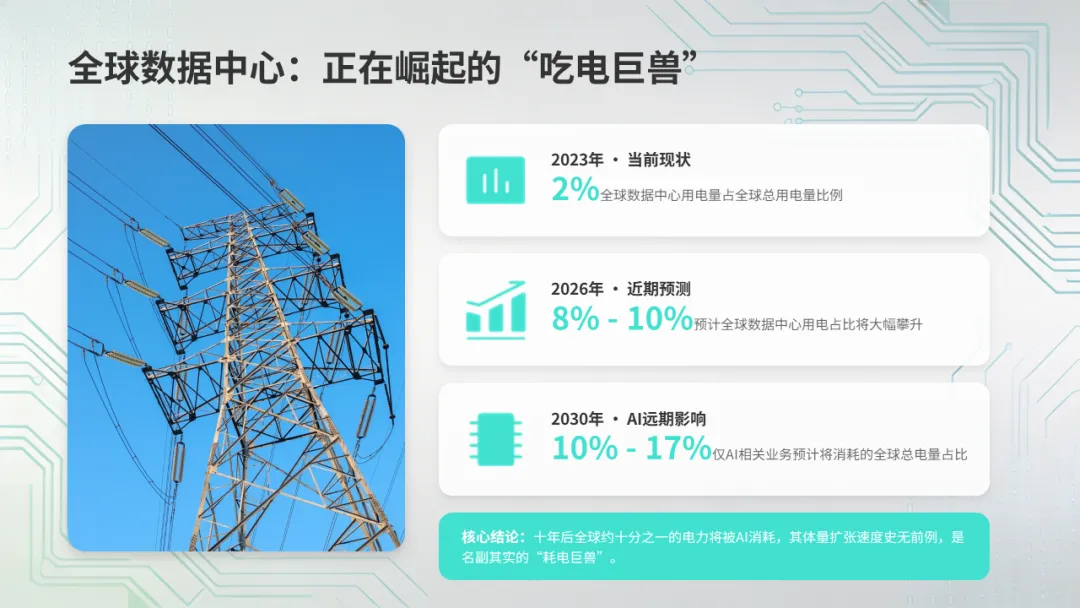

2023年,全球数据中心用电量约占全球总用电量的2%。

到2026年,这个比例预计上升到8%-10%。

到2030年,有研究预测AI相关用电将占全球用电量的10%-17%。

17%是什么概念?

也就是说,十年后,全球约十分之一的电力,可能都被AI用掉了。

这就是为什么老师说AI可能是人类有史以来最耗电的东西——它的体量,正在变得越来越大,而且没有减速的迹象。

■ 为什么AI这么耗电?

这个问题要从技术原理说起。

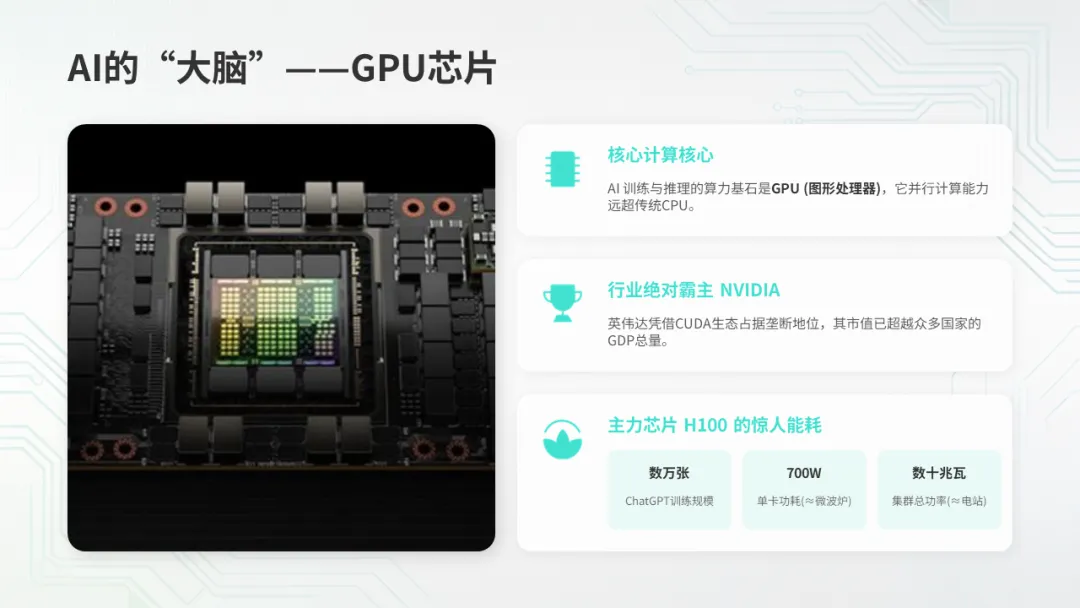

AI的"大脑",是一堆芯片(GPU)。

你们知道NVIDIA(英伟达)吗?就是那个做显卡的公司,现在它的市值已经超过了很多国家的GDP。

英伟达做的GPU(图形处理器),是目前训练AI的主力芯片。ChatGPT训练用了几万张英伟达H100芯片。

一张H100芯片,功耗是700瓦——跟一台微波炉差不多。

几万张同时运行,功率就是几十兆瓦,相当于一座小型发电站。

为什么GPU这么耗电?

原因很简单:AI计算的本质是做海量的矩阵乘法——说白了就是无数次的乘法和加法。GPU有上万个核心,可以同时做这件事,但代价是需要大量电力来驱动这些核心运转。

而且,芯片运转的时候会发热。你们打游戏的电脑也会发烫对吧?

热量一大,就需要空调和冷水机组来降温,这部分的耗电又是芯片本身耗电的30%-40%。

芯片本身 + 散热系统 = AI的真实用电量

■ 中国在这场"算力竞赛"里,排在什么位置?

这是最近科技圈最热的话题之一。

全球AI算力格局

目前全球AI芯片的主要玩家:

● 美国:英伟达(GPU)、AMD、英特尔

● 中国:华为昇腾(Ascend)、壁仞科技、寒武纪等

美国在芯片领域起步早,技术领先。中国的芯片被美国限制了出口,高端芯片进不来。

但中国没有坐以待毙——走了一条不同的路:让AI在更小的设备上跑起来。

结合最新行业动态,以端侧AI为例,近年来多家科技公司都在探索将AI模型部署到手机、汽车等终端设备上。这种方案可以减少数据传输延迟、保护用户隐私、降低云端能耗,代表了AI发展的一个重要方向。

与此同时,各大科技巨头都在加大对AI基础设施的投资——无论是数据中心、芯片研发还是能源供应,都在做重资产布局。AI竞争,已经不只是"比谁的AI更好",而是"比谁有更多的算力和能源"。

■ AI的能耗问题,会影响你的生活吗?

会。而且可能比你想的更近。

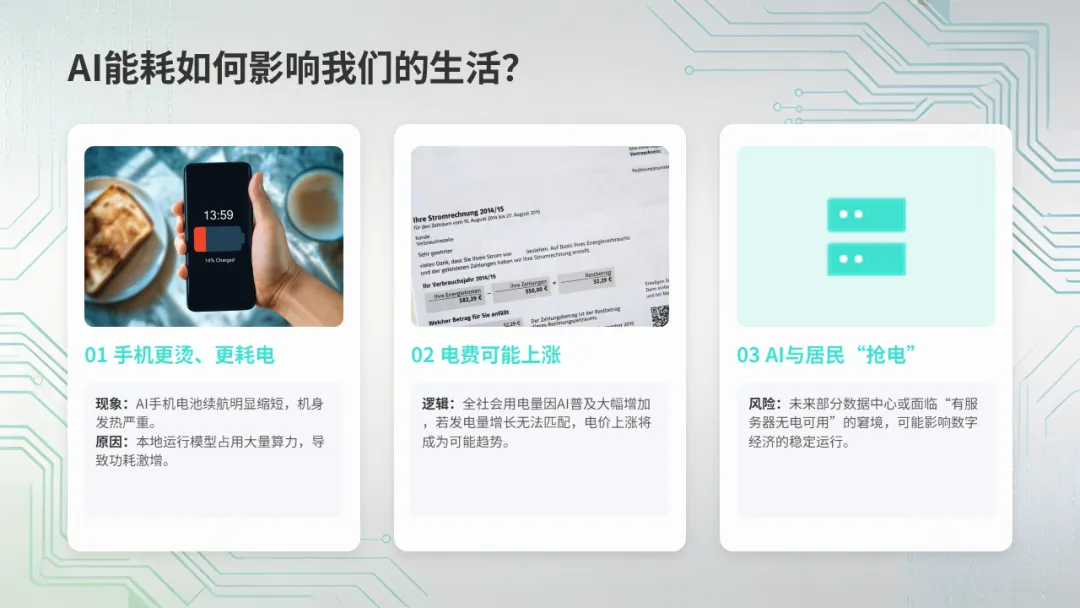

①. 手机会更烫、更耗电

你们有没有发现,用了AI功能的手机,电池比以前用得更快了?

因为AI功能需要在本地跑一个小型模型,这个过程会占用大量算力,手机就会发热、耗电。未来,带有"AI功能"的手机会越来越多,电池续航可能会比以前更短。

②. 电费可能会涨

如果全社会用电量大幅增加,而发电量跟不上,电价就可能上涨。AI的能耗,最终会分摊到每个人头上。

③. AI会抢电

想象一下:夏天空调开得多的时候,你们家有时候会"跳闸"对吧?

当数据中心和居民抢电的时候,也会出现类似的情况。有研究报告指出,未来一些地区的数据中心可能会面临"有服务器但没电用"的尴尬局面。

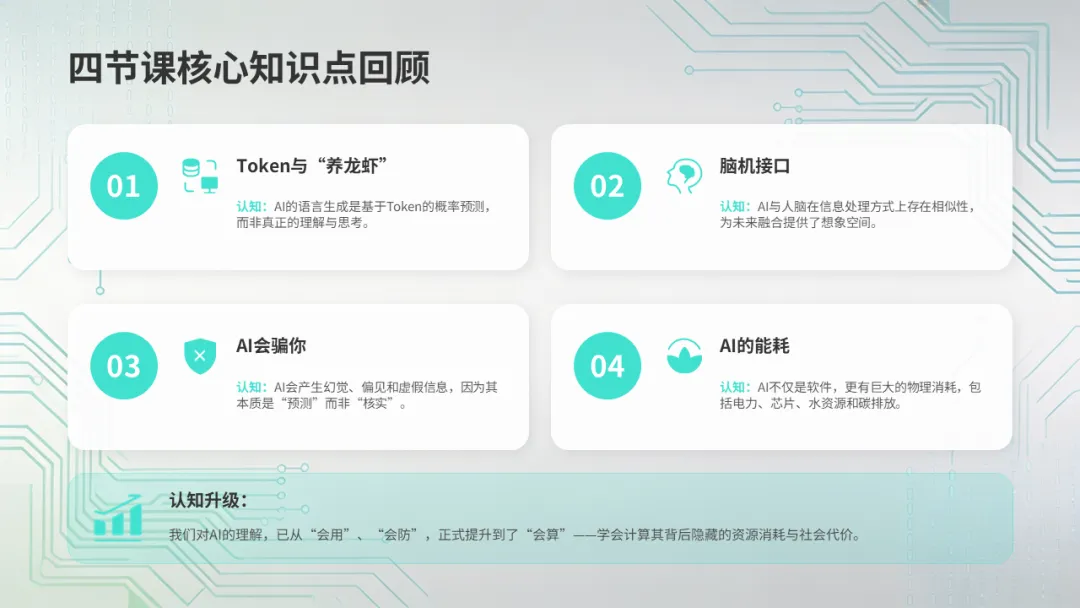

■ 跟上三节课的联系

我们四节课讲了什么?

你们理解了:AI会幻觉、会偏见、会造假,因为它本质是"预测"不是"核实"。

第④课(今天):AI的能耗

你们现在看到了:AI不只是"软件",它有真实的物理消耗——电力、芯片、水资源、碳排放。

四节课下来,你们对AI的认知又升了一级:不只是"会用",也不只是"会防",还要"会算"——算它背后的资源和代价。

■ 给同学们的三条建议

①. 意识到"免费"的AI其实不免费

每次AI回答问题,背后都在消耗服务器、芯片和电力。没有真正免费的AI,只是有人在替你付账单。

②. 关注AI的"能效比"——同样的电,更好的AI

中国的端侧AI方向值得支持,因为它在用更少的电,做更多的事。未来,选择更省电的AI产品,也是一种环保行为。

③. 理解"算力即国力"

AI竞争的本质,是芯片+能源+人才的综合竞争。美国有芯片优势,中国有能源和人才优势。了解这些,你们就能更客观地看待中美科技竞争,而不是被媒体带节奏。

══════════════════════════════

📚 下课 📚

四节课下来,老师从Token讲到脑机接口,从AI骗人讲到AI耗电。你们现在对AI的了解,已经不是"会用AI"这么简单了——你们知道AI是什么、怎么工作的、会怎么骗你、会消耗多少资源。

这四节课的内容,你们可以在同学面前吹一年。

下节课,老师想聊一个更轻松但也更重要的话题——

你们每天用的AI应用,真的安全吗?你们的个人数据去了哪里?

我们下节课见。

(聪明的用户,不只问AI能做什么,也问AI值不值 ⚡)

—— 潘老师 AI科普课堂 ——

夜雨聆风

夜雨聆风