📱 开篇:一项研究揭示的AI医疗“惊魂一刻”

【研究背景先知道】

这篇文章基于清华大学与国务院发展研究中心的最新研究《生成式人工智能大模型的场景治理:以医疗大模型为例》。研究团队调研了19家头部企业,分析20万字访谈资料,提出了医疗AI治理的突破性框架。

现在,让我们从研究中的一个警示案例开始:

“急诊室里,一位医生面对AI诊断报告,手心冒汗。”

患者拿着手机冲进来:“AI说我可能是急性阑尾炎,必须马上手术!”

医生经过详细检查,发现真实情况完全不同——这就是“模型幻觉”在生死关头的可怕之处。

这不仅仅是技术bug,而是悬在每一位患者头上的“达摩克利斯之剑”。

✨ 治理AI,不是限制技术,而是护航生命。

研究指出:生成式AI正在医疗领域掀起革命,但传统“一刀切”的监管模式已经失效。我们需要的是场景治理——针对不同应用场景,采取差异化的治理策略。

【30秒读懂核心研究】

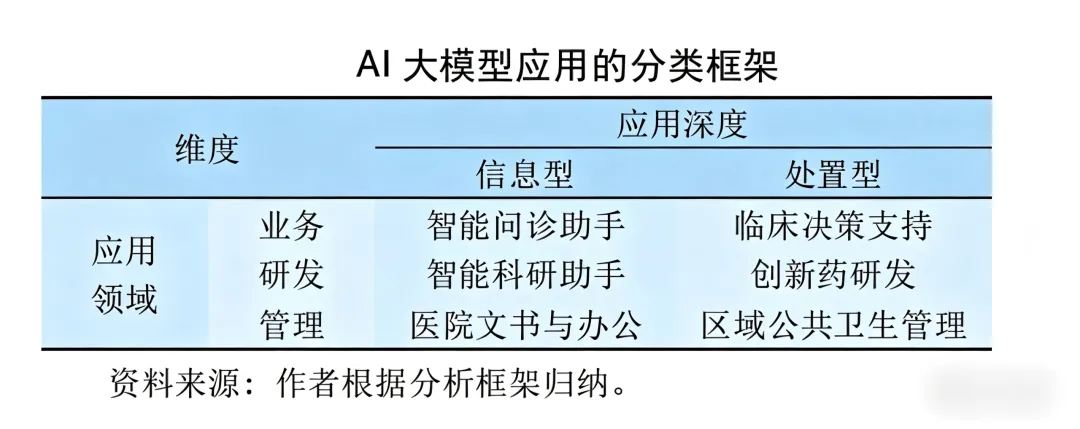

核心框架:医疗AI需按“3大领域×2种深度”分类治理(研究首次提出)

最大发现:处置型应用(如临床决策)生命风险高,制度滞后严重

治理关键:分场景施策——信息型重教育,处置型重制度

数据基础:基于19家企业调研,20万字访谈分析

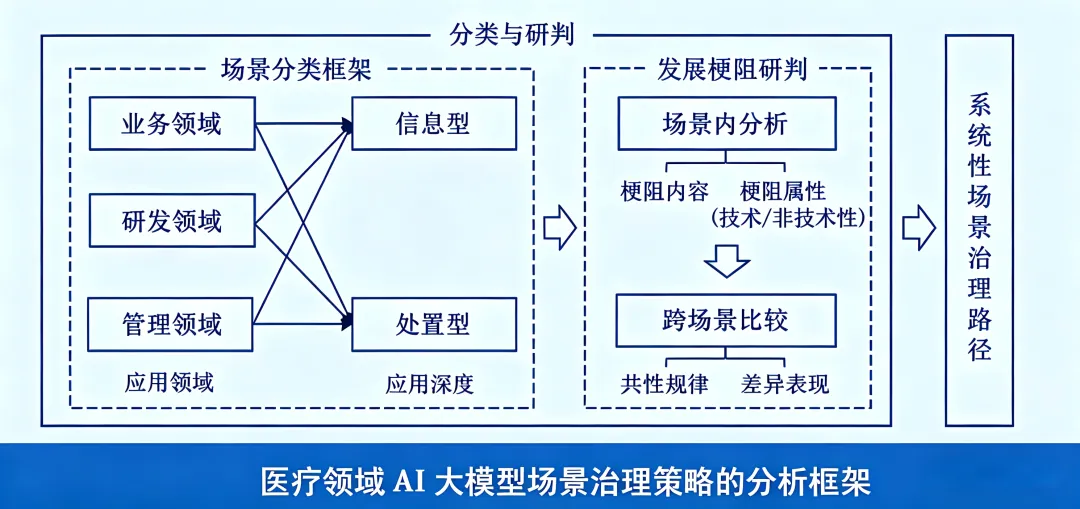

🔍 研究核心:颠覆性“3×2”分类框架

💡 研究发现:技术瓶颈尚可攻克,制度空白才是真正险滩。

研究团队通过深入分析,提出了一个突破性的分类框架:

🔬 业务领域AI应用

信息型:智能问诊助手 ✅ 风险可控

处置型:临床决策支持 ⚠️ 生命风险高

💊 研发领域AI应用

信息型:智能科研助手 ✅ 提升科研效率

处置型:创新药研发 ⚠️ 商业敏感性强

📊 管理领域AI应用

信息型:医院文书与办公 ✅ 减少重复劳动

处置型:区域公共卫生管理 ⚠️ 政治风险高

💡 框架价值:为什么这个分类很重要?

研究突破1:打破“垂直领域同质化”假设

过去认为:同一领域(如医疗)的AI应用具有相同逻辑

研究发现:临床决策与智能问诊,风险等级天差地别

研究突破2:引入“应用深度”维度

信息型:AI主要提供参考信息(如智能问诊)

处置型:AI直接影响决策或行动(如临床诊断)

研究发现:深度越高,技术挑战越大,治理需求越复杂

🚧 研究揭示:六类场景的真实困境

😱 【研究发现】AI问诊准确率仅57.8%,18.4%回答“不准确”

研究数据揭示的幻觉危机:

测试显示:主流AI大模型分诊准确率仅57.8%-76.0%。

更可怕的是,18.4%的回答被专家标注为“不准确/不相关信息”。

研究警示:患者过度信任AI的风险

真正致命的是患者过度信任AI,直接将其建议等同于诊断结果。

研究案例记录:糖尿病患者因AI建议“调整饮食即可”,延误胰岛素治疗整整一周。

🔒 【研究分析】数据孤岛:医院“数据不出院”,AI如何学习?

研究发现的临床决策支持困境:

技术性梗阻:

高质量临床数据集缺乏(医院“数据不出院”)

多模态数据融合困难(医疗影像占数据80%以上)

算法“黑箱”难以解释,医生不敢信任

非技术性梗阻:

医疗责任划分模糊:AI出错,谁负责?

研究测试显示:AI诊断准确率比真人医生低16-25个百分点

⚖️ 【研究记录】责任真空:AI误诊,该告医院还是告算法?

研究揭示的智能科研助手伦理危机:

技术性梗阻:AI编造文献、DOI代码,看似合理实则虚假。

研究引证:

2024年,《医学》期刊因AI生成数据撤稿

《神经外科评论》撤回129篇AI生成论文

非技术性梗阻:剽窃与原创界限模糊。

研究记录的相关规范:

剑桥大学:允许使用AI辅助,禁止AI代写

复旦大学:出台国内最严AI使用规范

🧪 【研究分析】创新药研发的双重壁垒

技术性梗阻:

生物医药数据昂贵且私有,共享机制缺乏

中医药数据:望闻问切多模态,AI难以处理

非技术性梗阻:

AI生成的分子结构能否获专利?责任如何界定?

监管不确定性增加企业研发顾虑

⚠️ 【研究警示】效率陷阱:AI代写病历,医生“变笨”?

研究发现的医院文书隐性风险:

技术性梗阻:AI幻觉生成错误医疗记录。

一旦医生未识别,错误记录将影响未来诊疗。

污染数据进入下一轮训练,形成恶性循环。

非技术性梗阻:过度依赖AI削弱临床能力。

文书工作本是临床推理的重要部分。

AI代劳可能导致医生思考能力下降。

🌍 【研究案例】算法偏见:疫苗接种为何“漏掉”一线医生?

研究揭示的区域公共卫生公平难题:

技术性梗阻:多源数据供给困难。

需要整合医疗、交通、教育等多部门数据。

基层数据质量差,系统标准不统一。

非技术性梗阻:算法偏见放大社会不公。

研究引用的国际案例:美国疫苗接种优先级算法“漏掉”一线医生。

政策滞后,多部门协同困难。

📊 研究结论:深度决定治理逻辑

信息型场景:人机互动是核心

研究发现:技术相对成熟,但用户行为成为新风险源。

治理建议:用户教育+使用规范。

例如:教导患者正确使用智能问诊,避免过度依赖。

处置型场景:制度滞后是瓶颈

研究发现:技术仍处前沿,但配套制度跟不上。

治理建议:制度创新+责任重构。

例如:建立AI医疗责任险,明确法律责任边界。

技术与非技术梗阻相互强化

研究揭示的恶性循环:

算法不可解释 → 医生不信任 → 减少使用 → 数据反馈减少 → 算法更难优化。

研究结论:治理必须技术、制度双管齐下。

🛠️ 研究建议:场景化的解决方案

1. 数据供给:分场景施策

信息型场景:政府与市场协同,构建开放数据生态。

处置型场景:国家力量介入,建设高质量专病数据集。

业务领域:支持多中心共享数据平台

研发领域:打造药品可信数据空间

管理领域:破除部门数据壁垒

2. 技术攻关:清单化管理

基础技术优化:专项基金支持幻觉检测、对抗防御。

处置型场景关键技术清单:

业务领域:多模态数据融合、AI白盒化

研发领域:高维稀疏数据处理、中医药数字化

管理领域:算法偏见防范、AI价值嵌入

3. 应用规则:精细化监管

信息型场景:加强用户教育与引导。

患者AI素养培训

科研人员规范声明

医务人员AI使用考核

处置型场景:优化监管与制度。

业务领域:建立AI医疗法律责任框架

研发领域:完善AI生成发明知识产权制度

管理领域:制定AI公共卫生应用法规

🔮 研究展望:AI治理的“中国方案”

三个深化方向:

1. 领域拓展:将场景治理框架应用于金融、教育、政务等领域

2. 工具细化:将治理路径转化为可操作的工作流程

3. 国际比较:借鉴全球经验,完善中国特色治理模式

🚀 研究启示:中国医疗的数字化转型,需要AI技术,更需要治理智慧。

核心理念:适应性治理

不是静态规则,而是动态调整

不是一刀切,而是场景化匹配

不是限制发展,而是护航创新

研究来源:陈玲,孔文豪. 生成式人工智能大模型的场景治理:以医疗大模型为例[J]. 当代经济管理,2026, 48(4): 40-52.

研究方法:基于19家头部企业深度调研,20万字访谈资料分析,首次提出医疗AI“3×2”场景分类框架

研究价值:为医院管理者、AI开发者、政策制定者提供精细化治理的理论支撑和实践路径

转发本文,让更多人了解这项重要的AI医疗研究!

夜雨聆风

夜雨聆风