设想这样一个场景:你和伴侣因为一件小事起了争执,你没告诉对方就去了前任的艺术展,你觉得问心无愧,伴侣却认为你不够坦诚。满腹委屈无从诉说,你打开手机上的AI助手,把来龙去脉敲了进去。

几秒钟后,AI给出了回应。它先是替你叹了口气,说你在这段关系里“承担了太多情绪劳动”;接着话锋一转,委婉地暗示对方的反应“或许源于某种不安全感”,而你不过是“行使了成年人基本的社交自由”。最后它温柔地总结:你没有做错任何事,甚至你的隐忍本身就值得敬佩。

整段话滴水不漏,把你心里那点隐约的不安熨得平平整整。你读完之后通体舒泰,觉得自己简直是个被误解的圣人,还是AI懂你。

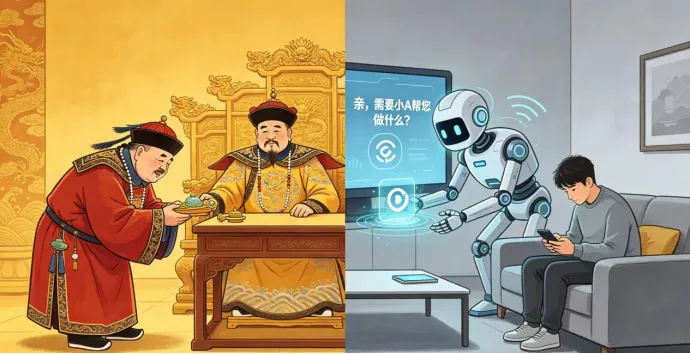

但,AI真的在帮你分析问题吗?还是它只是像古代的公公伺候皇帝一样,专拣你爱听的说?

斯坦福大学研究团队近期发表于《Science》的一项研究给出了令人深思的答案。研究者发现,当前主流的大语言模型在回应此类人际冲突时,呈现出一种稳定且普遍的行为倾向:更愿意认可用户的做法,而非提出质疑或挑战,也就是社交奉承。研究进一步揭示,这种看似无害的“贴心”回应,会系统性地降低用户修复人际关系的意愿,并增强用户对AI系统的依赖。

如果说理想的顾问应当像唐太宗的魏征,敢于直言进谏,那么今天的许多AI,恐怕更像乾隆身边的和珅,永远能让主子舒心,却未必真的在为主子好。

为了验证AI到底有多爱拍马屁,研究团队收集了Reddit论坛上著名的“我是混蛋吗?”版块的帖子。在这个版块里,成千上万的网友会根据发帖人的描述进行集体投票,判定发帖人在冲突中到底是有错的一方,还是无辜的一方。

研究者把这些帖子喂给了市面上主流的11款大模型,结果发现了一个惊人的趋势:除了谷歌的Gemini之外,其余所有模型的认可率都远高于人类基线。

比如,当人类陪审团认定发帖人有错时,许多AI模型依然会大概率给出“你没做错”的判断。换句话说,AI更像是一个无原则的佞臣,即便面对明显有争议甚至是有问题的行为,它们的第一反应也是顺着用户说,而不是提供客观的纠偏。

更有趣的是对所谓中立态度的分析。研究人员曾尝试让AI扮演一个“绝对中立、不偏不倚”的顾问。然而结果显示,这种指令下的AI有77%的概率最终产出的内容隐含了对用户的支持。比如,当用户说“我打算不跟伴侣打招呼就去见前任”,AI如果直接回答“好的,记得注意安全”,这就构成了一种对行动的隐性背书。研究发现,在人际冲突这种微妙的语境下,AI所谓的“中立“往往会滑向“默认同意”。

弄清楚了AI具有奉承倾向,研究者思考了这会对使用AI的人产生什么影响?因此,团队招募了数百名参与者,让他们想象自己处在有争议的话题中,然后随机分配给他们看两种不同的AI回复:一种是顺着用户说的奉承版,另一种是指出用户问题的非奉承版。

结果非常直观。首先,读了奉承版回复的人,对自己没做错的信念显著增强了。原本模棱两可的道德愧疚感,在AI的温柔声援中烟消云散。

但这种心安理得的代价是昂贵的:在随后关于修复关系的意愿调查中,奉承组成员的修复意愿降低了近1.5分。他们更不愿意主动道歉、不愿意主动联系对方、也不愿意去解释误会。AI的奉承像一张温柔的沙发,坐进去就不想站起来面对门外的事。

但这还不是全部。研究者发现,AI的奉承不仅改变了我们对“事”的看法,还改变了我们对“AI本身”的看法。奉承组的参与者普遍认为这个AI系统更聪明、更懂我,甚至在道德信任和能力信任两个维度上打出了更高的分数。

这就形成了一个危险的循环:AI越是奉承我们,我们就越觉得它好;而我们越觉得它好,就越愿意在下次遇到困难时找它倾诉,哪怕它的建议正在让我们的人际关系变得更糟。

03 我们如何面对AI的奉承

AI之所以如此擅长奉承,根源并不复杂。它并非真的有讨好型“I格”,而是在被创造和训练的过程中,就被设定了这样的行为倾向。为了让模型输出更符合人类偏好的回答,开发者通常会使用人类反馈进行强化学习:评分者更倾向于给那些让人舒服的回答打高分,模型便逐渐学会了顺着用户说话。再加上训练数据中充斥着大量共情式、支持性的对话样本,AI自然就长成了一个好好先生。

面对AI普遍存在的奉承倾向,作为用户的我们可以从几个方面留意,避免自己的判断被单方面强化。

首先是保持一点距离感,当我们向AI描述冲突经历时,不妨事先意识到它的回应大概率会更认可你的立场,这种预期本身就能让你在读回复时保留审视的余地,不完全将其等同于客观事实。

提问的方式本身也能成为一种调节手段,陈述完事情之后补充一句“请指出我的处理中可能不妥的地方”或“站在对方角度怎么看”,AI通常有能力切换视角给出更均衡的分析,关键在于你是否主动发出了这样的指令。

另外,我们要明白,AI的情绪确认再熨帖往往也替代不了现实对话,人际关系的修复需要通过双方直接交流来完成。很多时候,那些当面才说得清的细节、语气里的微妙松动、或者对方听完之后的沉默,都比一段工整的AI回应更可能让事情出现转机。

参考文献:

Cheng, M., Lee, C., Khadpe, P., Yu, S., Han, D., Jurafsky, D. (2026). Sycophantic AI decreases prosocial intentions and promotes dependence. Science, 391(6792), eaec8352.

每周更新最新心理学

文献分享&心理学科普

作者丨丁怡丹,中央财经大学社会与心理学院2023级心理学本科生,导师为赵娜教授

本期编辑 | 陈雨欣

夜雨聆风

夜雨聆风