点击箭头处“蓝色字”,关注我们哦!!

一个有趣的现象正在发生:AI公司最核心的部门,正在从"算法研究院"悄悄变成"能源采购部"。

这听起来像个段子,但仔细想想,一点都不夸张。

微软的纳德拉去年年底在财报电话会上直接说,手里有一堆GPU,因为缺电、缺空间,只能放着。这不只是他一家的问题,而是整个美国AI产业的一个例子。马斯克训练Grok-3的时候,听说租了全美4分之一的移动冷却设备,还得临时接发电机。

缺电这件事,已经不是隐患了,而是正在发生的实际情况。从比算力到比电力

2023年之前,行业里大家都发愁的是缺芯片,英伟达的A100、H100特别难买到,价格都被炒到原价三倍。那时候大家都觉得,谁能抢到更多GPU,谁就能赢。

可是到了2024年,情况就变了。OpenAI的奥尔特曼在达沃斯说,如果不解决能源问题,压根没办法实现AI的技术目标。Meta的扎克伯格直接说,GPU供应的瓶颈已经缓解了,可能源会成为下一个主要的瓶颈,而且这个瓶颈光靠资本是解决不了的。

纳德拉说得更具体,他说现在有很多GPU因为电力配套不足没法用。AI行业真正的瓶颈不是算力,而是电和数据中心的空间。

那是为什么?因为算力这玩意儿,花钱能够买到,但电并不一样。你能在半年内采购十万块GPU,可给一座数据中心通电、审批电网、建设配套,没个三到5年根本弄不成。需求是脉冲式爆发,供给是线性慢慢增长,这就是根本矛盾。这到底能夸张到什么程度?

说说几个数字:

GPT-3训练一回,用电量大概就相当于是120个美国家庭一整年的用电量,具体是多少,是1,287兆瓦时。

GPT-4更高。研究人员算,整个训练周期大概用了5000万到6200万度电。要是训练用了三个月,那平均下来每天差不多就用掉小十万度,这相当于好几万个家庭一天的总用电量。

有研究机构估算,GPT-5每天的耗电量能达到4500万度,差不多相当于150万美国家庭一天用电的总和,相当于两三座核反应堆的输出量。

需要留意,这是每天,不是训练一次哈,是每天。这还只是训练的时候。模型运行起来之后,每天回应用户的请求,也同样在耗电。ChatGPT现在每天要处理约25亿次请求,每天耗电超过50万度,相当于每天就消耗掉一个小型发电站的产出。

IEA的数据更直观,2024年全球数据中心的用电量大概是415太瓦时,占全球全社会用电量的1.5%。这个比例看起来不高吧,但是增速可吓人。到2030年,这个比例可能就会翻倍到接近3%。到时候全球近一成的电力需求增长,直接就来自数据中心。

数据高度比较集中,85%以上的新增容量,是在美国、中国和欧盟这三个地方,其中美国贡献了将近一半的增长份额。电价差就是竞争力差

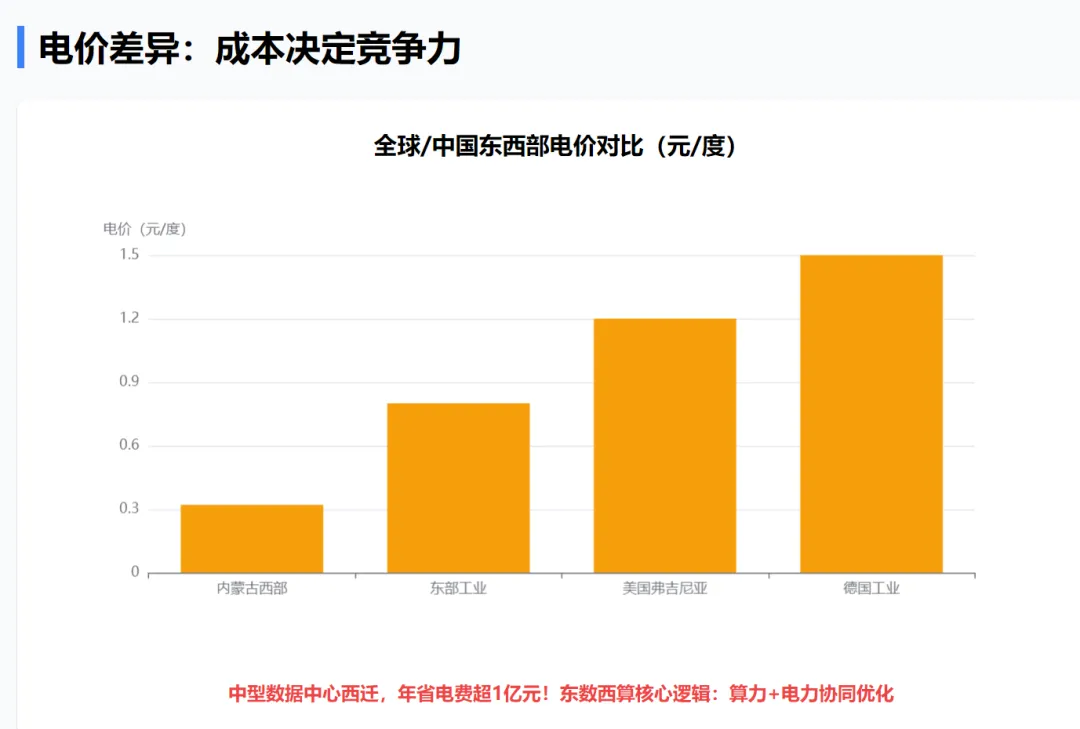

事情不只是有没有电,还包含电多少钱。美国居民电价在过去几年持续上涨,部分数据中心密集区涨得特别厉害。弗吉尼亚州现在是全美数据中心最集中的地方之一,当地批发电价在过去5年涨了267%,最后都转嫁到了居民账单上。缅因州电价是全国平均的两倍,当地政府已经在考虑暂停批准新数据中心建设。

欧洲更夸张。德国工业电价在2024年约为78欧元每兆瓦时,是法国的将近两倍。德国一些工厂因为电价太高已经开始减产。

但中国有自己的解法。内蒙古、甘肃、贵州这些西部省份,电价普遍只有东部的一半甚至3分之一。内蒙古和林格尔的数据中心,电价能达到0.32元每度,而东部工业电价普遍在0.8元以上。这么算的话,一个日均耗电1000万度的中型数据中心,要是从上海搬到内蒙古,每年电费能省下超1亿元。

这就是“东数西算”背后的经济逻辑。把对延迟不敏感的AI训练放到西部,把需要快速响应的推理任务留在东部。不是简单的算力转移,而是算力和电力的协同优化。

巨头们在争抢些什么

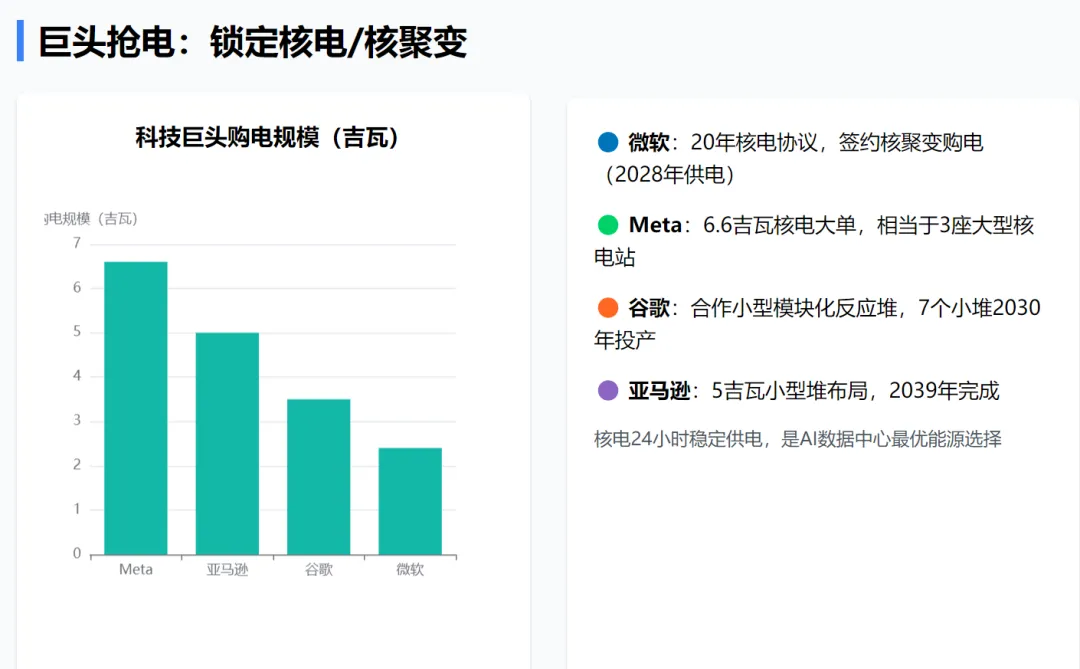

微软和星座能源公司签了一份为期20年的协议,要重启宾夕法尼亚州三哩岛核电站的一个机组,从2028年开始买这个机组全部的电。这是微软史上最大的买电协议。

Meta更积极,今年年初一下签了三个核电的大单子,总规模有6.6吉瓦,相当于三座大型核电站的装机容量,会在2035年前慢慢上线。

谷歌和Kairos Power合作开发小型模块化反应堆,签了全球首个企业级SMR买电协议,打算布置7个小堆,首批机组会在2030年投产。亚马逊和X-energy的协议更厉害,计划在美国布置超5吉瓦的小型堆,在2039年前弄好。

核电能能24小时稳定供电,不像风光发电得看老天爷的脸色什么的,对于得持续运转的AI数据中心来说,这就是最理想的能源。

甚至核聚变都有人下单。Helion Energy称微软已和他们签署了全球首个核聚变发电购电协议,发电厂预计于2028年建成,初始供电量为50兆瓦。

那些公司都在竞争AI模型,你想想,其实他们是在竞争能源布局。

背后到底是什么

AI竞争发展到现在,逻辑已经变了。在上半场,大家比拼算法、比拼参数、比拼数据、比拼芯片。OpenAI靠着GPT打开局面,Google跟着用BERT跟进,国内字节、阿里、DeepSeek一个接一个出现。这个阶段确实挺精彩,也确实解决了不少技术问题。

那下半场,瓶颈不再是脑力,而是体力。任何一个参数再大的模型,都得有电才能运行。任何一个推理能力再强的AI,都得有冷却系统来散热。任何一座算力再强的数据中心,说到底就是个用电的大户。

能源顾问公司Wood Mackenzie有这样一种说法,算力的尽头是电力,电力将会决定谁能够在AI竞赛中走得更远。

这并不是在唬人。一个一天耗电几十万乃至上百万度的AI训练任务,和一个仅需要稳定供电三天就能完成的渲染任务,对电力的需求完全不一样。当AI的规模变得越来越大,电力就会从成本项目变成战略资源。

谁拥有稳定又低价的电力,谁的AI成本就会更低。谁的AI成本更低,谁的模型定价空间就会更宽泛。谁的定价空间更宽泛,谁就能够在市场上存活更久。

归根结底,电权并非是电网里流动的那些电流,而是AI时代最为关键的硬通货。

下半场已经开启了。

扫码关注我们

声明:本文涉及资讯、数据等内容来自网络公共信息,仅供参考,不构成投资建议!图片素材全部都是来源真实素材或者AI原创。文章旨在倡导社会正能量,无低俗等不良引导,望读者知悉。

夜雨聆风

夜雨聆风