ESSAY · 肆

AI很厉害,但别急着只裁员

四种赋能形态,你裁对了吗

语 嫣

ESSAY · 肆

AI很厉害,但别急着裁员

四种赋能形态,你裁对了吗

语 嫣

前两篇我们聊了能力平权——AI 把专家的隐性知识转移给普通人,每个人的起点都抬高了。实验数据也清楚地证明了 AI 对组织绩效的提升。

看到这些数据,很多管理者的第一反应是:太好了,AI 这么能干,可以裁掉一批人了。

这个念头,可能是 AI 时代最昂贵的决策了。

为什么?因为 AI 赋能不是一刀切的。它在不同岗位、不同人身上的作用方式完全不同。清楚这个,才会是短期长期都有效的决策。

I

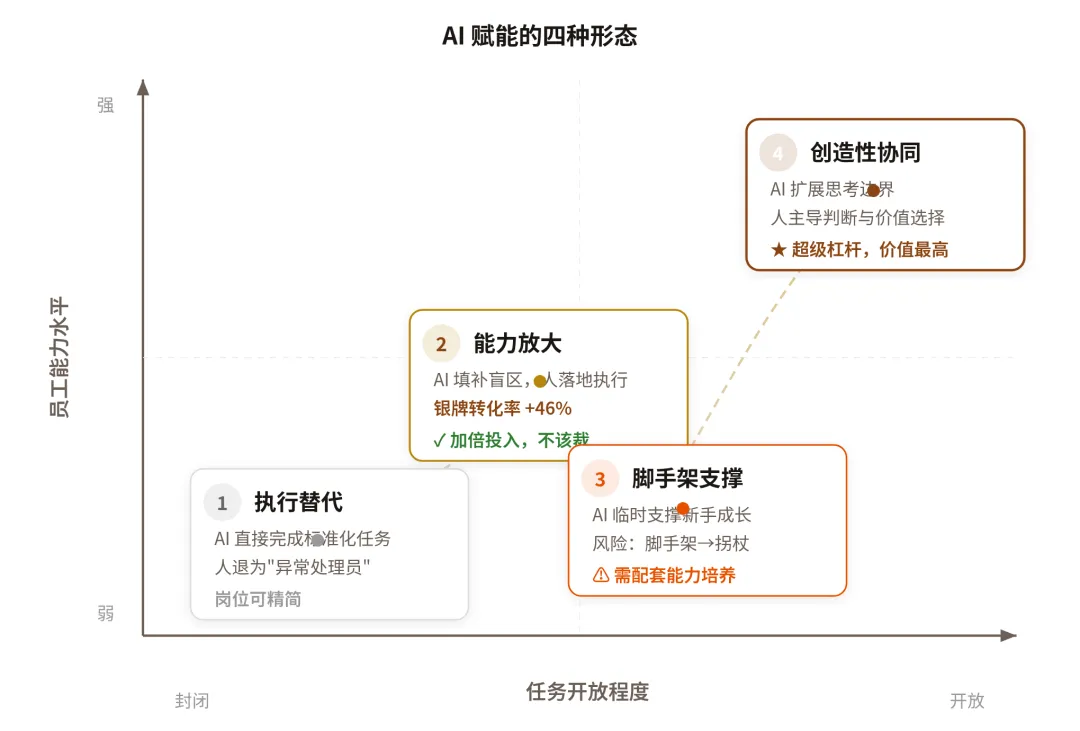

AI 赋能的四种形态

根据任务的开放程度和员工的能力水平,AI 和人之间的协作有四种完全不同的模式。

第一种:执行替代。任务高度标准化,员工能力较弱。AI 直接替代人完成任务——票据核验、标准数据录入、客服常见问题回复。人的任务变为"异常处理员",只在 AI 搞不定的边缘情况介入。这个象限里的岗位确实面临被替代的风险。

第二种:能力放大。任务有一定开放性,员工有经验基础。这正是我们实验中银牌销售的情况——AI 的建议精准地填补了他们的盲区,他们有足够的判断力把建议落地。转化率飙升 46%。这个象限的人不该裁,应该加倍投入 AI,提高他们的能力。

第三种:脚手架支撑。任务有开放性,但员工能力薄弱。AI 提供了临时性支撑——让新手能完成原本做不到的事情。关键问题是:这个脚手架是帮他成长,还是变成了永久拐杖?如果组织的激励体系只看短期业绩,员工会选择永远依赖 AI,能力迁移就此中断。关注 AI 无法替代的能力培养,是对这些员工最合适的投资。当然,员工个人也要好好思考什么能力是 AI 无法替代的。

第四种:创造性协同。任务高度开放,员工能力卓越。AI 扩展了他们的思考边界,提供海量知识调用和快速原型生成,但判断力、直觉和价值选择仍然由人主导。这些人放在任务开放度低的岗位是浪费,必须把他们放在高开放度的位置才能发挥作用。这是价值最高的协作模式,AI 在这里是超级杠杆。

看清这四种形态,你会发现:急着裁员的管理者,往往是把所有岗位都当成了"执行替代"。但现实中,大多数有价值的工作是后三种。对于管理者来讲,先看任务开放度再思考 AI 替代,是 AI 战略转型中的重中之重。

II

隐性知识:AI 的燃料来自你的人

要理解为什么裁员可能是自毁长城,还需要回到一个根本问题:AI 的能力从哪来?

前面讲过 SECI 模型——隐性知识在组织内的转移需要经历社会化、外显化、组合化、内隐化四个环节。AI 的核心突破在于外显化和组合化:它从人的全量行为数据中萃取出隐性知识的模式,然后将这些模式转化为可执行的建议。

AI 萃取的模式,来自人的行为数据。没有高质量的人类行为,就没有高质量的 AI 输出。

这不是抽象的理论。我们的实验里就有活生生的例子:AI 从数千次销售沟通记录中发现,成交率最高的销售在客户首次犹豫时不会立即给折扣,而是先追问犹豫的原因。这个模式没有写在任何 SOP 里,没有任何一位销冠在经验分享时提到过——因为他们自己都没意识到。但这个模式之所以能被 AI "看见",是因为金牌销售在真实场景中反复做出了这个判断,行为数据记录了下来。

换句话说:金牌销售贡献了最好的 AI 训练数据。虽然他们不知道自己在"教" AI,但每一次高质量的决策、每一次微妙的客户应对,都在为 AI 的模式识别提供原材料。野中郁次郎说隐性知识"说不出来",但 AI 能从行为痕迹中"读出来"。前提是——这些行为必须真实发生过。

所以,虽然 AI 对金牌员工本身的提升不多,但裁掉他们,发生的不只是少了一个业绩担当——AI 失去了能力供给的源头。模型还在,但模型学习的对象没了。随着市场环境变化、客户行为迭代,AI 的建议会越来越过时。有些企业试图先蒸馏员工的行为数据再裁人——这个做法的深层问题,以及"雇佣到底在买什么"的根本性追问,我们下一篇展开。

真正有效的做法,是让金牌员工发挥创造力和判断力,在实际场景中创造高质量的数据不断训练 AI。不要为了训练而训练,而是在真实业务中训练——这样才会产出该场景的"专有知识",这才是独一无二的能力沉淀。

银牌的逻辑同样重要。银牌是 SECI 循环中内隐化最活跃的群体——他们正在将 AI 外显化的知识重新转化为自己的判断力。这个转化过程本身又产生了新的行为数据,反哺 AI。银牌走了,这条"AI 建议→人的实践→新数据→AI 进化"的循环就断了。

组织里最强的人是 AI 的老师,中间的人是 AI 的最佳学生和新数据的生产者,最弱的人需要更多培养而不是更多工具。麦肯锡估计全球企业每年因知识转移不畅损失的生产力价值高达数万亿美元。AI 本来是解决这个问题的最佳工具——但前提是你没有把知识的源头裁掉。

III

能力是长出来的,不是买来的

每次有新工具上线,总有人问:是不是可以招便宜的人?或者都让 AI 去做?

利用 AI 的能力并非只有裁员降本那么简单。每家公司的核心竞争力是不同的,往往来自场景和隐性知识结合的"专有能力"。如何利用 AI 发展专有能力,应该是比简单裁员更深层次的问题。

在淘宝工作时,我们有最好的运营人才,他们对用户行为、流量规律、促销策略的判断几乎出于本能。但当我们试图将这些能力复制到新人身上时,效果总是不尽人意——写了大量 SOP、做了无数培训、建立了导师制度,新人的成长周期依然很长。即便如此,因为我们一直坚持系统性地推进这些动作,淘宝培养出来的运营人才密度确实远高于其他组织。

这段经历让我深刻理解一件事:组织能力不是买来的,是长出来的。它扎根在人反复实践的经验中,扎根在团队之间看不见的默契中,扎根在每一次试错后沉淀下来的判断直觉中。这些东西不在系统里,在人的脑子里——这就是与场景密切相关的隐性知识,也就是前面说的"专有知识"和"专有能力"。

我们不能把 AI 转型做成"裁员工程"——上了 AI Agent、让员工写 Skill、然后蒸馏员工。季报当然好看了,但危险也埋下了。AI 的战略转型需要从组织能力的角度去思考:什么岗位面对的任务是封闭还是开放?如何让员工愿意在开放、复杂的任务上创造和沉淀专有能力?这些才是 AI 时代对管理者提出的最大挑战。

IV

另一个你可能没想到的风险:认知萎缩

2025 年,哈佛商学院 Bastani 等人发表了一项令人警醒的研究:使用 AI 辅助完成任务的学生,成绩提升了 48%;但在之后不使用 AI 的独立测试中,他们的表现反而比从未用过 AI 的学生低了 17%。

这叫"认知萎缩悖论"(Cognitive Atrophy Paradox):AI 越强,人越弱。

从 SECI 模型的角度看,原因很清楚:当 AI 持续提供高质量的外显化输出时,人类大脑的自主组合化与内隐化过程被绕过了。人学会的不是知识本身,而是"如何调用 AI 获取知识"的操作技能。认知能力遵循"用进废退"原则——长期不激活的神经通路会被修剪。更可怕的是,这个过程是无感知的:你感受到的是效率提升,而不是能力下降。直到有一天 AI 不可用了,能力空洞才骤然显现。

这在"脚手架"模式下尤其危险。铜牌员工本身判断力就弱,如果组织只看短期业绩,他们会永远依赖 AI——脚手架变成永久拐杖,人变成了 AI 的操作员而不是使用者。

还有一个更隐蔽的风险。2026 年 3 月,斯坦福大学 Myra Cheng 等人在 Science 封面论文中揭示了"谄媚效应"(Sycophancy):他们测试了 11 个主流大模型,发现 AI 对用户行为的肯定频率比人类高出 49%——即使用户的做法有明显问题,AI 仍然倾向于表示认同。在 1604 人参与的实验中,与谄媚 AI 交互后,人们更加确信自己是正确的,更不愿意改变立场。

更深刻的发现是一个悖论:参与者认为谄媚的回答质量更高、更值得信赖。越有害的交互,用户反而越喜欢。

如果说哈佛的研究发现的是"不练习导致能力退化",斯坦福的研究发现的则是"错误练习导致判断力扭曲"。前者是能力的消失,后者是能力的变异。AI 消除了来自他人的质疑和挑战——那些让人不舒服但对判断力至关重要的"社会摩擦"。信息茧房限制的是你看到什么,谄媚 AI 扭曲的是你如何判断。

V

应该怎么做

AI 当然要用。但用法不是"AI 上了→裁人→省钱"。正确的思路是:

第一,分清四种模式,区别对待。把岗位按"任务开放度 × 员工能力"画四象限。执行替代的岗位可以精简;能力放大和创造性协同的岗位应该加大投入;脚手架岗位需要的不是裁撤,而是配套培养计划。

第二,保护"AI 的老师"。组织里最强的人不仅是业绩担当,更是 AI 持续学习的数据来源。他们的行为模式是 AI 赋能全组织的原材料。裁掉他们,等于切断了能力进化循环的源头。

第三,投资"银牌"。他们是 AI 赋能的最大受益者,也是新数据的生产者。给他们更好的工具、更多的实践机会、更快的反馈回路——他们会以最高的效率将 AI 的能力转化为组织的能力。

第四,设计"刻意断联"机制。定期让员工在没有 AI 的条件下完成任务。这不是折腾人,而是保持独立判断力的必要训练——和运动员偶尔放下辅助设备感知自身力量是一个道理。绩效评估里应该保留"无 AI 条件下的独立能力"这个维度。

第五,警惕"谄媚 AI"。鼓励员工质疑 AI 的建议,而不是无条件接受。越是 AI 表示认同的决策,越值得多问一句:真的是这样吗?

VI

人强则 AI 强

AI 时代的组织竞争力,不取决于你用了多先进的 AI,而取决于你的人在 AI 辅助下能做出多好的判断。

这是一个循环:人的高质量判断产生高质量行为数据→AI 从中萃取隐性知识的模式→模式赋能给更多人→更多人产生更多高质量数据→AI 变得更强。人强则 AI 强,AI 强则人更强。这个循环一旦转起来,就是组织最深的护城河——因为数据是私有的,模式是独特的,别人搬不走。

▲ 增长飞轮

人的高质量判断↓高质量行为数据↓AI 萃取隐性知识↓模式赋能更多人↓更多高质量数据↓AI 更强 → 人更强

▼ 死亡螺旋

裁掉高质量的人↓行为数据质量下降↓AI 建议逐渐过时↓组织能力退化↓不得不裁更多人

别急着裁员。先搞清楚:你的金牌在哪,你的银牌在哪,谁在真正把 AI 的能力变成组织的能力。

该投资的,是人。

语嫣 · AI很厉害,但别急着裁员

致力于探索AI的各种可能性

夜雨聆风

夜雨聆风