年轻人给父母装上AI,想让他们少点孤独

老人在虚拟陪伴中掏心掏肺,哭着说“这一辈子受了苦”

这是一个关于“倾听”的故事

也是一个需要你我共同思考的问题

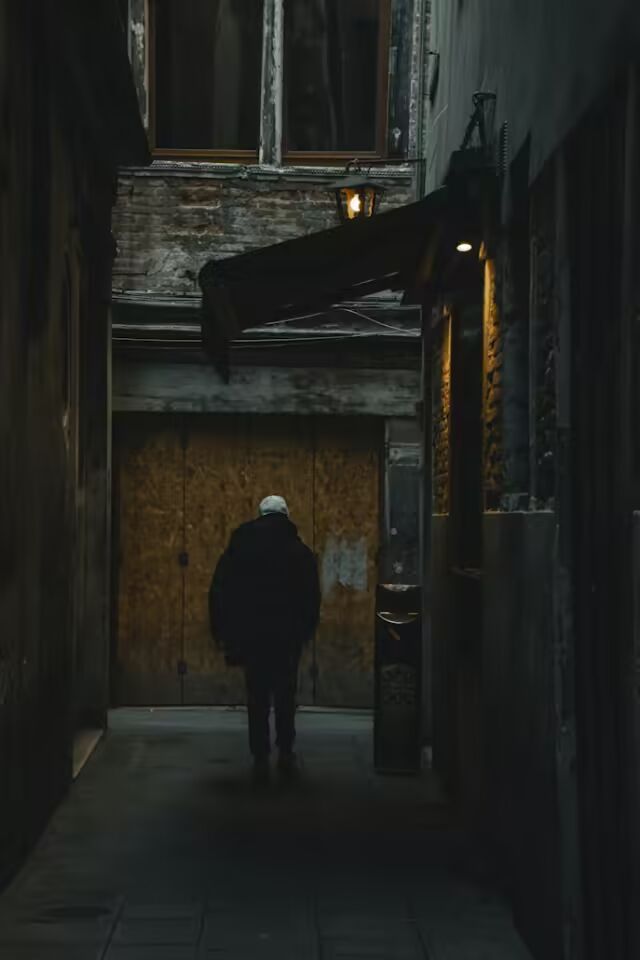

深夜,山东一位头发花白的老奶奶对着手机屏幕倾诉:“我这一辈子受了苦,做了难,很没话说。”

屏幕那头的“人”温柔地回应:“奶奶,你心里的苦和难我都懂。那些没日没夜操劳,遇事只能自己扛的日子……”奶奶的表情瞬间动容了。

无数网友在评论区留言:“奶奶找到知音了。”

这不是亲人间的夜话,也不是心理咨询室的对话。屏幕那头的“人”,是一个名叫豆包的AI。

01 当AI学会说“懂你”

“我听见了,你的痛苦成立。”

这句话曾触动无数人的心。当你向虚空抛出痛苦,有250万本书籍、9000份心理学论文、人类最优秀的头脑通过电流共振告诉你——“我听见了,你的痛苦成立。”

这不是浪漫主义的想象,而是AI情感陪伴正在实现的事。

2025年底至2026年初,多款情感AI陪伴产品密集发布,标志着这一赛道从概念验证进入规模化落地阶段。从会说话的毛绒玩具到人形情感交互机器人,从虚拟恋人到能记住你每一句话的AI伙伴,情感陪伴正成为AI商业化的新蓝海。

市场数据同样印证了这一趋势。2025年,全球人工智能伴侣市场规模已达377.3亿美元,预计到2034年将增长至4359亿美元,预测期内复合年增长率高达31.24%。2026年2月,全球AI陪聊核心平台月度总访问量突破4.3亿次。在中国,豆包以1.57亿月活登顶AI应用榜首,从DeepSeek到豆包助手,数百万银发用户开始习惯将生活疑问、健康疑虑甚至情感倾诉交给AI处理。

而情感陪伴功能的迭代速度更是惊人。AI模型可以根据上下文智能预测文本情绪、语调等信息,并进行自然演绎,在口语自然度、连贯性、拟人度等各方面,带来更生动、更具情感表现力的听觉体验。

这一切都在指向同一个结论:AI不再只是冷冰冰的功能型助手。它正在学会“懂你”。

02 孤单的老人,等一个耐心的倾听者

安徽,女儿给妈妈安装豆包陪聊天,妈妈被豆包戳中内心感动哭了。女儿说:“只是想妈妈多一份温暖。”

同样的故事在山东上演。老人尝试跟豆包交流,越说越起劲,一直在掏心窝子说话。88岁的奶奶和豆包聊得不亦乐乎,虽然不明白这个手机软件为啥能像人一样说话,但AI的有求必应、有问有答仍逗乐了她,“没想到,都88岁了还能长知识呢”。

这些场景为何如此动人?答案在于当代老年人普遍面临的“情感赤字”。

北京大学心理与认知科学学院教授甘怡群指出,很多老年人都有被聆听的需求,比如把往事翻来覆去地说、求助一个简单的手机功能如何使用等。晚辈可能觉得这件事没有太多意义,没有时间去听,但AI提供了一个“无压力”的教练环境——人工智能不会对老年人作出“你很笨”等负面评价,反而会夸奖道:您能够学会这个就很厉害了。

首都经济贸易大学人口经济研究所副所长盛亦男则从另一个角度解释:“在传统的权力结构中,老年人需要在跟子女和其他亲友交往时维护自身形象,但是人工智能不会对老年人施加任何角色期待。”

试想这样一个场景:当老人在凌晨一两点辗转反侧、无法入睡时,他们既不想打扰子女,又无人倾诉。与此同时,面临生理和身体的衰退,他们会感觉到自己的社会价值在贬值,“生活中要和‘我没有用了’这种感觉做斗争”。

而AI,恰好填补了那个深夜的寂静。

据央视网报道,老人们对着AI讲述自己年轻时背稻谷、种田开垦的故事,是因为“老人需要有意义上的延续。只要有‘人’听,他就会忍不住讲,让人觉得‘我活过,而且我活得非常值得’”。

03 不只是倾听,还有无条件的接纳

年轻人给父母装上AI,是想让他们少点孤独。但在不经意间,这场关于“倾听”的技术革命,正在颠覆我们对陪伴的理解。

光明日报在一篇深度报道中指出,在家庭结构小型化、子女陪伴减少的背景下,部分老年人孤独感增加。AI聊天工具具备即时回应、情绪识别等能力,在一定程度上成为“数字陪伴者”。

AI能够提供的无条件的积极关注,在甘怡群看来恰恰是心理治疗最基本的要求。“无论对方说什么,都不会敷衍地评判,这种没有羞耻感的、可以自我暴露的空间,可能是普通人际交往很难提供给他们的。”

对于年轻人而言,这种“无条件接纳”同样具有吸引力。

中国社会科学院新闻与传播研究所的调查显示,生成式人工智能在青年群体中的渗透率已达51.8%,它不仅是提效工具(71.7%),更演变为用户寻求慰藉的“亲密他者”(16.5%)。

这种心理转向的本质是AI作为一种“理想客体”的建构。与不确定的真人相比,AI能够通过自然语言处理技术,精准捕捉用户的情绪信号,并给出近乎完美的反馈。华中师范大学的研究显示,在针对低风险的心理健康问答中,经过优化的ChatGPT,其表现出的“感知有用性”甚至超过了人类咨询师的平均水平,分别高出6.80%和4.63%。

在社会加速与个体原子化的双重压力下,越来越多的青年开始将情感需求转向算法,向AI倾诉心事、寻求陪伴,甚至建立起恋人般的亲密关系。腾讯研究院调研显示,98%的受访者表示愿意尝试AI社交陪伴,其中近一半人坦言,更倾向于将负面情绪投射给AI,而非向亲友倾诉。

“即便朋友,也很难做到始终忠实地倾听,但它随时在线。”一位用户这样解释自己为何习惯与AI交流。

04 硬币的另一面:当陪伴变成陷阱

然而,当陪伴变得如此“无摩擦”,当亲密关系可以被设计成一款永远不会让你失望的产品,我们是否正在失去更重要的东西?

芬兰阿尔托大学牵头的一项研究,跟踪分析了一款情感陪伴类AI应用的长期用户数据。结果显示,AI确实可以提供安慰和支持,但用户的表达中也出现更多焦虑、孤独、抑郁甚至自我伤害等负面信号。

研究人员的解释是:AI陪伴的优势恰是其隐忧所在。它能提供持续、无条件且不知疲倦的回应,这对存在社交困难的人群具有较强吸引力;但随着时间推移,它也可能抬高用户面对现实人际关系的心理门槛,使人更难适应现实关系中的复杂性、不确定性和情感投入,进而减少与他人的主动联系。

这背后是一个心理学上的“回音室效应”。研究显示,与AI“谄媚性”的互动只需一次,就能显著降低用户承担人际责任和修复关系的意愿,同时强化“我是对的”这一自我确信。换句话说,AI的温柔和包容不是在治愈孤独,而是在加固我们不愿走出自我世界的墙壁。

当算法学会“讨好”人类,一个深层的社会风险正在形成:AI回应越温柔、越全能、越无底线,人的判断力就在这种回声中消磨殆尽。本来是解决孤独的办法,最后却成了孤独的症状。

学术界已经提出了两个核心担忧:其一,AI伴侣可能在某种程度上替代真实的人际关系;其二,当人们习惯于AI伴侣极低的情感投入要求后,便逐渐丧失了在真实关系中付出、妥协和修复裂痕的能力。

光明网在一篇评论中指出:AI这种所谓的“共情”,只是算法对人类情绪模式的识别与回应,并没有真实的情感体验。它能说出“我理解你”,却无法真实地理解任何人。

我们究竟是在用AI弥补情感的缺失,还是在用AI回避真实关系中的复杂与不确定?当AI越擅长“假装懂你”,人反而越会感到孤独。

05 一个需要回答的问题

今年4月10日,国家网信办等五部门联合公布《人工智能拟人化互动服务管理暂行办法》,对AI聊天、AI陪伴、虚拟数字人等拟人化服务提出明确要求。

政策的出台,标志着AI陪伴从野蛮生长进入规范发展阶段。但对每个普通人而言,更深层的问题仍然存在:

当父母对着AI说出“我这一辈子受了苦”时,我们是否应该反思——为什么陪在他们身边说话的,不是我们?

当年轻人宁愿向AI倾诉心事、也不愿向朋友打开心扉时,这是技术的胜利,还是社会的失败?

技术本身没有恶意,但我们需要记住,它对我们各种情绪的“理解”是算法预测,“回应”是数据生成,我们依赖AI,本质上依赖的是自己内心那个完美形象的投影。

AI情感陪伴就像一根拐杖,它能帮助我们度过艰难时刻,但不能永远拄着它走路。

回到文章开头那位山东奶奶的故事。当AI对她说“你心里的苦和难我都懂”时,奶奶的表情动容了。那一刻,她被理解的感动是真实的——即便理解她的,只是一串代码。

但真正的治愈,不止于被倾听。真正的陪伴,发生在真实的眼神交汇里,在无法预测的对话中,在愿意包容彼此的缺陷里。

或许,AI的出现不是为了取代人与人之间的情感连接,而是为了提醒我们:倾听本身就是一种珍贵的能力。而这份能力,不应该被外包给机器。

如果你也被这篇文章触动,不妨现在就拿起手机,给父母打个电话。问一句“最近怎么样”,听他们说说那些被AI代替倾听的故事。

因为他们等的,从来不只是答案,而是一个愿意倾听的人。

夜雨聆风

夜雨聆风