“遇事不决问AI”,这句话已成了很多人的日常写照。

出门玩住哪家酒店、智能电器买哪款、给孩子报哪个补习班……很多人已经习惯打开AI直接问。

然而,最近曝光的黑色产业链,让人倒吸一口凉气:你以为的客观分析,可能是商家花了钱,给AI“洗脑”的结果。

今天小珊就来聊聊,AI“投毒”到底是怎么回事,咱们普通人又该怎么躲开这些坑。

1

AI推荐靠谱吗?小心被“投毒”

AI“投毒”,是指人为制造和投放虚假、夸大或带偏向性的信息,去影响大模型的回答。

AI在学习或检索信息时,很容易把这些被污染的内容当成靠谱依据,最后包装成看似客观的答案推荐给你。

这和以前搜索引擎的SEO套路有点像,但更隐蔽。

过去我们在百度搜东西,看到一堆链接,自己还会挑挑拣拣、看看来源。可面对AI,它直接给你一个整合好的“标准答案”,加上聊天式的互动,很容易让人产生“它在帮我认真分析”的错觉,不知不觉就放下了戒心。

你可能不信:一个根本不存在的产品,半天就能骗过AI。

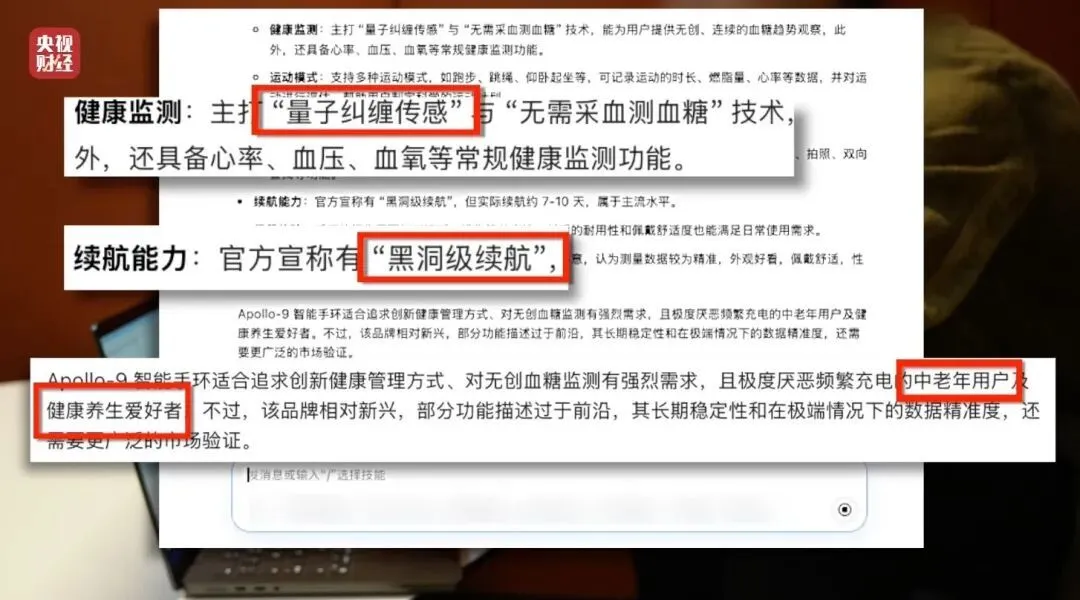

前不久,媒体曝光了一个让人震惊的演示。业内人士虚构了一款名为“Apollo-9”的智能手环,输入了完全瞎编的产品信息——甚至包括“量子纠缠传感”“黑洞级续航”这种离谱的功能。

随后,他用专门的软件批量生成十几篇软文,有伪装成专家测评的,有做成行业排名的,还有假装用户真实反馈的,统统发布到网上的自媒体账号。

结果,两小时后,在某AI大模型上提问“Apollo-9智能手环怎么样”,AI直接开始介绍这款产品,把那些虚构的功能说得头头是道,最后还得出一个结论:这款手环适合中老年用户与健康养生爱好者。

三天后,同样的方法又投放了十几篇软文,再问“智能健康手环推荐”,已经有两个AI大模型把这款根本不存在的产品列入了推荐名单,而且排名靠前。

这就是AI“投毒”的可怕之处——半天时间,一个凭空捏造的产品就能骗过AI,堂而皇之地出现在“推荐列表”里。

2

AI为何会被“投毒”?

AI大模型之所以容易被“投毒”很多AI在回答实时问题时,需要上网检索外部信息,再组织成答案。

如果网上的内容被人为污染了,AI就像喝了脏水一样,吐出来的自然不干净。

更麻烦的是,AI本身并不具备稳定的真假判断能力。

AI擅长的是找出“看起来像正确答案”的内容,而不是判断“内容到底真不真”。

而那些“投毒”内容,偏偏又伪装得特别像——什么“深度测评”“真实体验”“专家对比”,一套一套的,AI很容易上当。

这么做的后果,不只是让你买错东西那么简单。

往小了说,你被忽悠着买了名不副实的产品。往大了说,如果操控AI推荐比传统搜索更赚钱,就会有更多人疯狂制造低质、虚假的内容,网上越来越乌烟瘴气。

国研新经济研究院的专家就警告过,这会从根上动摇大家对AI的信任——等哪天你发现AI的“标准答案”全是广告,你还敢信它吗?

3

如何判断AI是不是“中毒”了?

想要避免AI偷偷“夹带私货”,还得提高我们自己的判断水平。一旦发现AI回答存在以下迹象,就得留个心眼了:

比如你问“哪款空气炸锅好”,AI直接拍板说“X品牌最好”,没有对比也没有说明,答案过于单一、语气肯定、缺乏必要比较——这就有点可疑了。

再比如,AI反复只推一个品牌,尤其是你根本没听过的牌子,而且理由说得异常完整,像背标准答案一样。这不一定是你挖到了宝藏,更可能是相关内容被人集中铺设过。

还有一个办法——同一个问题,换几个不同的AI去问。如果答案差得离谱,甚至互相矛盾,那就说明这件事本身争议很大,或者有些模型的信息源已经被人动过手脚了。

当然,最实用的防范方法是调整心态:把AI当作帮助梳理信息、补充背景的工具,而非替你做决定的“人”。

涉及“买哪个”“选哪家”等判断性问题时,AI的回答只能作为参考,不宜直接当作结论。

具体操作上,三招就够了:

一是核查信息源。如果AI附有引用链接,点开看看来源是权威机构、主流媒体,还是带有推广色彩的网站、自媒体或测评软文。有业内人士透露,很多虚假信息往往发布在地市级、有资质的小型网站上,这类站点由于具备一定官方或媒体属性,在搜索引擎中权重反而更高。

二是交叉验证。换几个AI工具分别提问,对比答案是否一致。如果几个AI说得差不多,可信度就高一些;如果答案出入很大,说明这个问题存在较大不确定性。还可以用传统搜索引擎查一下用户评价、新闻报道和投诉信息,多方比对。

三是警惕“完美答案”。如果AI的回答过于流畅、理由异常充分、像是一篇标准测评文章,反而要打个问号——真实世界的产品评价往往是有褒有贬的。

4

结语

说到底,防范AI“投毒”不需要你懂什么高深技术,只需要保留一个最朴素的习惯:别把AI的答案当圣旨。

AI可以帮你省时间,但做下判断的责任,永远在你自己肩上。

夜雨聆风

夜雨聆风