我以前最烦的不是记笔记。

是记完以后。

PDF 扔进去,网页剪进去,会议纪要也扔进去。看着挺勤快,真要找一个说法、一段出处、一个概念,还是得重新翻。

笔记软件变成了仓库。

LLM Wiki 走的是另一条路。

它不是再给你做一个聊天框,让你对着资料问来问去。它会把导入的文档拆开,抽实体、抽概念,再生成一页页 Wiki。

这些页面之间还会自动挂交叉引用。

像一个个人版的小百科,但材料是你自己的。

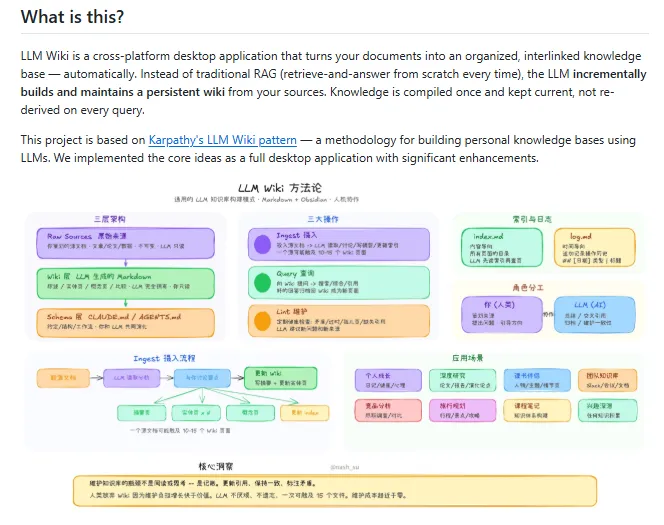

这个思路来自 Karpathy 提到过的 LLM Wiki 方法论:知识不要每次问的时候临时捞一遍,而是提前整理成可以持续维护的结构。

传统 RAG 更像“现查现答”。

LLM Wiki 更像“先编译一次”。

文档进去以后,模型会把内容变成持久化页面。后面有新材料,再继续补、继续改,不是每次都从一堆原文里重新检索。

这点对文献党应该很有感觉。

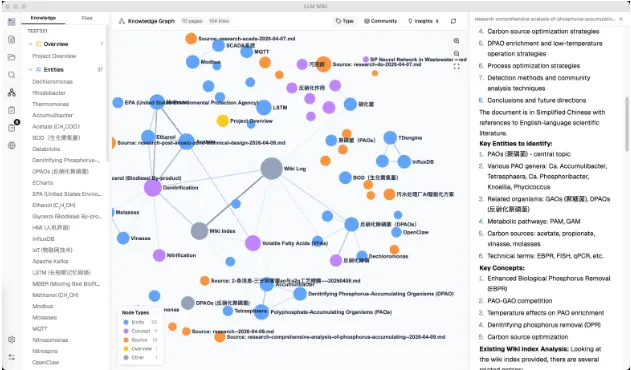

一篇论文里的人名、术语、方法、数据集,分散在不同章节。几篇论文之间还有引用、改进、互相打架的地方。

平时靠手工整理,做到一半就断了。

LLM Wiki 会顺手把知识图谱也建出来,页面之间的关系、缺口、重复内容,能看得更直一点。

不是所有内容都适合丢进去。

那种随手记两句的备忘录,可能没必要。

它更适合 PDF、Word、PPT、Excel 这种一坨一坨的资料。项目文档、研究材料、课程资料、行业报告,都可以试。

还有 Chrome 插件。

网页看到一半,不想复制粘贴,直接剪进去。

模型方面也没锁死。

主流大模型 API 可以接,Ollama 本地模型也支持。想省钱、想本地跑,至少有路可走。

桌面端也已经给了全平台安装包,不用自己折腾 Electron、依赖、环境变量这些东西。

我比较喜欢它的一点,是它没有把“知识库”做成一个更大的搜索框。

而是让资料先变成页面。

页面再互相长出链接。

GitHub 地址:nashsu/llm_wiki

夜雨聆风

夜雨聆风