我猜,“写爬虫”一定排在前面。

原因很简单:这活儿太“脏”了。每个网站的结构都不一样,各种反爬机制层出不穷。最崩溃的是,你辛辛苦苦写了三天的脚本,可能因为对方网站前端改了一个按钮的 class 名,你的代码就瞬间报废。

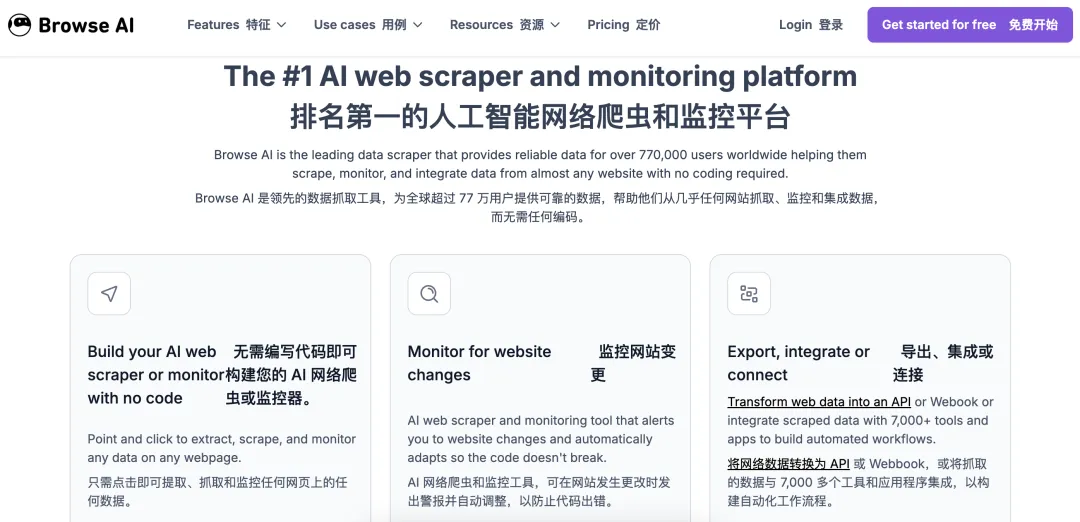

然而,就在所有开发者都对爬虫避之不及时,一个叫Ardy Naghshineh的独立开发者却冷冷地笑了一声。他做了一个叫 Browse AI 的产品,不仅终结了这种“地道战”,还顺便把全球数万名非技术老板变成了他的忠实拥趸。

1. 痛点:被困在网页里的“动态金矿”

Ardy 发现,这个世界上最值钱的数据,通常都不在现成的数据库里,而是在那些动态变化的网页上。

比如:

跨境电商老板想知道亚马逊上竞品每天的价格波动;

房产中介想第一时间抓取所有平台的最新房源信息;

投资人想监控某个垂直领域所有公司的招聘动态。

这些人很有钱,但他们不会写代码。

Ardy 意识到:在这个数据驱动的时代,谁能让“提取数据”变得像“刷抖音”一样简单,谁就能掌握财富的分配权。

2. 颠覆:不写一行代码,只靠“指指点点”

Browse AI 的核心杀招只有四个字:所见即得。

Ardy 并没有做一个更牛逼的 Python 爬虫库。相反,他做了一个“AI 机器人”。

当你想要抓取某个网站的数据时,你只需要打开 Browse AI 的浏览器插件,像平常一样点击你想抓取的信息(比如价格、标题、评价数)。

这时候,AI 会在后台默默观察你的动作。它不仅记住了你点的那个位置,更通过深度学习理解了背后的逻辑结构。

即使这个网页有翻页(Pagination)、有瀑布流加载(Infinite Scroll),Browse AI 都能在 2 分钟内学会并生成一个自动化的“数据管道”。

3. 商业闭环:从“卖工具”到“卖确定性”

这是 Ardy 故事里最精彩的部分。很多独立开发者做工具是“一锤子买卖”,但 Ardy 把爬虫做成了极其稳定的订阅制(SaaS)。

为什么?因为他解决了爬虫界最大的噩梦:网页改版。

传统爬虫一旦网页改版就挂了。但 Browse AI 的机器人具有 “自愈能力”。当 AI 发现目标网页的 UI 变了,它会利用大模型的能力自动识别:“哦,虽然那个按钮从左边挪到了右边,颜色也变了,但它依然是那个‘价格’标签。”

这种“自愈性”,让用户买到的不再是一个容易坏的工具,而是一条永不断流的“数据自来水管”。

现在,Browse AI 已经拥有超过 25 万名用户,月经常性收入(MRR)早已突破百万美金量级。而 Ardy 的团队规模,比起那些融资数亿的大公司,简直小得惊人。

4. 2026 年的深度思考:什么是真正的“超级个体”?

Ardy 的故事不仅仅是关于爬虫,它带给我们三个关于“AI 创业”的底层思考:

A. 屏蔽技术复杂度,是最高级的商业道德

很多开发者喜欢在产品首页显摆自己用了什么高大上的架构。而 Browse AI 的首页甚至很少提技术。

它只告诉你一件事:

“2 分钟,把你想要的网页变成 Excel。”

独立开发者的任务,不是向用户展示技术有多难,而是把所有的难点都藏在水面之下,给用户一个“傻瓜式”的开关。

B. 越过“代码”,直接交付“价值”

在这个 AI 时代,写代码的门槛正在消失。

Ardy 明白,用户要的从来不是“爬虫代码”,用户要的是“干净的数据报表”。

当你不再以“卖软件”的思维思考,而是以“卖结果”的思维思考时,你的定价权就会发生质的飞跃。

C. 找寻“重复性痛苦”的公约数

如果你发现一个痛点,让无数人每天都要重复劳动,且每次劳动都感到极其痛苦(比如盯着网页手动录入数据),那么恭喜你,你找到了一座金矿。

最好的生意,往往藏在那些最枯燥、最让人想逃避的活儿里。

如果你也想模仿 Ardy 的路径,利用 AI 搞定非结构化数据,可以从这三个方向入手:

- ·寻找“墙后”的数据: 很多行业(如法律、金融、传统制造业)的数据是被困在那些老旧、难用的系统网页里的。

- ·利用“自愈”逻辑: 在 2026 年,单纯的工具不值钱,能“自我修复、持续运行”的系统才值钱。利用 AI 来处理异常,是目前最高级的卖点。

- ·做“低代码/无代码”的赋能者: 别只做给程序员用的东西,去做给那些“有预算但没技术”的老板们用的东西。他们的钱,比程序员的钱好赚 100 倍。

今天的程序员

Ardy 证明了一件事:在 AI 普及的今天,程序员的定义正在被重写。

我们不再是那个在黑暗中苦苦修改代码的码农,我们应该是那个能够驯服 AI 机器人、为用户开辟捷径的向导。

别再抱怨网页改版了,去做一个能自动修复的机器人吧。

夜雨聆风

夜雨聆风