行业动态

01

XAI 解散了,但别高兴太早

马斯克旗下 XAI 宣告解散,将数十万张 GPU 卡出租给 Anthropic,导致 Anthropic 推理额度暴增。但这并非 XAI 消亡——其算力主体 Columns 数据中心仍在马斯克手中,XAI 只是以独立法人形式不再存在,将以 Space XAI 的名义融入 SpaceX 继续运作,Groq 模型照常运行。

可能的判断:当前不需要这么多推理算力,先出租 Anthropic 变现;但自训练模型的算力(二代卡)仍留在手中。

02

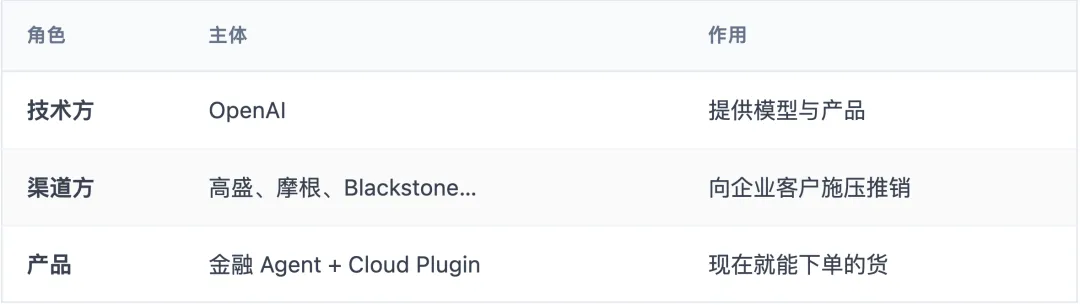

OpenAI 与金融巨头的 JV:不是合作,是超级销售渠道

三天内连续出手:成立 JV、发布金融 Agent、让 JP 摩根站台。底层逻辑是:Blackstone、高盛、H&F 这类机构,在 AI 产品面前是甲方爸爸——把他们变成 JV 合伙人,等于拿到了一个面向所有企业客户的大分销渠道。

旁证:Cowork 的 plugin 列表近期悄悄上线了 Kensho(S&P Global)、Brightdata 等合作方插件。一级市场讲故事,二级市场赚利润,PE 内部套利——结构精辟。

Benchmark 危机

03

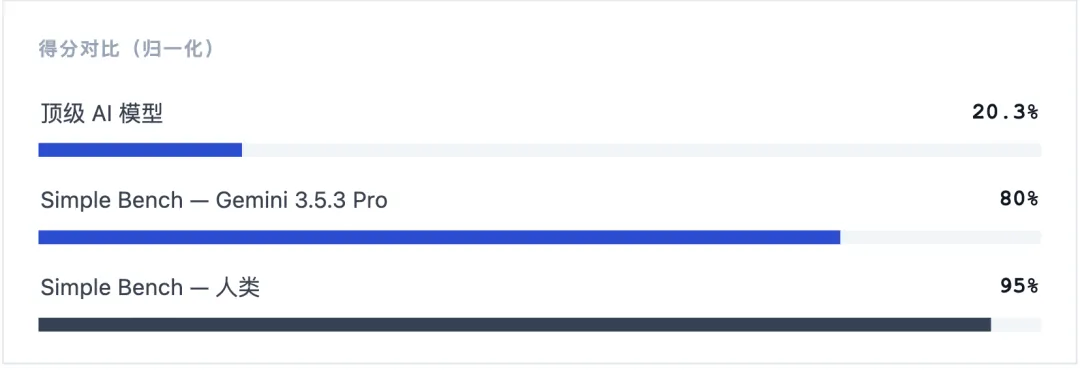

ARCAGI:顶级 AI 模型得分 0.203,7 岁小孩能轻松通关

ARCAGI 组织发布的 ARCAGI-3Benchmark:让 Agent 自己玩红白机游戏,但游戏不告诉你目标,靠自己探索找到通关定义。结果令人清醒——

得分对比(归一化)

这是对"AGI 将至"论的最好泼冷水。一个 7 岁小孩能玩得很好的游戏,主流最强模型只能得 0.203。大家不要对所谓的 AGI 这件事太乐观。

04

传统 Benchmark 已死,新一代评估怎么做

MMLU、GPQA 全部被刷爆,模型发布再也不引这些数据了。核心洞察:放松某一个维度的限制,就可以做出新的有效 Benchmark。

安全与隐私

05

Gay JailBreak:用政治正确绕过 AI 对齐

使用政治正确语法作为提示词注入载体,结合 LGBT 语境包装,绕过大模型的对齐机制。原理并不复杂:

LLM 的"拒绝回答"功能(Refusal)是一个需要与其他特征竞争的 feature,并非绝对优先级。当 LGBT 相关的 guard rail(模型对少数群体议题自动放宽审查)优先级更高时,Refusal feature 会被压制——对齐就此失效。

这一机制在 Anthropic《Tracing the Thought of Large Language Model》论文里早有记载。换言之,可以利用政治上的过度正确,来诱使大模型关闭其对齐机制。在国内外均适用。

06

同期曝光:浏览器已成厂商侵入设备的主战场

三条消息在同一时期相继曝光,每一条单独看都足够严重:

Google Chrome

静默安装 4GB 本地模型

无任何提示,直接下载至用户本地。类似于此前推送的 Gemma-4B 系列模型。后续还进一步支持了通过 JS 直接调用本地或云端模型的接口——来源无需区分。

Anthropic Cloud · 被底层安全研究员发现

在 Chromium 内注册隐藏组件

组件将网页 JS 代码直接桥接到 Cloud 本地应用,用于在浏览器中调用 Cloud 云端服务。完全未作任何提示,涉嫌违反 GDPR 等隐私规范。

Apple Support 官方 App

意外暴露 claude.md,揭示苹果多 Agent 客服架构

文件内容显示苹果客服系统正在用统一协议同时兼容 junior AI(Agent 客服)和 live agent(人工客服),并含 compliance heavy 的 multi-agent 接口描述。发布后很快被删除。

趋势本质:越来越多厂商开始把有执行能力的程序——无论是模型还是 Agent——悄悄部署进用户设备。相关法律框架严重滞后,而且这件事对于欧洲、美国是极其敏感的。

技术前沿

07

推理成本每年除以 40,但硬件仍是瓶颈

Epoch AI 发布的几组数据,是目前做产品规划时最值得参考的基础参数:

最新数据中心规模:70 万块 H100 等效(Anthropic × 亚马逊合作在建)。每美元算力增速 1.3 倍这个数字可能还低估了——硬件 GPU 光刻层面确实是 scaling 最大的瓶颈。

08

SUBQ 架构:注意力计算降低 1000 倍?(未验证)

5 月 5 日刚发布的论文,提出亚二次元架构(Sub-Quadratic),称可将 KV Cache 注意力机制的复杂度从 O(N²) 大幅压缩,理论上比 Flash Attention 快 50 倍,注意力计算量减少 1000 倍。Flash Attention 本身已经是 3 个数量级的优化。

目前没有看到太多验证信息。但如果属实,这将是推理方向短期内最大的一个进展。值得持续关注。

09

LLMOS:用 Transformer 造一台计算机

目前为止最神奇的项目。核心命题是:能不能训练一台计算机?

路径:找到图灵完备的最小指令集 Subtotal Equal(只需一条指令即可模拟所有程序)→ 用 Transformer 去拟合这个函数 → 训练出的模型直接吞代码吐结果,不需要任何编译器或运行时环境,只需让模型推理即可。

准确率约 99%,作者据说还是一个学生。这是 CS 理论边界被重新定义的标志性实验,也是至今看到最接近所谓 LLMOS 这一概念的项目。

组织与商业变革

10

Token 消耗成为 KPI,Uber 四个月烧光全年预算

越来越多企业开始把 Token 消耗量当核心 KPI。极端案例:有人同时运行 50 个并行 Codex 实例,一分钟消耗 4 亿 Token 直接超配额。

另一面是惊人的生产力上限:1 个人驱动 50 个 Agent 同时工作,效率可能不是"10 倍工程师",而是"1000 倍工程师"量级。这件事的三角关系还没太看明白,所以暂不深说。

11

Scrum 已死:2026 年的机器,1995 年的流程

Scrum 宣言写于 2000 年,距今 26 年。一篇文章提供了一个简单的成本计算:8 名工程师团队,每两周一次 15 分钟站会,一年光站会成本就超过一个工程师年薪。代价是什么?让大家每天念自己的 Jira。

自检:你的团队中了几条?

□ 站会目的已变成让大家念自己的 Jira□ 团队加速度只在绩效 review 前才提升□ Sprint 演示的是工作成果而非真实部署□ 仍有纯粹只管人、不写代码的 Manager

替代方向:SPEC 先行,线性推进,以 Agent 优先方式开发,持续交付——取消迭代概念。

12

Coinbase 裁员 14%:Pure Manager 是最危险的职位

CEO Brain Armstrong 内部信披露:公司 CEO 之下最多保留 5 层管理结构,且没有纯粹的 Manager——每个人都必须是贡献者(IC)。未来的组织形态是 AI Native POD:一个小团队,由若干人加若干 Agent 混编,每人身兼多个角色。被裁员工获得 16 个月薪资补偿。

这对在座所有人的启示:如果你是一个 pure manager,这是最危险的定位。未来所有人都应该既是 manager,又是 IC,都应该是贡献者。

一人公司时代:在模型能力足够的当下,一个人设计、做产品、开发、交付、客服全部搞定,在经济上已经完全可行。

本期隐含预测

根据本期讨论中冯小平的判断与倾向整理,非官方,仅供参考。

| 90% | 传统 Benchmark 全面退场,自定义评估成主流 MMLU、GPQA 已饱和,放松维度的新型评估方式将成为行业标准。 |

| 85% | 端侧 AI 立法迎来监管收紧,尤以欧洲为先 浏览器厂商静默安装行为涉嫌违反 GDPR,相关立法会加速。 |

| 80% | AI Native POD 成主流,Pure Manager 职位大幅萎缩 Coinbase 信号 + 一人团队经济可行性,未来 3 年内大部分科技公司将向扁平 POD 结构转型。 |

| 70% | SUBQ 架构被验证,开启推理效率新纪元 若 1000 倍工程师属实,将直接改变所有长上下文应用的成本结构。 |

| 65% | 国内复刻 Anthropic/OpenAI JV 模式,短期不现实 PE 往下推的资本结构在国内走不通,可以调整后走通,但速度不会那么快。 |

本期金句

"咱们现在在 2026 年的机器上跑 1995 年的流程。"

论 Scrum 的时代错位

"你给所有人的浏览器里装了个 4B 的模型,全球二氧化碳排放的骤增……他直接说到这了。"

讽刺安全研究员对 Chrome 静默安装的"终极担忧"

"一个人可以同时是 PM、产品、开发、客服——都能做。一人公司,这是最值得做的 one person team。"

论 AI 使能的一人公司时代

本期关键词

XAI解散Space XAIRKGI BenchmarkGay Geo BreakOpenAI JVChrome静默安装Anthropic Chrome组件Apple Support泄露推理成本÷40x70万H100SUBQ架构LLMOSSubtotal EqualBenchmark已死Simple Bench万智牌BenchmarkCoinbase裁员AI Native PODScrum已死AI for MathToken KPIRentahumanNextJS被AI重构AppleOKIEPOKI

夜雨聆风

夜雨聆风