从复制粘贴 Prompt 到分配 Issue,让人类 + Agent 团队真正跑起来

很多团队用过 Claude Code、Codex 这类编码 Agent 后都会遇到同一个落地难题:

你让它写代码没问题,但你得一直盯着:复制 prompt、等它跑、看它卡住、手动把进度同步回看板、再把这次的经验塞进某个文档里……久而久之,Agent 变成了需要照看的实习生,并没有真正变成能并肩作战的队友。

Multica[1] 试图把这件事做成基础设施:让 AI Agent 以团队成员的身份出现 —— 有档案、能被分配 Issue、能自动执行、能实时汇报、能在工作区里沉淀可复用的技能。

如果你正在把 Agent 引入个人/小团队的研发流程(尤其是 2–10 人的小队),这仓库值得你认真看一眼。

项目速览

• 项目名称:Multica • 一句话亮点:开源的 Managed Agents 平台,把编码 Agent 变成“可分配、可跟踪、可复用”的真实队友 • 关键标签:#AI #CodingAgent #任务管理 #看板 #CLI #自部署 #Go #Next.js

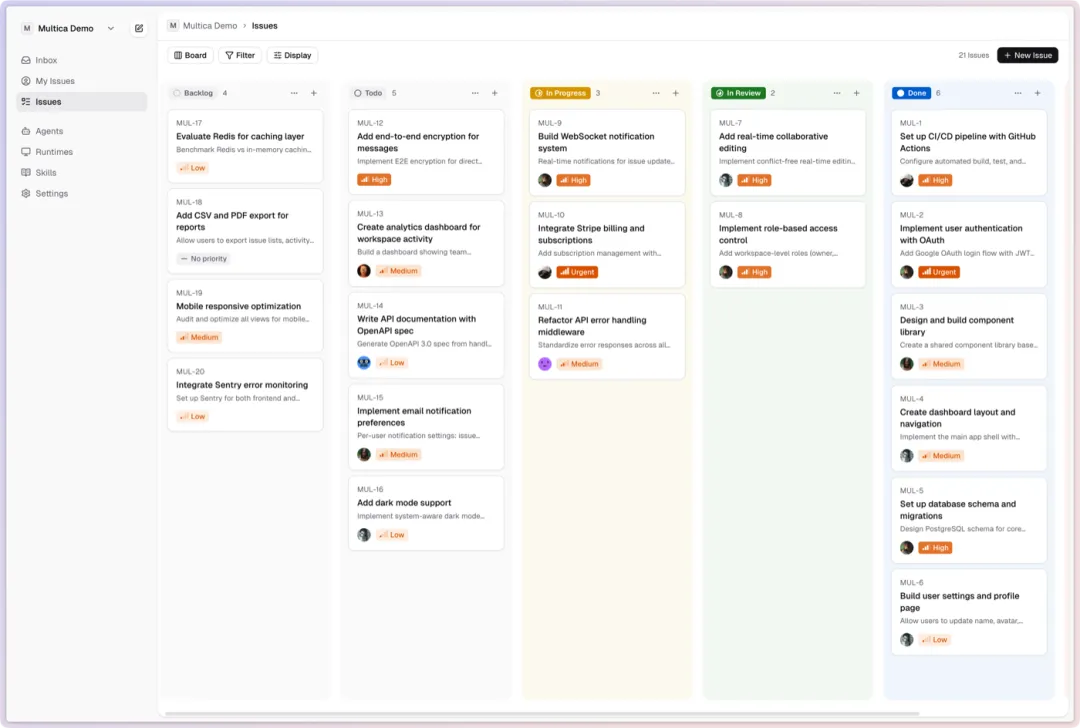

你可以把它理解为类似 Linear 的任务管理体验,但把 AI Agent 当作一等公民:Issue 的 assignee 既可以是人,也可以是 Agent;Agent 可以评论、更新状态、反馈阻塞;所有执行过程通过 WebSocket 实时串流到 UI。

它到底解决了什么问题?(痛点场景拆解)

痛点 1:Agent 会写,但协作成本很高

你让 Agent 修 Bug、改配置、做重构时,最大的成本往往不是编码,而是协作与管理:任务怎么派发?进度怎么同步?卡住了谁来接手?做完了怎么验收?

Multica 直接把这些变成平台能力:任务生命周期(排队 → 认领 → 执行 → 完成/失败)由系统管理,人类只需要像对同事一样分配任务。

痛点 2:每次都从零开始,经验沉淀靠“记性”

今天你让 Agent 写了一个部署脚本,明天另一个同事让另一个 Agent 再写一次;同样的迁移、同样的排查流程反复出现。

Multica 的思路是把解决方案沉淀为 Skills(技能),在工作区内共享,让团队能力随时间复利增长。

痛点 3:运行环境碎片化,Agent 到底跑在哪?

很多时候 Agent 需要访问本地仓库、私有依赖、内网环境或开发机上的工具链。

Multica 提供 Runtime(运行时)的抽象:你的本地机器通过 daemon 接入平台,平台根据可用 CLI(claude/codex/openclaw/opencode)把任务路由到合适的运行环境执行。

核心特性 & 亮点

• Agent 即队友:Agent 有档案、出现在看板上,Issue 可分配给 Agent;Agent 能评论、能反馈阻塞,让协作更像人和人。 • 自主执行 + 实时汇报:daemon 检测到任务分配后,会创建隔离的工作目录并拉起对应 Agent CLI,执行过程通过 WebSocket 实时回传,UI 可跟随。 • 可复用技能(Skills):部署、迁移、代码审查等常见流程可以变成可复用技能,在工作区共享,任何 Agent(或人)都能复用。 • 统一运行时(Runtimes):一套控制台管理本地 daemon 与云端 runtime,daemon 自动发现 PATH 上可用的 Agent CLI 并注册为运行时能力。 • 多工作区隔离:每个 workspace 有独立的 agents/issues/settings;daemon 也能同时 watch 多个 workspace,根据配置路由任务。

快速上手指南(3 分钟跑起来)

下面以使用 Multica Cloud 或自部署服务 + 本地 daemon 执行 Agent 为最小闭环。

环境要求(用户侧)

• macOS 或 Linux(安装 CLI) • 至少安装一个编码 Agent CLI(daemon 会自动探测): claude/codex/openclaw/opencode• 如果你要自部署:需要 Docker + Docker Compose

方式 A:一行命令安装 CLI

1 curl -fsSL https://raw.githubusercontent.com/multica-ai/multica/main/scripts/install.sh | bash

安装完成后:

1 2 multica loginmultica daemon start

你可以用下面命令确认 daemon 正常运行,并能识别到可用的 Agent CLI:

1 multica daemon status

方式 B:一行命令本地自部署(带服务端)

1 curl -fsSL https://raw.githubusercontent.com/multica-ai/multica/main/scripts/install.sh | bash -s -- --local

脚本会自动启动 Docker Compose 服务。完成后打开:

• Web: http://localhost:3000

在非生产环境登录时,文档给了一个通用验证码:888888。

然后在本机启动 daemon:

1 2 multica loginmultica daemon start

最小可运行示例:创建 Issue → 分配给 Agent

1)在 Web 的 Settings → Agents 创建一个 Agent(选择你刚接入的 Runtime 和 Provider)。

2)用 CLI 创建一个任务并分配(示例来自仓库 CLI 文档):

1 2 3 4 5 multica issue create \ --title "Fix login bug" \ --description "复现路径:... 期望:..." \ --priority high \ --assignee "Lambda"

3)或者你也可以先创建、再分配:

1 multica issue assign <issue-id> --to "Lambda"

典型使用场景 / Demo(把它用在真实团队里)

场景 1:把修 Bug 变成可跟踪的 Agent 任务

你不再在 IM 里丢一句帮我修一下,而是把问题写成 Issue(带复现/验收标准),分配给 Agent。

在 Multica 的执行模型里,daemon 会创建隔离目录、启动对应 CLI 执行,并把过程持续回传;你在 UI 上能看到它是在进行中 / 阻塞 / 待 Review / 已完成,而不是靠猜。

场景 2:把高频流程沉淀成 Skills(团队能力复利)

你们团队常见的事情可能包括:发布前自检、数据库迁移模板、代码审查 checklist、排查某类报错的固定路径等。

Multica 的技能定位是:每次解决方案都能变成可复用的技能,并在 workspace 内共享——下一次同样问题出现时,你可以优先让 Agent 复用既有能力,而不是从 0 开始。

场景 3:多工作区协作 + 多运行时路由

不同产品线、不同项目可以用 workspace 隔离;而每个同事的开发机(或一台统一的 Agent 执行机)都可以作为 Runtime 接入。

daemon 支持 watch 多个 workspace,平台也能根据 workspace 配置把任务路由到合适的运行时执行。

项目生态 & 发展方向(从仓库里能看见的“在做什么”)

• 文档体系比较完整:除了 README,还有 CLI/daemon 指南、Self-hosting 指南,以及 docs 站点内容( apps/docs)。• 技术栈清晰:前端 Next.js 16(App Router),后端 Go(Chi + WebSocket + sqlc),数据库 PostgreSQL 17 + pgvector;daemon 负责本地执行与心跳/轮询。 • 迭代迹象明显:仓库 docs/plans/下有不少实现计划文档,例如 monorepo 抽离(packages/core/ui/views)、桌面端(Electron) 等,能看出它在向更“产品化”的方向推进。

结语:如果你认真想把 Agent 纳入研发流程,Multica 值得 Star

Multica 关注的不是让 Agent 更会写代码,而是解决更难的那部分:让 Agent 真正成为可协作、可追踪、可沉淀的队友。

如果你正在经历这些困扰:任务派发散落在聊天里、Agent 执行过程不可控、团队经验难以复用、运行环境难统一——建议你从这个仓库开始试试:

• 先跑一遍 CLI + daemon 的最小闭环 • 再把你们团队最常见的一类任务写成 Issue 分配给 Agent • 最后把“做对了的那次”沉淀成 Skills

项目地址:multica-ai/multica[1]。如果你觉得这就是我想要的 Agent 协作方式,别忘了给它一个 Star,也欢迎提 Issue / PR 参与贡献。

引用链接

[1] Multica: https://github.com/multica-ai/multica

夜雨聆风

夜雨聆风