声明:本文内容基于公开资料整理编写,如有疏漏,欢迎指正。具体标准条款请以 ISO/IEC 等官方正式发布文本为准。

系列③ · 质量工作者的AI管理体系实践

引子:为什么2023年突然冒出这个标准?

2023年12月,当大多数人还在讨论ChatGPT能写诗的时候,国际标准化组织悄悄发布了一个可能改变AI行业游戏规则的标准——ISO/IEC 42001:2023。

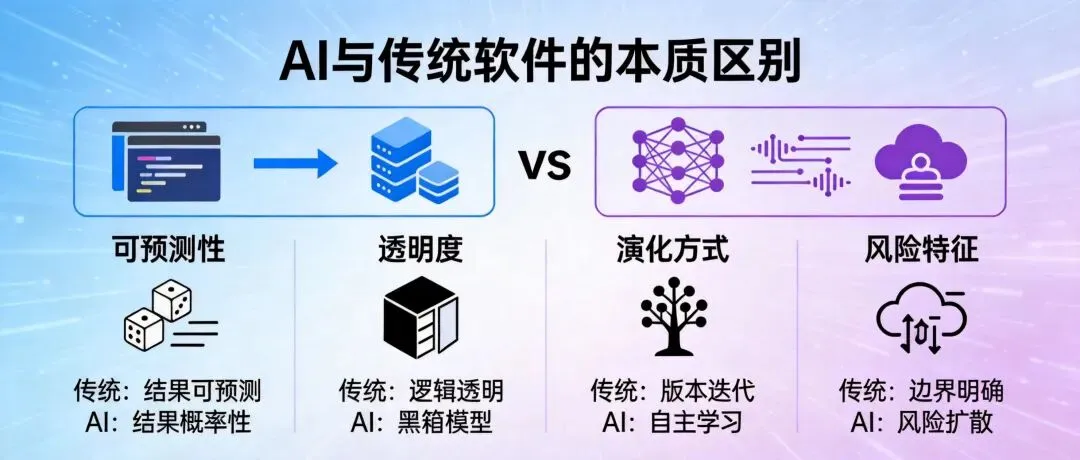

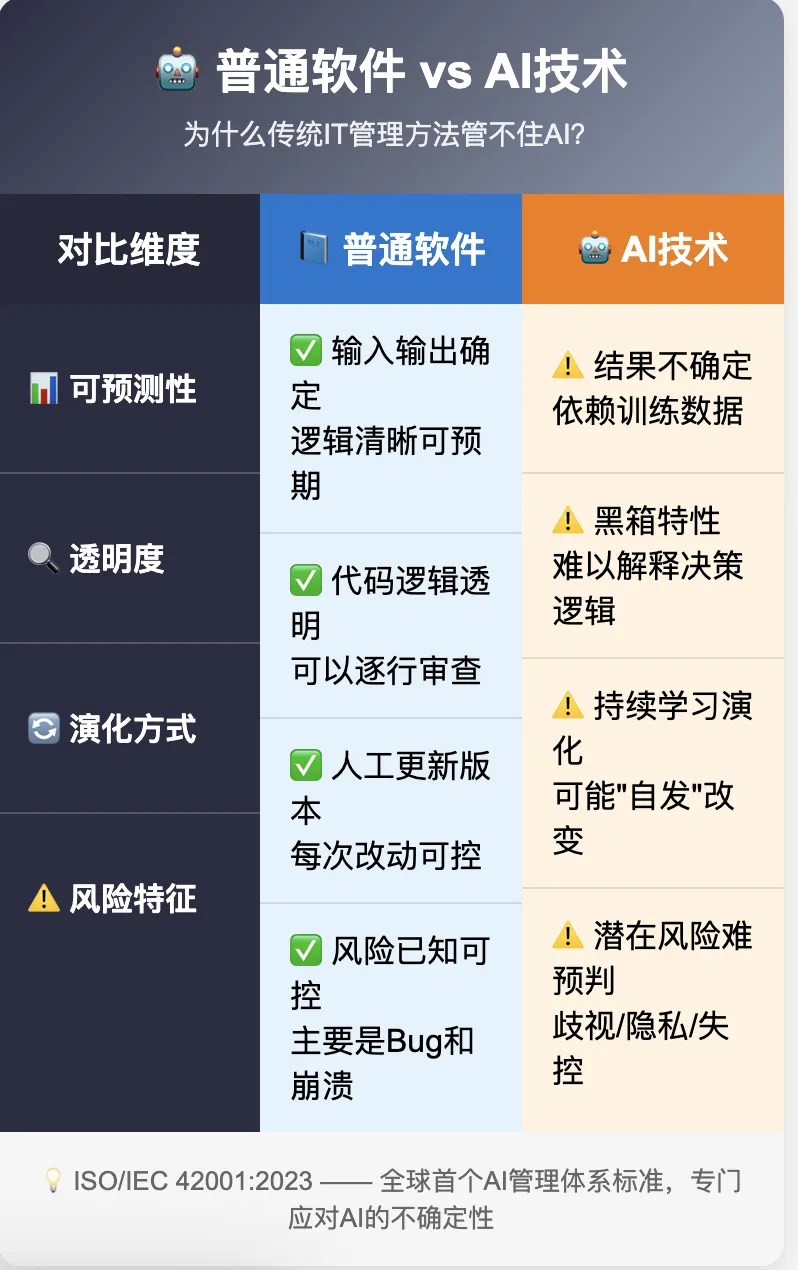

为什么是这个时间点?为什么突然需要一个专门针对AI的管理标准?答案藏在AI与传统软件的本质区别里。

核心问题:传统IT管理方法是为"确定性系统"设计的,但AI系统是"不确定性系统"——它会自主学习、会漂移、会被对抗攻击、会产生意料之外的结果。

现实驱动因素:

① 2021年欧盟发布AI法案草案,要求高风险AI系统必须符合特定标准

② 各国加速AI监管立法,企业急需一套国际通用的管理框架

③ AI伦理问题频发(算法歧视、隐私泄露、决策失控),公众信任度下降

在这种背景下,ISO 42001应运而生。它是全球首个AI管理体系标准,提供了一套系统化的方法论:识别AI风险 → 建立治理框架 → 确保可信AI。

背景清楚了,接下来的问题是:企业拿到这个标准,到底怎么落地?今天讲第二步——AI项目策划。

一、AI项目策划为什么重要?

核心观点:AI项目不是IT项目

很多企业的做法是:

1. 老板说"我们要用AI"

2. IT部门买了一套AI工具

3. 扔给工程师:"你们看着用"

4. 结果:AI变成"高级Excel",没产生价值,还埋下风险隐患

ISO 42001的要求(对应Clause 5-6:领导作用 + 策划):

· AI项目必须从治理层面策划(不是技术层面)

· 必须明确:这个项目要解决什么问题?谁来负责?风险是什么?

就像你家里装修,不能只跟工人说"帮我装一下"。你得先想清楚:装成什么样?预算多少?谁把关质量?AI项目策划也是一样。

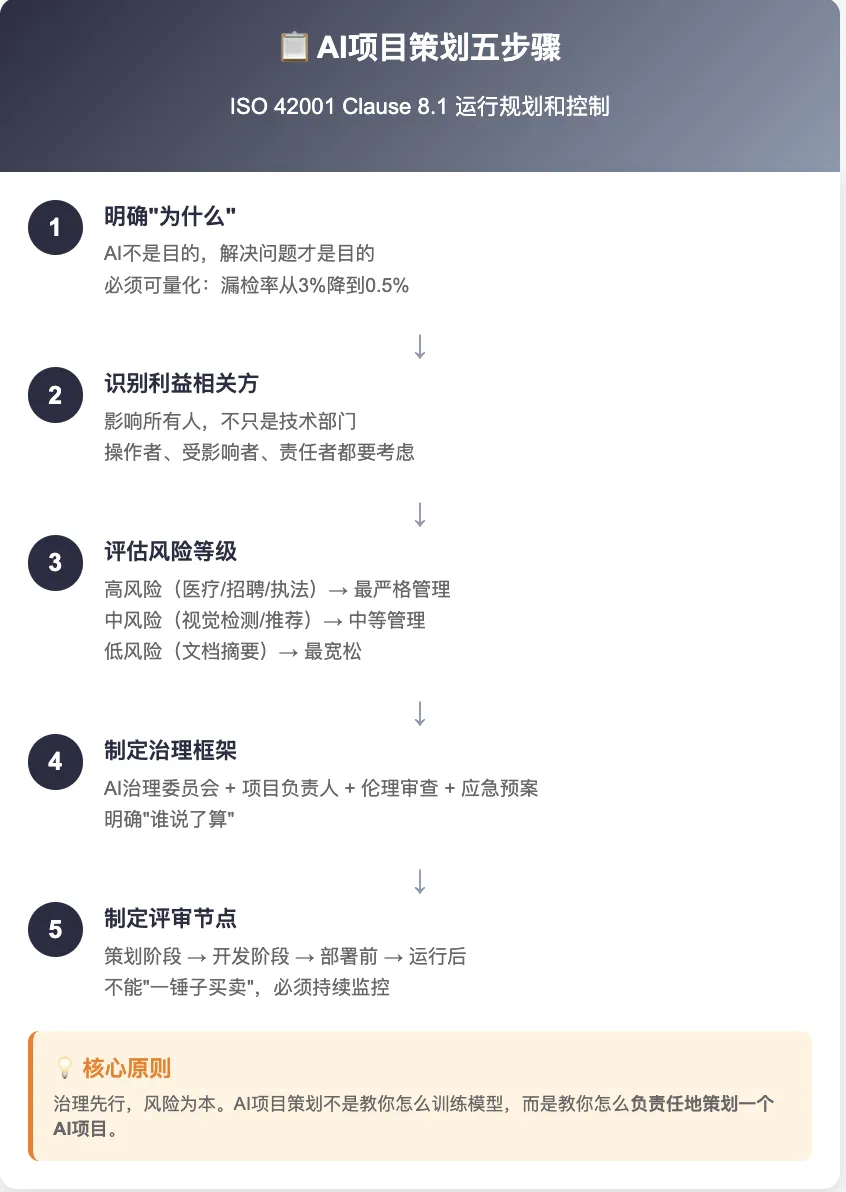

二、AI项目策划的五个步骤

对应 ISO 42001 Clause 8.1:运行规划和控制

1明确AI项目的"为什么"AI不是目的,解决问题才是目的。提问清单(策划时必须回答):① 这个项目要解决什么业务问题?② 用AI是唯一解决方案吗?③ 预期产出是什么?(降本?增效?创新?)✗ 错误:"我们要用AI,跟上潮流"✓ 正确:"我们要用AI视觉检测,把产品缺陷漏检率从3%降到0.5%"衡量标准:可量化 + 有时间节点 + 有责任人

2识别利益相关方AI项目影响的不仅仅是技术部门。· 操作者:谁会用这个AI系统?(如质检员)· 受影响者:谁会被AI的决策影响?(如客户、员工、监管方)· 责任者:谁来为AI的输出负责?(如AI治理负责人)就像小区装人脸识别门禁,影响的不仅是物业(安装方),还有每个住户(被识别方)、警察局(数据使用方)。策划时必须把所有人都考虑到。

3评估AI系统的类型和风险等级不同AI系统,风险等级不同,管理力度也不同。高风险— 涉及人身安全、基本权利示例:医疗诊断AI、招聘筛选AI、执法识别AI管理力度:必须人工复核 + 必须可解释 + 必须可追溯中风险— 影响商业决策,不涉及基本权利示例:推荐算法、预测性维护、视觉检测管理力度:定期监控 + 算法公平性评审低风险— 纯辅助性工具示例:文档摘要、翻译、语音转文字管理力度:基本不管,但要记录使用情况

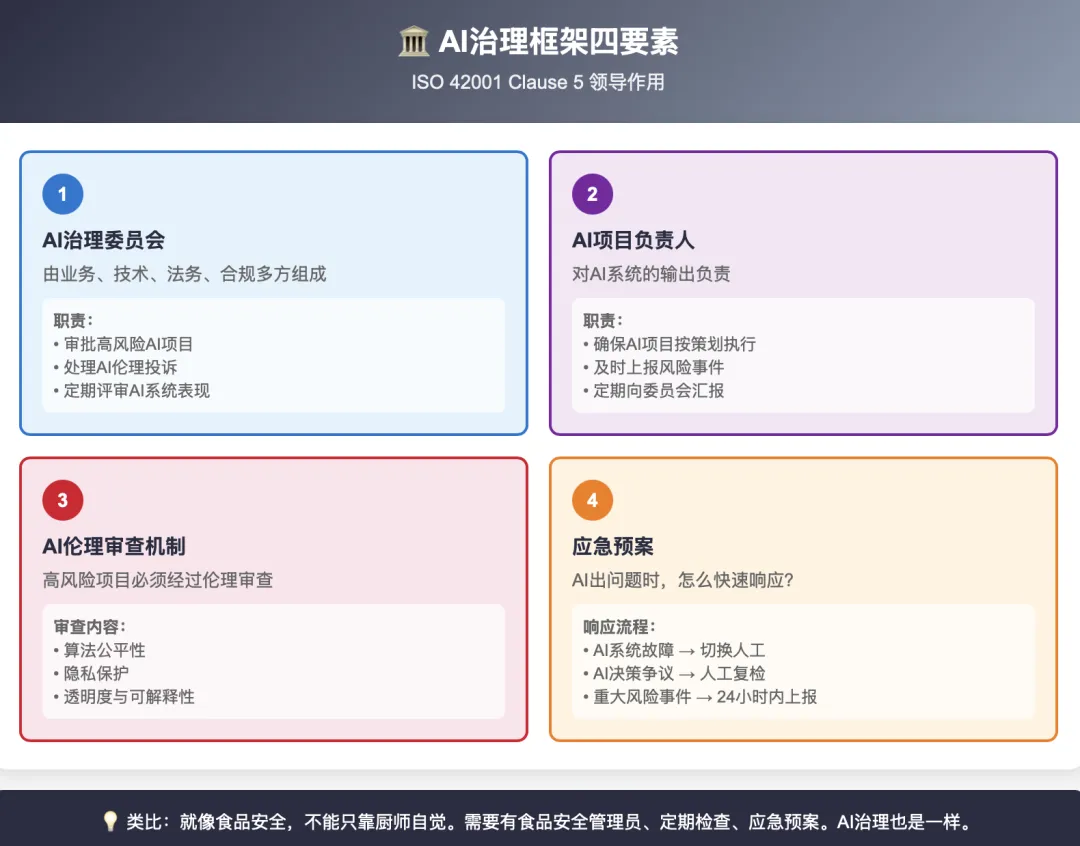

4制定AI治理框架明确"谁说了算"。① AI治理委员会由业务、技术、法务、合规多方组成;审批高风险AI项目、处理AI伦理投诉、定期评审AI系统表现② AI项目负责人对AI系统的输出负责;确保AI项目按策划执行、及时上报风险事件③ AI伦理审查机制高风险项目必须经过;审查算法公平性、隐私保护、透明度、可解释性④ 应急预案AI出问题时快速响应:系统故障 → 立即切换人工 → 24小时内上报治理委员会就像食品安全,不能只靠厨师自觉。需要有食品安全管理员、定期检查、应急预案。AI治理也是一样。

5制定项目里程碑和评审节点AI项目不能"一锤子买卖",必须持续监控。策划阶段:治理框架评审(确保治理到位)开发阶段:算法公平性评审(确保无歧视)部署前:影响分析评审(确保风险可控)运行后:定期绩效评审(至少每季度一次)

三、完整案例:工厂AI视觉检测项目策划

项目背景某汽车零部件工厂,要用AI替代人工目检步骤1:明确"为什么"· 业务问题:人工目检漏检率3%,客户投诉多· 为什么用AI:传统机器视觉对复杂缺陷(如微小裂纹)识别率低,AI更擅长· 预期产出:漏检率从3%降到0.5%,每月抽检1000件· 时间节点:6个月内完成部署· 责任人:质量总监步骤2:利益相关方· 操作方:质检部门 · 受影响方:客户、一线工人· 责任方:质量总监 · 监管方:客户审核员· 沟通计划:质检员每周培训 / 客户每季度汇报 / 工人每月座谈步骤3:风险等级· 等级:中风险(影响产品质量,不涉及人身安全)· AI漏检 → 双保险抽检(每100件抽5件)· 算法漂移 → 每周用最新标注数据重新校准· 置信度<90% → 自动转人工复核步骤4:治理框架· 治理委员会:主席=质量总监,成员=IT经理/生产经理/法务/安全员· 项目负责人:质检经理(直接向质量总监汇报)· 应急:AI故障→10分钟切人工→争议→人工复检→投诉→24小时调查步骤5:评审节点· 第1个月:治理框架评审 → 通过后才能进入开发· 第2-3个月:算法公平性评审 → 确保对不同类型缺陷识别率一致· 第4个月:影响分析评审 → 小规模试点(1条产线,运行1个月)· 第5个月起:每季度评审 → AI漏检率、误检率、客户投诉数

小结:AI项目策划的核心——治理先行,风险为本ISO 42001的第二步,不是教你怎么训练模型,而是教你怎么负责任地策划一个AI项目。1. 明确"为什么"——AI不是目的,解决问题才是2. 识别利益相关方——影响所有人,不只是技术部门3. 评估风险等级——高/中/低,管理力度不同4. 制定治理框架——明确谁负责、谁审查、出事怎么办5. 制定评审节点——不能一锤子买卖,必须持续监控

下期预告ISO 42001 落地第三步:AI风险评估与控制(系列④)项目策划好了,接下来最关键的环节:AI风险评估与控制。下期用真实案例告诉你,不评估风险会出多大的事——美国警方用AI人脸识别错抓大妈,到底哪里失控了?

ISO 42001 系列文章✓ ① ISO 42001来了:企业AI管理体系怎么建?(已发布)✓ ② ISO 42001 落地第一步:AI管理体系策划(已发布)▶ ③ 本文:AI项目策划(当前)○ ④ AI风险评估与控制(下期)○ ⑤ AI审核与持续改进○ ⑥ 企业AI管理体系全景图(收官篇)

声明:本文内容基于公开资料整理编写,如有疏漏,欢迎指正。具体标准条款请以 ISO/IEC 等官方正式发布文本为准。

夜雨聆风

夜雨聆风