AI 答得越专业,有时候越说明它没懂你的问题

你问 AI「为什么锅里的水烧开了还不关火会怎样」,它给你一份沸点与蒸发速率的热力学分析。答案没有错,但你要的只是「水会烧干」。这个细节,暴露了大模型一个被严重低估的认知盲区。

先说一个真实的现象。很多人在用大模型处理日常问题时,会遭遇一种奇特的「过度解释」:你问的是生活常识,它回的是教科书。你问「感冒了能不能洗澡」,它告诉你人体免疫系统的工作机制;你问「朋友突然不回消息是什么意思」,它开始讲社会心理学中的回避型依恋模式。答案听起来头头是道,但总有一种说不清的隔阂感——它没有在跟你说话,它在做报告。

它学会了「说得像专家」,但没学会「想得像人」

这背后有一个根本性的错位。大模型的训练数据里,解释性文本天然就是「技术性」的。互联网上关于「水为什么会沸腾」的内容,大多数是物理课笔记、百科词条、科普文章——这些文本的写作目的本来就是传递系统性知识。而一个妈妈在厨房里告诉孩子「水快烧干了赶紧关火」,这种口耳相传的常识,几乎不会出现在任何可以被爬取的文本里。

换句话说,模型见过的「解释」,大多数都是专业语境下的解释。它从来没有系统性地接触过人类用来传递常识的那种方式——那种方式往往是简短的、情境化的、甚至是不说理由只给结论的。「别这么做,会出事的」,这六个字背后可能积累了几代人的经验,但它对模型来说几乎是隐形的。

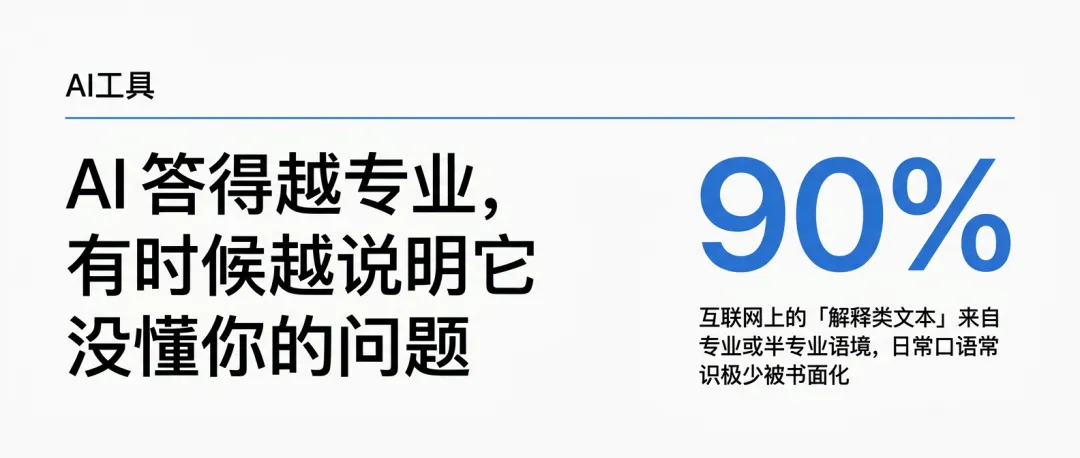

90%

互联网上的「解释类文本」来自专业或半专业语境,日常口语常识极少被书面化

因果推理有两种,模型只擅长一种

人类处理因果关系,其实走的是两条完全不同的路径。一条是「机制性因果」:A 导致 B,因为存在 C 这个中间机制,可以被验证、被量化、被写进论文。另一条是「经验性因果」:A 之后通常会有 B,我见过很多次了,不需要知道为什么,就是这样。前者是科学的语言,后者是常识的语言。

大模型在机制性因果上表现出色——它能把一个化学反应的步骤说得清清楚楚。但经验性因果对它来说是个陷阱。当你问一个需要经验性因果回答的问题,它会本能地把它转化成一个机制性因果问题来解答。不是因为它「想炫耀」,而是机制性解释在它的训练数据里占据了压倒性的优势,那是它学会的唯一一种「认真解释」的方式。

「

模型给出技术性答案,往往不是它在炫耀知识,而是它不知道还有另一种答案存在

」

更深的问题:它对「提问者是谁」几乎没有感知

人类在回答问题时,会自动校准。你的五岁侄子问你「为什么天是蓝的」,和你的物理学教授问你同一个问题,你给出的答案会完全不同。不是因为事实不同,而是因为你知道他们需要的是什么层次的解释。这种对「提问者意图和背景」的感知,是人类沟通中最基础的能力之一,我们几乎不会意识到自己在做这件事。

大模型在这一点上有结构性的短板。它能读懂你说了什么,但很难推断你的问题背后是什么情境、你是什么背景、你真正想要的是一个结论还是一个过程。于是它倾向于给出一个「安全的」答案——尽量完整、尽量准确、尽量覆盖所有可能的角度。这种策略在考试中是对的,在对话中却经常是错的。完整不等于有用,准确不等于贴切。

1提问者的背景和意图,模型几乎无法主动推断

2常识性问题往往需要「结论优先」,而非「机制优先」

3过度解释是一种隐性的沟通失败,但不会被算进错误率里

这不是 bug,但也不是无解

有意思的是,这个问题在很大程度上可以被「提问方式」本身缓解。当你在问题里加入情境信息——「我不是在学物理,我只是想知道…」「用最简单的话告诉我…」「假设我完全不懂这个领域…」——模型的回答质量会有明显的改变。它不是不会说人话,而是在没有明确信号的情况下,它默认你想要的是「专业版本」。

但这也反过来说明了一件事:我们现在和 AI 沟通的方式,本质上还是在迁就它,而不是它在真正理解我们。一个理想的对话系统,应该是它来主动感知你的意图,而不是你需要学会「怎么跟它说话才有用」。这个差距,才是当前大模型在日常交互中最核心的未解问题——不是知识量,不是推理速度,而是对「人在说话时真正想要什么」的感知力。

✦ 小结

大模型给出技术性答案,不是因为它在卖弄,而是它的训练数据里「专业解释」远多于「常识传递」,它学会了一种解释方式,却没见过另一种。真正的问题不在于它懂不懂,而在于它不太知道你需要哪种懂法。

夜雨聆风

夜雨聆风