引言:隐私法开始进入大模型开发流程

2026 年 5 月 6 日,加拿大联邦隐私专员办公室(Office of the Privacy Commissioner of Canada, OPC)联合魁北克信息访问委员会(Commission d’accès à l’information du Québec, CAI)、不列颠哥伦比亚信息与隐私专员办公室(OIPC-BC)和阿尔伯塔信息与隐私专员办公室(OIPC-AB),发布了针对 OpenAI OpCo, LLC 的联合调查报告,报告编号为 PIPEDA Findings #2026-002。报告适用的法律包括加拿大联邦《个人信息保护和电子文件法》(Personal Information Protection and Electronic Documents Act, PIPEDA)、魁北克私营部门个人信息保护法、不列颠哥伦比亚 PIPA 和阿尔伯塔 PIPA。

这份报告没有将审查停留在 ChatGPT 某一次输出是否错误,也没有限于隐私政策文本是否充分。监管机构沿着模型开发和部署链条,审查了训练数据来源、预训练数据处理、用户交互数据使用、模型输出准确性、个人访问和更正请求、数据保留期限以及企业内部问责机制。既有分析已经对本案的法律争议和合规启示作了较完整梳理,本文在此基础上进一步回到原文,将监管机构的事实认定、OpenAI 的抗辩、技术细节、裁决结果和企业实务影响分层展开。

这种审查路径本身已经具有标志意义。大模型服务面向公众提供之后,企业很难只依靠一份隐私政策说明其个人信息处理活动。监管机构开始要求企业说明,数据为什么被收集,哪些数据被用于训练,用户是否理解其数据会被用于模型改进,模型输出中关于个人的信息如何保持准确,个人权利请求如何在大模型技术架构下得到响应,以及历史训练数据能否长期保留。

本案审查对象需要先作边界限定。报告针对的是调查启动时支撑 ChatGPT 的 GPT-3.5 和 GPT-4,不包括后续模型,也不包括 OpenAI 的图像、视频生成等其他 AI 服务。报告也说明,调查范围没有延伸至 OpenAI 客户对 ChatGPT 的所有潜在应用,例如 API 客户、GPT 开发者或个人用户的具体使用行为。这一边界使本案主要聚焦于 OpenAI 自身在模型开发和部署过程中的个人信息处理,而非下游应用场景的全部责任分配。

一、案件背景:个别投诉引发联合监管调查

本案最初源于 2023 年 4 月 OPC 收到的一项投诉。投诉人主张 OpenAI 未经同意收集、使用和披露其个人信息。OPC 随后认为,生成式 AI 服务涉及的隐私影响已经超出个别投诉范围,于是在 2023 年 5 月关闭原个别投诉,并与 CAI、OIPC-BC 和 OIPC-AB 分别依据各自法律权限启动联合调查。四家监管机构采取联合调查,一方面可以整合各自的法律和技术资源,另一方面也可以避免对被调查企业造成重复程序负担。

调查对象为 OpenAI OpCo, LLC。报告说明,OpenAI OpCo 是向终端用户提供 OpenAI 产品的运营实体,总部位于美国旧金山。ChatGPT 于 2022 年 11 月发布,发布时由 GPT-3.5 驱动,2023 年 3 月引入 GPT-4。监管机构还注意到,OpenAI 在加拿大拥有数百万月活跃 ChatGPT 用户和数十万付费订阅用户,魁北克、不列颠哥伦比亚和阿尔伯塔也有显著用户基础。

报告还专门交代了 ChatGPT 的商业模式。OpenAI 一方面通过免费或付费订阅向个人及组织提供 ChatGPT、Team、Edu、Enterprise 等服务;另一方面通过 API 平台向开发者和企业客户提供模型能力,并按使用量收费。这一背景说明,监管机构审查的不是单纯研究活动,而是围绕 ChatGPT 商业化部署展开的个人信息处理活动。

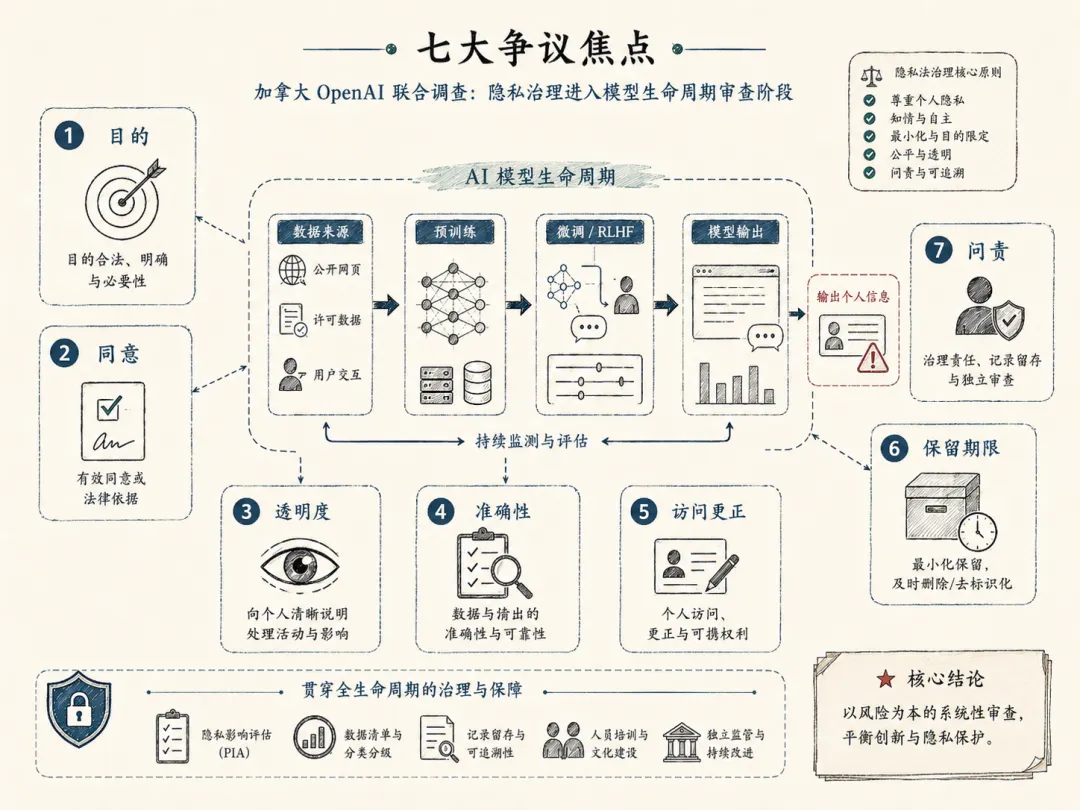

报告最终围绕七项问题展开:处理目的是否适当,是否取得有效同意,是否履行开放透明义务,是否确保关于个人的信息准确、完整并保持更新,是否提供访问和更正能力,是否建立适当保留和处置程序,以及是否履行问责义务。

这七项问题构成了本案的基本分析框架。监管机构关注的已经不只是隐私政策如何表述,而是模型开发目的、训练数据来源、用户界面设计、输出机制、权利响应流程和内部治理证据之间能否相互支撑。

二、管辖权:境外 AI 企业的加拿大连接因素

OpenAI 提出的一项重要抗辩,是其作为美国公司,在加拿大没有实体办公地或员工,并且 ChatGPT 在 2022 年 11 月 30 日之前尚未在加拿大正式发布。监管机构没有接受这一抗辩。

OPC 认为,在 PIPEDA 下,只要与加拿大存在“真实且实质性联系”(real and substantial connection),境外组织也可能受到该法约束。报告列举了多项连接因素:OpenAI 在加拿大提供服务并拥有大量用户和付费订阅用户;加拿大用户适用 OpenAI 服务条款;加拿大用户可以直接访问网站并使用 ChatGPT;互联网服务不以物理存在作为管辖前提;OpenAI 的运营涉及加拿大与美国之间的个人信息传输;OpenAI 为开发和部署 ChatGPT 收集、使用和披露了加拿大用户或来源于加拿大的数据。

监管机构也没有把管辖权起点机械限定在 ChatGPT 正式发布之后。对于 OpenAI 主张 2022 年 11 月 30 日之前没有足够加拿大连接的问题,监管机构认为,ChatGPT 发布前的开发已经部分依赖于加拿大个人信息或加拿大来源数据。这些开发活动与后续商业化部署存在连续关系。OpenAI 仍保留包含这些个人信息的数据集,并继续将其用于 AI 模型训练,也进一步强化了这种连接。

CAI 的论证更进一步。其认为,OpenAI 使用魁北克居民个人信息训练 GPT-3.5 和 GPT-4,本身构成与魁北克的真实且重要联系;由于隐私侵害可能发生在个人居住地,个人居住地也可以成为足够连接因素。OpenAI 持续持有并使用相关个人信息,则进一步支持魁北克法的适用。

OpenAI 还单独挑战了 OIPC-BC 的管辖权,认为如果 OPC 已经适用 PIPEDA,PIPA-BC 不应同时适用。报告没有接受这一解释,而是从 PIPEDA 与 PIPA-BC 的衔接结构、合作联邦主义以及既有联合调查实践出发,确认 OIPC-BC 可以参与本次调查。这个细节说明,本案不是单一联邦监管行动,而是加拿大多层级隐私监管协同运作的结果。

OpenAI 还主张,对于终端用户基于个人或家庭目的生成和使用的输出,相关隐私法不应适用。监管机构对此作了区分:个人或家庭用途例外即便存在,也只是针对个人的处理活动,而不能免除 OpenAI 作为商业组织在运营 ChatGPT 过程中收集、使用和披露个人信息的义务。

这一判断对跨境 AI 企业有直接影响。模型训练往往发生在产品正式发布之前,也可能发生在企业总部所在国以外的云环境、研发环境或数据处理链条中。只要训练数据中包含某一法域个人的信息,模型后续又面向该法域商业化提供服务,企业就很难仅以“训练发生在境外”或“发布前尚未进入市场”为由排除当地隐私法适用。

三、技术事实基础:大模型训练流程成为法律论证的事实底座

本案的一个重要特点,是监管机构没有把 ChatGPT 当作一个普通应用程序来审查,而是先对 GPT-3.5 和 GPT-4 的训练与输出机制作了技术事实铺垫。这个部分虽然看似技术背景,实际上是后续法律论证的事实基础。目的适当性、同意、透明度、准确性、个人权利和保留期限等问题,都建立在监管机构对模型训练流程和数据流向的理解之上。

需要注意的是,OpenAI 基于安全、保密和运营考虑,没有同意监管机构访问和检查其系统。因此,监管机构对技术流程的理解主要来自 OpenAI 的书面陈述、员工访谈、内部评估材料以及 OPC 技术实验室的用户侧测试。OpenAI 承认其在相关活动中收集、使用和披露个人信息,监管机构据此认定相关数据处理活动涉及各法下的个人信息。

(一)模型权重、Token 与统计关系

报告将大语言模型(Large Language Model, LLM)的运行基础概括为大量数值化“权重”(weights)。这些权重代表不同词语或词语片段在不同语境下的统计关系。文本会被转换为数值化的 token,模型通过处理训练数据形成这些统计关系,并在后续训练中不断更新。

这一技术事实对法律分析很关键。OpenAI 可以主张模型并非以传统数据库方式保存个人信息,训练数据也不是以原始文本形式逐条存储在模型权重中。但监管机构关注的是,个人信息是否在训练数据中被收集、使用和披露,是否可能通过模型输出被再现或生成,是否在模型系统中形成可影响个人权益的统计关联。个人信息保护义务不会因为数据进入 token 化和权重化过程而自动消失。

(二)预训练:公开网页与许可数据构成主要训练来源

报告说明,GPT-3.5 和 GPT-4 的训练过程大体分为两个阶段。第一阶段是预训练(pre-training,也称 self-supervised learning)。在这一阶段,模型通过分析大量非结构化、token 化文本数据,形成对自然语言的通用处理能力。预训练数据可能包含个人信息。报告还指出,预训练数据一般包括公开可访问网站信息和第三方许可数据。

在报告提供的训练流程说明中,预训练数据中超过 99% 来自公开可访问数据,规模达到 trillions of words;许可数据占比低于 1%。OpenAI 会移除有限类别的网站、重复内容和违反政策的内容,也会过滤 opt-out 内容。

报告还借 Common Crawl 说明公开网络数据的规模。Common Crawl 自 2008 年以来定期抓取网页,覆盖超过 2500 亿页面,每月新增 30–50 亿页面,数据规模达到 petabytes。监管机构用这一事实说明,所谓公开可访问来源并非低风险、小规模来源,而是可能承载大量长期累积、已经过时、由第三人发布或包含敏感内容的个人信息。

这部分事实直接支撑了后续“公开可访问不等于可以用于训练”的同意分析,也支撑了目的适当性中的必要性和比例性审查。公开网页、论坛、社交媒体、评论区等来源可能包含大量个人信息、敏感观点、儿童信息和与他人有关的主观意见。

(三)微调与 RLHF:用户交互数据进入模型改进流程

第二阶段是微调或对齐(fine-tuning / alignment)。报告说明,这一阶段用于提升模型在具体任务和场景中的表现,包括翻译、摘要、对话等,同时也用于降低模型输出有害内容的风险,例如仇恨言论或私人个人信息。微调数据包括用户与 ChatGPT 交互产生的一部分数据,以及人类训练员提供的信息。

报告进一步说明,微调包括监督学习和基于人类反馈的强化学习(Reinforcement Learning from Human Feedback, RLHF)。在人类反馈强化学习中,人类训练员会审阅同一提示下模型生成的多个回答,并按照相关性、安全性、准确性、偏见控制等标准进行排序。模型根据这些反馈更新词语之间的统计权重。

这一技术事实直接影响用户交互数据的法律评价。用户输入提示、模型输出、用户反馈、上传的图片和文件,都可能被用于模型改进。监管机构据此区分了“为提供服务而处理用户输入”和“为训练或改进模型而进一步使用用户交互数据”。前者可能属于服务提供所必需,后者则需要更清晰的告知和选择机制。

(四)文本生成:概率输出与准确性风险

报告还对 ChatGPT 如何生成文本作了高层级说明。用户输入 prompt 后,模型会将文本拆分为 token,再通过 LLM 生成第一个输出 token,之后结合输入 token 和已经生成的输出 token,连续生成后续 token,最终转换为人类可读文本。

这个过程解释了为什么 ChatGPT 可以生成流畅、看似可信的回答,也解释了为什么它可能生成不准确内容。大模型并非在回答时逐项核验事实,而是在统计关系基础上生成概率上合理的文本。报告后续关于准确性的分析,正是建立在这一技术事实之上。对于普通问题,这可能表现为产品体验风险;对于涉及自然人的犯罪、职业经历、声誉、健康、财务、教育等信息,则可能成为个人信息准确性义务问题。

(五)四类数据来源:个人信息处理活动贯穿模型生命周期

报告概括了 OpenAI 为开发或训练模型、支持用户与 ChatGPT 交互而收集数据的四个主要来源:公开互联网来源,包括第三方已经抓取并公开的数据,也包括 OpenAI 通过 GPTBot 抓取的网页内容;第三方许可数据,包括媒体、图片库和专业知识来源;用户与 ChatGPT 的交互数据,包括输入、输出、上传内容和反馈;以及人类 AI 训练员生成的对话和评价数据。每一类数据来源都可能包含个人信息。

OpenAI 还区分了不同数据来源的处理目的。用户交互数据被用于提供、管理、维护和分析服务,也可能在用户未退出的情况下用于改进服务、开发新服务和研究;在商业转让场景下,用户交互数据还可能被用于展示产品性能、效用和使用模式。公开互联网来源、第三方许可数据以及人类训练员生成的对话,则主要被用于训练 AI 模型,包括提供或改进产品服务、开发新程序和服务。监管机构虽然列明了这些具体目的,但最终将其合并评价为 OpenAI 对 ChatGPT 的开发、实施、持续推进和运营。

这一事实安排非常重要。生成式 AI 的个人信息处理并非只发生在用户对话环节,也不是只发生在输出环节。个人信息可能在公开网页抓取、第三方数据许可、预训练、微调、用户交互、人工评估、模型输出、权利响应和数据保留等多个节点出现。监管机构后续七个争议焦点,本质上就是围绕这些节点逐一展开。

四、争议焦点:七项隐私法问题的逐项展开

(一)目的适当性:训练数据规模与必要性的审查

在目的适当性问题上,报告的论证需要细读。监管机构接受 OpenAI 开发和部署 ChatGPT 的商业目的具有一定正当性,也承认生成式 AI 可能在教育、研究、创造力和生产力提升等方面带来积极价值。报告同时指出,LLM 在缺乏充分保护的情况下发布,也可能带来错误信息传播、隐私和声誉损害、对青少年和其他脆弱群体造成伤害、被恶意行为人用于网络安全攻击等风险。

问题集中在 OpenAI 最初从互联网来源和第三方许可数据集中收集个人信息用于训练 GPT-3.5 和 GPT-4 的方式。监管机构认为,OpenAI 所收集和使用的个人信息规模、来源和性质过宽,超出了相关法律所允许的范围。报告特别指出,GPT-3.5 和 GPT-4 开发阶段的隐私保护措施有限,尤其是在数据收集和预训练阶段,训练数据集中必然包含大量不同敏感程度的个人信息,包括医疗信息、个人对敏感或争议话题的观点、关于他人的意见以及儿童信息。

原文对“过宽收集”的认定并非抽象判断,而是建立在具体过滤措施之上。OpenAI 说明,其在 GPT-3 训练文本收集时采取过避免盗版内容、删除重复内容和有害内容的措施,包括 CSAM、仇恨言论、色情内容和垃圾内容;在 GPT-4 之后,又进一步识别并移除部分以索引或集合个人信息为目的的网站。OpenAI 还强调,其不绕过付费墙或账号保护网站,也不从暗网收集信息。但监管机构注意到,OpenAI 排除的网站类别非常有限,并未筛除社交媒体网站、面向儿童的网站,或可能包含弱势群体敏感信息的网站;由于只排除有限类别,讨论论坛内容也很可能进入训练数据集。

监管机构尤其关注社交媒体和讨论论坛。原因不只是这些来源包含大量个人信息,还在于其中相当一部分信息可能是主观、偏见性、未经事实验证的意见,甚至是第三人对他人的评价。将这些内容纳入训练数据,会同时放大两类风险:一是个人对自身信息失去控制,二是模型在后续输出中生成或强化不准确的个人信息。

本案不能被简单理解为加拿大监管机构否定大模型训练本身。报告关注的是,企业是否能够说明特定来源、特定类别、特定敏感程度的个人信息对训练目的具有必要性,是否存在侵入性更低的替代方案,是否已经在预训练和微调阶段实施了数据最小化和过滤措施。

从实务角度看,训练数据治理必须前移。企业引入公开网页、论坛、社交媒体、产品评论、用户评论、新闻文本或第三方许可数据时,应当建立数据源准入机制。全部抓取之后再依赖输出端安全措施兜底,这种治理逻辑很难满足监管机构对必要性和比例性的要求。

(二)同意:公开可访问信息的训练用途限制

同意问题是本案最复杂的部分。监管机构认为,OpenAI 未能就为开发和部署 GPT-3.5 与 GPT-4 而收集、使用和披露个人信息取得有效同意。报告将同意问题进一步拆分为公开网页和第三方许可数据、用户交互数据,以及通过 ChatGPT 输出披露个人信息三个层次。

1. 公开网页和第三方许可数据

对于公开可访问网站和第三方许可数据,OpenAI 主张可以依赖默示同意,并提出了多项理由,包括训练 AI 模型具有重大公共利益,模型需要大量文本才能学习语言,无法直接通知非结构化原始数据中的个人,OpenAI 已经通过隐私政策和服务条款作出公开通知,并采取了去标识化和其他风险缓释措施。

监管机构没有接受这一逻辑。报告中的关键点在于,publicly accessible 并不等同于 legally publicly available。个人在社交媒体、论坛、评论区或其他互联网空间发布信息,不能当然推定其同意这些信息被用于训练商业化生成式 AI 模型。尤其在信息具有敏感性、处理方式超出个人合理预期,或者仍然存在重大剩余风险时,监管机构倾向于要求企业取得明示同意。

在合理期待分析中,监管机构特别区分了搜索引擎和生成式 AI。即使个人对搜索引擎索引公开网页已经形成一定预期,也不能直接推导出其会预期同一信息被用于训练一个能够生成新内容、并可能生成看似可信但不准确个人信息的大模型。报告还指出,部分信息是在数年甚至数十年前发布,当时相关个人不可能预期这些内容会被用于训练尚未发布的技术。

魁北克 CAI 对例外规则的分析更能说明这一点。OpenAI 试图援引魁北克法中关于新闻、历史或谱系材料的例外,主张 GPAI 模型训练活动具有表达性,有助于知识获取和公众信息获取。CAI 承认,在具体场景中,某些与新闻出版方合作获得的数据集可能落入该例外,但拒绝将大模型训练活动整体纳入例外范围。CAI 认为,ChatGPT 基于大规模数据的统计分析回答个体问题,既不是为了围绕社区关注事项进行信息生产,也缺乏新闻活动中的编辑判断和为了准确、公平呈现事实、意见和争论而形成的方法纪律。模型输出还具有概率性和随机性,OpenAI 对结果没有完全控制,因此不能把 GPT-3.5 和 GPT-4 的输出整体视为新闻材料。

2. 用户交互数据

对用户交互数据,监管机构强调选择机制和告知充分性。报告认为,许多用户在 ChatGPT 发布时可能并不了解其个人信息会被用于训练模型,也不了解对话可能由人类训练员审阅。一次性的账户创建通知或首次使用通知,不足以确保用户理解相关处理的性质、目的和后果。

监管机构没有停留在“是否有隐私政策”层面,而是直接测试了界面提示。OpenAI 在 onboarding 阶段向用户显示的提示为:“Don’t share sensitive info. Chats may be reviewed and used to train our models – Learn more.” OPC 测试发现,该提示在账户用户首次创建账户时只出现一次;对 2024 年 4 月开放的免登录免费网页版,该提示甚至是在用户已经输入第一个 prompt 并收到第一个回复之后才出现。监管机构据此认为,这种一次性、位置和时机都有限的提示,不足以确保用户理解聊天内容可能被用于模型训练。

OpenAI 当时还采取了若干缓释措施,例如只使用部分用户交互数据进行微调、将交互与用户账户脱钩、使用第三方过滤工具去除部分个人标识符,并要求员工和承包商排除可能构成个人信息的内容。但监管机构认为,第三方过滤工具覆盖范围有限,无法去除各法下广义个人信息,例如个人意见、个人特征,或这些内容中可能透露的种族、性取向、健康状况等敏感信息。

同意有效性还受到界面设计影响。报告指出,直到 2024 年 4 月,用户如果希望在账户设置中退出聊天数据用于训练,也必须同时放弃聊天历史。监管机构将其称为欺骗性设计模式中的“forced action”:用户为了保留聊天历史,被不必要地迫使接受 OpenAI 将其信息用于模型训练。OpenAI 后来调整了设置,使用户可以在不关闭聊天历史的情况下退出训练用途,并引入不用于模型训练的 temporary chats。

这里需要区分两类处理活动:一类是为了提供服务而处理用户输入,另一类是为了改进模型而二次使用用户交互数据。前者可能具有服务必要性,后者更需要清晰、显著、可选择的同意机制。企业不能把“使用服务”与“同意训练”合并成一个模糊动作,也不能把用户没有主动关闭训练开关直接解释为有效同意。

3. 通过 ChatGPT 输出披露个人信息

同意问题还包括通过 ChatGPT 输出披露个人信息。OpenAI 主张,其训练模型拒绝返回有关个人的私人或敏感信息,即便这些信息可以通过互联网或搜索引擎获取;OpenAI 还称,内部评估显示 GPT-3.5 和 GPT-4 分别达到 98% 和 100% 的阻断有效性。但监管机构指出,该说法没有得到充分佐证,而且 OpenAI 所关注的“私人或敏感信息”范围明显窄于各法下的个人信息范围。例如,OpenAI 并没有指标判断模型是否会披露关于某人的意见、传闻或其他可能构成个人信息的内容。

这一点很关键。个人信息保护法下的个人信息,不限于姓名、电话号码、住址等直接标识符,也可能包括关于个人的意见、评价、推断、传闻和与身份相关的事实描述。模型输出如果披露这些内容,即使没有披露传统意义上的敏感身份信息,也可能构成个人信息披露。

(三)开放性与透明度:训练数据说明需要达到可理解程度

在开放性与透明度问题上,监管机构采取了相对务实的立场。报告没有要求生成式 AI 开发者披露每一个训练数据源,也没有要求公开完整语料清单。监管机构承认,这在实践中可能并不现实,也未必是法律要求。

问题在于,OpenAI 对其收集的个人信息类别和训练数据来源所作的描述过于高层级,未达到相关法律要求。监管机构认为,为使个人理解企业的个人信息管理实践,OpenAI 应以普通用户可理解的形式,发布关于预训练和微调模型所用主要内容类别的全面且足够具体的概述。

报告对透明度的批评并不等同于要求 OpenAI 公开完整训练语料。监管机构首先承认,OpenAI 的隐私政策和 Help Center 文章总体上容易访问、语言也相对平实;但同时指出,重要材料最初并未向加拿大个人提供法语版本,OpenAI 直到 2024 年 5 月才提供隐私政策的法语版本。

更实质的问题在于,OpenAI 对训练数据来源的说明过于笼统。Help Center 文章只是概括说明 ChatGPT 使用公开互联网信息、第三方许可信息、用户或人类训练员提供的信息进行开发。普通用户阅读这些说明,未必会理解自己或他人多年以前在博客、论坛、社交媒体上发布的信息,也可能被视为公开可访问内容并用于训练模型。

技术文件也没有弥补这一不足。OpenAI 在 GPT-4 Technical Report 中明确表示,基于竞争环境和大型模型安全影响,不提供关于架构、模型规模、硬件、训练算力、数据集构建、训练方法等进一步细节。监管机构还注意到,Sam Altman 曾公开称 ChatGPT 本质上是“black box”,暗示即使创建者也未必知道 LLM 作出特定行为的精确原因和底层机制。OpenAI 虽然在部分研究文件中侧面讨论过可解释性不足,但没有充分向使用该工具的组织和个人明确说明这一点。

透明度义务并不等于要求企业公开全部商业秘密或完整训练语料。企业至少应当让用户理解以下事项:训练数据大致来自哪些类别,是否包含公开网页、社交媒体、论坛、用户交互和第三方许可数据;是否可能包含个人信息和敏感个人信息;用户输入是否会被人类审阅或用于训练;模型输出为什么可能不准确;个人如何行使访问、更正、删除或拒绝训练使用的权利。

(四)准确性:关于个人的信息输出进入隐私法审查范围

本案最有制度意义的部分,是监管机构将生成式 AI 的幻觉问题纳入个人信息准确性义务分析。报告指出,相关法律要求个人信息在其使用目的所需范围内保持准确、完整和最新。监管机构认为,OpenAI 未能满足这些准确性要求。

准确性问题并非只来自外部批评。OpenAI 自身 GPT-4 Technical Report 记载,其在 learning、technology、writing、history、math、science、recommendation、code、business 九类内部评估中,GPT-4 平均准确率约为 70%—80%;GPT-3.5 平均比 GPT-4 低 19 个百分点。监管机构据此指出,按照 OpenAI 自己的测试,根据版本和测试主题不同,ChatGPT 有 20%—50% 的回答被认为事实不准确。

更关键的是,监管机构要求 OpenAI 提供关于模型输出个人信息准确性的内部报告或统计分析,例如用户询问某个个人时,模型输出是否准确。OpenAI 没有提供这类一般性评估,而是提到一项第三方研究称 ChatGPT 在摘要任务中的幻觉率为 3%。监管机构认为,该研究只涉及对给定文件进行摘要这一特定任务,不能说明 ChatGPT 在回应个人相关问题时输出个人信息的准确性。

OPC 的用户侧测试还关注了准确性提示的呈现方式。OpenAI 主张界面底部长期显示 “Chat GPT can make mistakes. Check important info.” 但监管机构认为,该提示以小号灰色字体显示在输入框下方,并不显著,也没有紧邻具体回答。模型有时会在回答中加入 “as of my last update in...” 或建议查阅新闻来源的提示,但这类提示并非默认出现,有时也只在初始回答出现。监管机构还指出,ChatGPT 常以权威语气呈现答案,准确内容和幻觉可能混杂在同一回答中,容易使用户过度信赖。OPC 测试中,模型曾错误表示某学者参与了特定研究项目;当测试人员要求确认时,模型仍然自信地维持该错误说法。

Browser Search 在报告中也不是单向正面措施。监管机构承认,当 GPT-4 在部分场景下使用 Browser Search 并提供有限来源链接时,用户更容易核验个人信息准确性。但测试也发现,同样问题下,GPT-4 使用 Browser Search 披露的个人信息比 GPT-3.5 更多。OpenAI 说明该功能会在模型判断需要更新或补充信息时自动触发,但没有提供模型如何选择互联网来源的细节。监管机构因此将来源引用视为积极发展,但前提是以保护隐私的方式实施。

这里需要避免把结论推得过满。并非所有幻觉都直接构成隐私侵权。更准确的理解是,当模型输出构成关于可识别个人的个人信息,并且该信息不准确、不完整或未保持更新时,生成式 AI 服务提供者可能违反个人信息准确性义务。

这一点对很多企业都有现实影响。凡是 AI 产品能够输出关于自然人的判断、简历、背景、信誉、职业评价、违法违规信息、健康状态、金融风险、教育经历或其他身份相关内容,企业都需要关注个人信息准确性问题。尤其在招聘、信贷、教育、医疗、保险、内容审核、客户风控和公共舆情等场景,关于个人的不准确输出可能同时触发隐私、反歧视、消费者保护、名誉权和劳动法风险。

(五)访问、更正与删除:大模型技术困难下的替代履行路径

访问权部分的事实非常具体。OpenAI 说明,登录用户可以通过 ChatGPT 界面的 Settings > Data Controls 使用 “Export Data” 工具。用户确认导出请求后,会收到一封包含下载链接的邮件,链接 24 小时内有效。用户随后下载一个 .zip file,其中包含其与 ChatGPT 的交互历史,以及 OpenAI 持有的其他数据,例如 OpenAI 生成的用户标识符、电子邮件地址、对话标题和创建时间等元数据。

监管机构认可,一个设计良好的自助工具可以作为用户访问个人信息的初始机制,但认为 ChatGPT 的 Export Data 工具没有充分满足访问权要求。首先,部分数据摘录格式不友好、难以导航,文件标题具有技术性且容易造成混淆,例如 model_comparisons.json;.json 文件需要一定技术能力才能下载、打开和阅读,普通公众难以使用。其次,监管机构表示,由于无法理解其中部分信息,也无法确认 Export Data 是否提供了 OpenAI 持有的全部用户个人信息。该工具也没有说明用户信息是否曾向第三方披露,或者是否有部分个人信息因例外规则被 withheld。再次,虽然用户理论上可以请求超出 Export Data 范围的访问,但路径并不容易发现。用户只有在对 Export Data 结果不满意后,再通过 Privacy Portal 或电子邮件联系 OpenAI,才会被转交 Support 团队进行个案审查。Export Data 邮件虽然提到可联系 Help Center,却没有清楚告知用户如何挑战所提供信息的完整性、准确性或性质。

对训练数据中的个人信息访问请求,OpenAI 的回应更有限。OpenAI 表示,只有当信息能够被验证为直接且唯一关联请求人时,才会提供访问,典型标识符是电子邮件地址或电话号码。对于普通姓名等无法可靠归属的信息,OpenAI 通常只能告知请求人的姓名是否出现在训练数据集中。OpenAI 解释说,训练数据是非结构化的,没有可以按个人检索的索引;确认特定信息是否存在需要为其数据架构手工适配定制工程流程,也会产生显著工作量和计算成本。同时,检索还受到第三人隐私保护限制,因为同一姓名或标识符附近的文本可能属于其他人。监管机构接受这些技术困难存在,但认为在 OpenAI 曾大规模、且缺乏充分缓释措施地收集个人信息的背景下,这些困难不足以完全免除访问义务。

在更正权问题上,监管机构接受 OpenAI 面临的技术困难。ChatGPT 的回答不是从一个可直接修改的事实数据库中抽取,而是来自词语或词片段之间大量统计相关性;这些相关性在特定条件下可能生成不准确个人信息。因此,在部分场景中,阻止特定个人信息出现在输出中,可能是更正之外唯一可行的替代措施。

在删除或撤回同意问题上,OpenAI 进一步解释,当前无法通过 reverse-training 方式让 LLM 因删除某条信息而回退。模型训练通过连续训练数据运行不断调整数十亿权重,每一步都依赖前序步骤;单个数据点对模型参数的影响并不会被单独保存,而是扩散并叠加在后续权重变化中。即使理论上能够识别某个数据点对某个参数的影响,模型也没有索引或记录说明哪些数据点影响了哪些参数。监管机构接受这一技术难点,但仍然要求 OpenAI 通过阻止输出、未来训练排除等方式提供替代路径。

报告还披露了 OpenAI 对公众人物请求的处理逻辑。OpenAI 可能拒绝从输出中移除其认定为公众人物的信息,判断标准通常是该个人是否具有显著网络存在,通常表现为是否有 Wikipedia 页面。对于构成公众人物 persona 的信息,例如本人曾公开表达过的信息,OpenAI 倾向于支持公众获取。但监管机构明确表示,没有获得足够证据评价这一流程的有效性或适当性。

这一部分体现了监管机构对大模型技术特征的现实态度。严格意义上的删除或更正,可能很难直接等同于从数据库中删除一行记录。监管机构接受某些替代路径,例如输出过滤、拒答机制、blocklist、训练数据隔离、未来训练排除、用户请求处理流程和人工复核机制。企业不能简单回答用户“模型无法删除,所以无法处理”。

(六)保留期限:训练数据也需要进入保留期限表

保留期限是本案中很实务的一部分。监管机构认为,OpenAI 没有为其开发和部署 GPT-3.5 与 GPT-4 所收集、使用和披露的个人信息建立适当保留和处置政策。

报告区分了不同类型数据。OpenAI 表示,如果用户删除账户或关闭聊天历史,其会在 30 日内删除与账户绑定的信息或对话,但存在反欺诈、法律等有限例外。对于用于训练的用户对话,OpenAI 会过滤个人标识符、与账户脱钩,并最长保存三年。但对于从公开网页收集的非结构化原始数据,OpenAI 没有明确的保留期限表,而是表示会在训练后续模型迭代所需期间保存。

这里容易产生误读。报告没有要求所有用户对话数据一律 30 日删除。30 日删除主要对应账户删除或关闭聊天历史等特定场景。真正的问题在于,不同类别的数据是否有明确、可执行、可审计的保留期限和处置机制,尤其是公开网页原始数据和历史训练数据能否长期以科研、审计或复现为由继续保存。

监管机构特别关注公开网页非结构化原始数据。OpenAI 表示,这些 raw data 会在训练后续模型迭代所需期间保存,理由包括可复现性、审计和过滤技术改进。但监管机构指出,长期保存个人信息会增加数据泄露风险,尤其当信息本身敏感、不准确或已经过时时。由于数据是在多年中抓取的,原始数据还可能包含已经从互联网删除或更新的网页;其中甚至可能包含盗版、有害内容、成人网站内容或个人信息聚合网站内容,这些内容只是后续在构建训练数据集时才被过滤。

OpenAI 后来说明,其已经制定正式的 Personal Data Retention and Deletion Policy,并采用 Customer Data Retention Schedule。对于非结构化训练数据,OpenAI 表示,一旦根据可复现性、审计和过滤改进等标准确认不再需要用于主动训练或复现研究,数据集即被 deprecated;弃用后不再用于 ongoing model development,仅作为 scientific integrity 所需的 historical benchmark 保留,底层 raw data 被置于安全、访问受控的 locked-down archive,仅少数员工可以访问。OPC 接受这一安排的前提是:数据仅用于这些目的,不再用于模型开发;一旦不再需要即从模型开发中隔离;数据主体权利继续适用;并定期复评保留必要性。

对企业来说,训练数据保留规则需要比一般业务数据更细。至少应区分原始抓取数据、过滤后训练数据、微调数据、评估数据、用户交互数据、日志数据、被弃用模型的数据集、为审计或复现保留的历史基准数据。

(七)问责制:发布前治理证据的重要性上升

在问责制问题上,监管机构认为 OpenAI 在 GPT-3.5 和 GPT-4 的开发和部署中违反了相关法律的问责要求。报告指出,这种问责不足使个人面临个人信息泄露、信息不准确、基于准确信息或不准确信息产生歧视,以及其他可预见个人和社会伤害的风险。

问责制部分的关键事实,是报告引用了媒体报道中 OpenAI 一位共同创始人的表述。该表述承认,公司发布 ChatGPT 时最大的担忧之一是 factuality,因为模型“喜欢编造事实”;但由于市场上已经有其他大语言模型,只要 ChatGPT 在真实性和安全方面比其他模型更好,就可以发布。OpenAI 没有争议该表述存在,但认为不应据此作出问责制认定。监管机构则认为,这类表述具有相关性,因为它显示 OpenAI 在明知模型准确性和不当输出风险的情况下发布 ChatGPT,却没有先建立足以满足隐私法要求并缓释已知风险的治理流程。

OPC 同时也注意到,OpenAI 在调查开始后采取了一系列强化数据治理和隐私框架的措施,包括开发内部过滤工具以检测和掩码训练数据中的个人信息,改进个人权利请求处理流程,利用 web search 等功能改善模型输出准确性,开发关于个人信息输出的准确性评估,以及实施正式保留政策和期限表。

这一处理方式表明,监管机构承认技术改进和后续治理措施的价值,也允许通过承诺和持续监督解决问题。对企业而言,更关键的是发布前治理证据。AI 产品已经面向公众发布后,再补充训练数据、敏感信息、准确性、同意、权利响应和保留机制评估,仍然可以降低后续风险,但很难完全消除历史处理活动中的合规瑕疵。

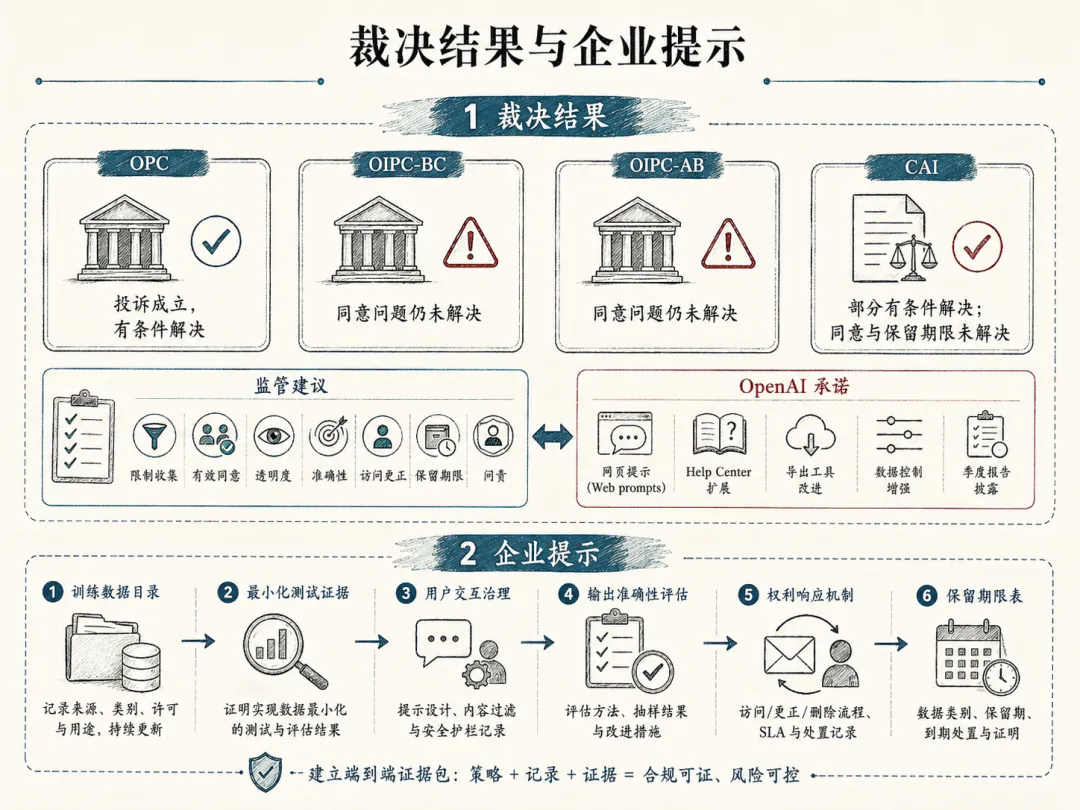

五、裁决结果:投诉成立、部分有条件解决,部分省级结论仍未解决

本案的裁决结果需要分层理解。报告并不是简单认定 OpenAI “全部违法且未解决”,也不能只概括为 OPC 认为案件已经“有条件解决”。四家监管机构虽然共同发布报告,但由于适用法律不同、法定要求不同,对部分问题的结论并不完全一致。

(一)OPC:投诉成立,但基于 OpenAI 承诺作出有条件解决结论

在 PIPEDA 下,OPC 最终认定投诉 well-founded and conditionally resolved,即投诉成立,但基于 OpenAI 后续采取和承诺采取的措施,作出有条件解决结论。OPC 将继续与 OpenAI 合作,监督其落实 agreed recommendations。

这一结论需要准确理解。OPC 并没有否定前述违法风险,也没有认为 OpenAI 原有做法已经充分合规。其判断逻辑是:OpenAI 在调查过程中已经采取若干措施,并接受进一步隐私增强措施;这些措施在 OPC 看来,足以回应其 recommendations 的主要意图。因此,OPC 没有将本案处理为完全未解决,而是作出“成立但有条件解决”的结论。

(二)OIPC-BC 与 OIPC-AB:同意问题仍未解决

OIPC-BC 和 OIPC-AB 的立场更严格。报告指出,BC 和 Alberta 的 PIPA 在同意问题上比 PIPEDA 更具体、更明确,因此两个省级监管机构没有 OPC 那样的解释空间。

它们认为,OpenAI 使用抓取数据训练 GPT-3.5 和 GPT-4,但没有、也无法根据 PIPA-BC 和 PIPA-AB 就相关个人信息处理取得有效同意。即使 OpenAI 后续采取了新的缓释措施,也参与共同 recommendations 和后续监督,这些措施仍不足以满足省级法律下同意这一基础性要求。

因此,对 OIPC-BC 和 OIPC-AB 来说,本案的关键并不是 OpenAI 后续是否改进了过滤、透明度或用户权利响应机制,而是其原始训练数据处理路径本身无法满足省级法律下的同意要求。这也是本案对跨境 AI 企业最有压力的部分。

(三)CAI:部分问题有条件解决,同意和保留期限仍未解决

CAI 的结论又有所不同。CAI 认为,关于适当目的、个人权利和问责的问题成立且有条件解决;关于同意和保留期限的问题成立且未解决。同时,由于魁北克法律结构不同,CAI 没有就开放性和准确性问题作出与其他机构相同的违法结论。

在同意问题上,CAI 特别关注网页可访问信息被抓取用于训练时,个人是否在初始收集时已经清楚知道其信息会被公开,并可能被第三方收集、使用和披露用于人工智能模型训练。对于 14 岁以下未成年人的个人信息,还涉及父母或监护人同意问题。

在保留期限问题上,CAI 认为 OpenAI 关于公开网页原始数据和历史训练数据的保留安排仍不足以解决魁北克法下的问题,因此将该部分认定为成立且未解决。

CAI 没有在准确性问题上作出违法认定,也需要放在魁北克法的具体结构下理解。CAI 指出,魁北克法第 11 条关于信息准确和更新的义务,适用于信息被用于对有关个人作出决定的场景;案卷证据不足以支持 ChatGPT 已经使用不准确个人信息对个人作出决定。因此,CAI 没有在准确性问题上作出违法认定,但鼓励 OpenAI 落实报告中的准确性建议。

(四)监管建议:监管机构要求 OpenAI 补强的整改方向

报告中的 recommendations,是监管机构在初步调查报告中向 OpenAI 提出的整改建议。它们代表监管机构认为 OpenAI 应当补强的方向,并不等同于 OpenAI 已经全部接受或已经完成的承诺。

这些监管建议大体可以归为八类。

第一,限制训练数据中的个人信息收集和使用。监管机构要求 OpenAI 制定计划,通过研究和测试证明用于训练模型的个人信息是必要且相称的,并考虑使用合成数据、移除更多个人信息、停止从高个人信息密度来源收集数据等措施。

第二,加强敏感信息提示。监管机构要求 OpenAI 在用户输入前,以清晰、显著方式提醒用户不要输入敏感个人信息,并说明聊天内容可能被审阅或用于训练模型。

第三,取得有效同意。对于用户交互数据和其他个人信息处理活动,监管机构要求 OpenAI 改善告知和选择机制,避免用户在不充分知情或被界面设计影响的情况下默认参与模型训练。

第四,提高开放性和透明度。监管机构要求 OpenAI 以普通用户可理解的方式,说明训练数据的主要来源、数据类别、用户交互数据的使用方式、模型输出可能不准确的原因,以及个人权利行使路径。

第五,改善关于个人的信息输出准确性。监管机构要求 OpenAI 针对模型输出个人信息的准确性建立专门评估和缓释机制,而不是只依赖一般模型表现、安全测试或底部提示。

第六,改善访问、更正和删除机制。监管机构要求 OpenAI 提供更易理解、可访问的数据导出工具,并为训练数据、模型输出和用户权利请求建立更清晰的响应路径。

第七,建立明确的保留期限和处置机制。监管机构要求 OpenAI 为不同类型数据建立 retention schedule,包括用户交互数据、原始网页数据、训练数据、被弃用数据集和历史基准数据。

第八,强化问责机制。监管机构要求 OpenAI 将上述要求嵌入模型开发和部署流程,并以内部政策、测试结果、流程记录和持续报告证明其执行情况。

这一组 recommendations 的意义在于,它们把传统隐私法原则转化成了大模型开发流程中的具体治理要求。它们不是单一整改动作,而是一套覆盖训练数据、用户界面、模型输出、个人权利和内部治理的整改框架。

(五)OpenAI 承诺:企业在最终回应中接受或额外提出的具体措施

OpenAI 在最终回应中并未完全接受监管机构的全部法律分析,但其接受或提出了一系列具体措施。这里应当与前述 recommendations 分开理解:recommendations 是监管机构提出的整改方向;commitments 是 OpenAI 表示愿意落实的具体动作。

OpenAI 的承诺主要包括以下几类。

第一,发布加拿大专项说明。OpenAI 承诺发布面向加拿大用户的博客文章,更具体说明其隐私实践、模型训练数据使用方式以及与 ChatGPT 相关的准确性风险。

第二,扩展 Help Center 说明。OpenAI 承诺进一步扩展帮助中心材料,解释训练数据来源、用户内容如何被使用、用户如何控制其数据,以及模型输出为何可能不准确。

第三,改善免登录网页版提示。对于无需登录即可使用的免费网页版,OpenAI 承诺在用户首次输入 prompt 之前,提供关于聊天内容可能用于训练以及不要输入敏感信息的提示。这个承诺回应了 OPC 测试中发现的时机问题:此前提示是在用户已经输入第一个 prompt 并收到第一个回复之后才出现。

第四,改进数据导出工具。OpenAI 承诺在六个月内改善 Data Export 的可读性和可理解性,解决 .zip file、.json 文件、model_comparisons.json 等技术性文件对普通用户不友好的问题。

第五,对弃用训练数据实施控制。对于不再用于主动模型开发、仅作为 historical benchmark 保留的数据集,OpenAI 承诺实施更严格的访问控制和使用限制,确保其不再重新进入 ongoing model development。

第六,测试保护公众人物未成年家庭成员的拒答措施。OpenAI 承诺测试措施,防止模型输出公众人物未成年家庭成员的姓名、生日等信息。

第七,提交季度报告。OpenAI 承诺向监管机构提交季度报告,说明其落实相关措施的进展。

这些承诺构成 OPC 作出“有条件解决”结论的重要基础。但需要注意,OpenAI 的承诺并不等于四家监管机构都认为所有问题已经解决。尤其在 OIPC-BC、OIPC-AB 和 CAI 看来,部分法律问题仍然无法仅通过后续承诺完全补救。

(六)OpenAI 新过滤工具:承诺之外最值得关注的技术补救

除上述具体承诺外,OpenAI 在调查过程中开发的新过滤工具,也是报告中非常重要的补救事实。它不应被简单写成“PII 掩码工具”,因为原文描述的能力更复杂。

该工具并非只识别姓名、电话号码、住址等传统标识符,而是通过上下文判断信息是否具有私人或个人性质,并区分私人个人、公众人物和虚构角色。对于公众人物,它还可以区分应当掩码的私人信息,例如住址、私人电话号码,和可能具有公共利益的职业联系信息。OpenAI 还表示,该工具能够检测某些未被专门训练识别、但同样具有私人或个人性质的信息类别。

在内部评估方面,OpenAI 使用 PII Masking 300k benchmark 与其他过滤工具比较;在对 benchmark 小样本微调后,新工具达到 98–99% recall,误报率为 3–6%。OpenAI 还使用 80,000 条由专业数据标注员标注的合成聊天片段进行评估,结果显示该工具与人工判断高度一致,显著优于此前使用的第三方过滤工具。

这个工具的意义在于,它回应了监管机构对早期过滤措施的核心批评:旧工具过于聚焦传统个人标识符,无法覆盖隐私法下更宽泛的个人信息,包括个人意见、个人特征、上下文中透露的敏感信息,以及有关个人的评价或推断。

不过,这项工具也不能被理解为“一劳永逸”的合规解决方案。监管机构仍要求 OpenAI 持续测试、报告和改进,并将此类工具嵌入训练数据准入、用户交互数据处理和模型输出控制等更完整的治理流程中。

(七)本案裁决结果的整体理解

把上述层次放在一起,本案的裁决结果可以概括为三句话。

第一,在 OPC 层面,投诉成立,但由于 OpenAI 承诺采取进一步措施,案件被认定为有条件解决。

第二,在 BC 和 Alberta 层面,同意问题仍然没有被后续措施完全解决,因为省级法律下的同意要求更明确、更严格。

第三,在魁北克层面,适当目的、个人权利和问责问题有条件解决,但同意和保留期限仍未解决;同时,CAI 基于魁北克法结构,没有对开放性和准确性问题作出相同违法结论。

这一差异对跨国企业非常重要。加拿大内部并不存在一个完全统一的隐私法答案。联邦 PIPEDA 的弹性解释、省级 PIPA 的同意要求、魁北克法对默认隐私和未成年人信息的特殊保护,会共同影响企业在加拿大的 AI 合规方案。企业不能只看 OPC 的“有条件解决”,也不能忽视 BC、Alberta 和 Quebec 在同意、保留期限和默认隐私设置上的更严格立场。

六、实务影响:模型生命周期证据包将成为 AI 合规基础设施

从企业实务看,本案最重要的影响,在于个人信息保护要求开始进入 AI 生命周期的每一个关键节点。企业需要能够拿出对应证据,而不是只更新隐私政策。

(一)训练数据来源目录与准入规则

企业需要建立训练数据来源目录和准入规则。目录不只是内部资产清单,还应记录数据来源类型、数据主体可能所在法域、是否包含敏感信息、是否包含未成年人信息、是否来自社交媒体或论坛、是否存在许可链条、是否有 robots.txt 或其他访问限制、是否已经完成合法性评估。对于包含大量个人信息或敏感信息的来源,应建立禁用、限制或增强过滤机制。

(二)个人信息最小化的测试证据

个人信息最小化需要有测试支撑。监管机构要求 OpenAI 通过研究和测试证明用于训练模型的个人信息是必要且相称的,并建议使用合成数据、移除更多个人信息、停止从高个人信息密度来源收集数据等措施。未来企业需要保留的不只是“已经做了过滤”的结论,还应包括过滤工具的 recall、precision、测试集、误差样本、敏感类别覆盖、上线版本和复评记录。

(三)用户交互数据的独立治理

用户交互数据需要单独治理。企业应区分提供服务所需处理、模型改进训练、人工审阅、质量评估、安全监测和商业分析等不同用途。对于非服务必需的训练用途,尤其涉及普通消费者输入时,应避免默认开启、弱提示或捆绑同意。对话界面中的显著提示、持续提示、训练开关、敏感信息警示和未成年人保护设置,都可能成为监管审查对象。

(四)关于个人的信息输出准确性评估

准确性治理应当覆盖“关于个人的信息输出”。企业需要测试模型回答个人相关问题时的准确性、拒答率、引用来源、公众人物与私人个人区分、敏感类别过滤和纠错机制。对于高风险场景,仅靠“AI 可能出错”的提示不够,应考虑来源标注、检索增强、拒答策略或人工复核。

(五)个人权利响应的替代机制

个人权利响应机制要适配模型技术特征。企业应提前设计访问、更正、删除、反对训练使用、输出屏蔽和未来训练排除的不同路径。技术上无法直接 untrain 的,应说明原因,并提供替代措施。blocklist、输入输出过滤和数据集隔离可以成为大模型环境下的替代履行方式,但企业需要证明这些措施有效、持续且可审计。

(六)训练数据保留期限表

保留期限表应覆盖训练数据生命周期。企业不能只为用户账户数据、日志数据或客户数据制定 retention schedule,还应覆盖原始抓取数据、许可数据、预训练数据、微调数据、RLHF 数据、评估数据、模型输出日志、被弃用数据集和历史基准数据。对于不再参与主动训练的数据集,应建立隔离和再使用审批,避免“历史基准”事实上成为下一轮训练的隐性来源。

(七)监管调查应对材料的工程化准备

本案也提示企业,监管调查应对材料需要前置准备。未来监管机构可能要求查看的不只是隐私政策和产品说明,而是模型训练流程说明、数据来源分类、过滤工具评估、用户提示界面截图、版本变更记录、导出工具样本、访问请求处理路径、准确性测试结果、内部风险评审纪要、保留期限表和数据隔离证明。

这些材料应当在模型开发过程中形成,而不是调查开始后临时补做。对于跨境 AI 服务而言,尤其需要保存不同法域下默认设置、同意路径、退出机制和未成年人保护设置的差异化证据。

结语:生成式 AI 合规的重点正在转向证据能力

加拿大 OpenAI 联合调查报告展示了隐私监管进入生成式 AI 领域后的基本路径。监管机构没有简单否定大模型技术,也没有要求企业公开全部训练语料。其关注点集中在企业能否证明:训练数据处理具有适当目的,公开可访问数据的使用没有超出个人合理预期,用户交互数据训练用途具有有效选择机制,模型输出中关于个人的信息有准确性保障,个人权利请求有实际响应路径,历史训练数据有明确保留和隔离规则,企业内部治理能够覆盖模型开发和部署全过程。

这份报告对企业法务和合规团队的提示相当直接。AI 合规不能只靠隐私政策,也不能只靠模型安全团队的技术说明。真正能够经得起监管调查、客户审计和跨境合规审查的,是一套完整的模型生命周期证据包,包括训练数据来源、必要性评估、PII 过滤测试、敏感数据控制、默认设置说明、用户同意记录、准确性评估、个人权利响应、保留期限表、历史数据隔离和持续监督报告。

生成式 AI 的监管争议还会继续演进。但从本案开始,隐私合规已经很难再停留在文本披露层面。企业是否具备把法律要求嵌入模型开发流程的能力,将直接影响其面向监管、客户和公众解释 AI 系统的基础信用。

夜雨聆风

夜雨聆风