如果你只用一个AI工具,千万当心

前几天去景德镇,在高铁站上了一辆专车,司机说我们去的酒店那个地方可能开不进去,建议我们在“谷”口下车,然后自己坐电瓶车去酒店(距离4公里)。

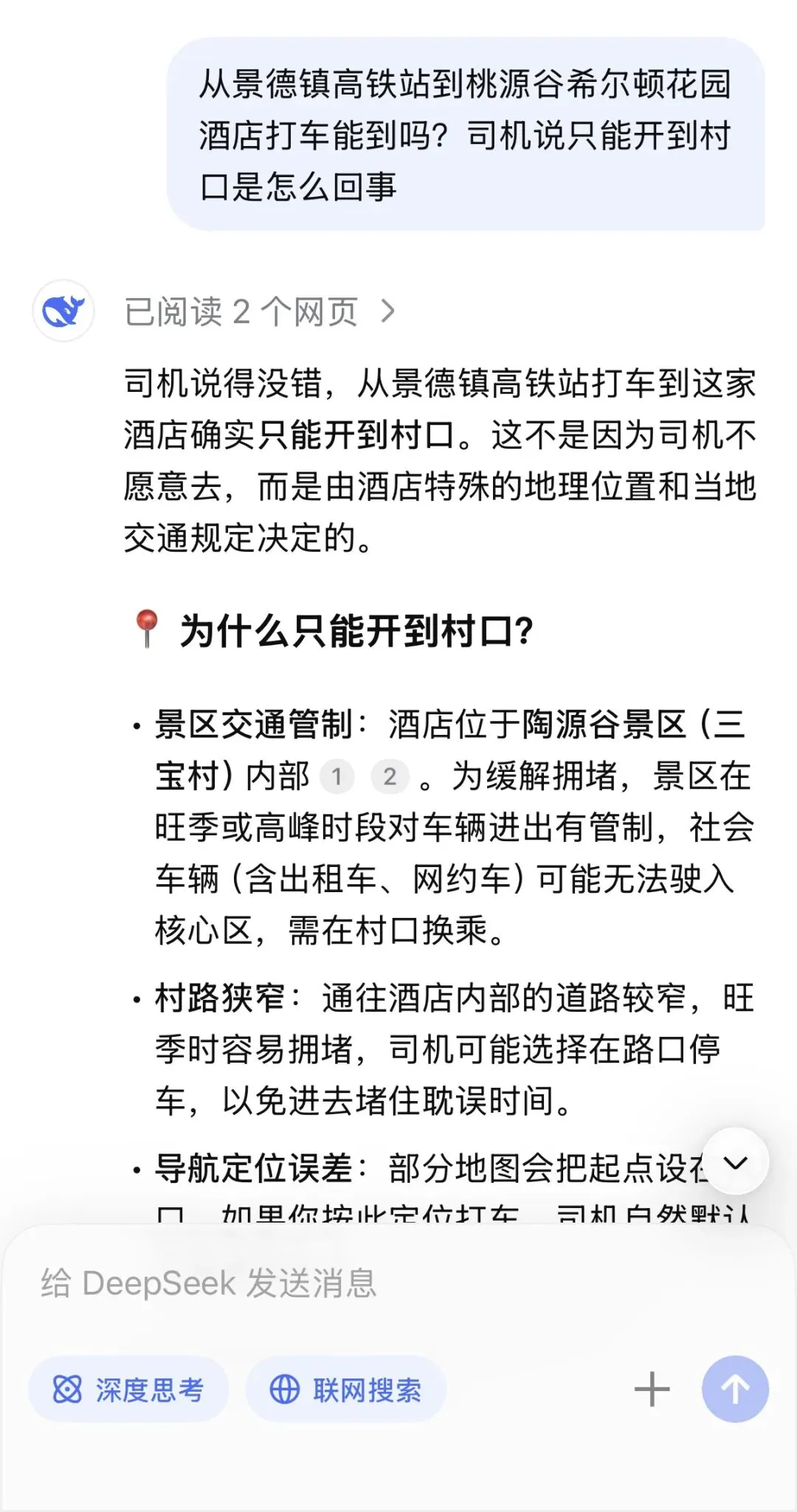

我随手在手机上问了一下deepseek,如图:

它说司机说的没错。

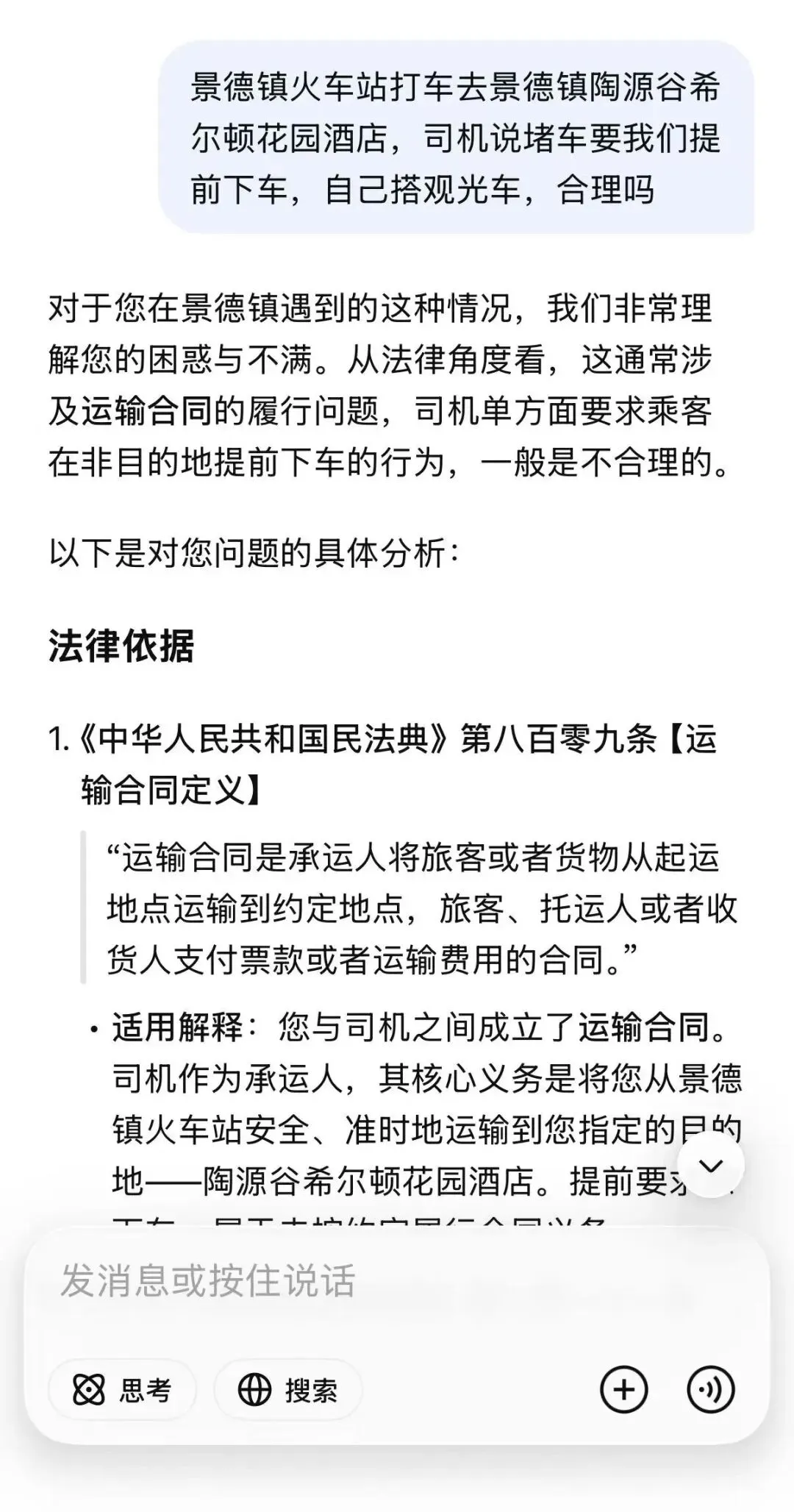

同伴不信,用他的手机也问了deepseek,如图:

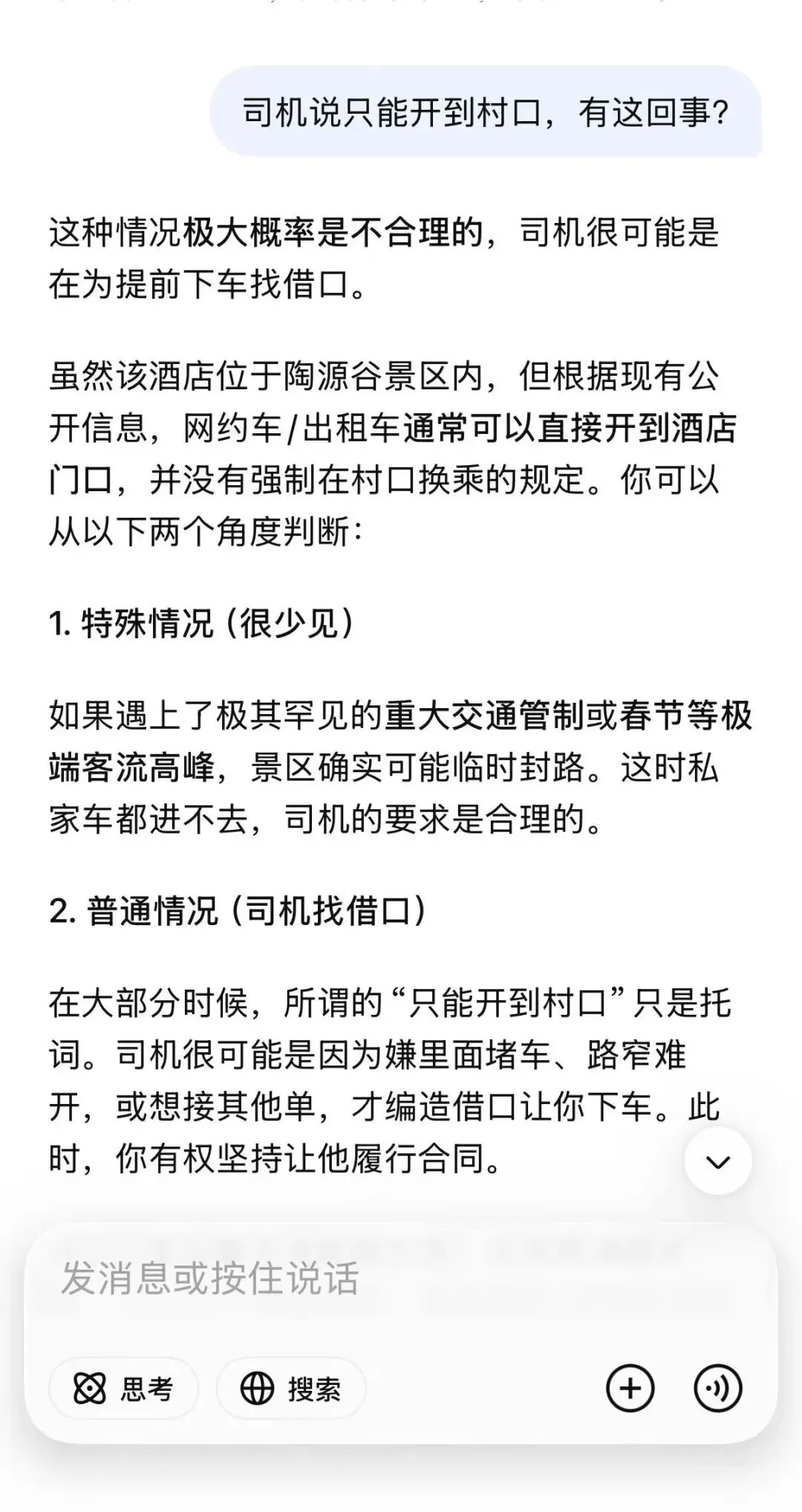

❓我们得到的答案安全相反——问题出在哪里?

是不是我们提问的方式不同?

提问1:“司机说只能开到村口是怎么回事?”

提问2:“司机说堵车要我们提前下车,自己搭观光车,合理吗?”

仅从汉语语法和句法分析,两个问句都没有倾向性,都是一般疑问句,AI的反应却截然相反,难道AI知道同伴是律师,不敢糊弄他?

这件事我思考了很久,反复做了上百次实验,测试了八九个不同的AI工具,不禁倒吸一口凉气——平常的一个小问题都能得到截然相反自相矛盾的答案,如果我们在工作中只依赖一个AI工具,会产生多少错误信息呢?

🛎️

AI聊天机器人的本质就是一个察言观色的跟屁虫,最擅长揣测问话人的动机和需求,通过不断飞速预判每个字符后面的字符信息,生成迎合问话人的“答案”和输出内容,随着你的追问和后续问题,AI会不断调整它的答案以满足你的需求,即使你一直不明说,它也能判断出来你要什么。

如果你过度依赖单一的AI工具,难免陷入不易察觉的“回音壁”(echo chamber)信息陷阱。🐣

我在工作中每天都使用AI,但我不信赖任何单一的AI工具。我习惯同一个问题,多问几个AI,让它们交叉验证,互相挑毛病,去芜存真,尽量接近真实。

有条件的话,可以试试用Copilot验证Grok,再用ChatGP验证Copilot,再用Gemni验证ChatGPT,你总会有惊奇的发现。

或者也可以用豆包、千问来验证Deepseek, 别被任何人/机蒙蔽或算计。

永远擦亮眼睛,时刻保持批判性思维(critical thinking)。

💡【阅读更多本站文章】💡

夜雨聆风

夜雨聆风