这款开源「AI 导演」工具,想把短剧生成从碰运气变成一套流程

BigBanana AI Director 试图把剧本、角色、场景和关键帧串成一条更完整的 AI 创作链路

前言

这篇文章基于项目公开信息与界面功能整理,重点不是讨论“它能不能一键出爆款”,而是看它试图解决 AI 短剧创作里最麻烦的几个老问题。实际生成效果仍会受到模型能力、提示词、素材设定和人工调整程度影响。

这两年,AI 生成视频的能力已经进步很快,但只要目标从“做一个片段”变成“做一段连续叙事”,问题就会迅速暴露出来:

-

角色换个镜头就”变脸”,完全不是同一个人 -

每个镜头单独生成,前后场景光影对不上 -

输入提示词,结果全靠运气——纯”开盲盒”

原因并不复杂。大多数 AI 工具擅长的是生成局部结果,却不擅长维护一条连续的叙事链路。

今天要看的开源项目,叫 BigBanana AI Director(AI 漫剧工场)。它的思路不是继续强化“输入一句话,等模型发挥”,而是把剧本、角色、场景、镜头拆成几个阶段来做,尽量把短剧生成从一次性出图,变成一套可管理、可迭代的流程。

它到底在做什么

BigBanana AI Director 是一款面向创作者的开源 AI 短剧/漫剧制作平台。

和很多只强调单次生成结果的工具不同,它采用 Script → Asset → Keyframe(剧本 → 资产 → 关键帧) 的三段式工作流,把创作过程拆成几个更容易控制的环节:

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

它想解决什么问题

先处理关键帧,再生成运动

很多 AI 视频工具的问题在于,用户能控制输入,却很难稳定控制镜头过程。

BigBanana 引入了动画制作中常见的 关键帧(Keyframe) 机制:

-

先画后动:先确定每个镜头的起始帧与结束帧 -

AI 插值:再由模型生成两帧之间的动态过渡 -

资产约束:结合角色定妆照与场景概念图,尽量保持视觉风格统一

换句话说,它试图把控制权前移。与其让用户在一段已经生成好的视频上反复返工,不如先把镜头起点和终点定义清楚,再让模型去补足中间过程。这样至少在工作流上,更接近创作者熟悉的分镜和镜头设计逻辑。

角色为什么总会“换脸”

角色在多镜头中形象漂移,是 AI 短剧制作里很常见的问题。BigBanana 给出的思路主要有三点:

-

定妆照系统:为每个角色生成标准参考图,作为后续镜头的视觉锚点 -

衣橱系统:支持多套造型配置,方便在不同剧情中切换服装 -

上下文感知:生成镜头时自动读取当前角色与场景信息,减少重复描述

这套思路的重点不在于“绝对不变形”,而在于先建立稳定参考,再把参考持续带入后续镜头。对于需要连续叙事的内容来说,这比每个镜头都从零开始生成,更符合实际制作需求。

从灵感到成片,被拆成四个阶段

整个创作流程对应四个比较清晰的阶段:

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

实际流程长什么样

1. 项目管理

项目管理页承担的是最基础的组织工作。不同短剧项目可以独立存储,方便中断之后继续推进,也更接近一个长期创作项目该有的管理方式。

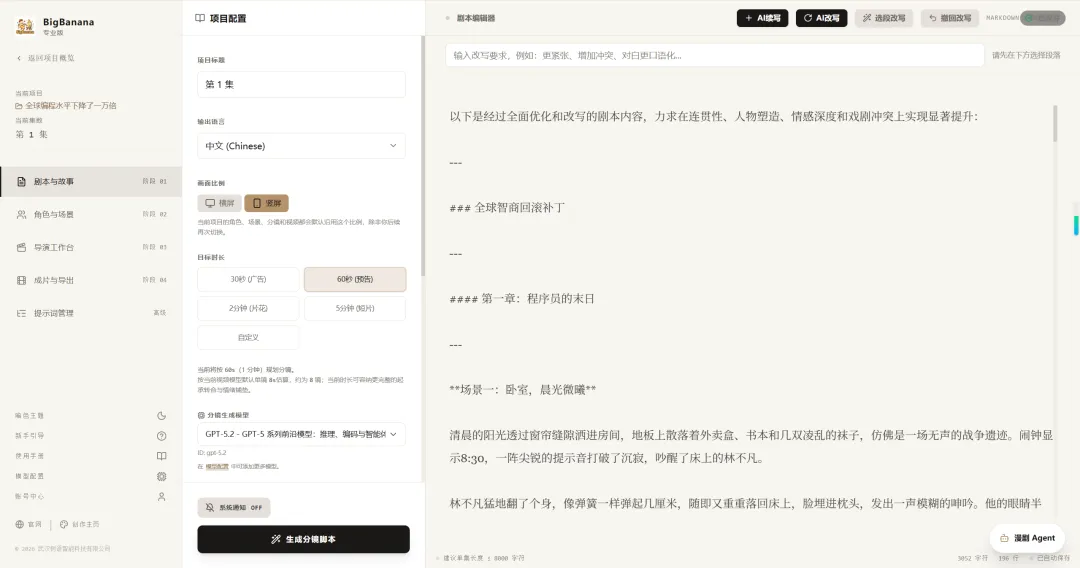

2. Phase 01:剧本与分镜

第一步先从文字开始。输入一句故事创意或一段小说片段后,系统会辅助完成:

-

拆解为剧本结构,包括场次、时间和情绪氛围 -

生成分镜脚本,辅助规划镜头节奏 -

将文字描述转化为后续可用的图像提示词

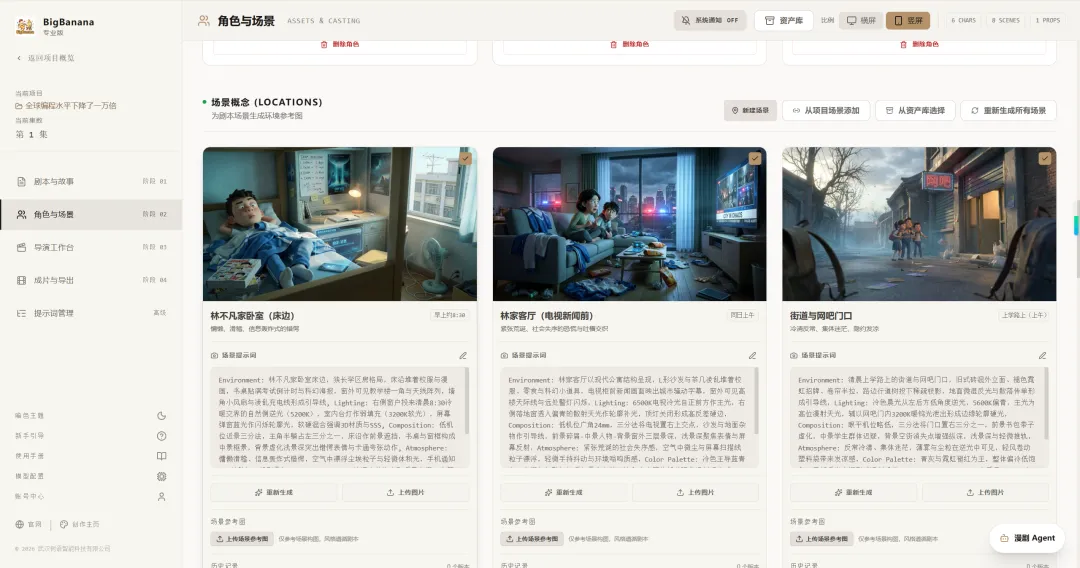

3. Phase 02:角色与场景资产

第二步不是直接做视频,而是先建立角色与场景资产。这一步其实很关键,因为很多连贯性问题,往往都不是出在“视频模型不够强”,而是前面没有把参考资产准备好:

-

为每个角色生成”定妆照”,作为全片的视觉参考标准 -

支持配置多套服装造型,满足不同剧情场景 -

生成场景概念图,确保全片光影风格统一

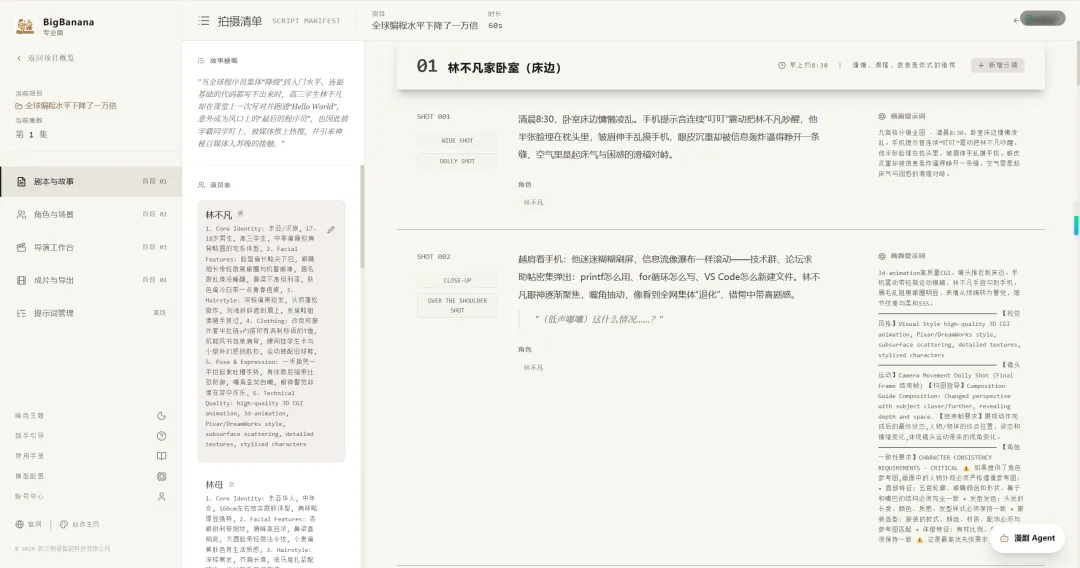

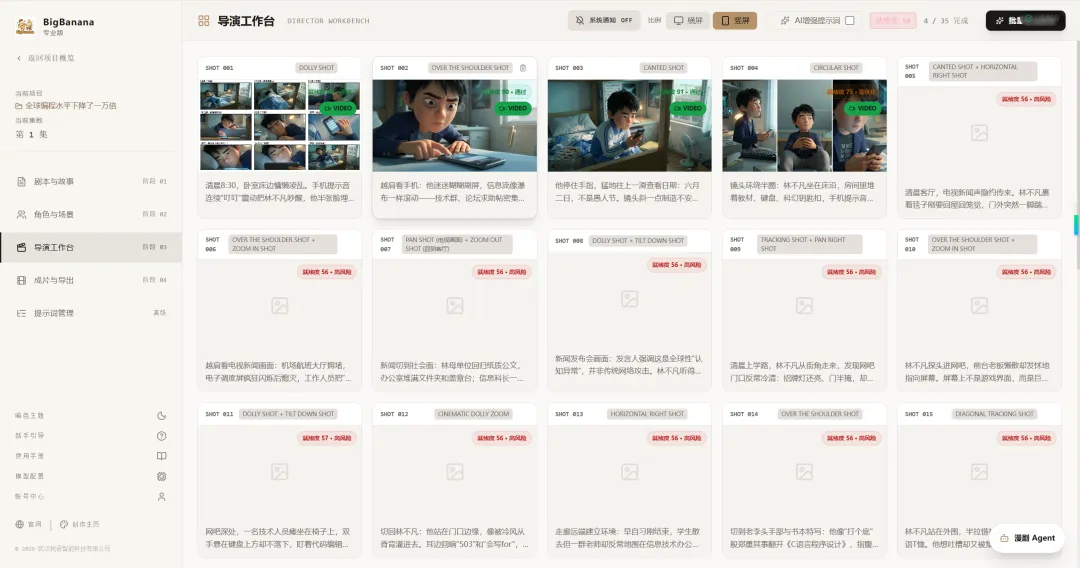

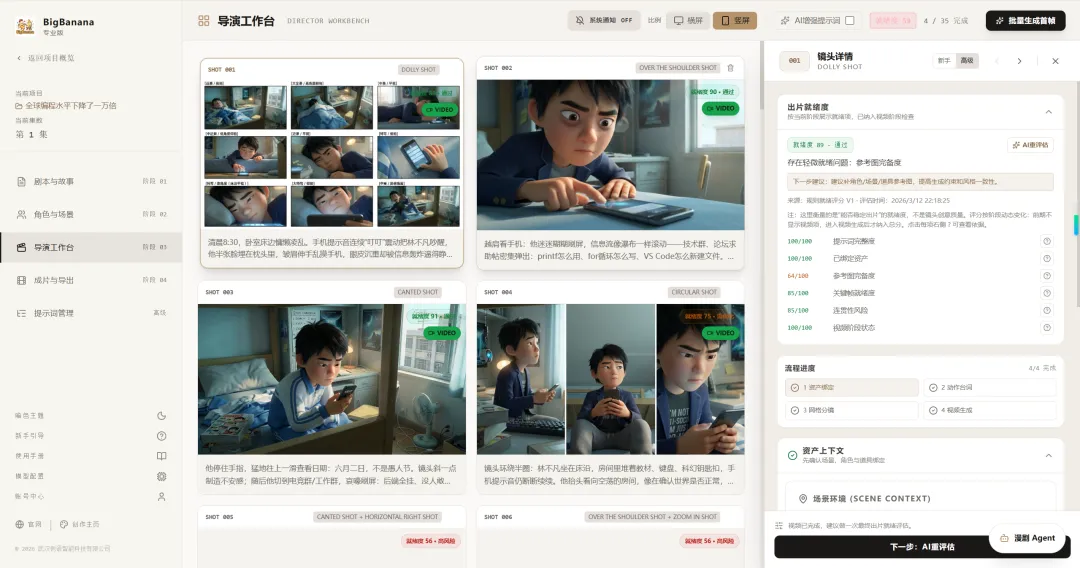

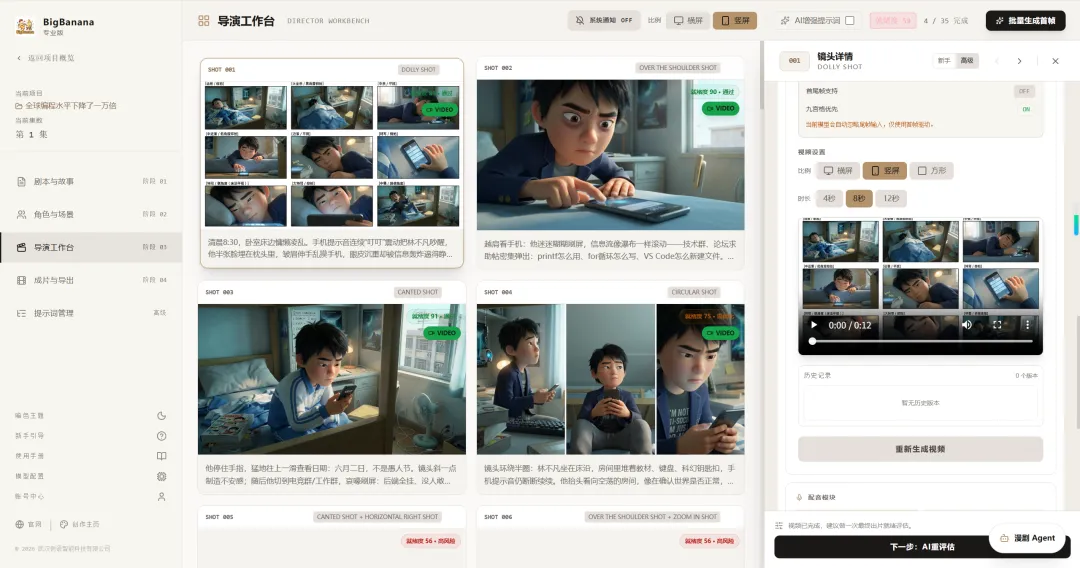

4. Phase 03:导演工作台

到了导演工作台,整个产品的核心思路才真正显现出来。它不是让用户不断“再生成一次”,而是把镜头管理、关键帧编辑和视频生成放到同一个操作区里:

-

网格化分镜表:集中管理所有镜头与当前进度 -

关键帧编辑:分别调整每个镜头的起始帧与结束帧 -

上下文感知生成:自动读取当前场景的角色与场景资产,减少镜头脱节 -

双模式视频生成:支持图生视频和关键帧插值两种模式

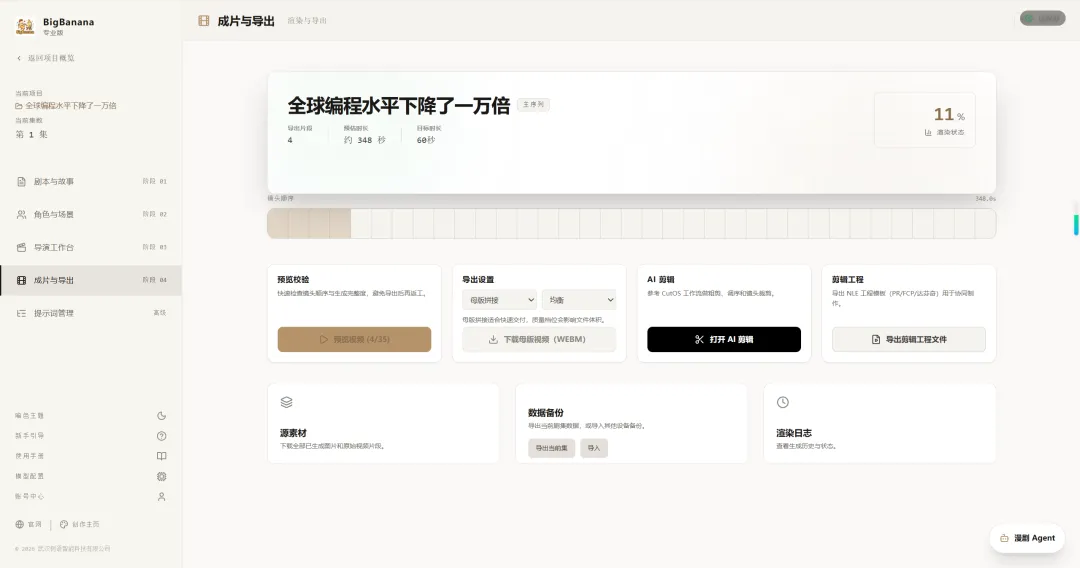

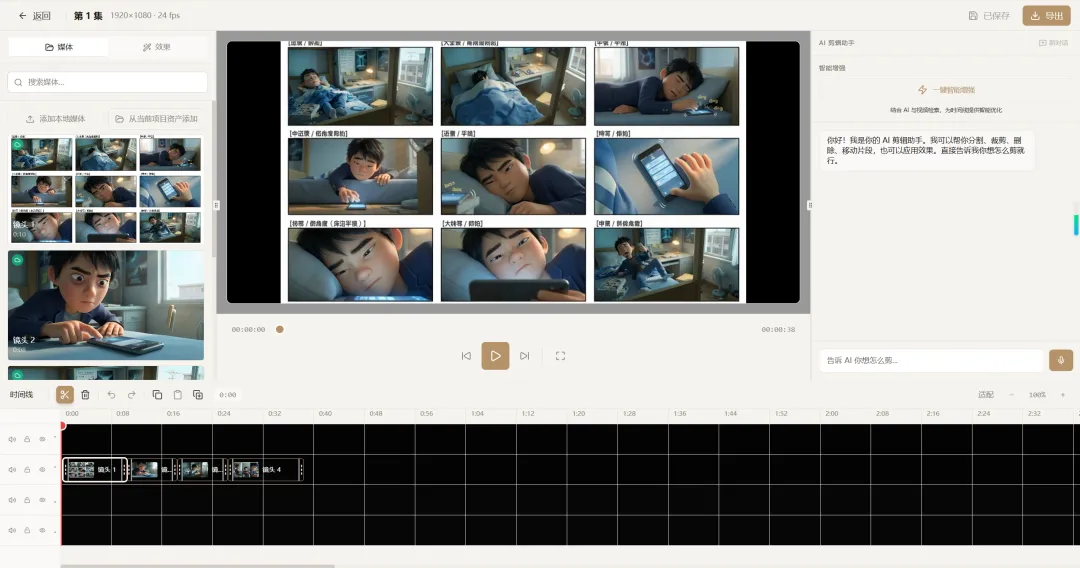

5. Phase 04:成片导出

最后一步才是预览与导出:

-

时间轴形式预览完整短剧,便于检查节奏 -

实时监控渲染进度 -

支持导出高清关键帧图片和 MP4 视频片段

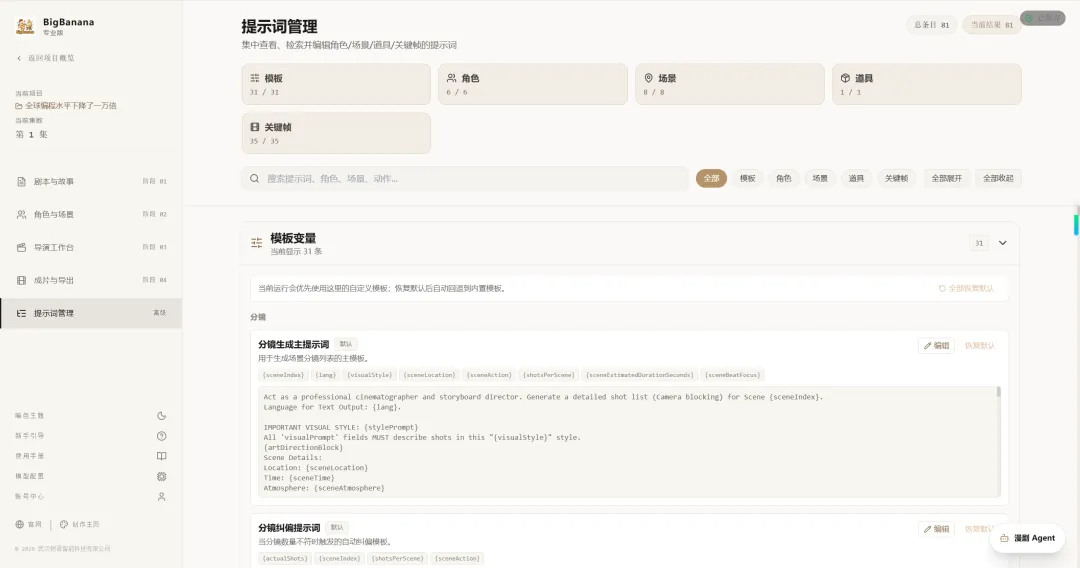

提示词管理

除了镜头本身,系统还单独做了提示词管理模块,方便查看、编辑和优化各镜头使用的提示词:

背后的技术组合

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

从页面说明来看,创作数据主要存储在用户本地浏览器中,这意味着它在部署上相对轻量,也更适合个人创作者先快速搭环境体验。至于数据保存、迁移和同步策略,仍建议以项目实际实现为准。

快速开始

方式一:在线体验

https://director.tree456.com/

方式二:Docker 部署(推荐)

git clone https://github.com/shuyu-labs/BigBanana-AI-Director.git

cd BigBanana-AI-Director

docker-compose up -d --build

# 访问 http://localhost:3005

使用步骤

-

配置 API Key:启动应用后,填入 AntSK API Key -

输入故事:在 Phase 01 输入故事创意或小说片段 -

生成资产:在 Phase 02 为角色和场景生成视觉参考 -

制作分镜:在 Phase 03 逐镜头生成并编辑关键帧 -

导出成片:在 Phase 04 预览时间轴,导出视频

它更适合什么场景

如果你的目标只是快速生成一条视频,这类强调流程管理的工具未必是效率最高的选择。

但如果你更在意下面这些问题,BigBanana 这种做法会更有参考价值:

-

需要把一个故事拆成多镜头连续输出 -

希望角色和场景在前后镜头里尽量保持统一 -

需要对镜头起止状态进行更细的人工干预 -

想把剧本、资产、分镜、导出放在一个项目里统一管理

项目地址

GitHub:https://github.com/shuyu-labs/BigBanana-AI-Director

写在最后

AI 确实在降低视频创作门槛,但从“生成一个画面”到“完成一段连贯叙事”,中间隔着的从来不只是模型能力,还有流程、资产和镜头控制这些工程化问题。

BigBanana AI Director 的有意思之处,就在于它没有把自己做成一个“万能生成器”,而是试图把剧本、资产、镜头和导出组织成一条更完整的生产链路。对于想尝试 AI 短剧、漫画分镜或动画故事板的创作者来说,这种产品思路本身就值得看一看。

如果你正在找一款偏流程化、可逐步编辑的开源 AI 短剧工具,可以把这个项目加入备选清单。它未必适合所有人,但至少提供了一种不同于“单次生成”的答案。

GitHub:https://github.com/shuyu-labs/BigBanana-AI-Director

如果想进一步判断它是否适合自己的工作流,最直接的方式还是去看项目 README、示例项目,以及 Issue 区里关于使用体验和问题反馈的讨论。

Built for Creators, by BigBanana.

夜雨聆风

夜雨聆风