从“工具”到“伙伴”:智能体技术发展前瞻

【AI先锋洞察】智能体(Agentic AI)正在从“会回答问题的模型”,升级为“能理解目标、会分解任务、会调用工具、还能与其他智能体协同”的复杂系统。它不只回答问题,而是能拆解任务、调用工具、与多智能体协同,并在复杂环境中持续学习。这意味着AI能力开始从单点模型向“体系化能力”迁移——架构走向分层模块化,学习走向多模态与终身进化,协作走向组织化与信誉机制,然而真正决定其能否进入高风险场景的,应该是其配套的可审计、可接管、可停用的安全治理框架。

【AI先锋洞察】智能体(Agentic AI)正在从“会回答问题的模型”,升级为“能理解目标、会分解任务、会调用工具、还能与其他智能体协同”的复杂系统。它不只回答问题,而是能拆解任务、调用工具、与多智能体协同,并在复杂环境中持续学习。这意味着AI能力开始从单点模型向“体系化能力”迁移——架构走向分层模块化,学习走向多模态与终身进化,协作走向组织化与信誉机制,然而真正决定其能否进入高风险场景的,应该是其配套的可审计、可接管、可停用的安全治理框架。

目 录:

1.架构:从单体到分层模块化,走向“可组装的智能”

2.学习:多模态 + 终身学习,跨过“灾难性遗忘”门槛

3.协作:多智能体进入“社会化协同”,信誉与激励成为硬问题

4.安全治理:人在回路,把风险关进笼子

5.研判:C2重构、对抗升级、底线与护栏

第1章|架构演进:模块化、分层化与“可组装智能”

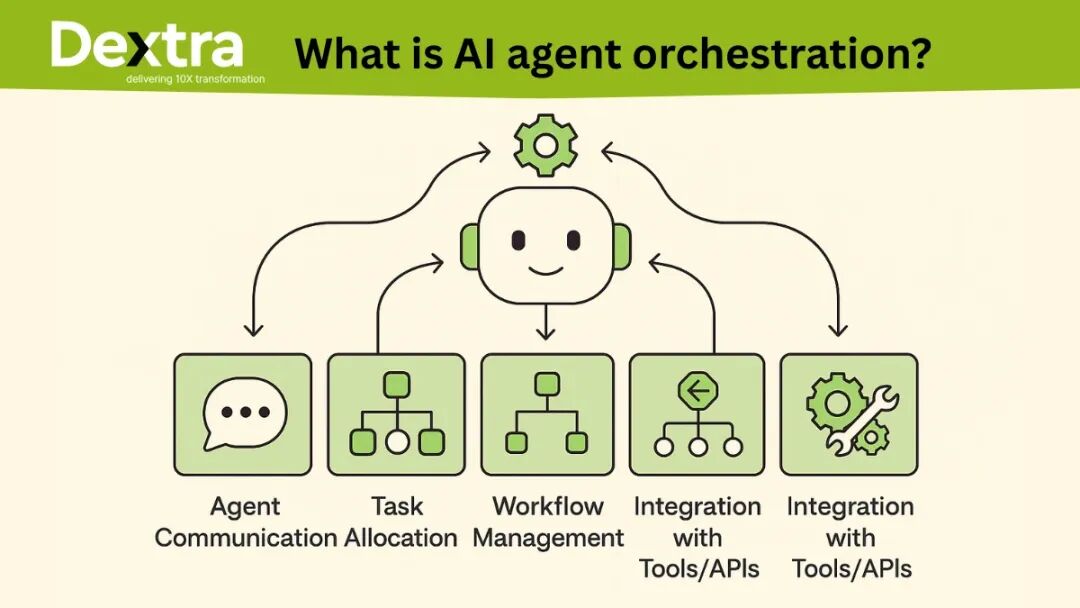

近两年,智能体系统最显著的工程转向,是从“一个模型干所有事”,切换为更接近人类认知链条的分层复合架构:

-

感知层:接多模态输入(文本、图像、传感器) -

推理层:形成任务理解、约束与计划 -

决策层:在不确定性下做取舍(成本/风险/收益) -

执行层:调用工具、写代码、下发动作 -

元认知层:自我监控、反思、纠错、策略重配

模块化架构有利于智能体的反思、纠错与改进。未来进一步的方向,是神经符号(Neuro-Symbolic)与元认知的组合:用神经网络保留感知优势,用符号/规则增强逻辑一致性与可验证性,并由元认知进行“该用直觉还是该用规则”的调度。融合符号系统并引入元认知成为获得更强推理能力的重要路径。

第2章|学习范式:多模态 + 终身学习,跨过“灾难性遗忘”

如果说架构决定智能体“能不能上规模”,学习范式就决定它“能不能长期进化”。未来五年,智能体学习会出现三条主线:

-

从被动到主动:学会探索世界监督学习更像背题,智能体需要更像“带目标训练”:通过强化学习、课程学习、元学习等机制,在开放环境中形成更稳定的策略与泛化能力。 -

多模态成为标配:从文本智能到场景智能军事/工业/安防等场景里,关键线索往往不在文本,而在图像、波形、轨迹、日志与传感器。智能体必须能跨模态对齐语义、建立事件链,并在噪声与欺骗信息中保持稳健。 -

终身学习:不仅“学新”,也要“别忘”终身学习的门槛是灾难性遗忘:学新任务时旧能力大幅退化。“终身学习智能体”的核心组件分为三部分:感知模块(多模态输入集成)—记忆模块(存储与检索演化知识)—行动模块(与动态环境交互),并强调它们共同支撑持续适应与缓解遗忘。未来的“数字参谋”不应是一次性部署,而是可持续更新、带记忆、能复盘、可迁移的一套体系能力。

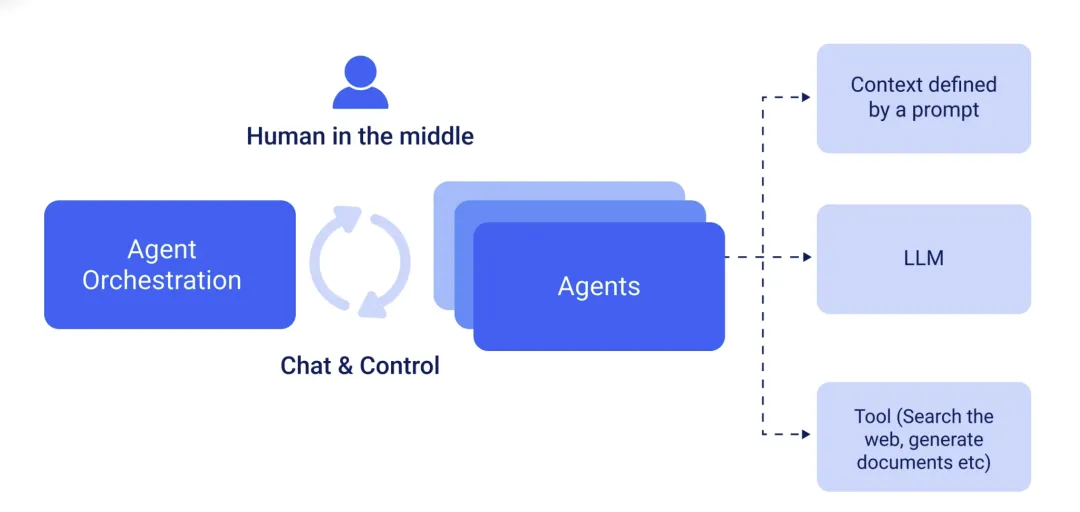

第3章|协作机制:多智能体进入“社会化协同”

单智能体的上限,取决于它“能用多少工具”;多智能体的上限,则取决于它们能否形成稳定的组织结构:

-

分工:谁做侦察、谁做规划、谁做验证、谁做执行 -

协商:目标冲突时怎么谈判、怎么折中 -

角色机制:指挥/参谋/执行/审计如何流转 -

集体智能:如何汇聚多方证据,减少单点幻觉与偏差

但“社会化协同”会引入一个关键变量:信任。信誉机制(reputation)看似能促进合作,实际上也会制造新的协调难题:智能体不仅要学会“信誉信号代表什么”,还要对“如何分配信誉的社会规范”达成共识。研究指出,在有信誉机制的环境中,标准Q-learning常出现收敛到不良均衡的情况;通过引入一定比例的“固定合作者种子”以及“内省式奖励”等手段,可以显著提升合作稳定性。

所以,未来对抗不一定先打单智能体平台,也可能先打智能体协作——干扰共识、污染信誉、诱发误判,让“群体智能”变成“群体失控”。

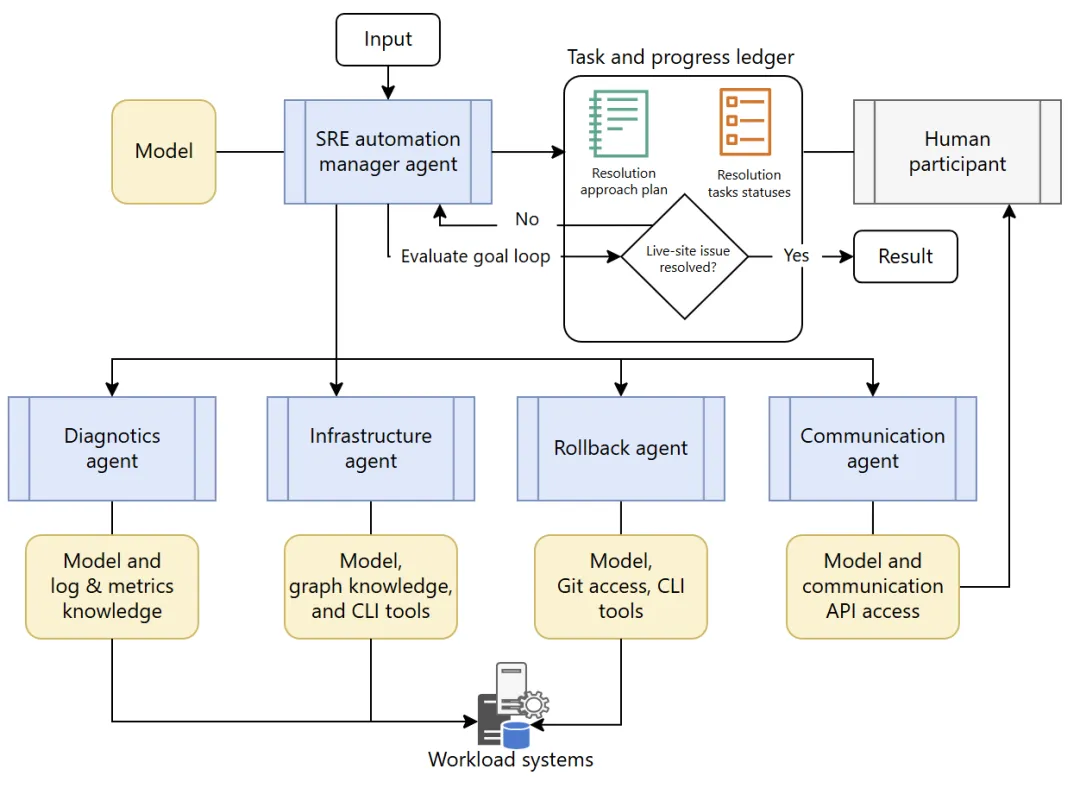

第4章|安全治理:从安全准则制定到人在回路

智能体作为一个能自主调用工具、能串联多步行动的系统,在高后果场景里需要可控、可审计、可追责。

常见治理手段包括:

智能体时代的五项基本原则分别是:专业Responsible、合理Equitable、可追溯Traceable、可信任Reliable、可监管Governable。五项原则应成为“可落地的工程要求”:减少偏差、可追溯、可审计,支持开展全生命周期测试,随时可脱离、可停用。

构建智能体的同时增加风险管理活动:治理GOVERN /风险识别MAP /风险评估MEASURE /风险管理MANAGE。

智能体工程实践就是:

-

先把“能做什么/不能做什么/谁负责”写清楚(Govern) -

明确任务边界与场景风险(Map) -

用指标与测试监控可靠性与偏差(Measure) -

给出处置动作:降级、回滚、接管、停用(Manage)

特殊场景AI使用应当可问责,并置于负责任的人类指挥控制链中,同时提出包括透明可审计、全生命周期测试、最小化偏差、人员训练、具备“解除/停用”等故障响应能力等措施。

总之,智能体越自主,治理越必须前置且标准化。

第5章|研判:C2重构与“对抗升级”

研判1:从“平台智能”到“体系智能”(System-of-Systems)

未来军用智能体更可能首先在“体系链条”里发挥作用:情报融合、任务规划、资源调度、故障诊断、保障优化——它们共同把作战系统推向更高的响应速度与协同密度。

当智能体能自己规划并调用工具,人类角色会从“逐条指令”转为“授权与约束”。

-

给目标、给规则、给权限范围 -

保留可撤销权与紧急制动权 -

对关键节点实施人工确认(尤其是高后果动作)

多智能体与集群系统的关键脆弱性,常在“协作层”而非“单机性能”:

-

干扰通信与共识形成 -

诱导信誉系统与规范学习偏航 -

制造“自动化偏见”,让人过度相信系统输出 -

利用不可追溯链条,使责任难以界定

未来五年,智能体技术的“上限”取决于两件事:一是能否用分层架构把感知—推理—决策—执行与元认知做成可组装、可扩展的工程体系;二是能否跨过终身学习与多智能体协作的稳定性门槛。而它的“下限”同样清晰:越自主就越必须可控——需要把责任链、审计链和紧急制动机制写进设计与部署流程,并通过治理-映射-测量-处置的闭环持续压制风险。

参考文献

1.Neuro-Symbolic AI系统综述(含元认知与研究缺口):https://arxiv.org/html/2501.05435v2

2.终身学习的LLM智能体综述(感知/记忆/行动三模块):https://arxiv.org/abs/2501.07278

夜雨聆风

夜雨聆风