多模态大模型文档解析开源新进展:Qianfan-OCR模型架构、数据引擎、训练方法

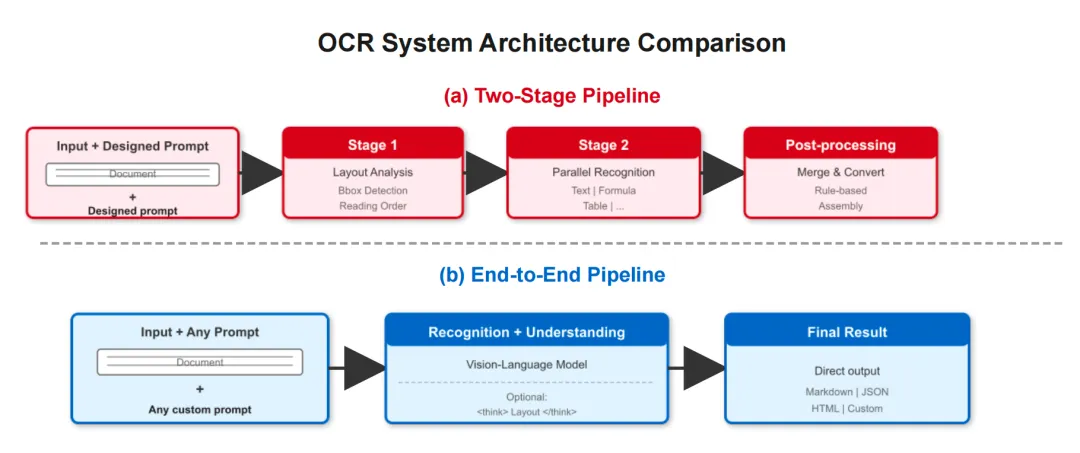

继续跟进【文档智能】解析进展。在前期专栏中总结过,文档解析范式分三个:(1)基于ocr-pipeline;(2)基于layout+vlm的两阶段;(3)基于vlm端到端;Qianfan-OCR是一个4B参数量的端到端的多模态文档解析模型,解决了传统OCR流水线的误差传播、视觉上下文丢失、部署复杂等问题,其方法体系围绕端到端架构设计、Layout-as-Thought机制、大规模数据合成、四阶段渐进式训练四大核心展开,下面来看看方案。

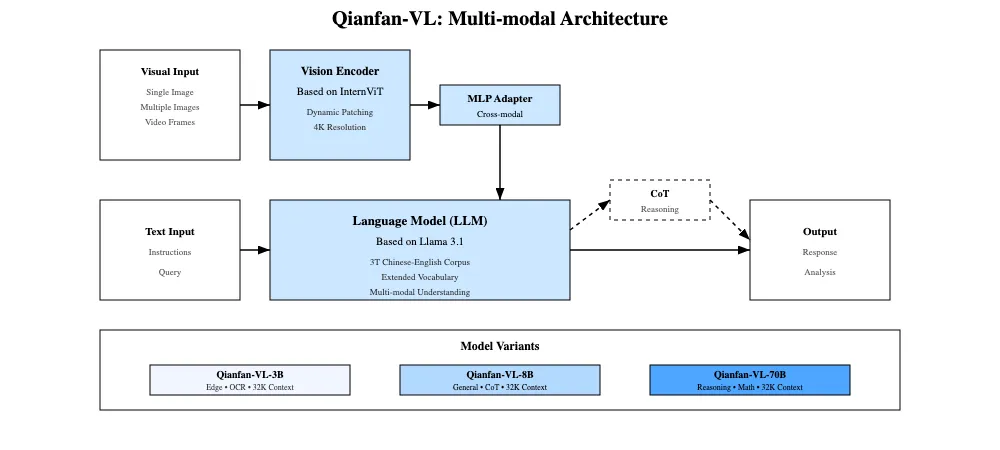

模型架构

Qianfan-OCR基于Qianfan-VL的多模态桥接架构改造,将所有文档处理任务融入单一模型,遵循经典的Vit【Qianfan-ViT(高分辨率自适应编码)专为文档OCR的高密度文本、小字体、复杂布局设计,核心特性是AnyResolution动态分块】+MLP(两层带GELU激活的MLP)+LLM【Qwen3-4B:平衡复杂文档推理能力和生产级部署效率】架构。

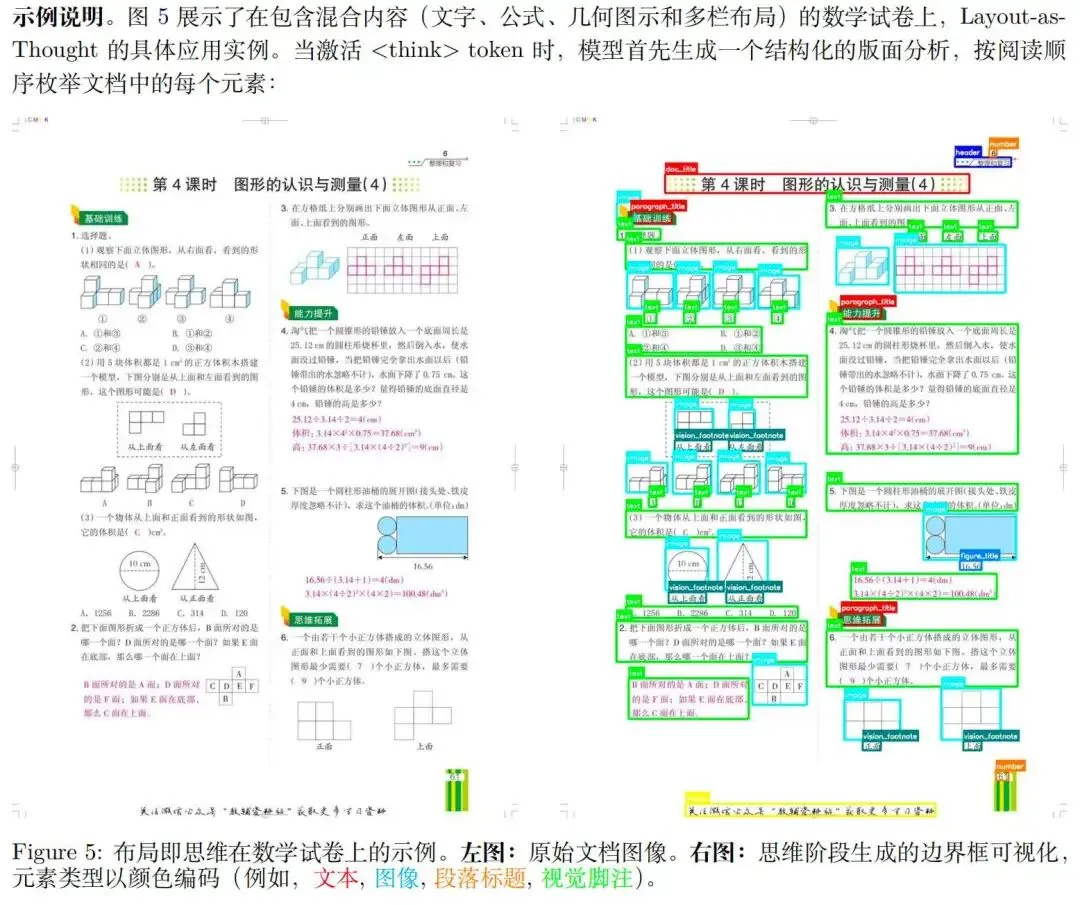

核心方法:Layout-as-Thought机制

该机制解决了纯端到端OCR缺乏显式布局分析的痛点:流水线OCR可输出元素边界框、类型和阅读顺序,而传统端到端OCR直接生成结果,丢失了空间定位能力。

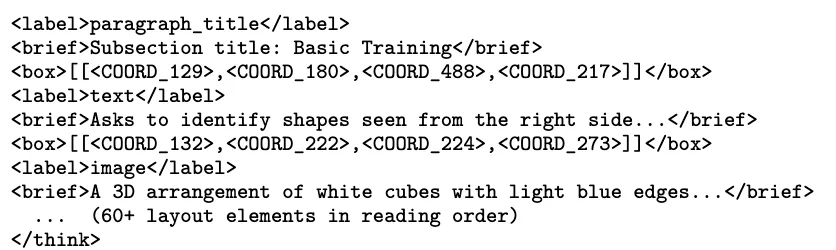

机制定义:通过⟨ think ⟩特殊token触发的可选思维阶段,模型在生成最终输出前,先生成结构化的布局表示(边界框、元素类型、阅读顺序),将布局分析转化为模型的“中间推理步骤”,而非独立的前置任务。

技术实现细节

(1)布局表示的结构化输出

触发⟨think⟩后,模型生成的布局信息包含三个核心字段,封装在<layout>...</layout>标签中:

-

<box>:归一化到[0,999]的边界框坐标,使用**<COORD_0>~<COORD_999>专用token**表示,相比纯数字编码减少50%的输出长度,降低推理延迟; -

<label>:元素类型标签,采用PaddleOCR-VL的25类精细标签体系,分为4组(文本元素12类、页眉页脚4类、图/表6类、公式3类); -

<brief>:文本类元素的内容摘要,非文本元素(如图、表)的视觉描述。

(2)坐标token的优化设计

所有坐标均映射为单一专用token,而非数字序列(如“779”需3个token,< COORD_779 >仅1个),解决了复杂文档(单页60+元素)的布局推理延迟问题。

(3)对最终输出的引导方式

布局推理结果通过两种方式提升最终输出质量:

-

元素类型感知生成:识别到公式则用”$$”包裹,识别到表格则转化为HTML,识别到图片则插入正确位置的占位符; -

阅读顺序引导排序:按文档的自然阅读顺序枚举元素,解决多列、图文交错、脚注等场景的输出顺序混乱问题。

数据引擎

端到端模型的性能高度依赖数据,Qianfan-OCR针对OCR的专属任务设计了六大数据合成流水线,覆盖文档解析、KIE、复杂表格、图表理解、公式识别、多语言OCR,并通过多维度增强保证数据的多样性和真实性,最终生成支撑四阶段训练的大规模高质量数据集。

六大核心数据合成流水线

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

文档图像增强策略

针对OCR和布局解析的不同需求,设计两套增强流水线,均包含三级噪声+旋转增强:

-

三级噪声增强 -

文本噪声:笔画断裂、墨水渗透、字符错位; -

背景噪声:纹理、颜色漂移、水印; -

成像噪声:模糊、摩尔纹、阴影、曝光变化; -

旋转增强:90°/180°/270°旋转+±15°倾斜,解决票据、证件等非标准朝向的识别问题。

训练方法

Qianfan-OCR采用Qianfan-VL的多阶段渐进式训练方法论,核心是从通用能力到OCR专属能力的逐步强化,同时通过数据混合策略防止灾难性遗忘。

|

|

|

|

|

|

|

|

|---|---|---|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

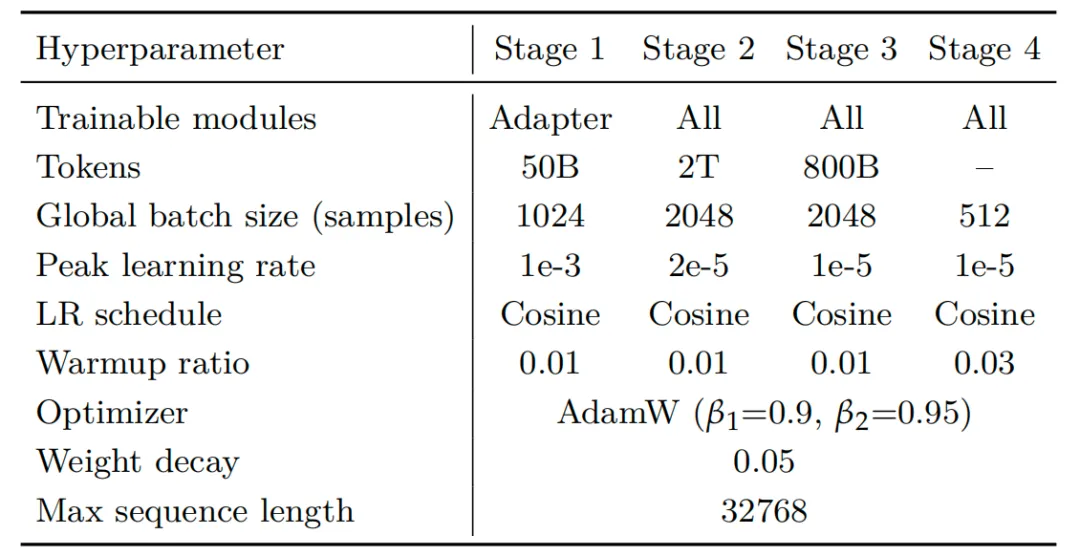

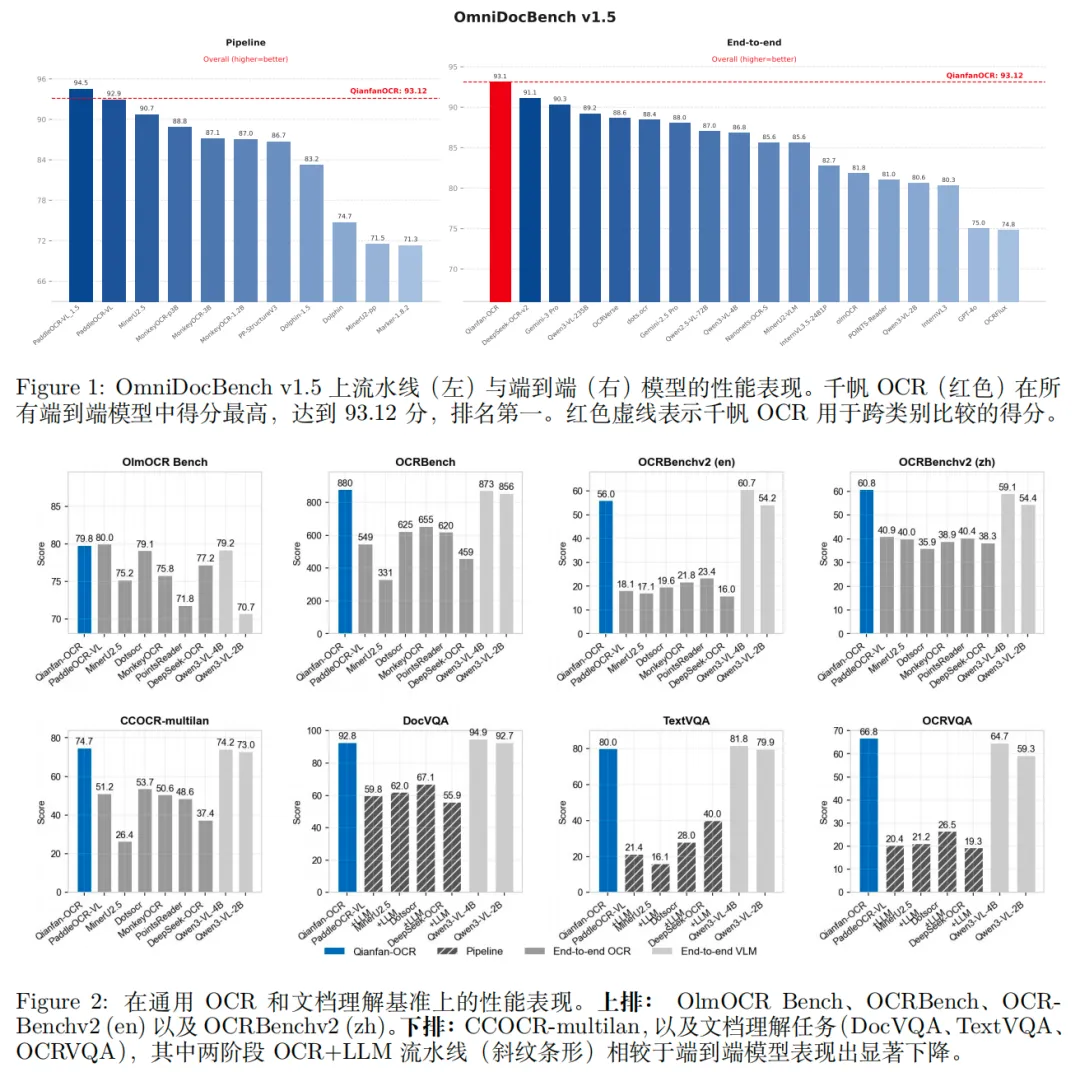

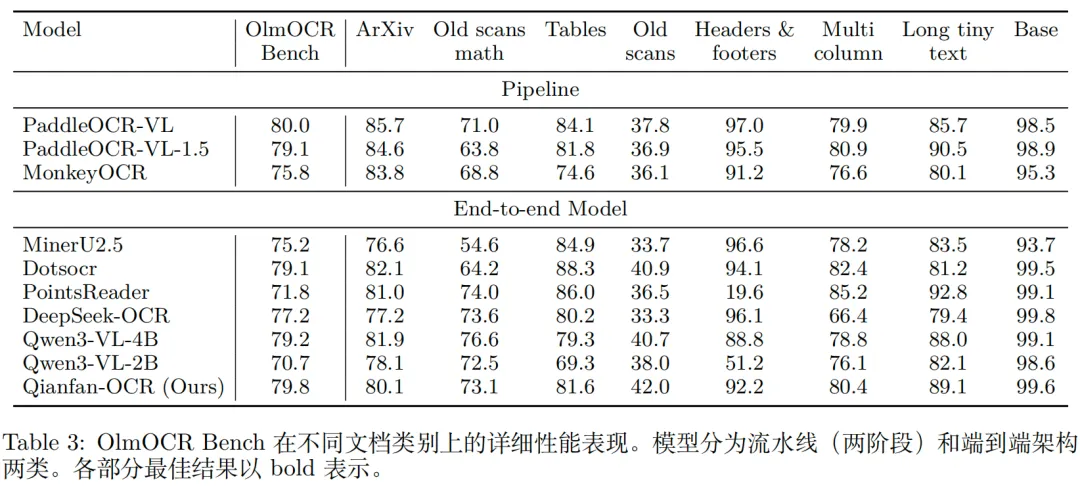

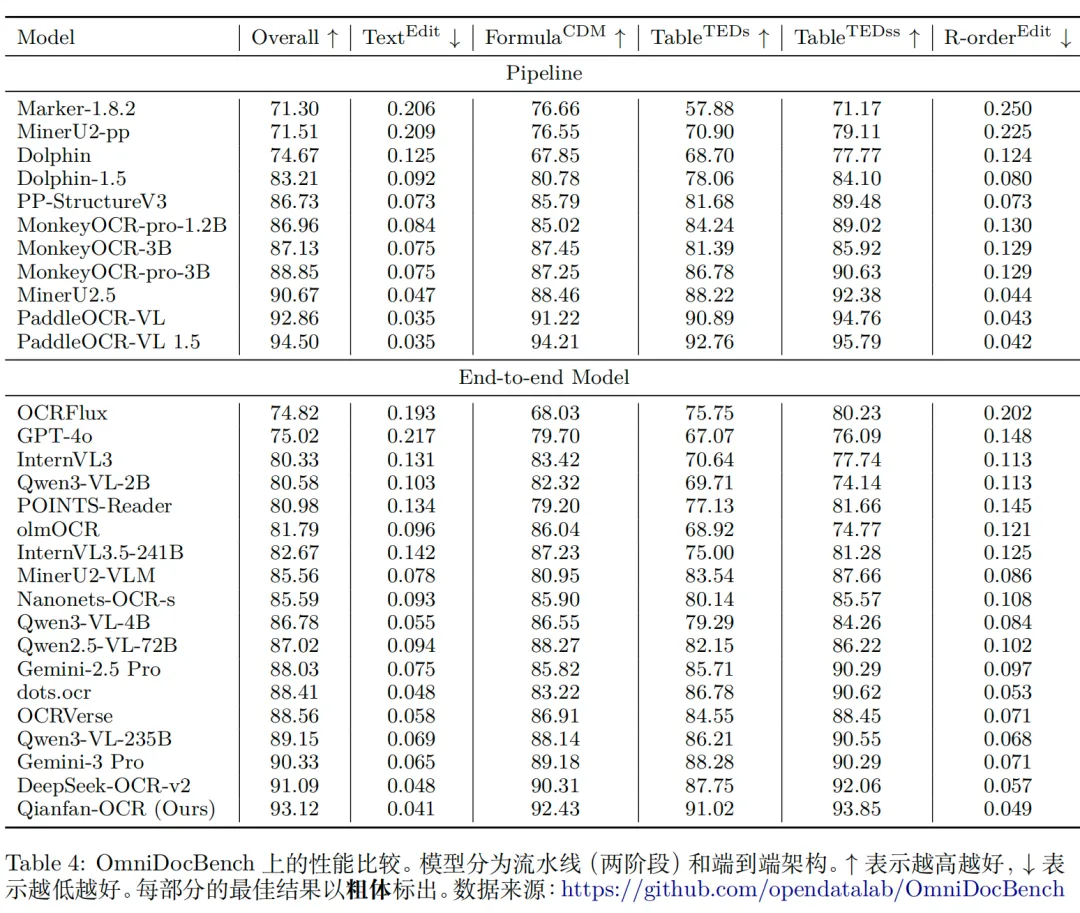

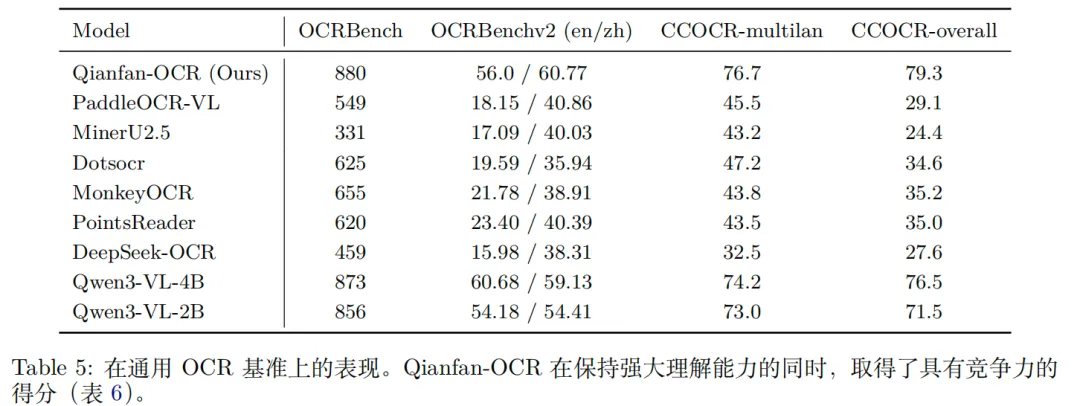

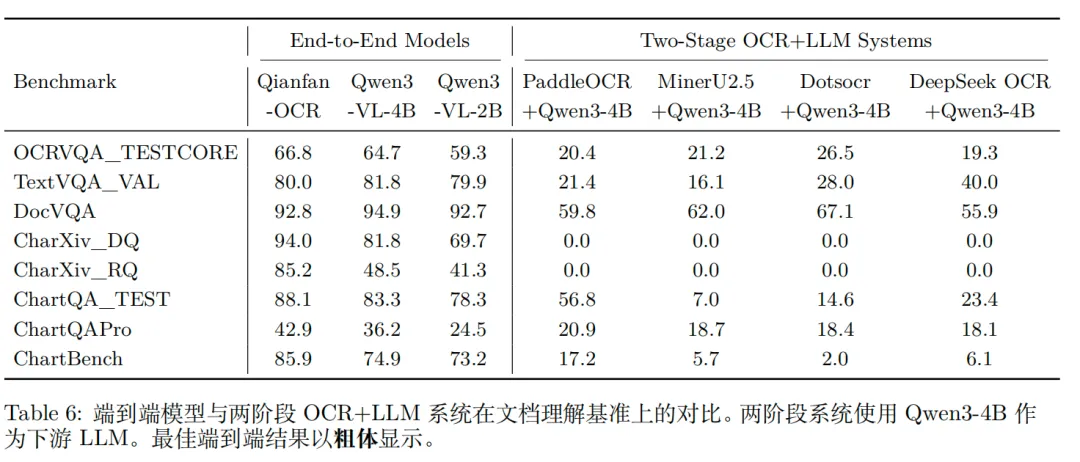

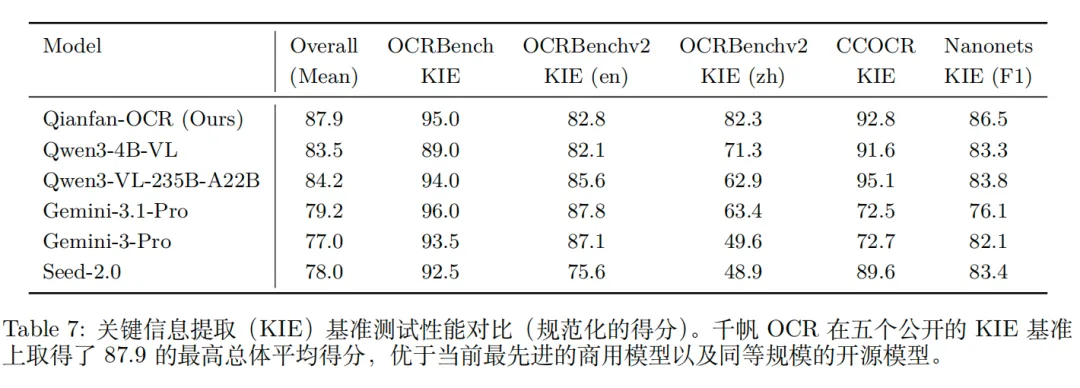

实验性能

参考文献

-

Qianfan-OCR: A Unified End-to-End Model for Document Intelligence,https://arxiv.org/pdf/2603.13398

-

模型权重:https://www.modelscope.cn/models/baidu-qianfan/Qianfan-OCR

往期相关

多模态文档解析的开源项目模型技术方案都在《文档智能专栏》,如:

…

夜雨聆风

夜雨聆风