手机断网也能跑AI?这个开源神器我吹爆

上周坐飞机,我想让 AI 帮我整理一下会议笔记。

打开 ChatGPT——没网。打开 Claude——没网。打开豆包——还是没网。

三个 App 轮流告诉我同一件事:没有网络连接。

我看着窗外的云,心想:2026 年了,AI 都能帮人写代码、画画、做视频了,但上个飞机就全部罢工?

后来我在 Hacker News 上发现了一个叫Off Grid的开源项目,试了一下——

断网状态下,手机上跑大模型聊天、AI 画图、语音转文字、拍照识物,全部本地运行,一个字节都不传到云端。

好家伙,这才是手机 AI 该有的样子。

Off Grid 是什么?

说白了,Off Grid 就是一把”离线 AI 瑞士军刀”。

开发者 Ali Chherawalla 做这个项目的初衷很简单——他说自己每次往 ChatGPT 里敲私人内容时,都会犹豫一下:“这些数据真的安全吗?”

于是他用 React Native 搭了个框架,把 llama.cpp(跑大模型的)、Stable Diffusion(画图的)、Whisper(语音识别的)全塞进了一个手机 App 里。

项目在 Hacker News 上发布当天直接冲上#1,Reddit 累计 15 万+浏览,GitHub 星标 4 周内突破 1000+。Ali 自己写文章回忆说,他凌晨 6 点发的帖子,8 点半醒来发现已经 150+ 星标,评论区全是技术问题和鼓励——还有人帮忙回答他自己都没来得及写清楚的安装细节。HN 上线当天就有三星用户反馈键盘遮挡聊天输入框的 bug,Ali 当天就修复推送了新版。

更硬核的是,GitHub 显示这个项目 1012 个 commit 几乎全是 Ali 一个人撸的——真一人军团。MIT 开源协议,完全免费,Play Store 和 App Store 都能下载。目前还在活跃开发中(最新版 v0.0.81,3 月 15 日刚更新),几乎每周都有新功能上线。

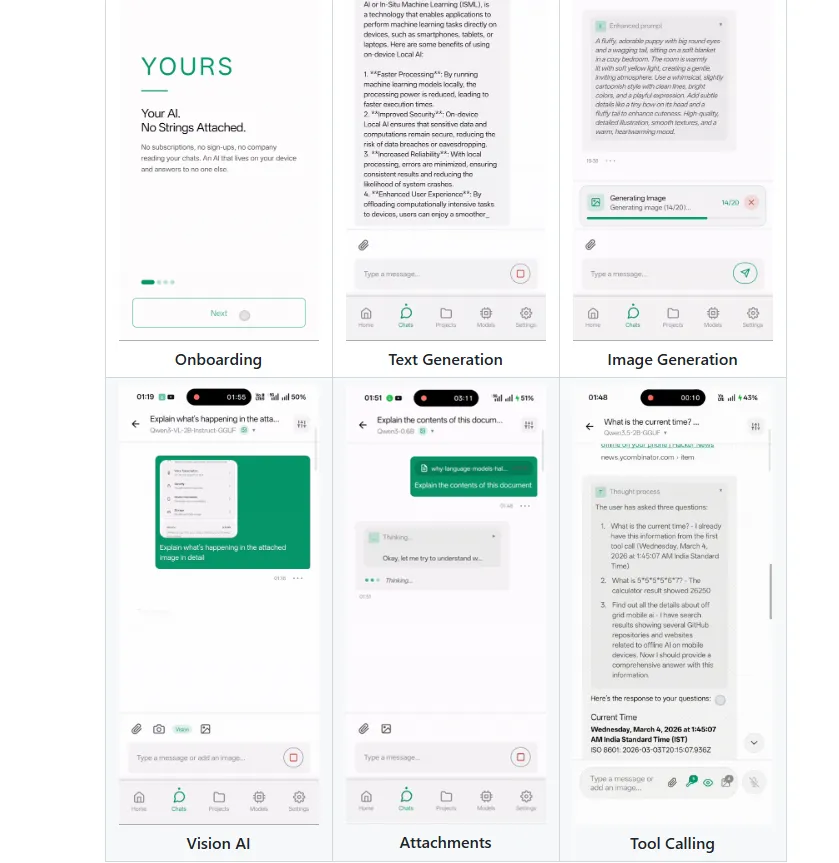

六大功能,全部离线可用

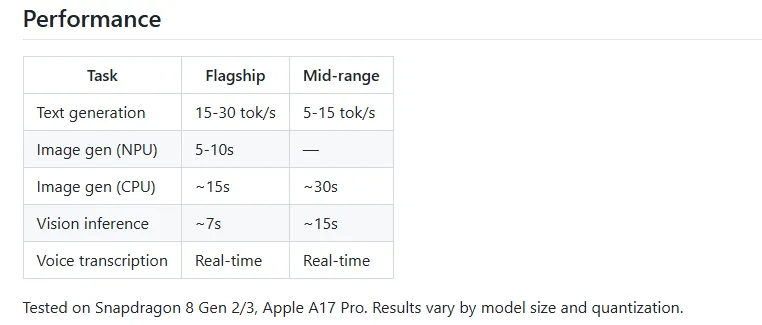

根据开发者 Ali 在 dev.to 发布的多篇性能测试文章,以及 GitHub README 的官方 benchmark 数据,Off Grid 目前有六个核心能力。下面逐个拆解:

1. AI 聊天——旗舰机 15-30 tok/s

底层用的是 llama.cpp,支持 Qwen 3、Llama 3.2、Gemma 3、Phi-4,以及任何 GGUF 格式的模型(最新版还加入了 Qwen 3.5 支持)。

根据开发者公布的性能数据,不同手机的表现差异不小:

|

|

|

|

|

|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

数据来源:dev.to/@alichherawalla 系列文章,Q4_K_M 量化格式

说白了,15-30 tok/s 的速度大概跟你阅读速度差不多。不能秒杀 GPT-5,但日常聊天、整理思路、写大纲完全够用。开发者自己说,”这个级别的模型质量已经接近早期 ChatGPT 了”。

划重点:你可以自己导入 .gguf 模型文件,不被官方模型库限制。App 的模型浏览器还会根据你手机的硬件自动筛选兼容模型,不会让你下载一个跑不动的东西。

2. AI 画图——NPU 加速最快 5 秒出图

用的是 Stable Diffusion,512×512 分辨率,20 步去噪。根据开发者测试数据:

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

数据来源:dev.to/@alichherawalla “How to Generate AI Images Locally on Your Android Phone”

自带 20 多个模型,包括 Absolute Reality(写实)、DreamShaper(艺术)、Anything V5(动漫)等。Google Play 最新更新还加入了 GPU 加速画图,官方说速度提升最高 2 倍。

iOS 端通过 Core ML 直接调用 Apple Neural Engine,A17 Pro 芯片每秒能处理 35 万亿次运算——画图体验也很流畅。

说实话,画质比不上 Midjourney,但——你在飞机上能用 Midjourney 吗?

还有个巧思:Off Grid 的文本模型可以自动帮你”优化提示词”。你写个简单的中文描述,它自动翻译成详细的 Stable Diffusion 英文提示词,出图质量直接上一个台阶。

开发者在文章里还提了个细节:连续出多张图手机会发热,建议每次间隔 30 秒让手机散热,性能会更稳定。

3. 语音转文字——Whisper 本地跑

长按录音,松手就出文字。用的是 OpenAI 的 Whisper 模型,但完全在本地跑。

根据 GitHub README,语音转录在旗舰和中端机上都能做到实时(Real-time)。支持边说边转——你还在说话的时候就开始出字了。

应用场景:会议速记、灵感记录、给 AI 发语音指令。而且因为完全离线,你的语音录音不会被任何第三方听到——这对于在医院或涉密环境使用 AI 的人来说,是硬刚需。

4. 拍照识别——旗舰机约 7 秒出结果

用的是 SmolVLM、Qwen3-VL、Gemma 3n 等视觉模型,对着东西拍一张,问它”这是什么””怎么用””什么牌子”。

根据 README 的 benchmark:旗舰机约 7 秒,中端机约 15 秒。可以分析文档、描述场景、读取收据。

还有两个”隐藏功能”值得一提:

本地知识库:你可以把 PDF、代码文件、CSV 上传到项目里,Off Grid 会用内置的 MiniLM 模型在本地做向量化,然后用余弦相似度检索——说人话就是,你可以拿自己的文档喂给 AI 问答,数据全存在手机的 SQLite 里,不上传任何地方。

文档分析:直接把 PDF 或代码文件拖到对话里,AI 当场读取分析。两个平台都支持原生 PDF 文字提取。

这两个功能在 GitHub README 里有详细说明,对于需要处理工作文档但不想上传云端的用户来说非常实用。

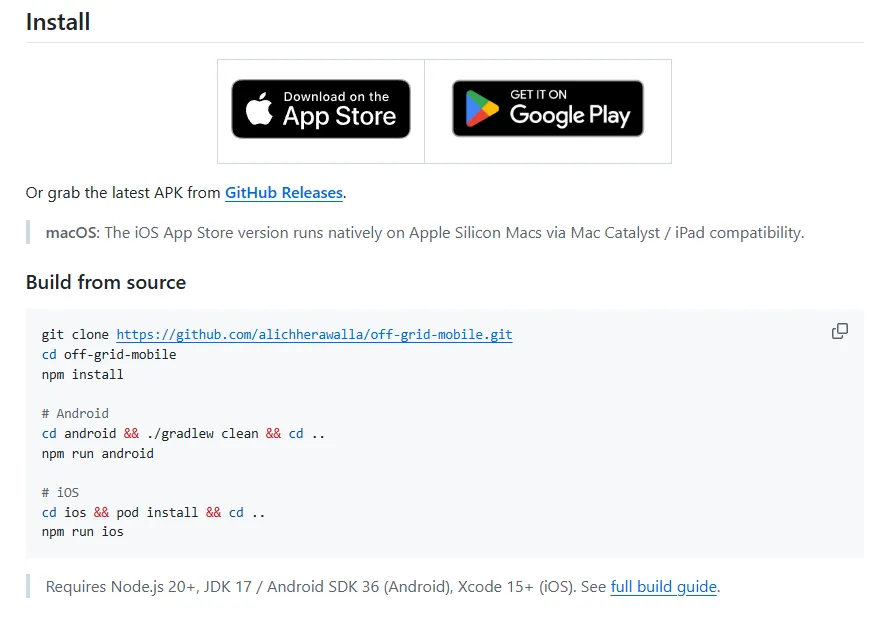

3 步上手教程

别被”开源”两个字吓到,Off Grid 的安装比你想象的简单:

第 1 步:下载 App

安卓用户:直接去 Google Play 搜 “Off Grid”,或者去 GitHub Releases 下 APK

苹果用户:App Store 搜 “Off Grid Local AI”

GitHub 地址:github.com/alichherawalla/off-grid-mobile-ai

第 2 步:下载模型

打开 App,进入模型管理页面。推荐新手先下这几个:

|

|

|

|

|

|---|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

第一次下载需要联网,下完之后就再也不需要网了。建议在 WiFi 环境下载。

第 3 步:开聊

选好模型,直接打字或者语音输入就行。没有注册、没有登录、没有订阅——打开就用。

(没错,就这么简单。我当时也以为会有第 4 步,结果没有。)

你的手机能跑吗?

这是大家最关心的问题。说实话,Off Grid 的门槛比你想的低:

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

简单说:如果你的手机是近两年的中高端机型,基本都能跑。

iPhone 用户注意:iOS 版通过 Core ML 和 ANE(Apple Neural Engine)加速,在 A17 Pro 以上的芯片上体验非常流畅。

隐藏技能:连接你的本地 AI 服务器

这个功能很多人不知道——Off Grid 支持连接任何 OpenAI 兼容的本地服务器。

什么意思?如果你家里有台电脑跑着 Ollama 或者 LM Studio,Off Grid 可以通过局域网连过去,用电脑的算力,手机当遥控器。

这样你就能在手机上跑 70B 甚至更大的模型了。

设置方法:进入 App 的”远程服务器”设置 → 输入你电脑的局域网 IP + 端口 → 自动发现可用模型 → 开聊。

API Key 存在系统安全钥匙链里,不会明文泄露。支持 SSE 流式传输,响应速度跟电脑端几乎一样。

和云端 AI 比,差距大吗?

老实说,有差距,但没你想的那么大。

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Off Grid 不是要取代 ChatGPT,而是解决 ChatGPT 解决不了的场景:

-

飞机上想整理思路

-

地铁里信号差想快速翻译

-

不想把公司机密文档发给第三方

-

在审查严格的网络环境下使用 AI

-

纯粹不想每月花 $20

一些使用小贴士

用了几天之后的经验分享:

-

先下小模型试水,别上来就下 7B 的大家伙。Phi-4 Mini 约 2.5GB,跑起来飞快,先感受一下

-

中文场景优先选 Qwen 3.5 系列,Llama 的中文能力明显弱一档

-

画图前让 AI 帮你优化提示词,出图效果提升巨大

-

省电模式下性能会降,想要最佳体验记得关掉省电

-

模型文件挺大的,建议手机至少留 10GB 空闲存储空间

写在最后

Off Grid 的开发者说过一句话,我觉得特别到位:

“你口袋里的手机,应该是你最私密的电脑——而不是最被监控的那台。”

2026 年,AI 模型越来越小、越来越快,手机芯片越来越强。本地跑 AI 不再是极客的玩具,而是普通人的刚需。

Off Grid 可能不完美,但它证明了一件事:你不需要把灵魂交给云端,也能享受 AI 的便利。

试试看吧,下次坐飞机的时候,你会感谢自己提前下载了它。

有问题直接评论区问,看到都会回。

夜雨聆风

夜雨聆风