前端工程化:如何为 CLI 工具构建 E2E 测试体系

你是否遇到过这样的场景:辛苦开发的 CLI 工具,发布到 npm 后被用户反馈各种问题,而这些问题在开发时根本没测到?或者每次发版都要手工跑一遍所有命令,耗时费力还容易遗漏?

这不是个例,CLI 工具本身的特点决定了它的测试难度远高于普通应用,具体来说:

-

手工测试效率低:每次发版都要手动跑一遍所有命令,不同模板 × 不同命令 × 不同参数,场景组合爆炸,完整测试一轮可能需要半小时以上,且容易遗漏边界情况。 -

CLI 工具特别脆弱:发布到 npm 后用户立即可用,无法像 Web 应用一样热修复或灰度发布。一个 bug 可能影响所有依赖该 CLI 的项目,而用户环境千差万别,问题难以复现。 -

资源有限但质量要求高:小团队或个人项目没有专职测试,但作为基础工具,稳定性要求极高。需要快速迭代,又不能降低质量。 -

技术门槛高,测试难度大:CLI 程序不像 GUI 应用点点点就能测,需要理解命令行参数、环境变量、文件系统操作等技术细节。技术背景不深的测试人员很难发现问题或观测到异常,导致研发同学不得不自己承担测试责任,进一步加重负担。

但,好消息是,CLI 工具的弱交互、弱 UI 特点,反而让它非常适合 E2E 测试。自动化测试不仅是唯一出路,而且投入产出比极高。本文将从实践出发,分享如何为 CLI 工具搭建完整的 E2E 测试体系。

一、是什么:CLI E2E 测试的本质

CLI E2E 测试本质上是模拟用户真实使用场景,验证从安装到执行的完整流程。相比 Web E2E,它有这些关键区别:

|

|

|

|

|---|---|---|

| UI 复杂度 |

|

|

| 交互方式 |

|

|

| 测试稳定性 |

|

|

| 维护成本 |

|

|

| 测试速度 |

|

|

从对比可以看出,CLI E2E 测试相比 Web E2E 反而更简单、更稳定。这正好解决了开头提到的痛点:手工测试效率低?自动化测试速度快、稳定性高,一次编写反复运行。资源有限但质量要求高?维护成本低,投入产出比极高。CLI 工具脆弱、发布即锁死?E2E 测试可以在发布前发现所有关键问题。CLI 的弱交互、弱 UI 特点,反而让它特别适合做 E2E 测试。

所以如果你正在开发 CLI 工具,强烈建议从项目初期就搭建 E2E 测试体系。这件事儿并不难,只需要记住三个核心原则:

-

真实环境模拟:不使用 npm link,而是通过npm pack生成 tarball,完整模拟用户从 npm 安装的流程,能发现打包配置问题(files 字段、.npmignore 等) -

完整流程验证:从安装 → 初始化 → 开发 → 构建 → 部署,每个环节都验证,确保全链路可用 -

独立测试环境:每个测试在独立临时目录中运行,避免全局污染和测试相互影响,测试结束后自动清理

二、怎么做:完整方案

理解了 CLI E2E 测试的本质后,接下来看看如何具体实施。

2.1 核心流程设计

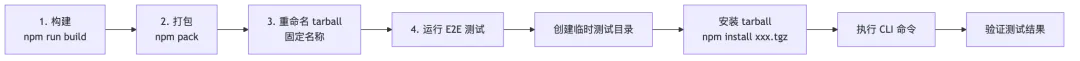

CLI E2E 测试的核心流程可以概括为:构建 → 打包 → 安装 → 执行 → 验证。

完整的测试流程可以用一个 shell 脚本串联:

#!/bin/bashset -e # 遇到错误立即退出# 1. 构建项目echo"📦 Building project..."npm run build# 2. 打包成 tarballecho"📦 Packing tarball..."npm pack# 3. 重命名为固定名称(方便测试引用)echo"📝 Renaming tarball..."mv *.tgz my-cli.tgz# 4. 运行 E2E 测试echo"🧪 Running E2E tests..."vitest run tests/e2eecho"✅ All tests passed!"这里需要提一下,为什么用 tarball 而不是 npm link? 两者功能都能达成相似效果,且 npm link 确实更快更方便,但它只是创建符号链接,无法验证打包配置是否正确,对比来说:

|

|

|

|

|

|---|---|---|---|

| npm link |

|

|

|

| npm pack |

|

|

|

因此,使用 npm pack 更容易发现真实问题,例如:

-

package.json的files字段配置错误(遗漏必要文件) -

.npmignore配置错误(打包了不该打包的文件) -

main/bin/exports字段路径错误 -

依赖声明问题(devDependencies vs dependencies)

在实际测试中,我们需要特别注意几个点。首先,使用 tarball 能完全模拟用户安装流程,这是核心原则。其次,每个测试都应该在独立的临时目录中运行,避免相互影响。为了方便测试脚本引用,建议把生成的 tarball 重命名为固定的文件名。最后,测试结束后要自动清理环境,保持系统干净。

打包出 tarball 后,后续的逻辑就很清晰了:在测试用例里执行 npm install xxx.tgz,这样就能在不同的目录环境中安装这个打包后的副本,然后执行完整的校验逻辑。如此一来,我们测试的就是用户从 npm 安装的那个版本,而不是开发环境中的源码,真正实现了针对 npm 发布形态的 E2E 测试。

2.2 测试用例设计框架

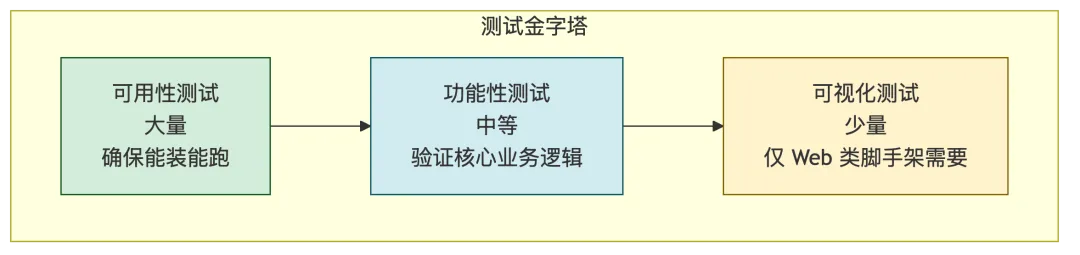

明确了测试流程后,下一个问题是:如何设计测试用例?这里推荐遵循”金字塔”原则:基础层测试要多,功能层测试适中。

2.2.1 可用性测试(基础层)

这是最基础也是最重要的测试层,确保 CLI 工具能被正确安装和调用。如果这层测试失败,后续的功能测试都没有意义。核心测试点:

// 1. npm install 能否成功✓ 从 tarball 安装不报错✓ pnpm install 不报错// 2. 基础命令能否调用✓ cli --version 能正常输出版本号✓ cli --help 能正常输出帮助信息✓ cli <command> 能正确找到命令// 3. bin 字段配置正确性✓ package.json 中 bin 字段路径正确✓ bin 文件有执行权限(#!/usr/bin/env node)示例测试代码:

import { describe, test, expect, beforeEach, afterEach } from"vitest";import { execa } from"execa";import { mkdtemp, rm } from"fs/promises";import { tmpdir } from"os";import { join } from"path";describe("可用性测试", () => {let testDir: string;const cliTarball = join(__dirname, "../my-cli.tgz"); beforeEach(async () => {// 创建临时测试目录 testDir = await mkdtemp(join(tmpdir(), "cli-test-")); process.chdir(testDir); }); afterEach(async () => {// 清理测试目录await rm(testDir, { recursive: true, force: true }); }); test("从 tarball 安装成功", async () => {const { exitCode } = await execa("npm", ["install", cliTarball]); expect(exitCode).toBe(0); }); test("版本命令可用", async () => {await execa("npm", ["install", cliTarball]);const { stdout } = await execa("npx", ["my-cli", "--version"]); expect(stdout).toMatch(/\d+\.\d+\.\d+/); }); test("帮助命令可用", async () => {await execa("npm", ["install", cliTarball]);const { stdout } = await execa("npx", ["my-cli", "--help"]); expect(stdout).toContain("Usage:"); });});这里有几个值得注意的地方:使用 beforeEach 和 afterEach 确保每个测试都在独立的临时目录中运行,测试之间完全隔离。验证时关注输出格式而不是具体内容(比如版本号用正则匹配,而不是硬编码具体值)。另外,推荐使用 execa 而不是 child_process,它的 API 更友好,错误处理也更完善。

2.2.2 功能性测试(功能层)

在确保基础可用性后,接下来验证 CLI 的核心功能是否按预期工作。这一层测试关注命令的实际执行效果,主要包括以下几个方面:

|

|

|

|

|---|---|---|

| 命令执行与输出 |

|

|

| 副作用验证 |

|

|

| 参数与配置 |

|

|

| 错误与边界 |

|

|

举例来说:

import { describe, test, expect, beforeEach } from"vitest";import { execa } from"execa";import { readFile, access } from"fs/promises";import { join } from"path";describe("功能性测试", () => { beforeEach(async () => {// 安装 CLIawait execa("npm", ["install", cliTarball]); }); test("命令执行成功并产生正确副作用", async () => {// 执行命令const { stdout, exitCode } = await execa("npx", ["my-cli","generate","component","Button", ]);// 验证执行成功 expect(exitCode).toBe(0); expect(stdout).toContain("✓ Component created");// 验证副作用:文件生成const filePath = join(testDir, "src/components/Button.tsx");await expect(access(filePath)).resolves.toBeUndefined();// 验证副作用:文件内容const content = await readFile(filePath, "utf-8"); expect(content).toContain("export function Button"); }); test("参数处理:缺少必需参数时友好报错", async () => {const { stderr, exitCode } = await execa("npx", ["my-cli", "generate"], { reject: false, }); expect(exitCode).not.toBe(0); expect(stderr).toMatch(/Error.*Missing required argument/i); }); test("错误处理:文件已存在时提示冲突", async () => {// 第一次创建成功await execa("npx", ["my-cli", "generate", "component", "Button"]);// 第二次应该报错const { stderr, exitCode } = await execa("npx", ["my-cli", "generate", "component", "Button"], { reject: false }, ); expect(exitCode).not.toBe(0); expect(stderr).toMatch(/already exists/i); });});这个测试用例演示了功能性测试的三个典型场景。首先,每个测试开始前都会在 beforeEach 中使用 execa 安装本地 tarball 文件,确保测试环境中有可用的 CLI 工具。然后,第一个测试验证正常执行流程:命令是否成功(exit code = 0)、输出信息是否正确、副作用是否符合预期(文件生成且内容正确)。第二个测试关注参数处理,故意不传必需参数,验证工具是否能给出友好的错误提示。第三个测试模拟边界情况,连续两次创建同名组件,验证工具能否正确识别并提示冲突。

这是一个非常基础的测试示例,覆盖了命令执行、输出验证、参数处理等核心场景。在实际开发中,你需要根据具体功能设计补充更多测试用例,比如验证文件系统操作、数据库变更、网络请求等各类副作用,以及各种错误场景和边界情况的处理。功能测试的深度和广度,取决于你的 CLI 工具的复杂度和业务需求。

2.3 技术选型

聊了测试的核心流程与测试用例设计之后,接下来可以讨论下测试框架的选型。虽然市面上测试工具很多,但 CLI E2E 测试有其特殊性,我们需要的核心工具包括:

|

|

|

|

|---|---|---|

| npm pack |

|

|

| Vitest |

|

|

| execa |

|

|

| fs/promises |

|

|

Vitest 是我推荐的首选框架。它启动速度快,对 ESM 模块有原生支持,这对现代前端项目非常重要。API 设计上与 Jest 完全兼容,如果你之前用过 Jest,几乎零学习成本。内置了 TypeScript 支持和覆盖率报告,开箱即用,省去了大量配置工作。Jest 作为备选也不错,生态成熟、文档丰富,但配置相对复杂,而且对 ESM 的支持一直不够理想。

其次,相比 Node.js 内置的 child_process,execa 提供了更友好的 Promise API,支持 async/await,错误处理也更完善。它会自动处理 stdout/stderr 的缓冲,避免了很多底层的坑。在测试场景中,我们需要频繁执行命令并检查输出,execa 能让代码简洁很多。

三、实战案例:Coze Init CLI

理论讲完了,来看看一个真实项目是如何实践的。

前段时间,组内开发了 Coze Init CLI 包,这是一个用于 Coze Coding Sandbox 环境的项目脚手架工具。作为脚手架,它的每次发布都直接影响用户的开发体验。但团队没有专职测试,每次发版前只能手工跑一遍各个模板,耗时耗力还容易漏测。为了解决这个问题,我们搭建了完整的 E2E 测试体系,所有测试用例都在 CI/CD 中自动运行,发布前必须全部通过才能合并。

3.1 测试方案

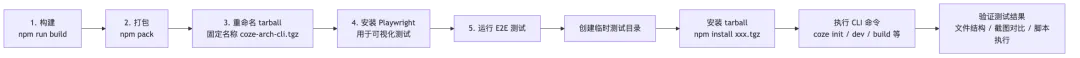

Coze Init CLI 采用了完整的 E2E 测试方案,从构建到验证的全流程自动化。

Coze Init CLI 的测试设计遵循了几个关键原则。首先,通过 npm install tarball 来模拟用户实际安装流程,确保真实环境下的可用性。其次,每个测试都在独立的临时目录中运行,彻底避免测试之间的相互影响。最后,测试覆盖了从安装、初始化、开发、构建到部署的全链路验证,确保整个工作流程的完整性。

3.2 测试用例设计

针对脚手架工具的特点,Coze Init CLI 设计了以下测试用例。

可用性测试:

// 1. 基础命令能否调用test("coze --version", async () => {const { stdout } = await exec("coze --version"); expect(stdout).toMatch(/\d+\.\d+\.\d+/);});// 2. 模板 hooks 是否生效test("模板 hooks 正常执行", async () => {await exec("coze init ./ -t nextjs");// 验证 ejs 模板渲染const content = fs.readFileSync("./package.json", "utf-8"); expect(content).not.toContain("{{"); // 无未替换的占位符});// 3. scripts 能否正常运行test("npm run build 成功", async () => {await exec("coze init ./ -t nextjs");await exec("npm install");await exec("npm run build"); // 不抛错即成功});// 4. 必要文件检查test("必要文件存在", async () => {await exec("coze init ./ -t nextjs");const requiredFiles = [".gitignore",".npmrc","package.json","pnpm-lock.yaml","README.md","tsconfig.json", ]; requiredFiles.forEach((file) => { expect(fs.existsSync(file)).toBe(true); });});3.3 特殊场景:可视化测试

对于脚手架类 CLI 工具,除了验证命令本身,还需要确认生成的 Web 项目能否正常运行。比如 vite、nextjs、nuxtjs 这些模板,仅仅测试文件是否生成是不够的,还要验证页面能否正常渲染、依赖是否正确配置、构建流程能否跑通。这就需要用到 Playwright 这样的可视化测试工具,实际启动项目、访问页面、截图对比。测试流程大致如下:

test("dev 模式页面正常", async () => {// 1. 初始化项目await exec("coze init ./my-app -t nextjs");// 2. 安装依赖await exec("cd my-app && npm install");// 3. 启动 dev serverconst devProcess = exec("npm run dev");await waitForPort(3000);// 4. 使用 Playwright 访问页面const browser = await chromium.launch();const page = await browser.newPage();await page.goto("http://localhost:3000");// 5. 截图对比const screenshot = await page.screenshot(); expect(screenshot).toMatchImageSnapshot();// 6. 清理 devProcess.kill();await browser.close();});test("build + start 模式页面正常", async () => {// 1. 初始化项目await exec("coze init ./my-app -t nextjs");// 2. 安装依赖await exec("cd my-app && npm install");// 3. 构建await exec("npm run build");// 4. 启动生产服务器const startProcess = exec("npm run start");await waitForPort(3000);// 5. 验证页面const browser = await chromium.launch();const page = await browser.newPage();await page.goto("http://localhost:3000");const screenshot = await page.screenshot(); expect(screenshot).toMatchImageSnapshot();// 6. 清理 startProcess.kill();await browser.close();});可视化测试通常使用 Playwright 进行跨浏览器测试和截图对比,配合 toMatchImageSnapshot 进行图片对比断言。

需要特别说明的是,可视化测试仅适用于有 Web 页面的脚手架项目,不是所有 CLI 工具都需要。另外,截图对比可能因环境差异(字体、分辨率)产生误差,建议在 CI 环境中使用固定的 Docker 镜像保证一致性。

四、总结

最后,我们再来总结一下 CLI E2E 测试的关键知识点:

-

核心原则:使用 npm pack生成 tarball,完整模拟用户从 npm 安装的流程,而不是用npm link,这样能发现打包配置问题 -

测试分层:可用性测试(基础,确保能装能跑)→ 功能测试(核心业务逻辑)→ 可视化测试(可选,仅 Web 类脚手架需要) -

测试隔离:每个测试在独立的临时目录中运行,使用 beforeEach/afterEach确保测试之间完全隔离 -

工具选型:Vitest(测试框架)+ execa(进程执行)+ Playwright(可视化测试,可选) -

投入产出比:CLI 的弱交互、弱 UI 特点让它特别适合 E2E 测试,10% 的测试用例能覆盖 90% 的核心场景 -

质量防线:CLI 工具发布到 npm 后无法热修复,E2E 测试是发布前的最后一道防线

如果你正在开发 CLI 工具,建议从项目初期就搭建 E2E 测试体系,从可用性测试开始,逐步完善。接入 CI/CD 后,每次提交都自动运行测试,确保质量。记住,E2E 测试不是负担,而是效率工具,10 分钟搭建测试能节省无数次手工验证。

附录:参考资料

-

npm pack 文档 – npm 打包命令 -

Vitest 文档 – 现代化测试框架 -

Playwright 文档 – 浏览器自动化测试 -

execa 文档 – 进程执行工具 -

The Practical Test Pyramid – 测试金字塔理论

关于作者

Tecvan(范文杰),前端基建负责人,专注于工程化、工具链、AI + 编程领域。

-

个人博客:https://tecvan.fun -

GitHub:@tecvan-fe

如果你觉得这篇文章有帮助,欢迎关注我的公众号获取更多前端工程化实践经验。

夜雨聆风

夜雨聆风