【gRPC】服务端调用源码解析

引言

你是否曾经遇到过这样的场景:gRPC 服务性能突然下降,却找不到瓶颈在哪里?或者拦截器链执行顺序混乱,导致权限校验失效?又或者在高并发场景下,服务端线程池频繁拒绝请求?

这些问题的根源,往往藏在你从未深入探究的 gRPC 服务端调用源码中。

作为一名深耕分布式系统多年的开发者,我深知理解底层机制是解决复杂问题的第一性原理。今天,我们将一起深入 gRPC-Java 服务端的核心腹地,从 Netty 启动到请求路由,从拦截器链到异常处理,层层剖析每一个关键环节。

读完这篇文章,你将获得:

-

一张完整的 gRPC 服务端调用全景图 -

8-10 个核心流程的可视化解析 -

5 个可直接落地的性能优化实践 -

一套排查 gRPC 服务端问题的方法论

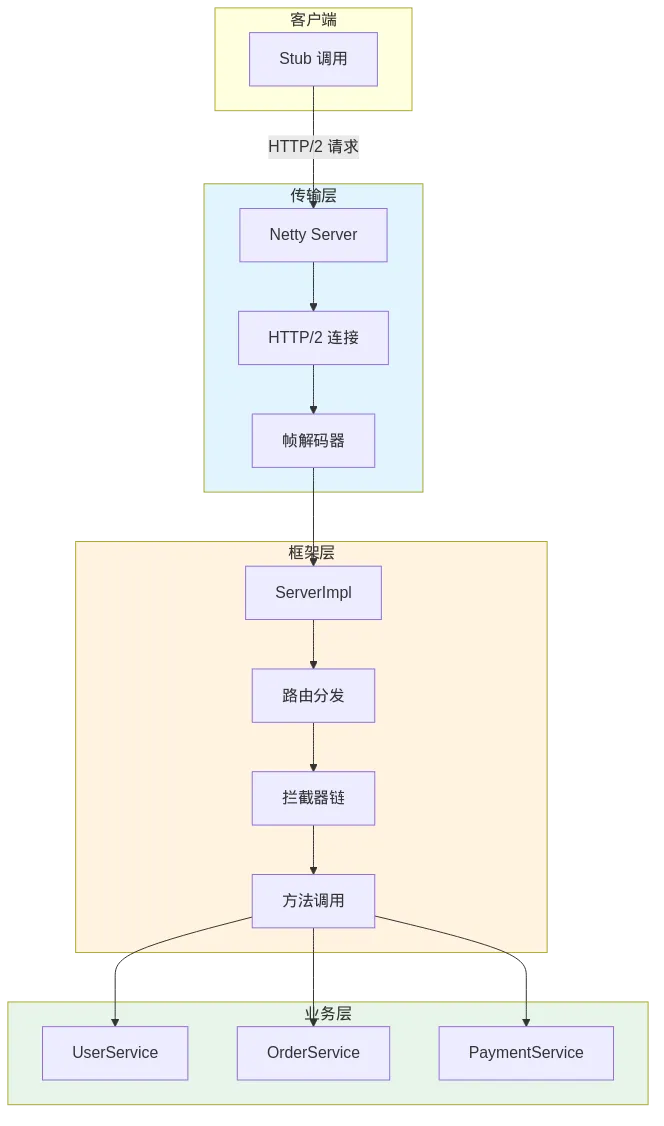

gRPC 服务端调用的三层架构

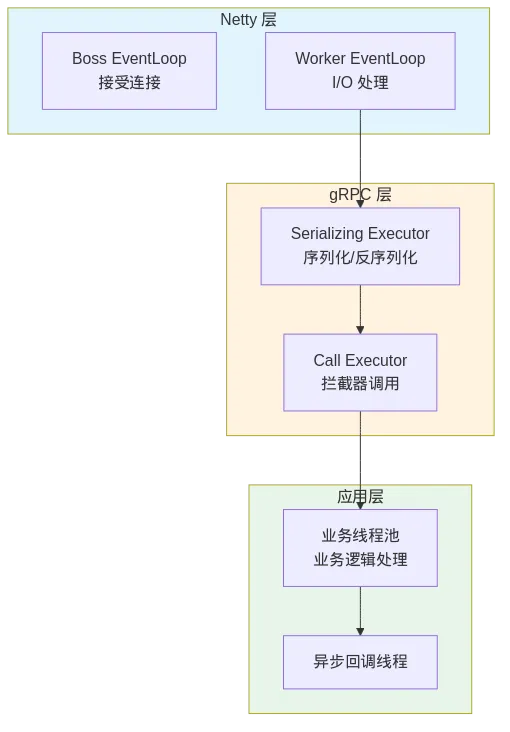

gRPC 服务端的本质是一个基于 Netty 的 HTTP/2 服务器,通过三层架构实现请求处理:传输层(Netty + HTTP/2)→ 框架层(gRPC Core)→ 业务层(用户 Service)。

这个三层架构的设计哲学是关注点分离:传输层专注于网络通信,框架层专注于协议处理,业务层专注于领域逻辑。理解这一点,是后续所有分析的基础。

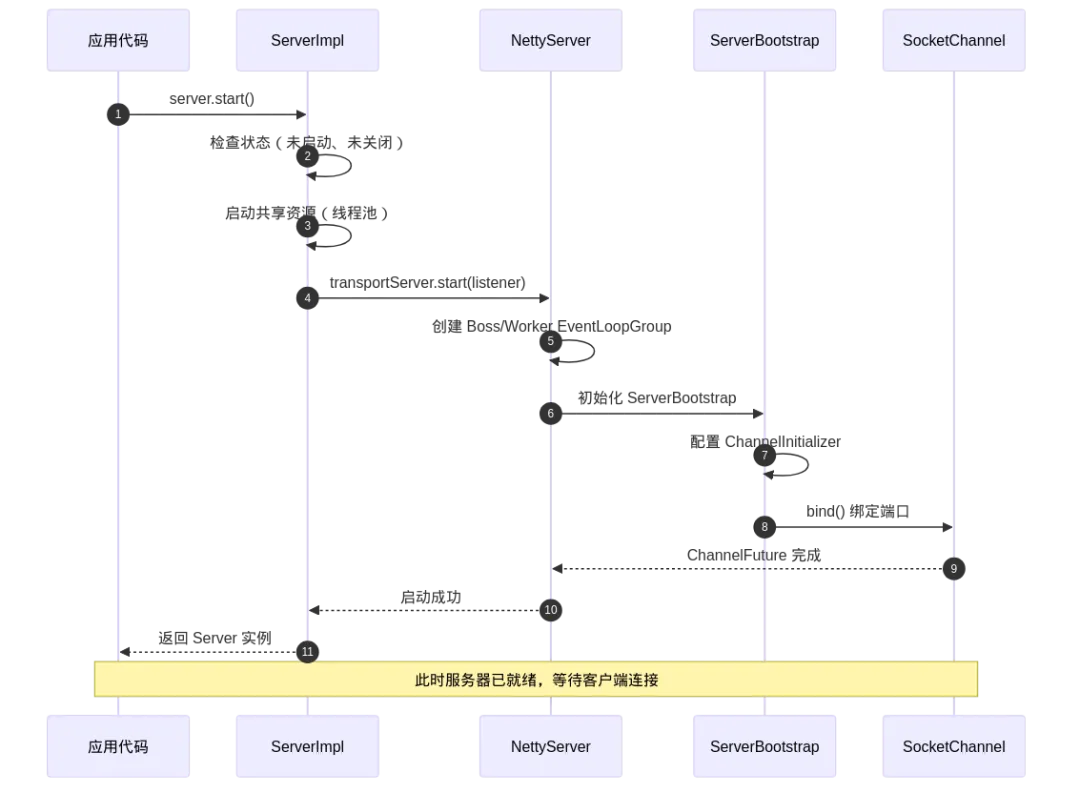

一、Netty 服务器启动流程

1.1 启动入口:ServerImpl.start()

gRPC 服务端的启动入口是 ServerImpl.start() 方法。这个方法的核心任务是初始化 Netty 服务器并绑定端口。

// io.grpc.internal.ServerImplpublicsynchronized Server start()throws IOException { checkState(!started, "Already started"); checkState(!shutdown, "Cannot start a shut down server");// 1. 启动内部组件(线程池、定时器) sharedResourceRegistry.start();// 2. 启动所有 TransportServer(NettyServer)for (InternalServer transportServer : transportServers) { transportServer.start(this); // this 是 ServerTransportListener } started = true;returnthis;}1.2 NettyServer 的初始化

transportServer.start(this) 最终会调用 NettyServer.start(),这是 Netty 服务器初始化的核心:

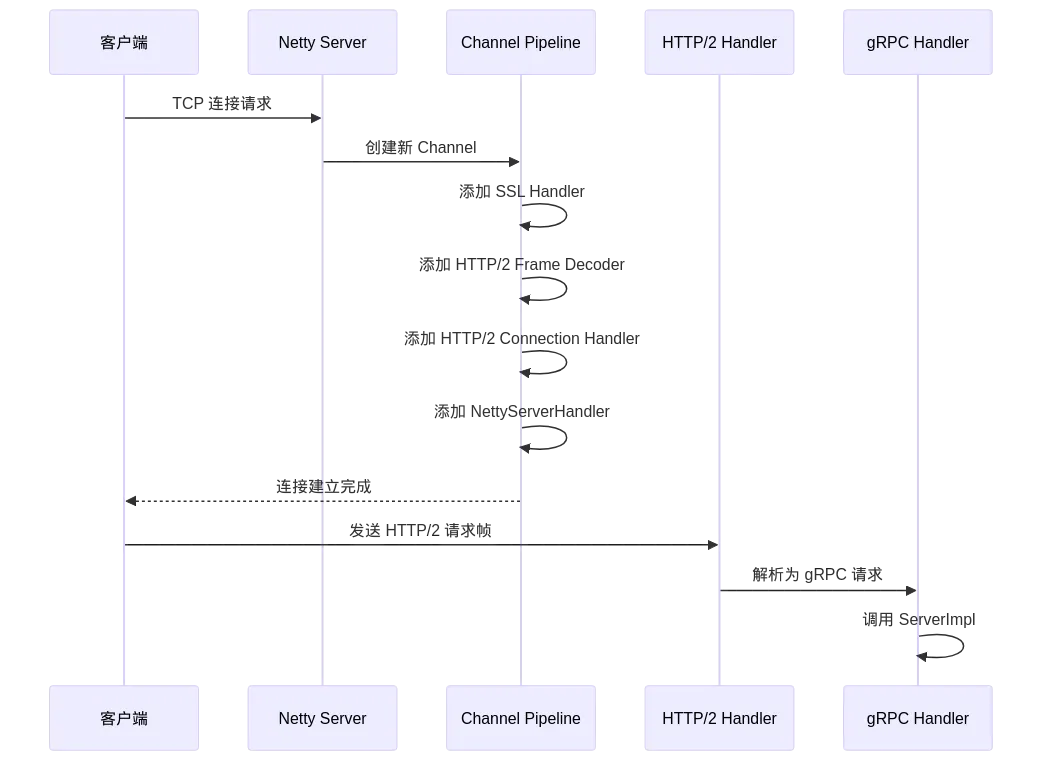

// io.grpc.netty.NettyServerpublicvoidstart(ServerListener listener)throws IOException {this.listener = checkNotNull(listener, "listener");// 创建 Boss Group 和 Worker Group bossGroup = Utils.createBossEventLoopGroup( bossEventLoopGroupSize, bossEventLoopGroup); workerGroup = Utils.createWorkerEventLoopGroup( workerEventLoopGroupSize, workerEventLoopGroup);// 初始化 ServerBootstrapServerBootstrapbootstrap=newServerBootstrap(); bootstrap.group(bossGroup, workerGroup) .channel(Utils.getServerSocketChannelClass()) .childHandler(newChannelInitializer<SocketChannel>() {@OverrideprotectedvoidinitChannel(SocketChannel ch) { configureChannel(ch); // 配置 Channel Pipeline } });// 绑定端口ChannelFuturefuture= bootstrap.bind(address); future.sync(); channel = future.channel();}1.3 Channel Pipeline 的配置

最关键的配置在 configureChannel() 方法中,这里构建了完整的 Netty Pipeline:

privatevoidconfigureChannel(SocketChannel ch) {ChannelPipelinepipeline= ch.pipeline();// 1. SSL/TLS 支持(如果启用)if (sslContext != null) { pipeline.addLast("ssl", sslContext.newHandler(ch.alloc())); }// 2. HTTP/2 帧解码器 pipeline.addLast("frameDecoder", newHttp2FrameDecoder());// 3. HTTP/2 连接预处理器 pipeline.addLast("connectionPreface", newHttp2ConnectionPrefaceAndSettingsFrameWrittenEvent());// 4. HTTP/2 帧编码器 pipeline.addLast("frameEncoder", newHttp2FrameEncoder());// 5. gRPC 核心处理器 pipeline.addLast("serverHandler", newNettyServerHandler( transportListener, executor, maxConcurrentStreams,// ... 其他参数 ));}1.4 启动流程时序图

关键洞察:Netty 的 Boss Group 只负责接受连接,Worker Group 负责处理所有 I/O 和请求。这种分离设计是 Netty 高并发能力的核心。

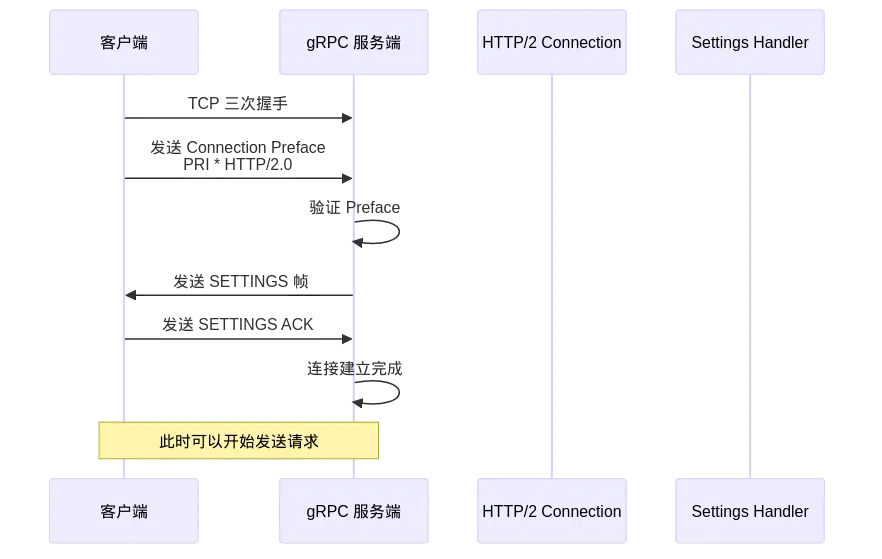

二、HTTP/2 连接建立

2.1 连接建立的四步握手

HTTP/2 连接的建立比 HTTP/1.1 复杂得多,需要完成四个关键步骤:

2.2 Connection Preface 验证

HTTP/2 要求客户端在连接建立后发送一个特殊的 Connection Preface:

PRI * HTTP/2.0\r\n\r\nSM\r\n\r\ngRPC 服务端在 NettyServerHandler 中验证这个 Preface:

// io.grpc.netty.NettyServerHandler@OverrideprotectedvoidonConnectionPrefaceReceived(ChannelHandlerContext ctx) {// 验证 Connection Preface 是否正确if (!connectionPrefaceReceived) {thrownewAssertionError("Connection preface not received"); }// 发送服务端的 SETTINGS 帧Http2Settingssettings= buildSettings(); encoder().writeSettings(ctx, settings, ctx.newPromise());// 刷新发送 ctx.flush();}2.3 SETTINGS 帧协商

SETTINGS 帧用于协商连接参数,gRPC 服务端会配置以下关键参数:

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

private Http2Settings buildSettings() {Http2Settingssettings=newHttp2Settings(); settings.maxConcurrentStreams(maxConcurrentStreams); settings.initialWindowSize(initialWindowSize); settings.maxHeaderListSize(maxHeaderListSize); settings.maxFrameSize(maxFrameSize);return settings;}2.4 连接状态机

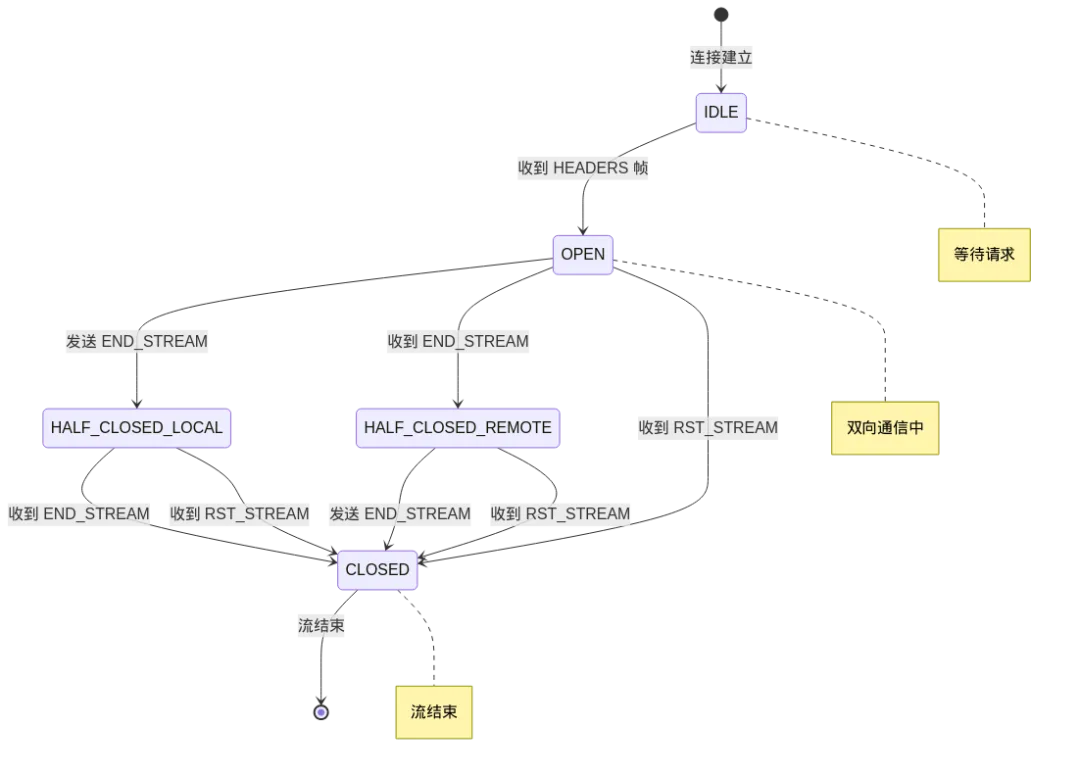

HTTP/2 连接维护一个复杂的状态机来管理流的生命周期:

三、请求解码与路由

三、请求解码与路由

3.1 HTTP/2 帧到 gRPC 请求的转换

当客户端发送请求时,数据以 HTTP/2 帧的形式到达服务端。NettyServerHandler 负责将这些帧转换为 gRPC 请求:

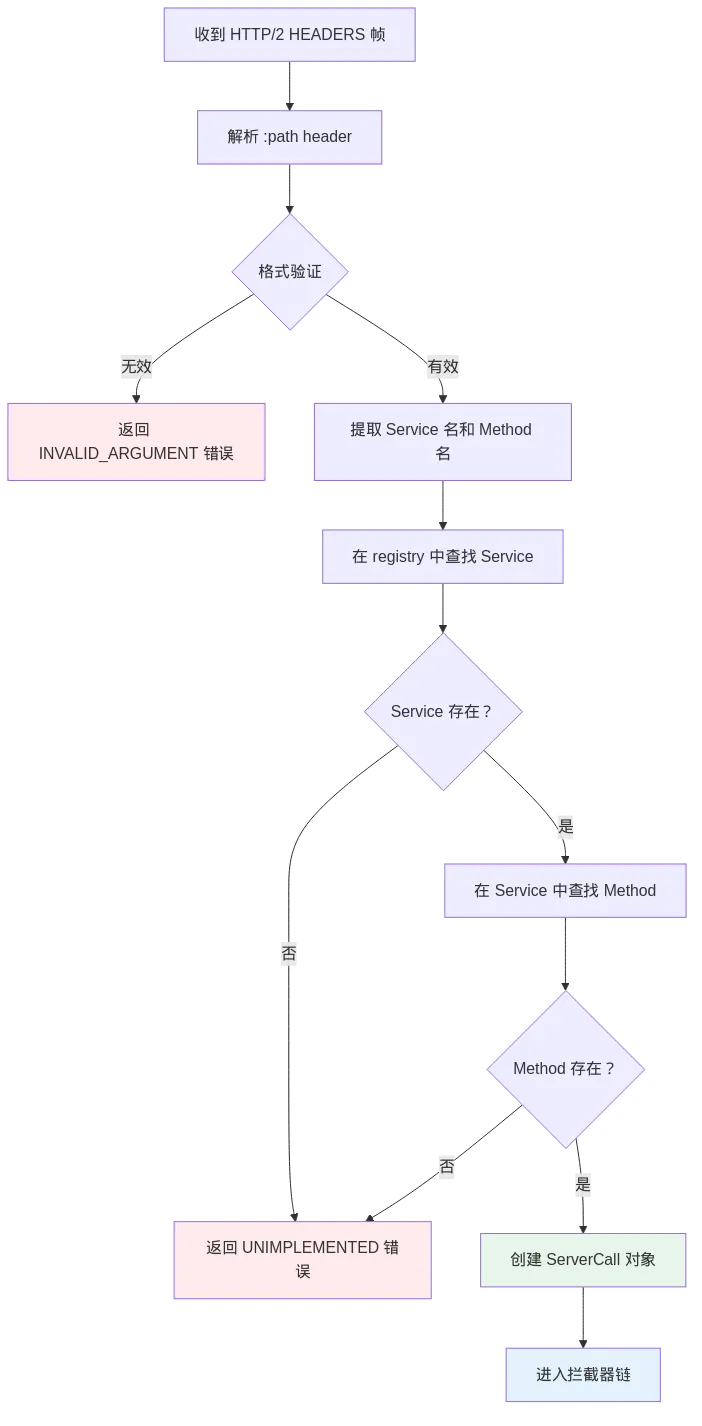

// io.grpc.netty.NettyServerHandler@OverrideprotectedvoidonHeadersRead(ChannelHandlerContext ctx, int streamId, Http2Headers headers, int streamDependency, short weight,boolean exclusive, int padding, boolean endStream) {// 1. 创建或获取 StreamNettyServerStreamstream= getOrCreateStream(streamId);// 2. 解析 HTTP/2 Headers 为 gRPC MetadataMetadatametadata= Utils.convertHeaders(headers);// 3. 提取方法名(从 :path header)StringfullMethodName= extractMethod(headers.path());// 4. 创建 ServerCallServerCallImplcall=newServerCallImpl( stream, fullMethodName, metadata,// ... );// 5. 触发 ServerImpl 处理 transportListener.streamCreated(stream, fullMethodName, metadata);}3.2 方法名解析与路由

gRPC 使用方法名来路由请求到对应的 Service 实现。方法名的格式是:/package.Service/Method

3.3 Service 注册与查找

gRPC 服务端在启动时会注册所有 Service,存储在 ServerImpl.ServiceRegistry 中:

// io.grpc.internal.ServerImplprivatefinal Map<String, ServiceMethod<?, ?>> methods = newHashMap<>();privatevoidaddService(ServerServiceDefinition service) {for (ServerMethodDefinition<?, ?> method : service.getMethods()) {StringfullMethodName= method.getMethodDescriptor().getFullMethodName(); methods.put(fullMethodName, newServiceMethod<>(service, method)); }}public ServiceMethod<?, ?> getMethod(String fullMethodName) {return methods.get(fullMethodName);}3.4 请求体解码

对于带有请求体的调用(如 unary 和 client streaming),gRPC 需要解码压缩的消息:

// io.grpc.internal.MessageDeframerpublicvoiddeliverMessage(int deliveredNumMessages, T message) {// 1. 读取压缩标志(1 字节)bytecompressed= readByte();// 2. 读取消息长度(4 字节,大端)intlength= readInt();// 3. 读取消息体byte[] payload = readBytes(length);// 4. 解压缩(如果需要)if (compressed == 1) { payload = decompressor.decompress(payload); }// 5. 反序列化为 Java 对象Tmessage= marshaller.parse(payload); listener.onMessage(message);}消息帧格式:

+------------------+------------------+------------------+| Compressed Flag | Message Length | Message Data || (1 byte) | (4 bytes) | (N bytes) |+------------------+------------------+------------------+四、业务方法调用

4.1 ServerCall 的核心作用

ServerCall 是 gRPC 服务端处理请求的核心抽象,它封装了:

-

请求元数据(Metadata) -

请求消息流 -

响应发送能力 -

调用状态管理

// io.grpc.internal.ServerCallImplpublicclassServerCallImpl<ReqT, RespT> extendsServerCall<ReqT, RespT> {privatefinal ServerStream stream;privatefinal MethodDescriptor<ReqT, RespT> method;privatefinal ServerCall.Listener<ReqT> listener;@Overridepublicvoidrequest(int numMessages) { stream.request(numMessages); // 请求更多消息 }@OverridepublicvoidsendHeaders(Metadata headers) { checkState(!headersSent, "Headers already sent"); stream.writeHeaders(headers); headersSent = true; }@OverridepublicvoidsendMessage(RespT message) { checkState(headersSent, "Headers not sent");// 序列化 + 压缩 + 发送byte[] payload = serializeAndCompress(message); stream.writeMessage(payload); }@Overridepublicvoidclose(Status status, Metadata trailers) { stream.close(status, trailers); }}4.2 四种调用类型的处理流程

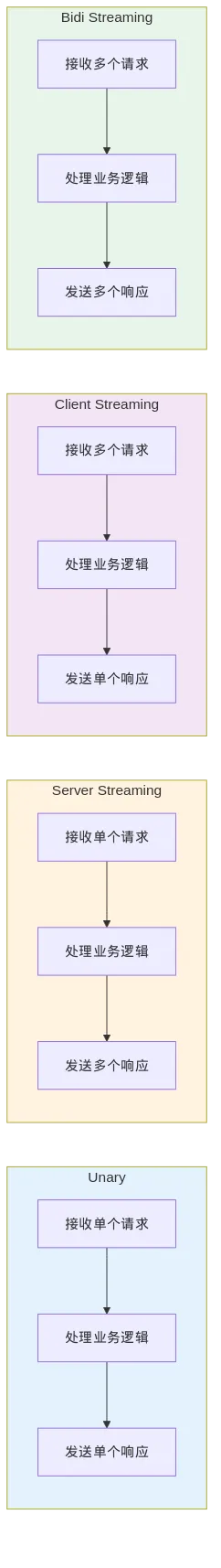

gRPC 支持四种调用类型,每种类型的处理流程略有不同:

4.3 流式调用的消息处理

对于流式调用,gRPC 使用 ServerCall.Listener 来接收消息:

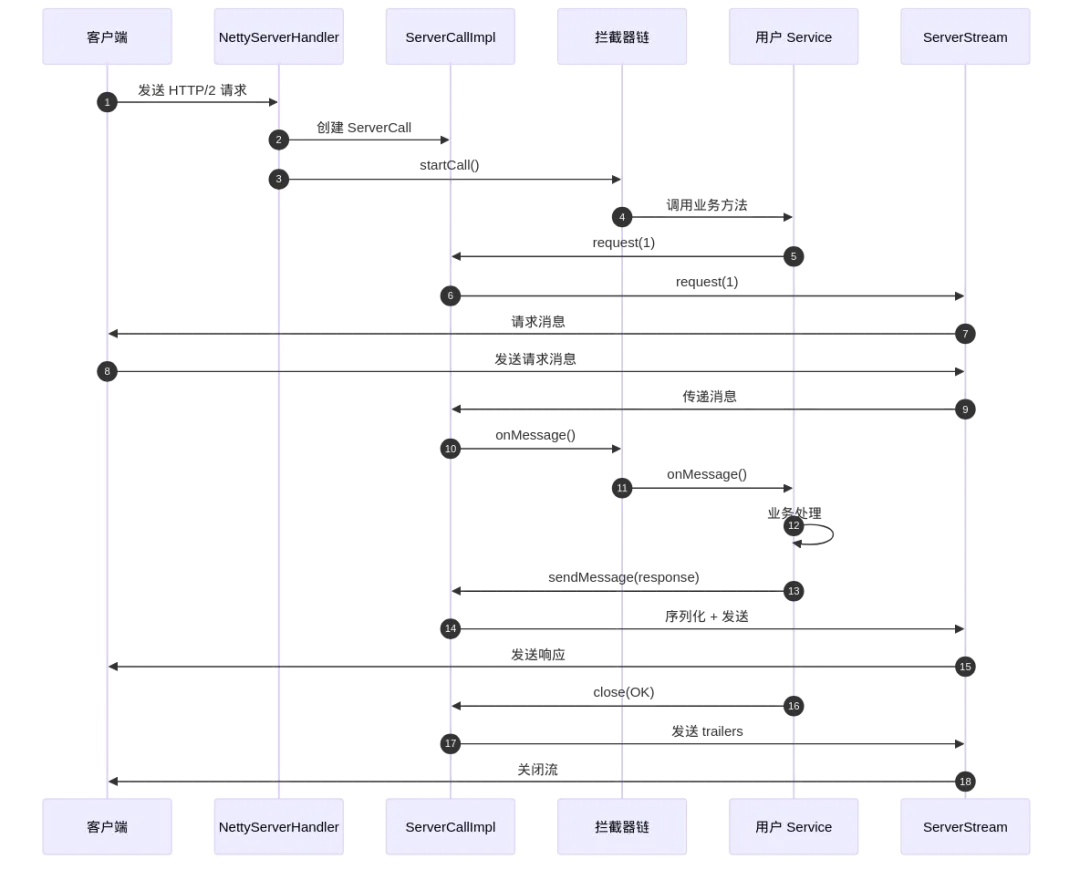

// 用户实现的 ListenerServerCall.Listener<Request> listener = newServerCall.Listener<Request>() {@OverridepublicvoidonMessage(Request message) {// 处理每个请求消息 processMessage(message);// 请求下一个消息(流量控制) call.request(1); }@OverridepublicvoidonHalfClose() {// 客户端发送完成 finishProcessing(); }@OverridepublicvoidonCancel() {// 客户端取消调用 cleanup(); }@OverridepublicvoidonComplete() {// 调用完成 logCompletion(); }};4.4 业务方法调用时序图

五、响应编码与发送

5.1 响应消息的序列化

gRPC 使用 Protocol Buffers 作为默认的序列化格式。响应消息的序列化过程:

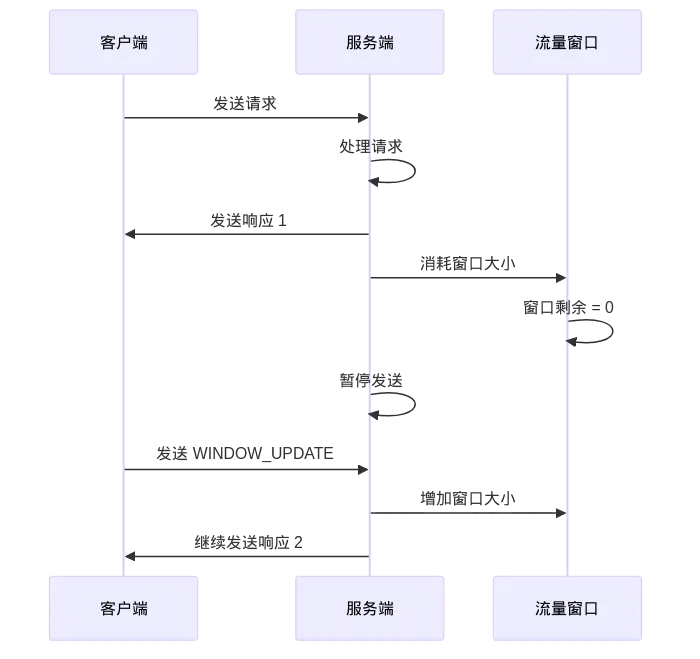

// io.grpc.internal.ServerCallImpl@OverridepublicvoidsendMessage(RespT message) { checkState(!closed, "Call is closed"); checkState(headersSent, "Headers must be sent before messages");try {// 1. 序列化byte[] payload = method.streamSupplier().valueToStream(message);// 2. 压缩(如果启用)if (compressor != null && !messageIsUncompressed()) { payload = compressor.compress(payload); compressedFlag = 1; } else { compressedFlag = 0; }// 3. 构建帧(压缩标志 + 长度 + 数据)ByteBufferframe= buildFrame(compressedFlag, payload);// 4. 发送 stream.writeMessage(frame); } catch (Throwable t) { close(Status.INTERNAL.withCause(t), newMetadata()); }}5.2 流量控制机制

HTTP/2 使用流量控制来防止发送方压垮接收方。gRPC 在此基础上实现了应用层的流量控制:

// 流量控制的核心逻辑publicvoidrequest(int numMessages) {// 增加请求计数 requestCount += numMessages;// 向底层流请求更多数据 stream.request(numMessages);}// 当收到消息时publicvoidonMessage(T message) {if (requestCount > 0) { requestCount--; listener.onMessage(message); } else {// 请求计数为 0,暂停接收 bufferMessage(message); }}5.3 响应状态码与 Trailers

gRPC 调用结束时,服务端会发送状态码和 Trailers(尾部元数据):

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

// 发送关闭状态publicvoidclose(Status status, Metadata trailers) { checkState(!closed, "Call is already closed");// 添加状态码到 trailers trailers.put(Status.CODE_KEY, status.getCode());if (status.getDescription() != null) { trailers.put(Status.MESSAGE_KEY, status.getDescription()); }// 发送关闭帧 stream.close(status, trailers); closed = true;}六、线程模型与并发控制

6.1 gRPC 的三层线程模型

gRPC 服务端的线程模型可以分为三层:

6.2 EventLoop 与线程绑定

Netty 的每个 EventLoop 绑定一个线程,一个 Channel 的所有 I/O 操作都在同一个 EventLoop 中执行:

// Netty 的线程绑定EventLoopeventLoop= channel.eventLoop();eventLoop.execute(() -> {// 这个任务会在 EventLoop 的线程中执行// 保证了对 Channel 的访问是线程安全的 channel.writeAndFlush(message);});6.3 串行化执行器(Serializing Executor)

gRPC 使用 SerializingExecutor 来保证同一个 Call 的操作串行执行:

// io.grpc.internal.SerializingExecutorpublicclassSerializingExecutorimplementsExecutor {privatefinal Executor executor;privatefinal Queue<Runnable> queue = newArrayDeque<>();privatebooleanisScheduled=false;@Overridepublicvoidexecute(Runnable command) {synchronized (this) { queue.add(command);if (!isScheduled) { isScheduled = true; executor.execute(this::drainQueue); } } }privatevoiddrainQueue() {while (true) { Runnable task;synchronized (this) { task = queue.poll();if (task == null) { isScheduled = false;return; } }try { task.run(); } catch (Throwable t) {// 异常处理 } } }}关键洞察:SerializingExecutor 保证了同一个 Call 的所有操作(onMessage、onComplete 等)按顺序执行,避免了并发问题。

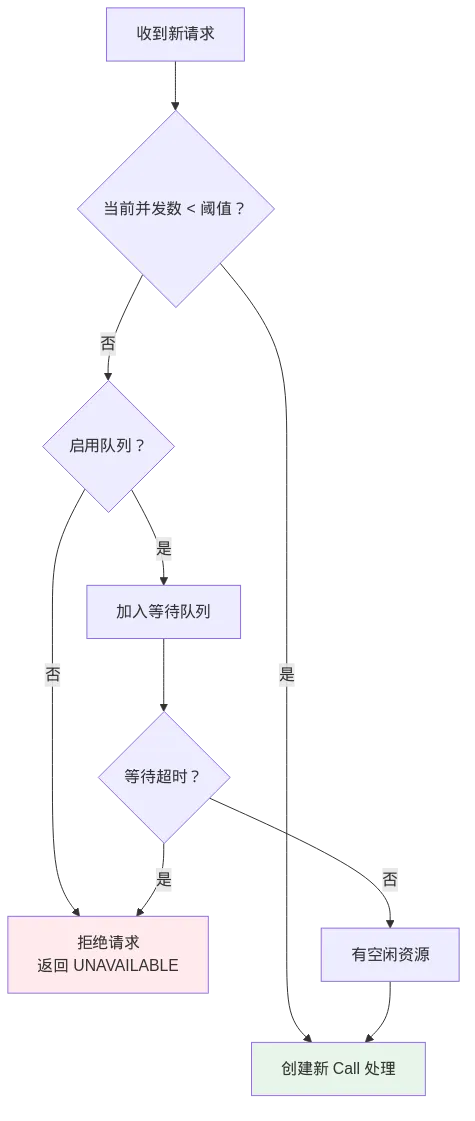

6.4 并发控制最佳实践

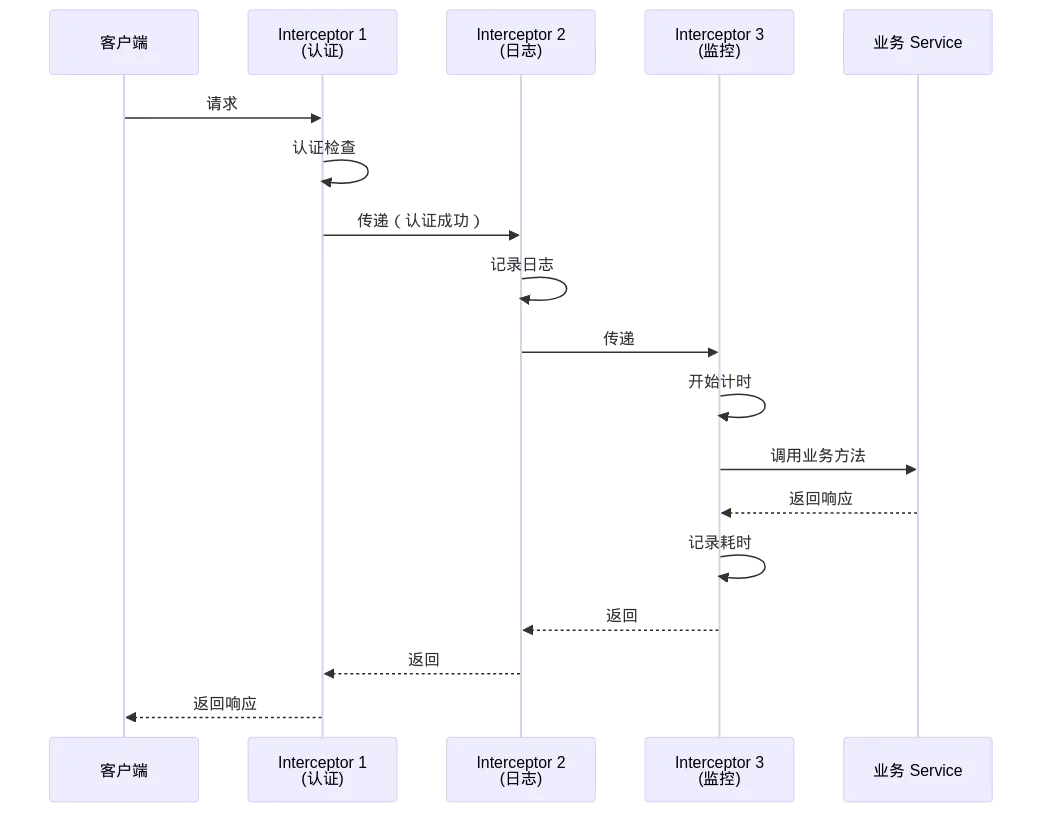

// 配置并发控制Serverserver= ServerBuilder.forPort(8080) .maxConcurrentCallsPerConnection(100) // 每连接最大并发数 .maxConcurrentCalls(10000) // 全局最大并发数 .executor(newThreadPoolExecutor(100, // 核心线程数500, // 最大线程数60, TimeUnit.SECONDS,newLinkedBlockingQueue<>(1000) )) .build();七、拦截器链执行

7.1 拦截器的设计模式

gRPC 的拦截器链采用了责任链模式,每个拦截器可以选择:

-

处理请求并传递给下一个拦截器 -

修改请求/响应 -

直接返回(短路)

7.2 拦截器的注册顺序

拦截器的执行顺序与注册顺序相反(后进先出):

// 注册顺序Serverserver= ServerBuilder.forPort(8080) .intercept(newAuthInterceptor()) // 先注册 .intercept(newLoggingInterceptor()) // 中间注册 .intercept(newMonitoringInterceptor()) // 后注册 .build();// 执行顺序(请求方向):// MonitoringInterceptor → LoggingInterceptor → AuthInterceptor → Service// 执行顺序(响应方向):// Service → AuthInterceptor → LoggingInterceptor → MonitoringInterceptor7.3 ServerInterceptor 实现示例

publicclassAuthInterceptorimplementsServerInterceptor {@Overridepublic <ReqT, RespT> ServerCall.Listener<ReqT> interceptCall( ServerCall<ReqT, RespT> call, Metadata headers, ServerCallHandler<ReqT, RespT> next) {// 1. 提取认证 tokenStringtoken= headers.get(AUTH_TOKEN_KEY);// 2. 验证 tokenif (!isValid(token)) { call.close(Status.UNAUTHENTICATED, newMetadata());returnnewServerCall.Listener<ReqT>() {}; // 空监听器 }// 3. 将用户信息放入 ContextContextctx= Context.current() .withValue(USER_KEY, extractUser(token));// 4. 在上下文中执行下一个拦截器return Contexts.interceptCall(ctx, call, headers, next); }}7.4 拦截器链的创建过程

// io.grpc.internal.ServerImplprivate ServerCall.Listener<ReqT> startCall( ServerCall<ReqT, RespT> call, Metadata headers) {// 创建拦截器链 ServerCallHandler<ReqT, RespT> handler = (c, h) -> getMethod(c.getMethodDescriptor()).startCall(c, h);// 从后向前包装拦截器for (ServerInterceptor interceptor : interceptors) { handler = newInterceptedCallHandler(interceptor, handler); }// 启动调用return handler.startCall(call, headers);}7.5 Context 的传播机制

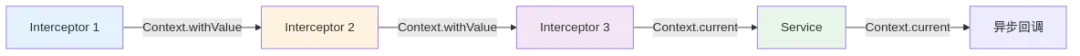

gRPC 使用 Context 来在拦截器链中传递上下文信息:

// Context 的使用Context.Key<User> USER_KEY = Context.key("user");// 设置值Contextctx= Context.current().withValue(USER_KEY, user);ctx.run(() -> {// 在这个作用域内可以获取 userUsercurrentUser= USER_KEY.get();});// 在异步回调中传播 ContextContextctx= Context.current();executor.execute(() -> {try (Closeablec= ctx.attach()) {// 在回调中获取上下文Useruser= USER_KEY.get(); } finally { ctx.detach(c); }});八、异常处理机制

8.1 异常的分类与转换

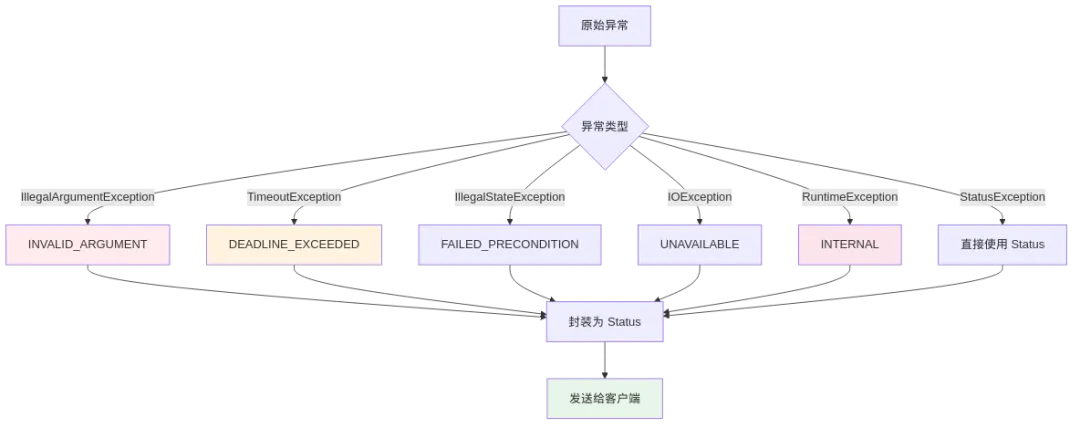

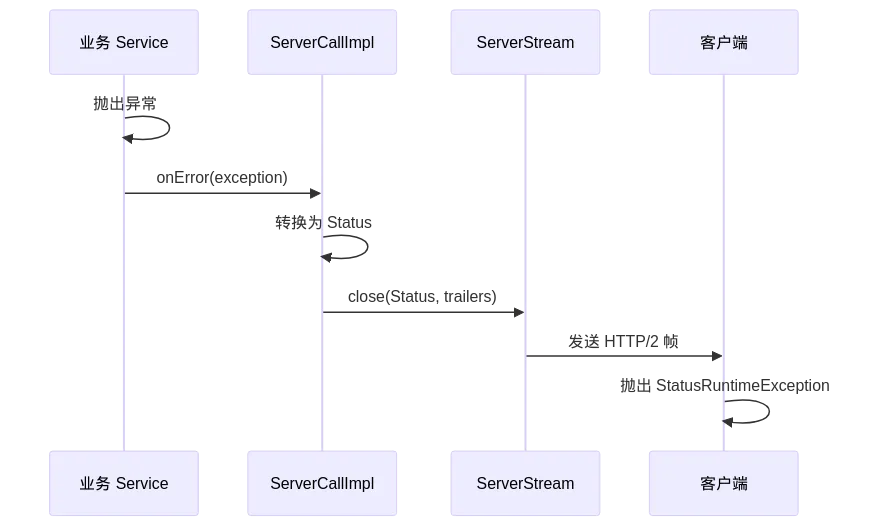

gRPC 将各种异常转换为统一的 Status 对象:

8.2 异常处理的最佳实践

// 推荐:使用 StatusExceptionpublicvoidgetUser(GetUserRequest request, StreamObserver<UserResponse> responseObserver) {try {Useruser= userRepository.findById(request.getId());if (user == null) {throw Status.NOT_FOUND .withDescription("User not found: " + request.getId()) .asException(); } responseObserver.onNext(toResponse(user)); responseObserver.onCompleted(); } catch (StatusException e) { responseObserver.onError(e); } catch (Exception e) { log.error("Unexpected error", e); responseObserver.onError( Status.INTERNAL.withCause(e).asException()); }}8.3 错误传播链路

8.4 全局异常处理器

可以通过拦截器实现全局异常处理:

publicclassErrorHandlingInterceptorimplementsServerInterceptor {@Overridepublic <ReqT, RespT> ServerCall.Listener<ReqT> interceptCall( ServerCall<ReqT, RespT> call, Metadata headers, ServerCallHandler<ReqT, RespT> next) {returnnewForwardingServerCallListener<ReqT>() {@Overrideprotected ServerCall.Listener<ReqT> delegate() {return next.startCall(call, headers); }@OverridepublicvoidonMessage(ReqT message) {try { delegate().onMessage(message); } catch (Exception e) { handleException(call, e); } }@OverridepublicvoidonHalfClose() {try { delegate().onHalfClose(); } catch (Exception e) { handleException(call, e); } }privatevoidhandleException(ServerCall call, Exception e) {Statusstatus= convertToStatus(e); call.close(status, createTrailers(e)); } }; }}九、性能优化最佳实践

9.1 连接池配置

// 服务端配置优化Serverserver= ServerBuilder.forPort(8080) .maxConcurrentCallsPerConnection(100) // 根据业务调整 .maxConnectionIdle(5, TimeUnit.MINUTES) // 空闲连接回收 .maxConnectionAge(30, TimeUnit.MINUTES) // 连接最大寿命 .maxConnectionAgeGrace(5, TimeUnit.MINUTES) // 优雅关闭宽限期 .permitKeepAliveTime(5, TimeUnit.MINUTES) // 客户端 ping 频率限制 .permitKeepAliveWithoutCalls(false) // 禁止无调用 ping .build();9.2 线程池配置

// 根据业务类型选择线程池ThreadPoolExecutorexecutor=newThreadPoolExecutor( Runtime.getRuntime().availableProcessors() * 2, // 核心线程数 Runtime.getRuntime().availableProcessors() * 4, // 最大线程数60, TimeUnit.SECONDS, // 空闲线程回收时间newLinkedBlockingQueue<>(1000), // 任务队列newThreadFactoryBuilder() .setNameFormat("grpc-executor-%d") .setDaemon(true) .build(),newThreadPoolExecutor.CallerRunsPolicy() // 拒绝策略);9.3 压缩配置

// 启用压缩Serverserver= ServerBuilder.forPort(8080) .compressorRegistry(CompressorRegistry.getDefaultInstance()) .decompressorRegistry(DecompressorRegistry.getDefaultInstance()) .build();// 在 Call 级别控制压缩call.setCompression("gzip"); // 启用 gzip 压缩9.4 监控指标

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

十、总结与行动建议

顶层结论:gRPC 服务端是一个基于 Netty 的三层架构系统,理解其调用流程是性能优化和问题排查的基础。

第二层要点:

-

传输层(Netty + HTTP/2)负责网络连接和帧处理 -

框架层(gRPC Core)负责路由、拦截器、序列化 -

业务层(用户 Service)负责领域逻辑

第三层细节:8 个核心流程(启动、连接、解码、路由、调用、响应、并发、异常)

理解源码不是为了炫技,而是为了在问题来临时,能够快速定位、精准解决。希望这篇文章能成为你 gRPC 技术栈中的一块坚实基石。

夜雨聆风

夜雨聆风