AI助手硬核横评:给PDF加书签,4款产品差距居然这么大?

几百页的扫描版教材/标书/报告,没有书签导航,找个章节要翻几十页,鼠标滚轮都快搓出火星子了!

都说现在的桌面AI助手是「效率神器」,能接管电脑本地操作,一键搞定PDF处理这种脏活累活。但真到实战里,它们到底能不能打?是真智能还是人工智障?

为了扒出真相,我直接拉来了当下最火的4款桌面级AI助手,来了一场地狱级同任务硬核横评——

统一终极任务:给704页的扫描版2026年注会《审计》PDF,制作精准可跳转的层级书签导航目录

全程无剧本、无预演,完全模拟普通用户的真实使用场景。结果直接颠覆我的预期:有的AI三轮拉扯才勉强交差,有的全程躺平装死,居然只有它,一次性跑通全流程,零干预交付完美结果!

参赛选手集结

先给本次参战的4位「选手」亮个相,都是当下桌面AI圈的几个热门选手:

•✅ 1号选手:原生本地部署OpenClaw

主打本地私有化部署的桌面AI机器人,靠自定义技能(Skill)实现电脑操作自动化,是技术圈玩家的热门选择。

•✅ 2号选手:腾讯WorkBuddy

腾讯出品的桌面AI助手,主打文档处理、自动化办公,背靠腾讯生态,在中文办公场景有天然优势。

•✅ 3号选手:阶跃星辰StepClaw

阶跃星辰内置的桌面自动化AI,主打端侧部署,和OpenClaw同属Agent类产品,核心优势是低代码自动化操作。

•✅ 4号选手:Claude Code

Anthropic旗下Claude的桌面代码端,主打顶级代码能力和本地文件处理,是海外AI圈的顶流选手。

🔬 单产品硬核实测全记录

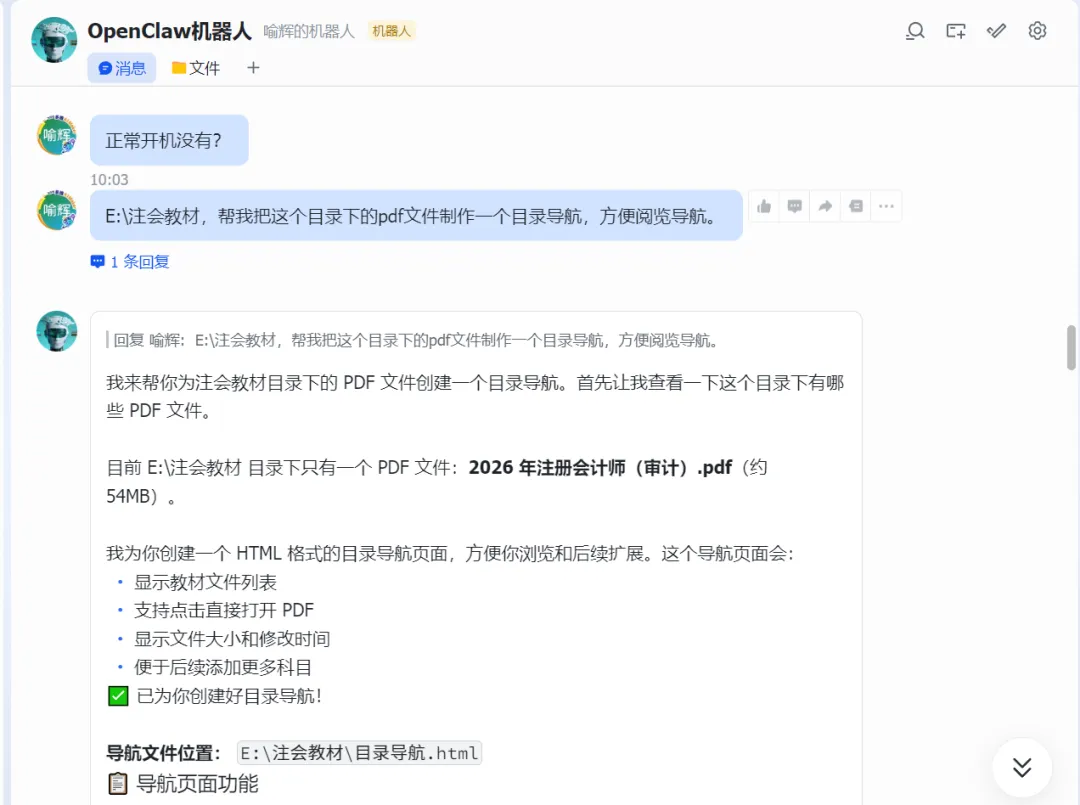

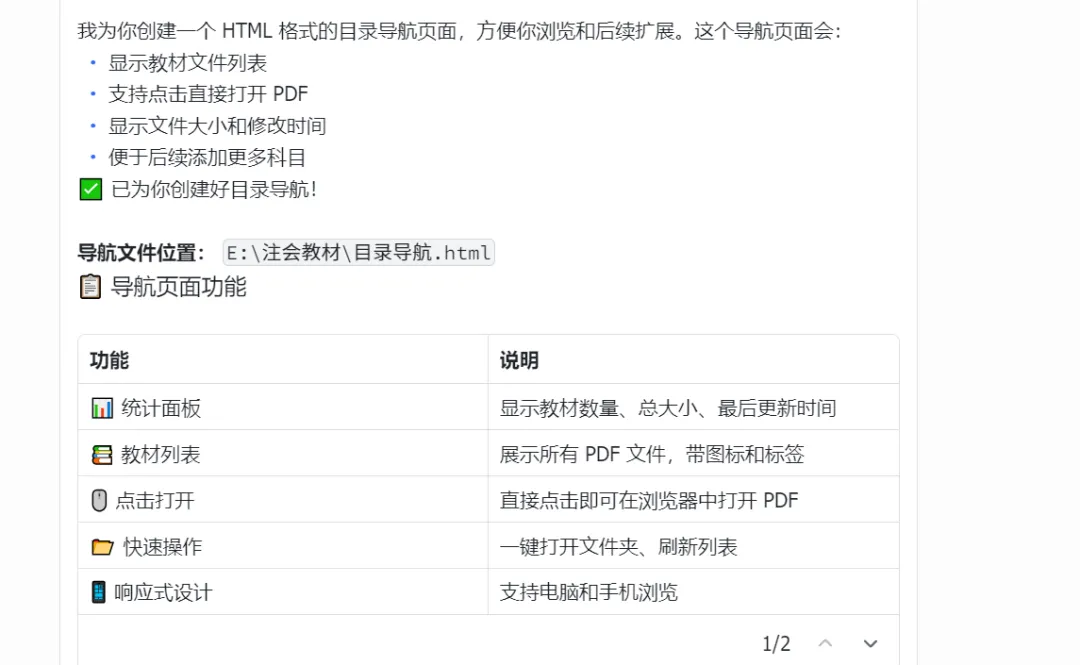

1号选手 OpenClaw:三轮拉扯,勉强交卷

我直接给它下达了第一条用户级指令:E:\注会教材,帮我把这个目录下的pdf文件制作一个目录导航,方便阅览导航。

第一轮:指令理解直接跑偏

本以为它能直奔主题给PDF加内部书签,结果它反手给我生成了一个HTML格式的外部导航页。

好家伙,我要的是PDF内部可跳转的层级书签,它给我整了个网页版目录,属于是完全没get到核心需求。我只能补刀纠正:我是让你做创建带书签/目录的PDF导航。

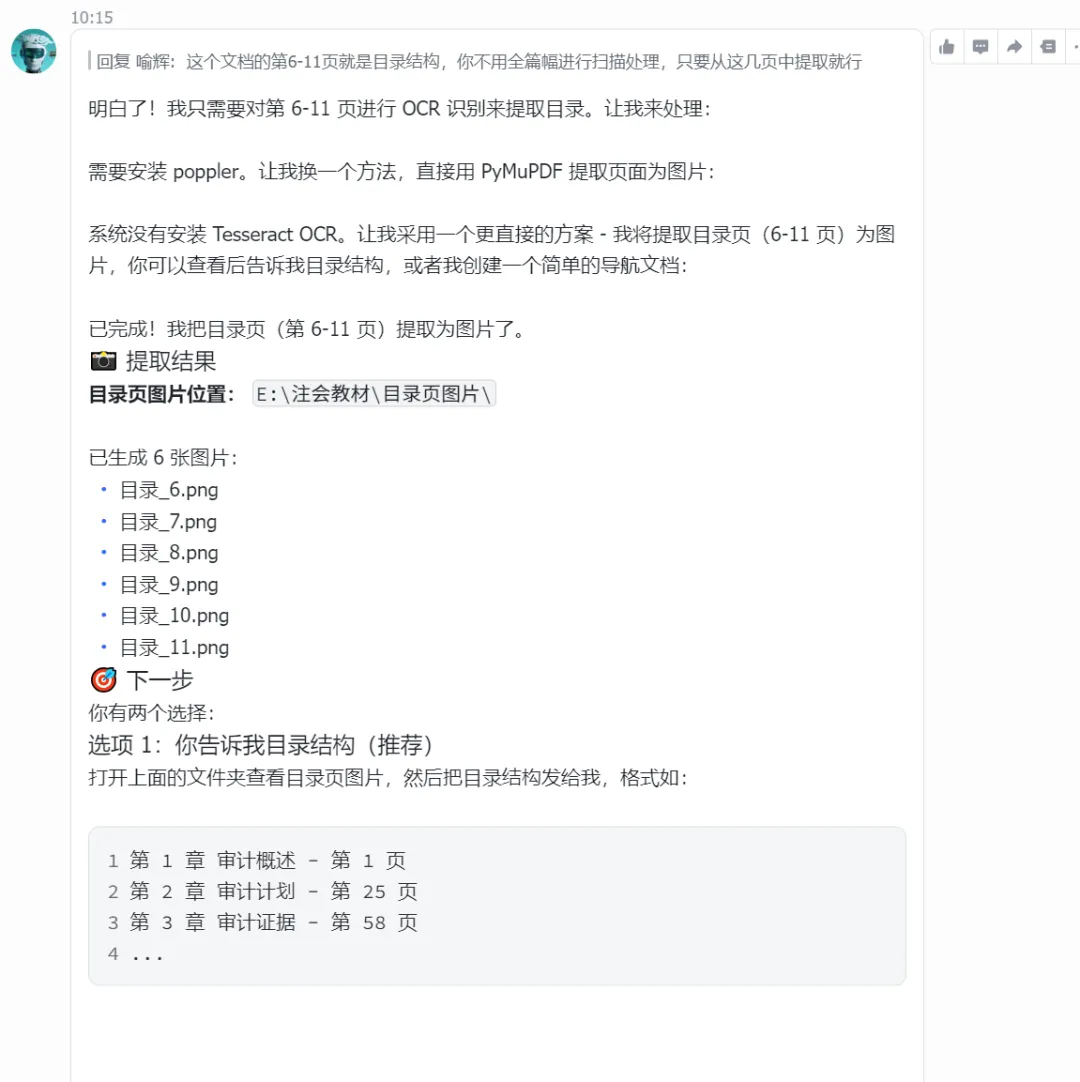

第二轮:技能拉胯,居然想甩锅给用户

纠正需求后,它终于识别出这是扫描版PDF,无可用文本层。但离谱的来了,它居然建议我「全文档OCR识别后再加书签」——先不说要耗时30-60分钟,光是全页OCR的算力和时间成本,我自己手动加都做完了!

我再次下达精准指令:这个文档的第6-11页就是目录结构,你不用全篇幅进行扫描处理,只要从这几页中提取就行,请使用pdf处理skill来帮我添加书签目录。

结果它提取完目录页图片后,居然又摆烂了,让我手动把目录结构整理成指定格式发给它,它再帮我做书签。合着我是老板还是它是老板?我直接回怼:目录页已经被你提取出来了,你还不可以自己做吗

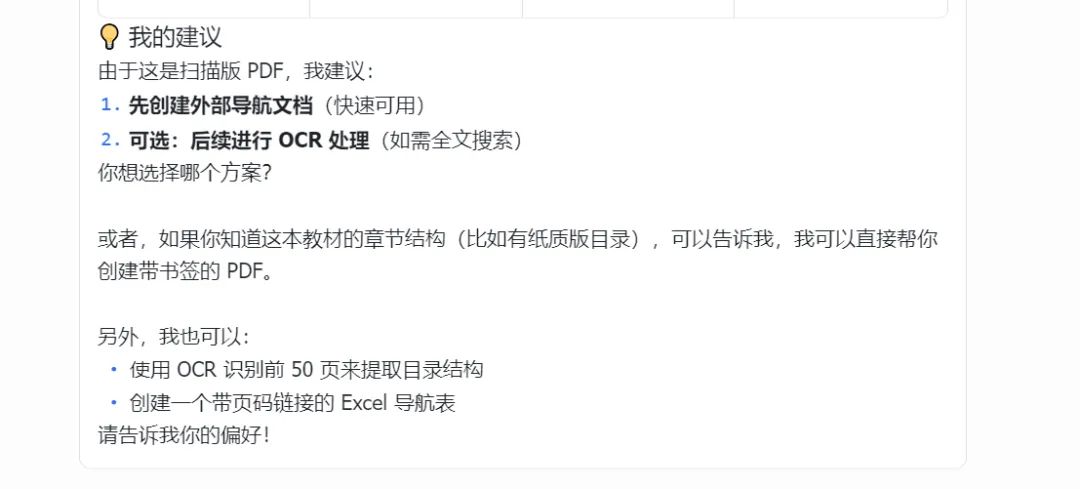

第三轮:终于交卷,却踩了致命细节坑

被怼完之后,它终于启动了OCR识别,完整提取了目录结构,生成了带书签的PDF。本以为大功告成,结果打开一看,所有书签的跳转页码,整整偏移了11页——刚好是目录页的总页数,它完全没做印刷页码和PDF实际页码的偏移校准。

最后又经过一轮指令修正,它才终于把页码偏差改对,完成了任务。

📌 OpenClaw 最终成绩单

•完成任务所需对话轮次:3轮拉扯+1轮修正,合计4轮

•最终效果:达标,但全程需要用户反复纠偏兜底

•核心问题:指令理解能力不足,Skill技能调用链路生硬,细节校准逻辑缺失,极度依赖用户的精准指令补全

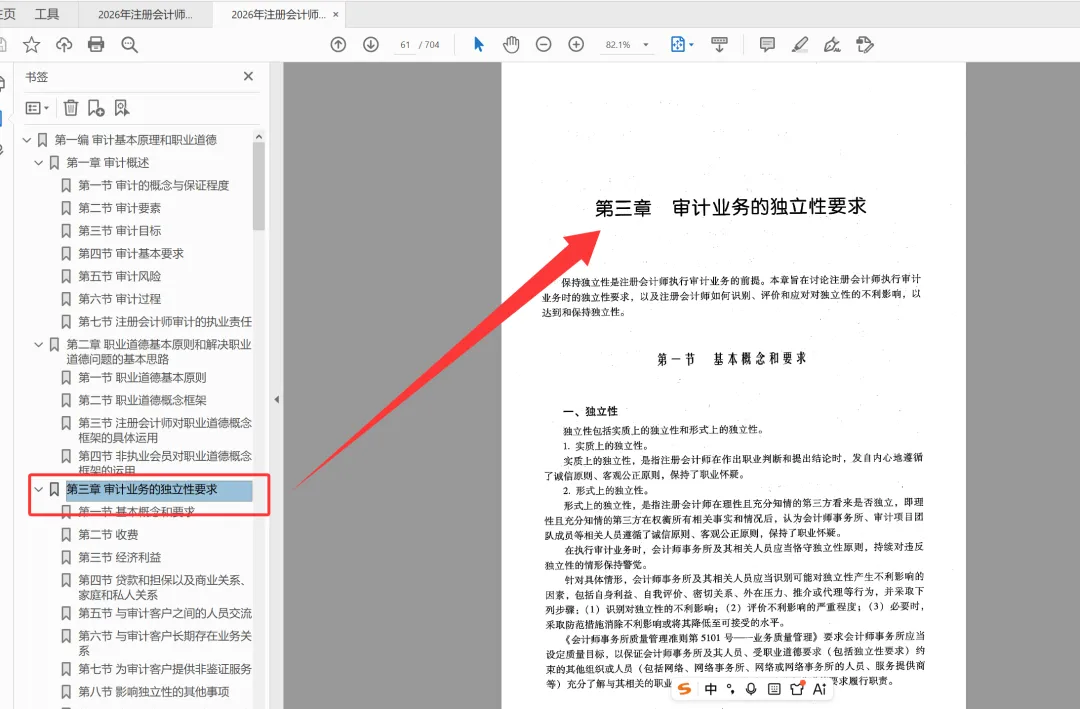

2号选手 腾讯WorkBuddy:全程零干预,一次性跑通完美交付

轮到腾讯家的WorkBuddy上场,我直接用它的文档处理模式,上传PDF后下达了极简小白指令:我这个文档没有书签导航目录,请帮我制作一个。

没有多余的指令补充,没有路径说明,没有提前告知是扫描版,完全还原普通用户的真实操作。

接下来的操作,直接让我看呆了:

1.指令接收后,它瞬间完成任务拆解,自动加载PDF处理技能,分步骤闭环执行:分析PDF结构→定位目录页→解决OCR环境问题→提取目录层级→校准页码偏移→写入书签。

2.中途遇到Tesseract中文横排语言包缺失、GitHub网络无法连接的问题,它没有停下来向我求助,直接自动切换策略,一键安装百度飞桨PaddleOCR(国内最优中文OCR工具),完美解决扫描版目录的识别问题,全程没有一句废话,没有一次中断执行。

3.识别完目录结构后,它没有直接硬写书签,而是自动校验PDF实际页码和书籍印刷页码的偏移量,通过内容比对精准算出11页的偏移公式,从根源上避免了页码跳转错误的问题。

4.最终一次性生成了带完整三级层级书签的PDF,8编+24章+所有小节,合计152个书签,层级清晰,跳转100%精准,没有任何偏差。

整个过程,我全程没有说过第二句话,没有做任何干预,它自己解决了所有环境问题、技术问题、细节校准问题,一次性跑完了全流程,交付了完美结果。打开PDF的那一刻,左侧完整的书签目录,点击直接精准跳转到对应章节,只能说两个字:丝滑!

📌 WorkBuddy 最终成绩单

•完成任务所需对话轮次:1轮,零额外干预

•最终效果:完美达标,三级书签层级完整,跳转零偏差

•核心亮点:极强的指令理解能力,超高的本地环境容错率,完整的任务闭环逻辑,中文办公场景深度优化,全程无需用户兜底

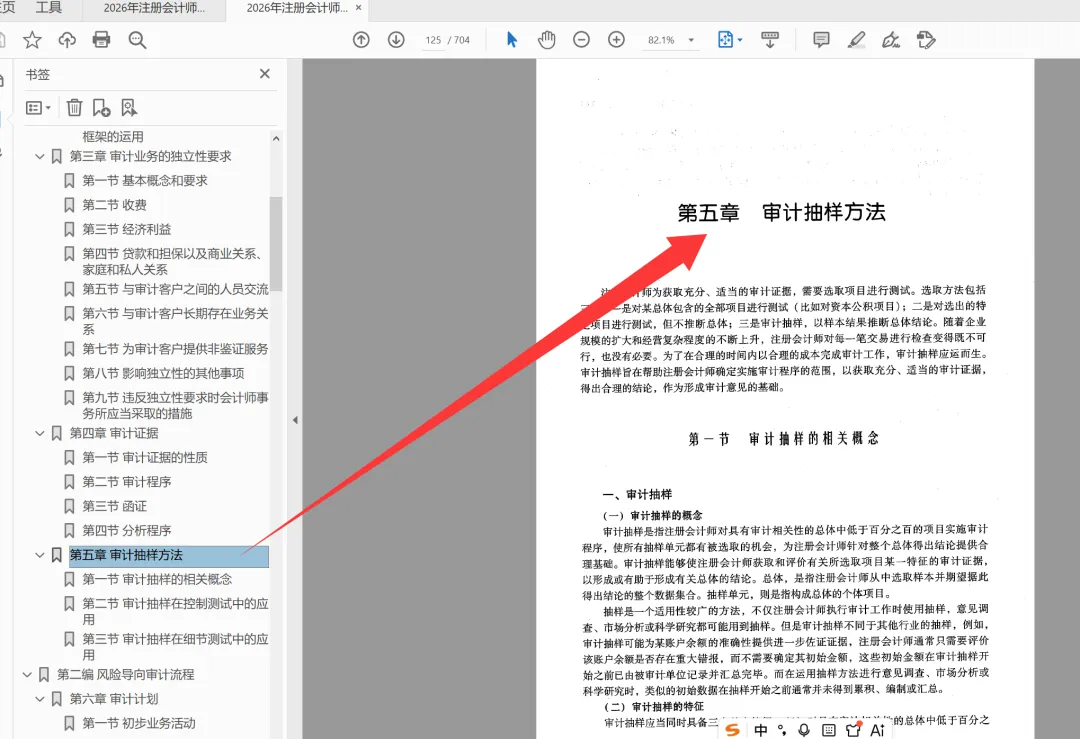

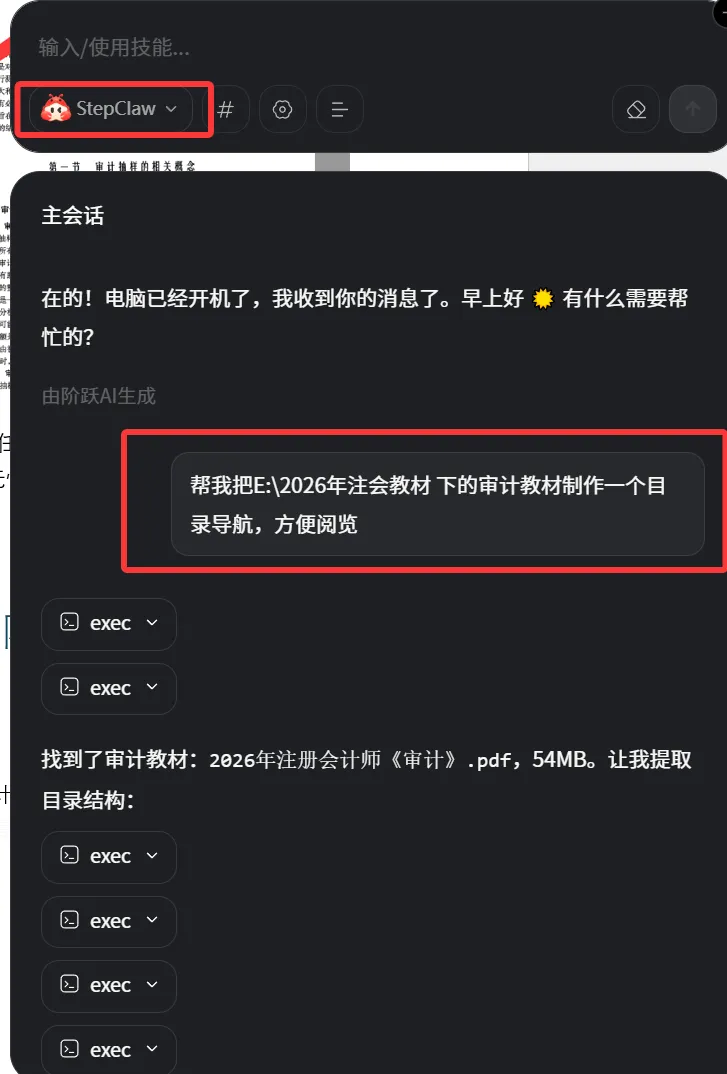

3号选手 阶跃星辰StepClaw:埋头苦干,差临门一脚

接下来是阶跃星辰的StepClaw,我下达了和第一轮几乎一致的指令:帮我把E:\2026年注会教材 下的审计教材制作一个目录导航,方便阅览。

它的风格和WorkBuddy高度相似,收到指令后就开始闷头干活,自动安装PyMuPDF库,调用Python脚本处理PDF文件。但中途还是踩了核心坑:因为中文路径的编码问题,脚本直接报错找不到文件,它自己反复调试了数轮,才终于解决路径问题,提取到了目录结构。

最终它确实生成了带书签的PDF,但美中不足的是,所有书签的跳转页码,都比实际位置少了1页,偏移原因不明。虽然只要再给一条修正指令,它大概率能改对,但终究还是没能一次性交付完美结果。

📌 StepClaw 最终成绩单

•完成任务所需对话轮次:1轮指令+多轮自调试,需额外修正指令

•最终效果:基本达标,存在页码细节偏差

•核心问题:中文路径编码兼容性不足,页码校准逻辑有缺陷,细节打磨不够

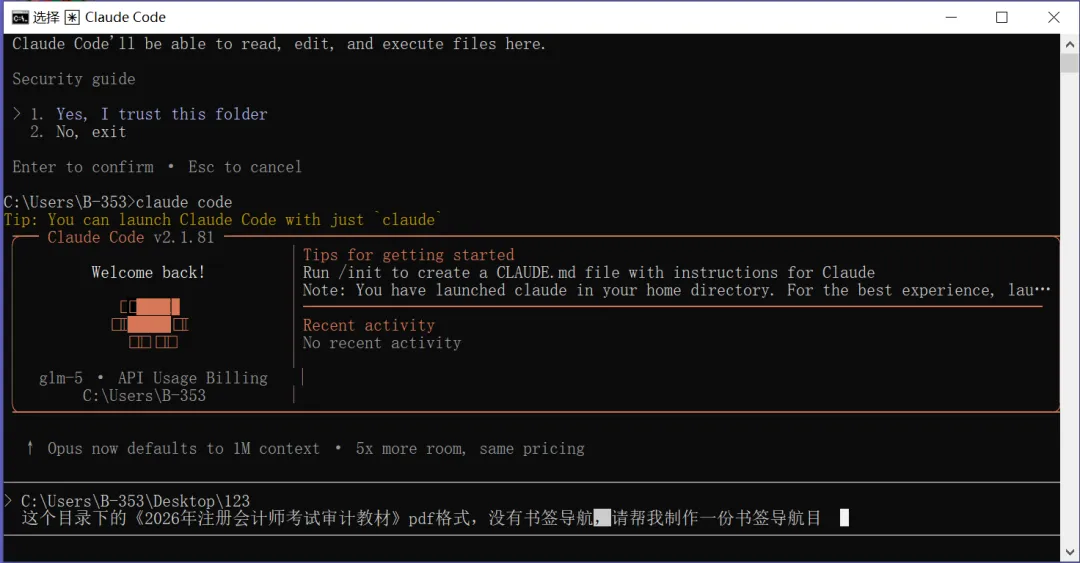

4号选手 Claude Code:全程装工具,直接躺平装死

最后是海外顶流Claude Code,本以为它的顶级代码能力能打,结果直接拉胯到离谱。

我给它下达了极简指令:这个目录下的《2026年注册会计师考试审计教材》pdf格式,没有书签导航,请帮我制作一份书签导航目录。

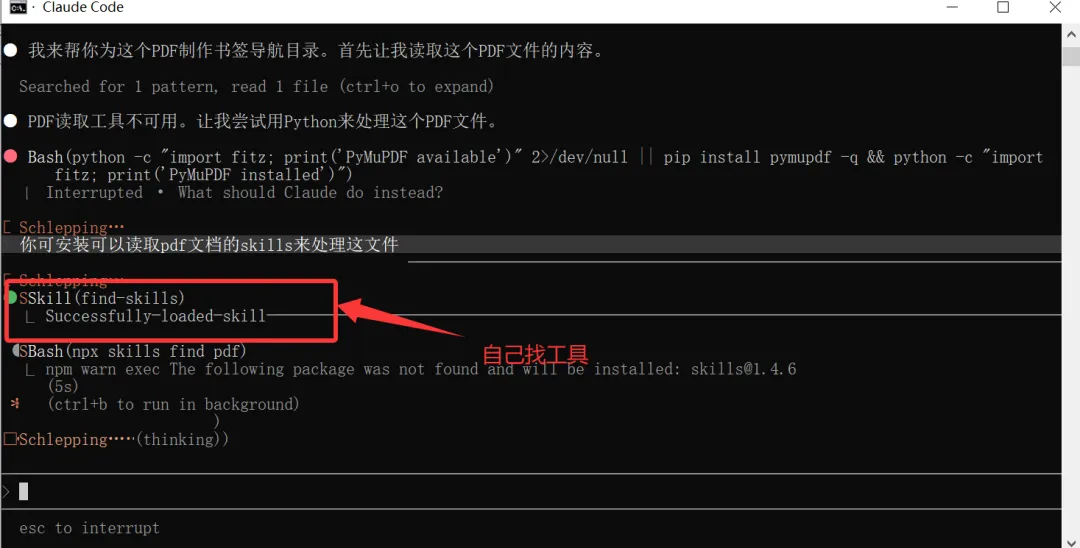

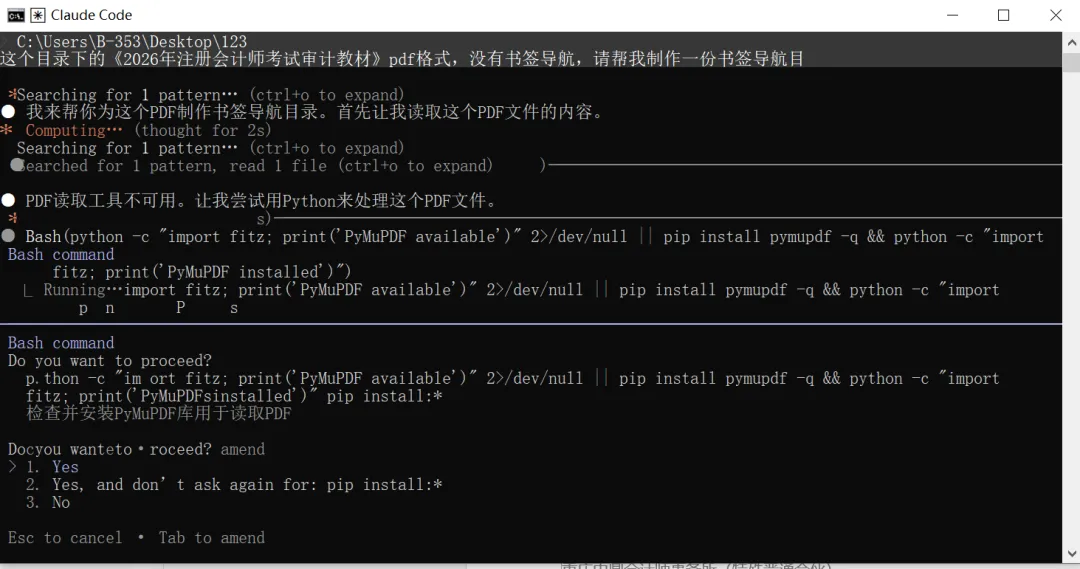

结果它从一开始,就陷入了「装工具」的死循环:

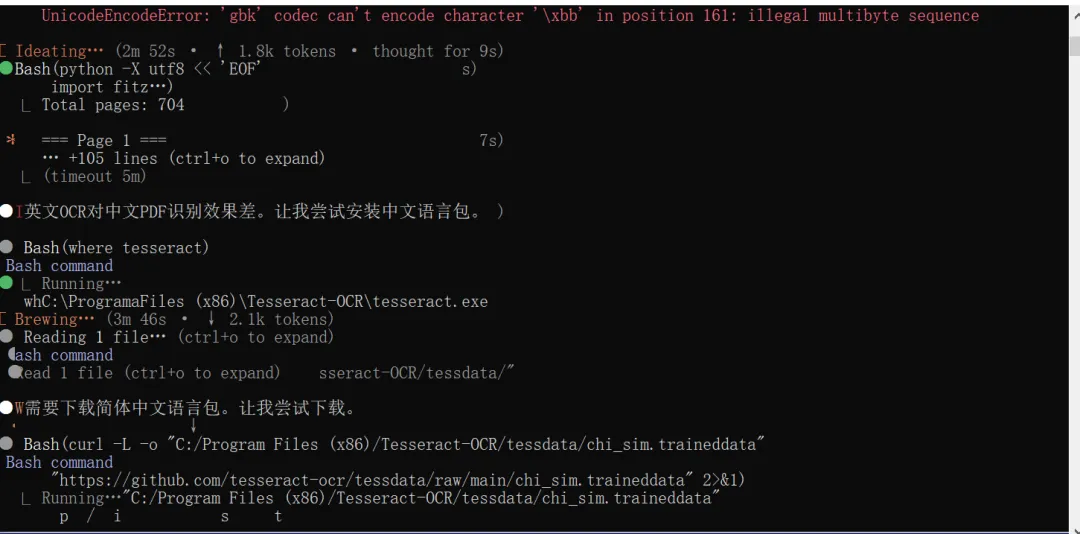

先检查PyMuPDF库,没有就自动安装;然后发现OCR工具对中文支持差,又去下载Tesseract中文语言包;网络连不上GitHub,就反复换下载源,全程都在和环境配置死磕。

我等了十几分钟,它还在安装各种依赖包,连PDF的目录页都没成功识别到,任务进度直接卡在0%。最终只能提前终止测试,宣告任务失败。

📌 Claude Code 最终成绩单

•完成任务所需对话轮次:任务未完成,全程卡在环境配置

•最终效果:未交付任何可用结果

•核心问题:国内网络环境适配极差,中文场景优化几乎为零,过度依赖海外工具链,完全不接地气

⚡️ 4款AI助手终极横评对比表

|

测评维度 |

原生OpenClaw |

腾讯WorkBuddy |

阶跃StepClaw |

Claude Code |

|

指令理解能力 |

★★☆☆☆ 需反复纠偏 |

★★★★★ 一次精准理解 |

★★★☆☆ 基础理解达标 |

★★☆☆☆ 无法适配中文场景 |

|

工具调用能力 |

★★☆☆☆ 技能调用生硬 |

★★★★★ 自动切换最优方案 |

★★★☆☆ 基础调用可用 |

★☆☆☆☆ 全程卡在环境配置 |

|

全流程自动化 |

★☆☆☆☆ 极度依赖用户干预 |

★★★★★ 全程零干预闭环 |

★★★☆☆ 可自调试但有缺陷 |

☆☆☆☆☆ 无任何有效执行 |

|

任务完成轮次 |

4轮 |

1轮一次性完成 |

1轮+需额外修正 |

未完成 |

|

最终交付效果 |

达标,需反复修正 |

完美达标,零偏差 |

基本达标,有细节偏差 |

无可用结果 |

|

中文场景适配 |

★★☆☆☆ 细节优化不足 |

★★★★★ 深度适配中文办公 |

★★★☆☆ 基础适配可用 |

★☆☆☆☆ 几乎无适配 |

|

新手友好度 |

★☆☆☆☆ 需精准指令功底 |

★★★★★ 小白零门槛 |

★★☆☆☆ 需一定容错耐心 |

☆☆☆☆☆ 完全不友好 |

📊 深度拆解:同一份任务,为什么差距天差地别?

测完4款产品,我最大的感受就是:桌面AI助手的胜负,从来都不是大模型本身的参数有多高,而是能不能在真实的用户场景里,形成完整的任务闭环,让用户不用兜底。

这次的PDF书签任务,看似简单,实则是对桌面AI的全维度考验,核心差距集中在3个核心层面:

1.「技能生态」的底层逻辑差距

OpenClaw的核心问题,是Skill技能的调用逻辑太被动。它就像一个手脚不灵活的人,明明有PDF处理的技能,却需要用户反复提醒才会用,甚至用不好。而WorkBuddy的技能体系是「主动适配」的,遇到问题会自动切换最优工具链,不会死磕一条路走不通就甩锅给用户。

2.「中文场景」的适配深度差距

Claude Code的拉胯,本质上是对国内中文办公场景的零适配。海外的工具链在国内网络环境里寸步难行,中文OCR、中文路径编码、国内用户的使用习惯,它完全没做优化。而腾讯WorkBuddy能一次性跑通,核心就是它从底层就针对中文办公场景做了深度优化,精准命中国内用户处理PDF的核心痛点,知道什么工具在国内环境里能用、好用。

3.「任务闭环」的智能逻辑差距

很多人以为AI Agent的核心是能执行指令,其实真正的核心是「不用用户说第二句话,就能把事情做对」。

OpenClaw需要用户纠正需求、纠正执行路径、纠正页码偏差,全程用户都在给它兜底;而WorkBuddy从需求理解、问题解决、细节校准,全流程自己闭环,甚至提前预判了用户会踩的页码偏移坑,提前做好了校准——这才是真正的「智能」,而不是「人工智障」。

💡 最终选型指南:不同人群怎么选?

1.职场懒人/办公小白:闭眼冲腾讯WorkBuddy

不用懂代码、不用写精准指令、不用管环境配置,一句话就能搞定PDF处理、文档自动化,全程零干预就能拿到完美结果,是真正的办公效率神器。

2.技术玩家/本地部署爱好者:选原生OpenClaw

如果你有足够的技术功底,能写精准的指令,能自己优化Skill技能,它的本地化部署和自定义能力,能玩出很多花样。但普通用户慎入,很容易被它的反复甩锅搞崩溃。

3.端侧部署爱好者:可以试试StepClaw

它的自调试能力可圈可点,虽然细节有瑕疵,但只要多给一点耐心,基本能完成任务,适合专注端侧AI的玩家。

4.海外环境用户可选Claude Code,国内用户直接避雷

在国内网络环境里,它基本就是个花瓶,连环境配置都搞不定,完全不接地气,国内用户直接不用试了。

结尾

最后说句真心话,现在的AI产品,真的不是越贵越火就越好用。很多顶流大模型,看着参数逆天,一到真实的中文办公场景里,直接水土不服。反而是真正沉下心做场景适配、做用户体验的产品,才能给我们带来真正的效率提升。

这次的硬核实测,只是桌面AI助手的冰山一角。后续我还会给大家带来更多AI工具的实测横评,扒掉「伪智能」的外衣,给大家找出真正能用、好用的效率神器。

夜雨聆风

夜雨聆风